Weight Space Representation Learning on Diverse NeRF Architectures

作者: Francesco Ballerini, Pierluigi Zama Ramirez, Luigi Di Stefano, Samuele Salti

分类: cs.CV

发布日期: 2025-02-13 (更新: 2025-12-09)

备注: v3: added quantitative Objaverse retrieval and language tasks. Under review

💡 一句话要点

提出一种架构无关的NeRF权重空间表征学习框架,用于处理多样NeRF架构。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 NeRF 权重空间表征学习 图元网络 对比学习 架构无关 三维重建 元学习

📋 核心要点

- 现有NeRF处理框架通常依赖于预定义的特定架构,限制了其泛化能力和灵活性。

- 该论文提出一种基于图元网络的无监督表征学习框架,旨在学习架构无关的NeRF权重空间表征。

- 实验结果表明,该方法在多种NeRF架构上,包括训练时未见过的架构,均表现出强大的分类、检索和语言任务性能。

📝 摘要(中文)

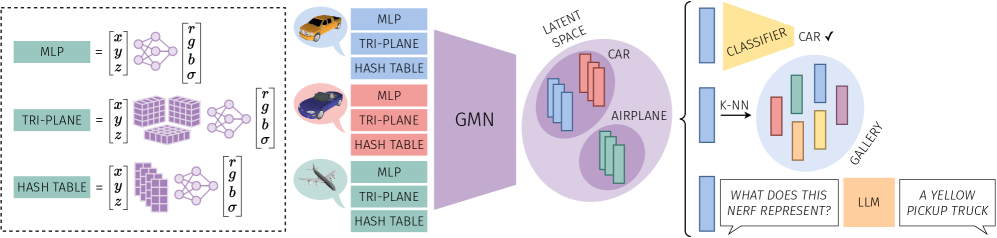

神经辐射场(NeRFs)通过将形状和外观信息编码到神经网络的权重中,已经成为表示3D对象和场景的突破性范例。最近的研究表明,这些权重可以用作旨在解决深度学习任务的框架的输入;然而,这些框架要求NeRFs遵循特定的、预定义的架构。在本文中,我们提出了第一个能够处理具有不同架构的NeRFs,并在训练时未见过的架构上执行推理的框架。我们通过在无监督表征学习框架内训练图元网络来实现这一点,并表明对比目标有助于获得架构无关的潜在空间。在跨越属于三个系列的13种NeRF架构(MLP、三平面,以及首次使用的哈希表)进行的实验中,我们的方法在涉及多种架构(甚至在训练时未见过的架构)的分类、检索和语言任务中表现出强大的性能,同时匹配或超过了现有仅限于单一架构的框架的结果。

🔬 方法详解

问题定义:现有NeRF处理框架通常针对特定架构设计,无法有效处理具有不同架构的NeRF模型。这限制了NeRF在实际应用中的灵活性和可扩展性。因此,需要一种能够处理多样NeRF架构,并在未知架构上进行推理的通用框架。

核心思路:该论文的核心思路是学习一个架构无关的NeRF权重空间表征。通过将不同架构的NeRF模型映射到一个共享的潜在空间,使得在该空间中可以进行各种下游任务,而无需针对特定架构进行训练。这种方法的关键在于找到一种能够捕捉NeRF模型本质特征,同时忽略架构差异的表征方式。

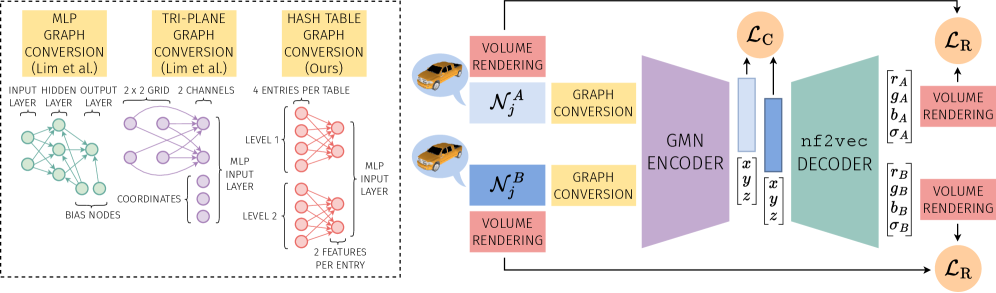

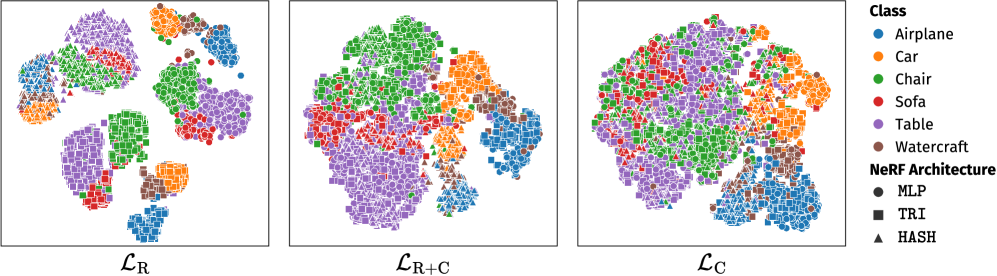

技术框架:该框架主要包含两个阶段:表征学习阶段和下游任务评估阶段。在表征学习阶段,使用一个图元网络(Graph Meta-Network)来编码NeRF模型的权重信息,并利用对比学习的目标函数来训练网络,使得相似的NeRF模型在潜在空间中距离更近,不相似的NeRF模型距离更远。在下游任务评估阶段,将学习到的NeRF表征用于分类、检索和语言任务,以验证其泛化能力。

关键创新:该论文最重要的创新点在于提出了一个架构无关的NeRF权重空间表征学习框架。与现有方法相比,该框架能够处理具有不同架构的NeRF模型,并在训练时未见过的架构上进行推理。此外,该论文首次将图元网络应用于NeRF模型的表征学习,并探索了对比学习在学习架构无关表征方面的有效性。

关键设计:图元网络的设计是关键。该网络将NeRF模型的权重视为图的节点,权重之间的关系视为边,然后利用图神经网络来学习节点的表征。对比损失函数的设计也至关重要,它促使网络学习到能够区分不同NeRF模型,同时忽略架构差异的表征。具体的网络结构和超参数设置需要根据实际情况进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在分类、检索和语言任务中均取得了显著的性能提升。例如,在跨越13种NeRF架构的实验中,该方法在分类任务中取得了超过现有方法的性能,并且在训练时未见过的架构上也表现出良好的泛化能力。此外,该方法还首次在包含哈希表的NeRF架构上进行了实验,验证了其对不同类型NeRF模型的适用性。

🎯 应用场景

该研究成果可广泛应用于3D内容生成、场景理解和机器人导航等领域。例如,可以利用该框架对不同NeRF模型进行分类和检索,从而快速找到符合特定需求的模型。此外,该框架还可以用于NeRF模型的迁移学习,将已有的知识迁移到新的架构上,从而加速NeRF模型的开发和部署。未来,该技术有望推动3D视觉和人工智能的融合,实现更智能化的3D场景理解和交互。

📄 摘要(原文)

Neural Radiance Fields (NeRFs) have emerged as a groundbreaking paradigm for representing 3D objects and scenes by encoding shape and appearance information into the weights of a neural network. Recent studies have demonstrated that these weights can be used as input for frameworks designed to address deep learning tasks; however, such frameworks require NeRFs to adhere to a specific, predefined architecture. In this paper, we introduce the first framework capable of processing NeRFs with diverse architectures and performing inference on architectures unseen at training time. We achieve this by training a Graph Meta-Network within an unsupervised representation learning framework, and show that a contrastive objective is conducive to obtaining an architecture-agnostic latent space. In experiments conducted across 13 NeRF architectures belonging to three families (MLPs, tri-planes, and, for the first time, hash tables), our approach demonstrates robust performance in classification, retrieval, and language tasks involving multiple architectures, even unseen at training time, while also matching or exceeding the results of existing frameworks limited to single architectures.