PoI: A Filter to Extract Pixel of Interest from Novel View Synthesis for Scene Coordinate Regression

作者: Feifei Li, Qi Song, Chi Zhang, Hui Shuai, Rui Huang

分类: cs.CV

发布日期: 2025-02-07 (更新: 2025-09-29)

💡 一句话要点

提出PoI滤波器,从新视角合成中提取可靠像素,提升场景坐标回归精度

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 新视角合成 场景坐标回归 像素过滤 相机位姿估计 视觉定位

📋 核心要点

- 现有NVS方法渲染图像模糊,导致场景坐标回归精度下降,尤其是在像素级坐标估计中。

- 提出双重标准滤波器PoI,基于重投影误差和梯度阈值动态筛选可靠像素,提升训练数据质量。

- 设计粗到精的PoI变体,利用稀疏输入NVS辅助视觉定位,实验证明方法有效且高效。

📝 摘要(中文)

神经辐射场(NeRF)和3D高斯溅射(3DGS)等新视角合成(NVS)技术可以通过渲染图像来扩充训练数据,从而增强相机位姿估计。然而,这些方法渲染的图像通常存在模糊,降低了其作为相机位姿估计训练数据的可靠性。对于旨在进行像素级3D坐标估计的场景坐标回归(SCR)方法来说,这种限制尤为关键,因为渲染伪影会直接导致估计不准确。为了解决这个问题,我们提出了一种双重标准过滤机制,该机制在训练期间动态识别并丢弃次优像素。该双重标准滤波器评估两个并发指标:(1) 实时SCR重投影误差,以及 (2) 坐标回归域上的梯度阈值。此外,对于稀疏输入场景中的视觉定位问题,更有必要使用NVS生成的数据来辅助定位任务。我们设计了一种使用稀疏输入NVS的由粗到精的PoI变体来解决这个问题。室内和室外基准测试的实验证实了我们方法的有效性。它实现了最先进的定位精度,同时保持了计算效率。

🔬 方法详解

问题定义:论文旨在解决新视角合成(NVS)技术生成的图像质量问题,特别是模糊和伪影,这些问题严重影响了场景坐标回归(SCR)的精度。现有的SCR方法在利用NVS数据进行训练时,会受到低质量渲染像素的干扰,导致定位性能下降。

核心思路:论文的核心思路是通过动态过滤掉NVS生成的图像中的不可靠像素(Pixel of Interest, PoI),从而提高训练数据的质量。通过设置双重标准,即重投影误差和梯度阈值,来判断像素的可靠性,只保留高质量的像素用于SCR模型的训练。这样可以减少模糊和伪影对模型的影响,提高定位精度。

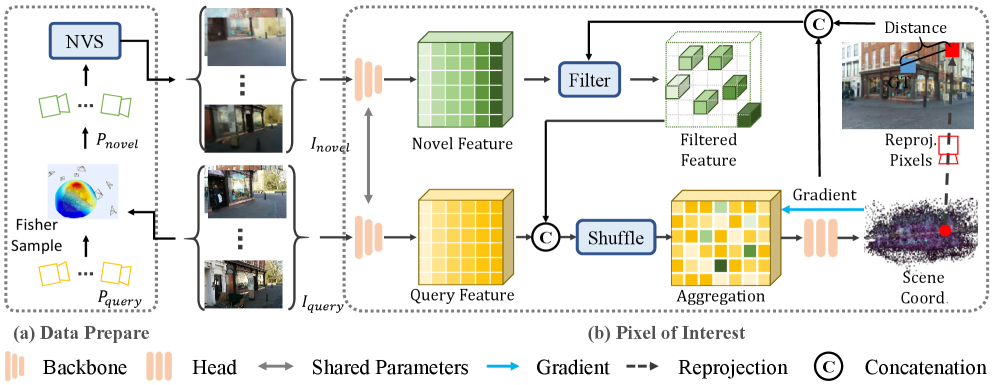

技术框架:整体框架包含以下几个主要步骤:1) 使用NVS技术(如NeRF或3DGS)生成新的视角图像;2) 使用场景坐标回归模型预测新视角图像中像素的3D坐标;3) 计算预测坐标的重投影误差;4) 应用双重标准滤波器(重投影误差和梯度阈值)筛选PoI;5) 使用筛选后的PoI数据训练SCR模型。对于稀疏输入场景,采用粗到精的策略,先进行粗略的定位,再逐步细化。

关键创新:论文的关键创新在于提出了双重标准的PoI滤波器,能够有效地识别和去除NVS生成的图像中的不可靠像素。与传统的直接使用所有渲染像素进行训练的方法相比,PoI滤波器能够显著提高训练数据的质量,从而提升SCR模型的定位精度。此外,针对稀疏输入场景设计的粗到精的PoI变体也具有一定的创新性。

关键设计:双重标准滤波器的关键设计在于重投影误差和梯度阈值的选择。重投影误差反映了预测3D坐标与实际2D像素位置的偏差,梯度阈值则反映了坐标回归的置信度。具体实现中,需要根据具体场景和数据集调整这两个阈值,以达到最佳的过滤效果。此外,粗到精的PoI变体中,需要设计合适的粗略定位方法和细化策略,以保证定位的准确性和效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在室内和室外基准测试中均取得了最先进的定位精度,同时保持了计算效率。具体性能数据未知,但摘要强调了其超越现有技术的优越性。通过动态筛选高质量像素,显著提升了场景坐标回归的准确性。

🎯 应用场景

该研究成果可广泛应用于增强现实、机器人导航、自动驾驶等领域。通过提高场景坐标回归的精度,可以提升AR应用的定位效果,增强机器人对环境的感知能力,并为自动驾驶车辆提供更准确的定位信息。未来,该方法有望进一步扩展到其他需要精确3D场景理解的应用中。

📄 摘要(原文)

Novel View synthesis (NVS) techniques, notably Neural Radiance Fields (NeRF) and 3D Gaussian Splatting (3DGS), can augment camera pose estimation by extending training data with rendered images. However, the images rendered by these methods are often plagued by blurring, undermining their reliability as training data for camera pose estimation. This limitation is particularly critical for Scene Coordinate Regression (SCR) methods, which aim at pixel-level 3D coordinate estimation, because rendering artifacts directly lead to estimation inaccuracies. To address this challenge, we propose a dual-criteria filtering mechanism that dynamically identifies and discards suboptimal pixels during training. The dual-criteria filter evaluates two concurrent metrics: (1) real-time SCR reprojection error, and (2) gradient threshold, across the coordinate regression domain. In addition, for visual localization problems in sparse input scenarios, it will be even more necessary to use data generated by NVS to assist the localization task. We design a coarse-to-fine PoI variant using sparse input NVS to solve this problem. Experiments across indoor and outdoor benchmarks confirm our method's efficacy. It achieves state-of-the-art localization accuracy while maintaining computational efficiency.