SC-OmniGS: Self-Calibrating Omnidirectional Gaussian Splatting

作者: Huajian Huang, Yingshu Chen, Longwei Li, Hui Cheng, Tristan Braud, Yajie Zhao, Sai-Kit Yeung

分类: cs.CV, cs.GR

发布日期: 2025-02-07

备注: Accepted to ICLR 2025, Project Page: http://www.chenyingshu.com/sc-omnigs/

💡 一句话要点

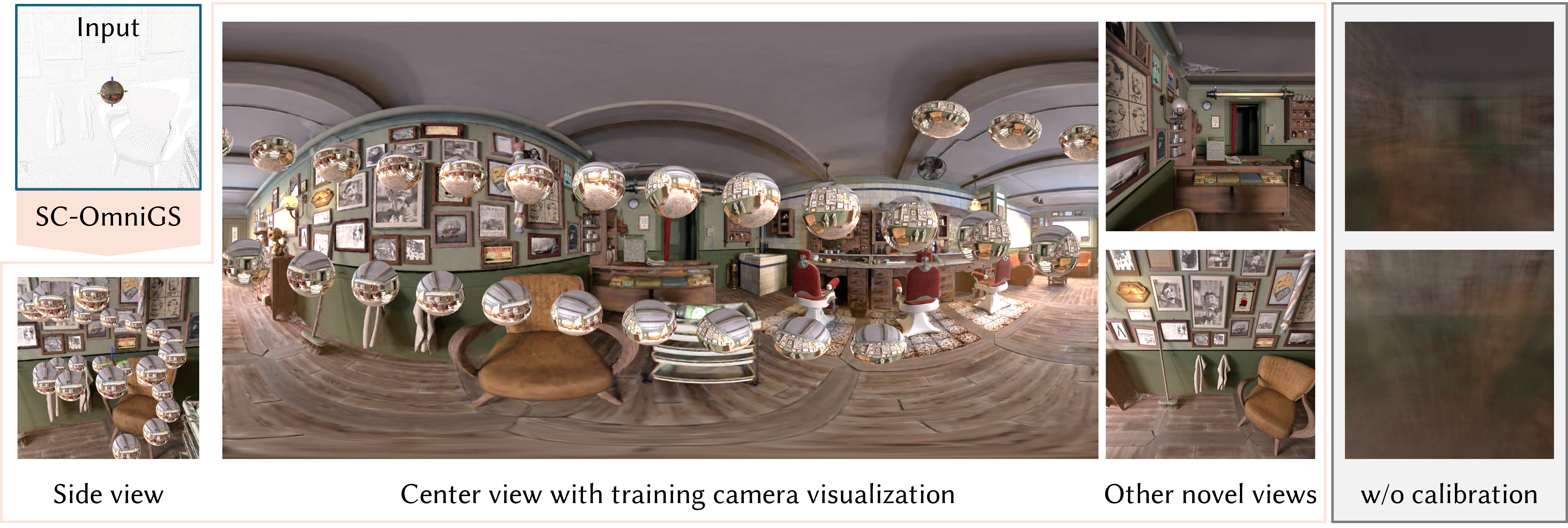

SC-OmniGS:一种自校准全景高斯溅射方法,用于快速精确的全景辐射场重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 全景图像 辐射场重建 高斯溅射 相机自校准 可微渲染 3D重建 球面光度损失

📋 核心要点

- 传统辐射场方法难以处理360度图像的固有挑战,例如图像畸变和相机姿态估计。

- SC-OmniGS将360度图像视为一个球体,推导数学框架,直接进行全景相机姿态校准和3D高斯优化。

- 实验表明,即使在相机姿态噪声较大或无先验的情况下,SC-OmniGS也能重建高质量辐射场,并有效减少图像失真。

📝 摘要(中文)

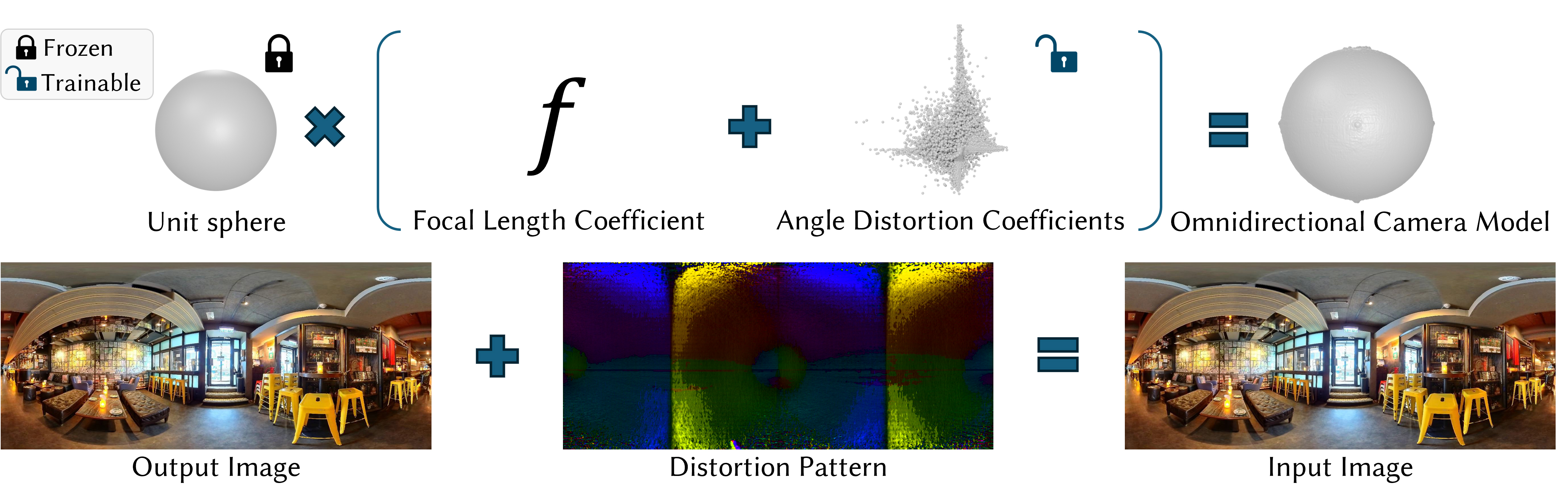

本文提出了一种新颖的自校准全景高斯溅射系统SC-OmniGS,用于利用360度图像进行快速而精确的全景辐射场重建。该方法没有将360度图像转换为立方体贴图并执行透视图像校准,而是将360度图像视为一个完整的球体,并推导出一个数学框架,该框架能够直接进行全景相机姿态校准以及3D高斯优化。此外,为了提高性能,我们引入了一个可微的全景相机模型,以校正真实世界数据的失真。总体而言,通过最小化加权球面光度损失来联合优化全景相机内参模型、外参姿态和3D高斯。大量实验表明,我们提出的SC-OmniGS能够在具有宽基线和非以对象为中心的配置等具有挑战性的场景中,从嘈杂的相机姿态甚至没有姿态先验的情况下恢复高质量的辐射场。消费级全景相机捕获的真实世界数据集的显著性能提升验证了我们通用全景相机模型在减少360度图像失真方面的有效性。

🔬 方法详解

问题定义:现有辐射场方法在处理360度全景图像时面临挑战,主要体现在两个方面:一是全景图像的畸变较大,传统的透视相机模型难以准确描述;二是全景图像的相机姿态估计通常不够精确,甚至缺失,影响重建质量。因此,需要一种能够处理全景图像畸变并进行自校准的辐射场重建方法。

核心思路:SC-OmniGS的核心思路是将360度全景图像视为一个完整的球体,并在此基础上建立数学模型,直接对全景相机姿态进行校准,并同时优化3D高斯参数。通过可微的全景相机模型来校正图像畸变,并使用球面光度损失函数来联合优化相机内参、外参和3D高斯参数。

技术框架:SC-OmniGS的整体框架包括以下几个主要步骤:1) 初始化3D高斯分布;2) 使用可微的全景相机模型将3D高斯投影到全景图像上;3) 计算球面光度损失;4) 使用优化算法(如Adam)联合优化相机内参、外参和3D高斯参数。该过程迭代进行,直到收敛。

关键创新:SC-OmniGS的关键创新在于:1) 提出了一个可微的全景相机模型,能够有效地校正全景图像的畸变;2) 建立了一个数学框架,可以直接在球面上进行相机姿态校准和3D高斯优化,避免了将全景图像转换为立方体贴图的步骤;3) 实现了相机内参、外参和3D高斯参数的联合优化,提高了重建的精度和鲁棒性。

关键设计:SC-OmniGS的关键设计包括:1) 使用球面光度损失函数来度量重建结果与真实图像之间的差异;2) 使用加权策略来平衡不同视角下的损失;3) 使用Adam优化器来优化相机参数和3D高斯参数;4) 对3D高斯的大小和透明度进行自适应调整,以提高重建的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SC-OmniGS在各种具有挑战性的场景中均能取得优异的性能。与现有方法相比,SC-OmniGS在重建质量和速度上均有显著提升。尤其是在相机姿态噪声较大或无先验的情况下,SC-OmniGS的性能优势更加明显。在真实世界数据集上,SC-OmniGS能够有效地减少图像畸变,提高重建的真实感。

🎯 应用场景

SC-OmniGS在虚拟现实、增强现实、机器人导航、自动驾驶等领域具有广泛的应用前景。它可以用于快速构建高质量的3D场景模型,为用户提供沉浸式的体验。此外,该方法还可以用于室内场景重建、文物数字化保护等领域,具有重要的实际价值。

📄 摘要(原文)

360-degree cameras streamline data collection for radiance field 3D reconstruction by capturing comprehensive scene data. However, traditional radiance field methods do not address the specific challenges inherent to 360-degree images. We present SC-OmniGS, a novel self-calibrating omnidirectional Gaussian splatting system for fast and accurate omnidirectional radiance field reconstruction using 360-degree images. Rather than converting 360-degree images to cube maps and performing perspective image calibration, we treat 360-degree images as a whole sphere and derive a mathematical framework that enables direct omnidirectional camera pose calibration accompanied by 3D Gaussians optimization. Furthermore, we introduce a differentiable omnidirectional camera model in order to rectify the distortion of real-world data for performance enhancement. Overall, the omnidirectional camera intrinsic model, extrinsic poses, and 3D Gaussians are jointly optimized by minimizing weighted spherical photometric loss. Extensive experiments have demonstrated that our proposed SC-OmniGS is able to recover a high-quality radiance field from noisy camera poses or even no pose prior in challenging scenarios characterized by wide baselines and non-object-centric configurations. The noticeable performance gain in the real-world dataset captured by consumer-grade omnidirectional cameras verifies the effectiveness of our general omnidirectional camera model in reducing the distortion of 360-degree images.