High-Speed Dynamic 3D Imaging with Sensor Fusion Splatting

作者: Zihao Zou, Ziyuan Qu, Xi Peng, Vivek Boominathan, Adithya Pediredla, Praneeth Chakravarthula

分类: cs.CV, cs.GR

发布日期: 2025-02-07

💡 一句话要点

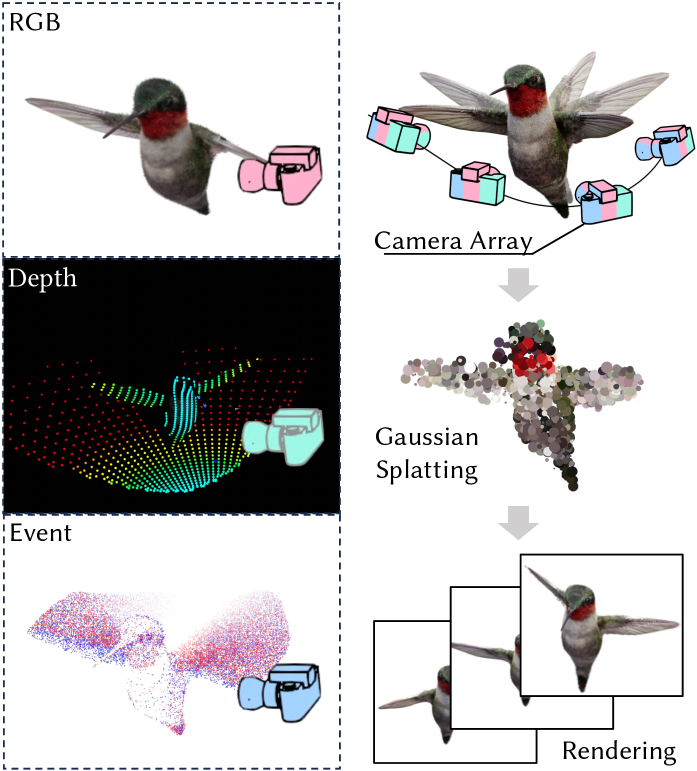

提出基于高斯溅射的传感器融合方法,实现高速动态3D场景重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 传感器融合 高斯溅射 动态3D重建 事件相机 深度相机

📋 核心要点

- 传统RGB相机在高速动态3D场景重建中面临帧率低、曝光时间短和基线窄等问题。

- 提出一种基于高斯溅射的传感器融合方法,结合RGB、深度和事件相机数据,优化可变形3D高斯参数。

- 实验结果表明,该方法在渲染保真度和结构精度方面显著优于现有技术,适用于低光照和快速运动等挑战场景。

📝 摘要(中文)

本文提出了一种新颖的传感器融合方法,利用高斯溅射技术,结合RGB、深度和事件相机,实现高速形变场景的捕获和重建。该方法的核心在于利用不同成像模式的互补优势:RGB相机捕捉详细的颜色信息,事件相机以微秒级分辨率记录快速的场景变化,深度相机提供3D场景几何信息。为了统一不同模态下的场景表示,我们使用可变形的3D高斯表示场景。为了处理快速的场景运动,我们通过整合来自所有三种传感器模态的数据,联合优化3D高斯参数及其时间形变场。这种融合使得即使在低光照、窄基线或快速运动等具有挑战性的条件下,也能高效、高质量地对快速和复杂的场景进行成像。在合成和真实数据集上的实验表明,我们的方法显著优于最先进的技术,在渲染保真度和结构精度方面都取得了显著的改进。

🔬 方法详解

问题定义:论文旨在解决高速动态3D场景重建问题。现有方法,特别是依赖单一成像模态的方法,在处理快速运动、低光照或窄基线等挑战性场景时存在局限性。例如,RGB相机帧率有限,事件相机缺乏颜色信息,深度相机在反射表面上表现不佳。因此,需要一种能够融合多种传感器信息,克服各自局限性的方法。

核心思路:论文的核心思路是利用多种传感器的互补优势,通过传感器融合实现更鲁棒和精确的3D重建。具体来说,RGB相机提供颜色信息,事件相机捕捉快速运动,深度相机提供几何信息。将这些信息融合到一个统一的场景表示中,可以克服单一传感器的局限性,从而实现高质量的高速动态3D重建。

技术框架:该方法的技术框架主要包括以下几个阶段:1) 数据采集:使用RGB相机、深度相机和事件相机同步采集场景数据。2) 场景表示:使用可变形的3D高斯表示场景,每个高斯包含位置、协方差、颜色等参数。3) 联合优化:通过最小化一个损失函数,联合优化3D高斯参数及其时间形变场。损失函数包含颜色损失、深度损失和事件损失,分别约束高斯参数与RGB图像、深度图像和事件流的一致性。4) 渲染:使用优化后的3D高斯参数,通过可微分渲染生成重建结果。

关键创新:该方法最重要的技术创新点在于将高斯溅射技术与传感器融合相结合,实现高速动态3D场景的重建。与传统的基于体素或网格的方法相比,高斯溅射具有更强的表达能力和更高的渲染效率。此外,该方法还提出了一种新的联合优化策略,能够有效地融合来自不同传感器的信息,从而提高重建的鲁棒性和精度。

关键设计:在关键设计方面,该方法采用了以下策略:1) 可变形高斯:使用可变形高斯来表示场景,能够更好地处理快速运动和形变。2) 联合损失函数:设计了一个包含颜色损失、深度损失和事件损失的联合损失函数,能够有效地约束高斯参数与不同传感器数据的一致性。3) 时间形变场:引入时间形变场来建模场景的运动,能够更好地处理非刚性形变。4) 参数初始化:使用深度相机数据初始化高斯参数,能够加速优化过程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成和真实数据集上均取得了显著的性能提升。与现有技术相比,该方法在渲染保真度和结构精度方面都取得了明显的改进。具体数据提升幅度未知,但摘要中强调了“显著优于最先进的技术,在渲染保真度和结构精度方面都取得了显著的改进”。

🎯 应用场景

该研究成果在计算机图形学、计算机视觉以及机器人等领域具有广泛的应用前景。例如,可以应用于高速运动物体的三维重建、虚拟现实和增强现实中的动态场景建模、机器人导航和控制中的环境感知,以及生物学研究中对快速生物过程的观察和分析。该技术能够提升相关应用在复杂环境下的性能和鲁棒性。

📄 摘要(原文)

Capturing and reconstructing high-speed dynamic 3D scenes has numerous applications in computer graphics, vision, and interdisciplinary fields such as robotics, aerodynamics, and evolutionary biology. However, achieving this using a single imaging modality remains challenging. For instance, traditional RGB cameras suffer from low frame rates, limited exposure times, and narrow baselines. To address this, we propose a novel sensor fusion approach using Gaussian splatting, which combines RGB, depth, and event cameras to capture and reconstruct deforming scenes at high speeds. The key insight of our method lies in leveraging the complementary strengths of these imaging modalities: RGB cameras capture detailed color information, event cameras record rapid scene changes with microsecond resolution, and depth cameras provide 3D scene geometry. To unify the underlying scene representation across these modalities, we represent the scene using deformable 3D Gaussians. To handle rapid scene movements, we jointly optimize the 3D Gaussian parameters and their temporal deformation fields by integrating data from all three sensor modalities. This fusion enables efficient, high-quality imaging of fast and complex scenes, even under challenging conditions such as low light, narrow baselines, or rapid motion. Experiments on synthetic and real datasets captured with our prototype sensor fusion setup demonstrate that our method significantly outperforms state-of-the-art techniques, achieving noticeable improvements in both rendering fidelity and structural accuracy.