FairT2I: Mitigating Social Bias in Text-to-Image Generation via Large Language Model-Assisted Detection and Attribute Rebalancing

作者: Jinya Sakurai, Yuki Koyama, Issei Sato

分类: cs.CV

发布日期: 2025-02-06 (更新: 2026-01-07)

💡 一句话要点

FairT2I通过大语言模型辅助检测和属性重平衡缓解文本到图像生成中的社会偏见。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文本到图像生成 社会偏见缓解 大语言模型 潜在变量引导 属性重采样

📋 核心要点

- 现有的文本到图像模型依赖未经筛选的数据集,导致生成结果中存在社会偏见。

- FairT2I利用潜在变量引导和LLM辅助的偏差检测与属性重采样,实现偏差感知生成。

- 实验表明,FairT2I在减少社会偏见、保持图像质量和多样性方面优于现有方法。

📝 摘要(中文)

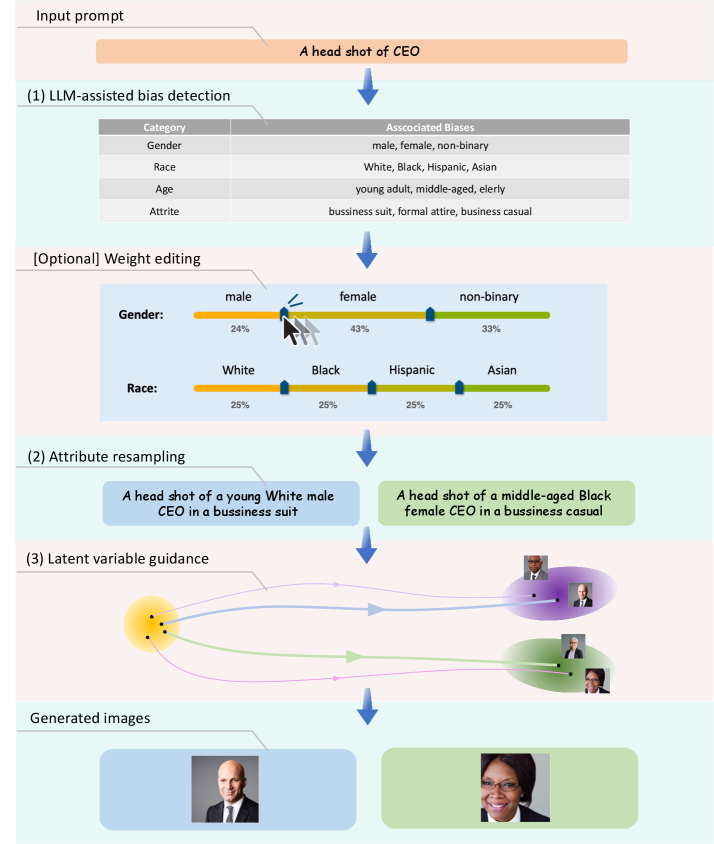

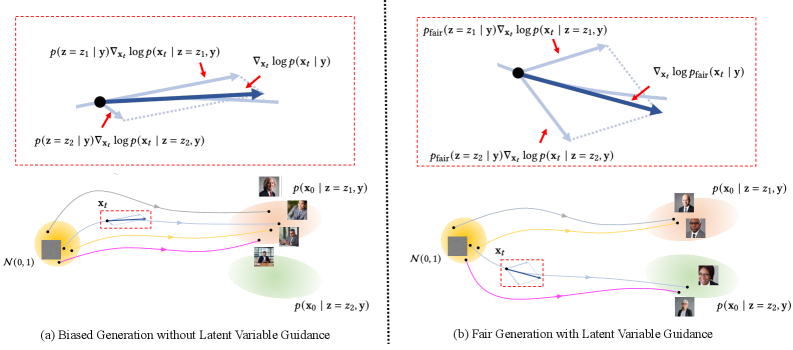

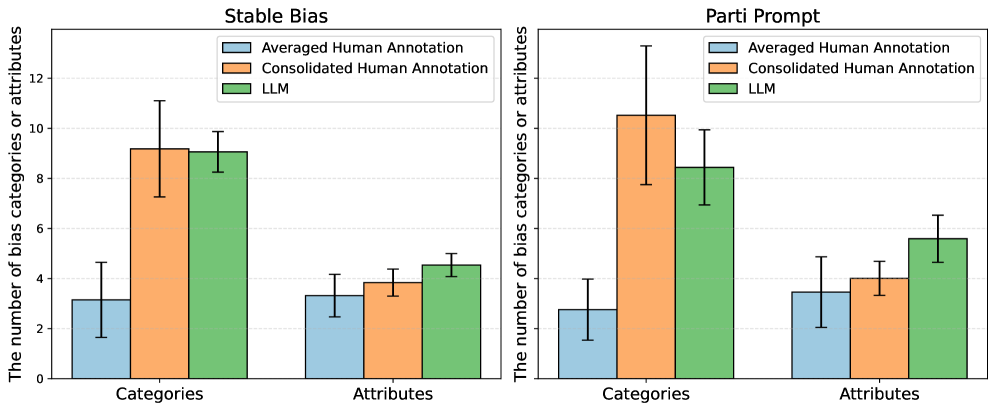

文本到图像(T2I)模型在创意内容生成方面取得了进展,但它们对大型未策划数据集的依赖常常再现社会偏见。我们提出了FairT2I,这是一个无需训练且交互式的框架,它基于数学上合理的潜在变量引导公式。该公式将生成评分函数分解为属性条件组件,并根据定义的分布重新加权,从而为偏差感知生成提供统一且灵活的机制,该机制还将许多现有的临时性去偏方法作为特例包含在内。在此基础上,FairT2I包含(1)作为核心机制的潜在变量引导,(2)基于LLM的偏差检测,以自动从文本提示中推断出易于产生偏差的类别和属性作为潜在结构的一部分,以及(3)属性重采样,允许用户根据均匀、真实世界或用户指定的统计数据来调整或重新定义属性分布。随附的用户界面通过允许用户检查检测到的偏差、修改属性或权重以及实时生成去偏图像来支持此流程。实验结果表明,LLM在检测到的偏差类别和属性的数量和粒度方面优于普通人工标注员。此外,FairT2I在社会偏差缓解和图像多样性方面均优于基线模型,同时保持了图像质量和提示保真度。

🔬 方法详解

问题定义:文本到图像生成模型(T2I)在生成图像时,由于训练数据集中存在的社会偏见,会导致生成结果也带有偏见。例如,当输入“医生”时,模型可能倾向于生成男性图像,而忽略女性。现有方法通常是针对特定偏见进行处理,缺乏通用性和灵活性。

核心思路:FairT2I的核心思路是将生成过程分解为属性条件组件,并根据用户定义的分布对这些组件进行重新加权。通过这种方式,可以控制生成图像中不同属性的比例,从而缓解社会偏见。利用大语言模型(LLM)自动检测文本提示中的偏见类别和属性,并提供用户界面进行交互式调整。

技术框架:FairT2I框架主要包含三个模块:1) 潜在变量引导:将生成评分函数分解为属性条件组件,并进行重加权。2) LLM偏差检测:利用LLM自动识别文本提示中潜在的偏见类别和属性。3) 属性重采样:允许用户根据不同的统计数据(如均匀分布、真实世界分布或用户自定义分布)调整属性的分布。用户可以通过提供的用户界面,检查检测到的偏差,修改属性或权重,并实时生成去偏图像。

关键创新:FairT2I的关键创新在于其统一且灵活的偏差感知生成机制,该机制基于数学上合理的潜在变量引导公式。它将生成评分函数分解为属性条件组件,并根据定义的分布重新加权,从而为偏差感知生成提供了一种通用方法。此外,利用LLM进行偏差检测,提高了检测的自动化程度和准确性。

关键设计:FairT2I使用潜在变量引导作为核心机制,通过调整属性条件组件的权重来控制生成结果。LLM用于自动检测文本提示中的偏见类别和属性,并提供用户界面进行交互式调整。属性重采样允许用户根据不同的统计数据调整属性的分布。具体的参数设置和损失函数等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FairT2I在社会偏差缓解和图像多样性方面均优于基线模型。LLM在检测到的偏差类别和属性的数量和粒度方面优于普通人工标注员。FairT2I在保持图像质量和提示保真度的同时,有效减少了生成图像中的社会偏见。具体的性能数据和提升幅度在论文中未详细说明,属于未知信息。

🎯 应用场景

FairT2I可应用于各种需要生成无偏图像的场景,例如广告设计、教育内容创作、新闻报道等。通过减少社会偏见,该研究有助于提高图像生成模型的公平性和包容性,促进更公正的社会环境。未来,该技术可以扩展到其他生成模型,例如视频生成和3D模型生成。

📄 摘要(原文)

Text-to-image (T2I) models have advanced creative content generation, yet their reliance on large uncurated datasets often reproduces societal biases. We present FairT2I, a training-free and interactive framework grounded in a mathematically principled latent variable guidance formulation. This formulation decomposes the generative score function into attribute-conditioned components and reweights them according to a defined distribution, providing a unified and flexible mechanism for bias-aware generation that also subsumes many existing ad hoc debiasing approaches as special cases. Building upon this foundation, FairT2I incorporates (1) latent variable guidance as the core mechanism, (2) LLM-based bias detection to automatically infer bias-prone categories and attributes from text prompts as part of the latent structure, and (3) attribute resampling, which allows users to adjust or redefine the attribute distribution based on uniform, real-world, or user-specified statistics. The accompanying user interface supports this pipeline by enabling users to inspect detected biases, modify attributes or weights, and generate debiased images in real time. Experimental results show that LLMs outperform average human annotators in the number and granularity of detected bias categories and attributes. Moreover, FairT2I achieves superior performance to baseline models in both societal bias mitigation and image diversity, while preserving image quality and prompt fidelity.