ZISVFM: Zero-Shot Object Instance Segmentation in Indoor Robotic Environments with Vision Foundation Models

作者: Ying Zhang, Maoliang Yin, Wenfu Bi, Haibao Yan, Shaohan Bian, Cui-Hua Zhang, Changchun Hua

分类: cs.CV, cs.RO

发布日期: 2025-02-05

🔗 代码/项目: GITHUB

💡 一句话要点

ZISVFM:利用视觉基础模型实现室内机器人零样本物体实例分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 零样本学习 物体实例分割 视觉基础模型 机器人视觉 自监督学习 Segment Anything Model 视觉Transformer

📋 核心要点

- 传统监督学习的分割技术需要大量标注数据,难以适应真实场景中物体的多样性,零样本物体实例分割旨在解决此问题。

- ZISVFM利用SAM的零样本能力和自监督ViT的视觉表征,通过掩码提议、特征细化和点提示生成实现精确分割。

- 实验结果表明,ZISVFM在复杂室内环境中表现优异,尤其是在处理分层物体时,性能显著提升。

📝 摘要(中文)

本文提出了一种名为ZISVFM的新方法,旨在解决室内机器人环境中零样本物体实例分割(UOIS)问题。该方法利用了Segment Anything Model (SAM)强大的零样本分割能力,以及自监督视觉Transformer (ViT)提供的显式视觉表征。ZISVFM框架包含三个阶段:首先,利用SAM从彩色深度图像中生成与物体无关的掩码提议;其次,使用来自自监督ViT的基于注意力的特征来细化这些提议,过滤掉非物体掩码;最后,应用K-Medoids聚类生成点提示,引导SAM实现精确的物体分割。在两个基准数据集和一个自收集数据集上的实验验证表明,ZISVFM在复杂环境中表现出卓越的性能,包括柜子、抽屉和手持物体等分层场景。

🔬 方法详解

问题定义:论文旨在解决室内机器人环境中零样本物体实例分割(UOIS)问题。现有方法通常依赖于在合成数据上训练模型,然后泛化到真实世界的物体,但这种方法容易受到模拟到现实的差距的影响,导致性能下降。因此,如何在真实场景中有效分割未见过的物体是一个挑战。

核心思路:论文的核心思路是利用视觉基础模型(Vision Foundation Models)的强大泛化能力,特别是Segment Anything Model (SAM)的零样本分割能力和自监督视觉Transformer (ViT)学习到的视觉表征。通过结合这两种模型的优势,可以避免对大量标注数据的依赖,并提高在真实场景中的分割性能。

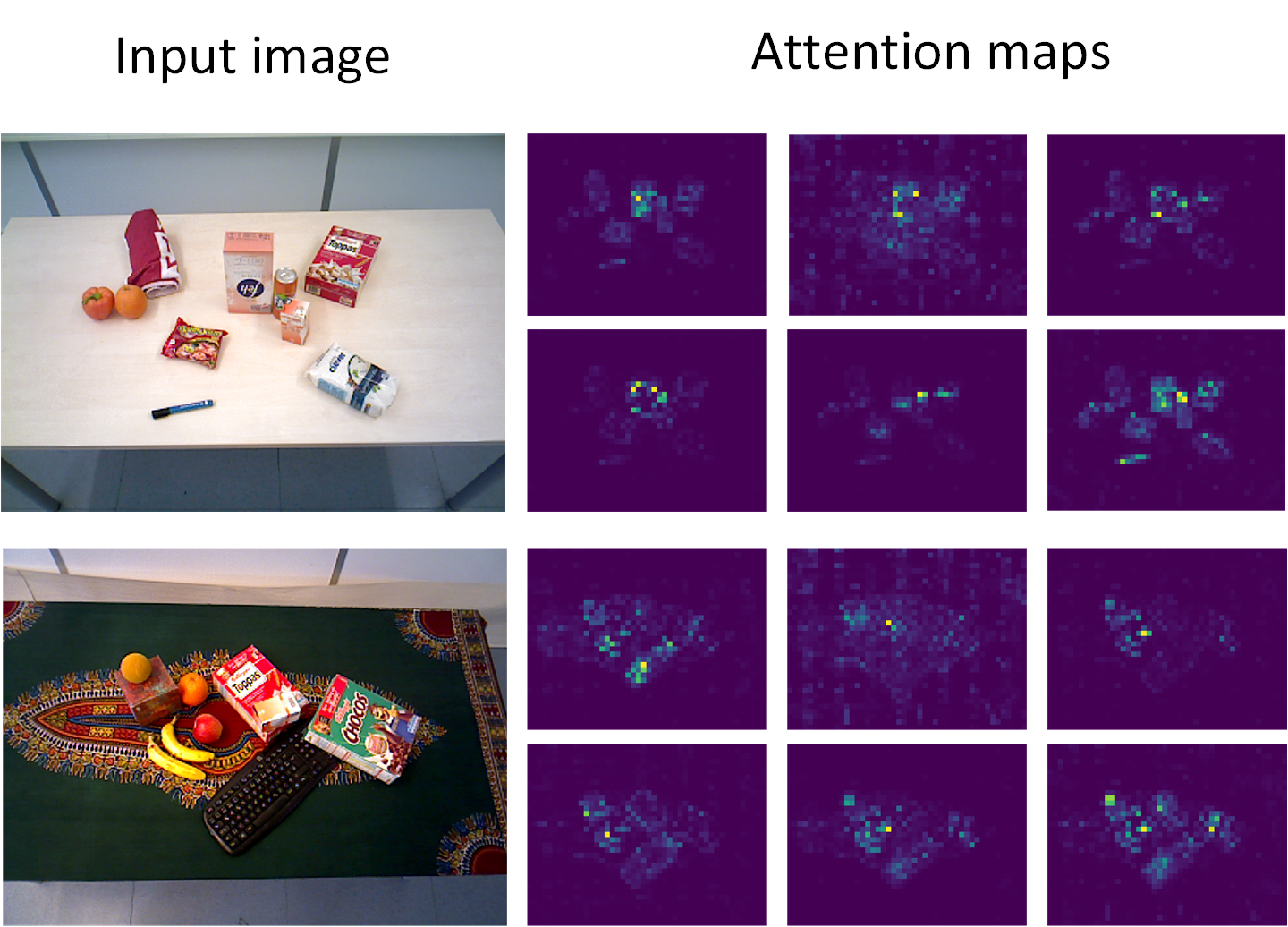

技术框架:ZISVFM框架包含三个主要阶段: 1. 掩码提议生成:使用SAM从彩色深度图像中生成与物体无关的掩码提议。SAM能够基于各种提示(如点、框、掩码)生成高质量的分割掩码。 2. 掩码提议细化:利用自监督ViT提取的视觉特征,通过注意力机制对掩码提议进行过滤和细化,去除不属于物体的掩码。 3. 点提示生成与分割:使用K-Medoids聚类算法在每个掩码提议中生成代表性的点,作为SAM的提示,引导SAM生成更精确的物体分割结果。

关键创新:该方法最重要的创新点在于将SAM的零样本分割能力与自监督ViT的视觉表征相结合,从而实现无需训练即可在真实场景中分割未见物体的能力。与以往依赖合成数据训练的方法相比,ZISVFM能够更好地应对模拟到现实的差距。

关键设计: * 彩色深度图像:使用彩色深度图像作为输入,同时利用了物体的颜色和几何信息。 * 自监督ViT特征:使用在ImageNet上预训练的DINOv2 ViT提取视觉特征,并利用其注意力机制进行掩码提议细化。 * K-Medoids聚类:使用K-Medoids聚类算法生成点提示,该算法对噪声和异常值具有较强的鲁棒性。 * SAM提示工程:通过精心设计的点提示策略,引导SAM生成更准确的分割结果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ZISVFM在两个基准数据集和一个自收集数据集上均取得了优异的性能。与现有方法相比,ZISVFM在分割精度和召回率方面均有显著提升。尤其是在处理包含分层物体的复杂场景时,ZISVFM的性能优势更加明显。具体数据需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于室内服务机器人领域,例如家庭服务、仓储物流、医疗辅助等。机器人可以利用该方法识别和分割未知的物体,从而执行更复杂的任务,如物体抓取、整理和操作。此外,该方法还可以应用于增强现实、虚拟现实等领域,提高用户与虚拟环境的交互体验。

📄 摘要(原文)

Service robots operating in unstructured environments must effectively recognize and segment unknown objects to enhance their functionality. Traditional supervised learningbased segmentation techniques require extensive annotated datasets, which are impractical for the diversity of objects encountered in real-world scenarios. Unseen Object Instance Segmentation (UOIS) methods aim to address this by training models on synthetic data to generalize to novel objects, but they often suffer from the simulation-to-reality gap. This paper proposes a novel approach (ZISVFM) for solving UOIS by leveraging the powerful zero-shot capability of the segment anything model (SAM) and explicit visual representations from a selfsupervised vision transformer (ViT). The proposed framework operates in three stages: (1) generating object-agnostic mask proposals from colorized depth images using SAM, (2) refining these proposals using attention-based features from the selfsupervised ViT to filter non-object masks, and (3) applying K-Medoids clustering to generate point prompts that guide SAM towards precise object segmentation. Experimental validation on two benchmark datasets and a self-collected dataset demonstrates the superior performance of ZISVFM in complex environments, including hierarchical settings such as cabinets, drawers, and handheld objects. Our source code is available at https://github.com/Yinmlmaoliang/zisvfm.