UVGS: Reimagining Unstructured 3D Gaussian Splatting using UV Mapping

作者: Aashish Rai, Dilin Wang, Mihir Jain, Nikolaos Sarafianos, Kefan Chen, Srinath Sridhar, Aayush Prakash

分类: cs.CV

发布日期: 2025-02-03 (更新: 2025-12-01)

备注: https://ivl.cs.brown.edu/uvgs

期刊: CVPR 2025

💡 一句话要点

UVGS:利用UV映射重构非结构化3D高斯溅射,实现高效生成与编辑。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 UV映射 扩散模型 3D生成 球面映射

📋 核心要点

- 3D高斯溅射虽然效果好,但其非结构化特性导致生成和编辑困难,缺乏有效的结构化表示。

- 论文提出UVGS,通过球面映射将3D高斯溅射转换为结构化的2D UV图像,便于利用2D生成模型。

- 实验表明,UVGS能够直接利用现有的2D扩散模型进行3DGS的无条件生成、条件生成和图像修复等任务。

📝 摘要(中文)

3D高斯溅射(3DGS)在建模3D物体和场景方面表现出卓越的质量。然而,由于3DGS的离散、非结构化和置换不变的特性,生成3DGS仍然具有挑战性。本文提出了一种简单而有效的方法来克服这些挑战。我们利用球面映射将3DGS转换为结构化的2D表示,称为UVGS。UVGS可以看作是多通道图像,其特征维度是高斯属性(如位置、尺度、颜色、不透明度和旋转)的串联。我们进一步发现,这些异构特征可以使用精心设计的多分支网络压缩到低维(例如,3通道)共享特征空间。压缩后的UVGS可以被视为典型的RGB图像。值得注意的是,我们发现使用潜在扩散模型训练的典型VAE可以直接推广到这种新的表示,而无需额外的训练。我们的新颖表示使得利用基础2D模型(如扩散模型)直接建模3DGS变得毫不费力。此外,可以简单地增加2D UV分辨率以容纳更多高斯,这使得UVGS成为一种可扩展的解决方案,与典型的3D骨干网络相比。这种方法通过固有地利用已经开发的卓越2D生成能力,立即解锁了3DGS的各种新颖生成应用。在我们的实验中,我们展示了基于扩散模型的3DGS的各种无条件、条件生成和修复应用,这些应用以前是非平凡的。

🔬 方法详解

问题定义:现有的3D高斯溅射方法由于其非结构化和离散的特性,在生成和编辑方面面临挑战。直接操作3D高斯参数非常困难,难以利用现有的2D图像生成模型的能力。因此,需要一种结构化的表示方法,能够将3D高斯溅射转换为易于处理的形式。

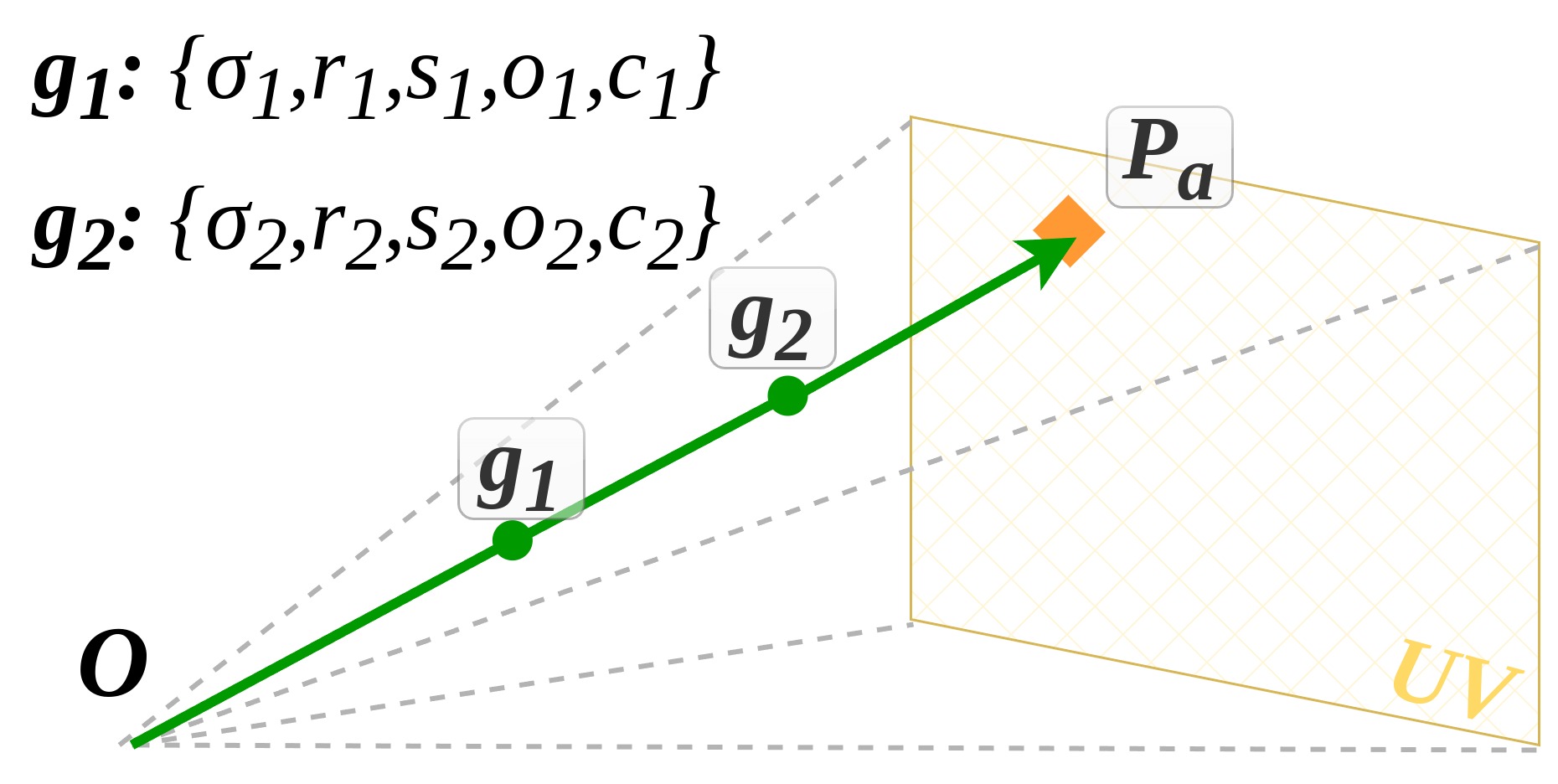

核心思路:论文的核心思路是将3D高斯溅射通过球面映射转换为2D的UV图像表示,即UVGS。这种转换将非结构化的3D数据映射到结构化的2D空间,使得可以利用现有的2D图像处理和生成技术。通过将高斯参数(位置、尺度、颜色等)作为UV图像的通道,保留了3D信息。

技术框架:UVGS的整体框架包括以下几个主要步骤:1) 将3D高斯溅射进行球面映射,得到UV坐标。2) 将每个高斯点的属性(位置、尺度、颜色、不透明度、旋转等)映射到对应的UV坐标上,形成多通道的UV图像。3) 使用多分支网络将这些异构特征压缩到低维的共享特征空间(例如,3通道RGB)。4) 利用现有的2D扩散模型在UVGS表示上进行生成、编辑等操作。5) 将生成的UVGS表示转换回3D高斯溅射。

关键创新:最重要的技术创新点在于将非结构化的3D高斯溅射转换为结构化的2D UV图像表示。这种转换使得可以直接利用现有的2D图像生成模型,例如扩散模型,来生成和编辑3D高斯溅射。与直接在3D空间中操作高斯参数相比,UVGS提供了一种更加高效和灵活的方法。

关键设计:关键的设计包括:1) 使用球面映射进行3D到2D的转换。2) 使用多分支网络将异构的高斯属性压缩到低维的共享特征空间。3) 利用现有的2D扩散模型进行生成和编辑。此外,可以通过增加UV图像的分辨率来容纳更多的高斯点,从而提高模型的表达能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,UVGS能够有效地利用现有的2D扩散模型进行3D高斯溅射的生成和编辑。通过在UVGS表示上进行无条件生成、条件生成和图像修复等任务,展示了该方法的有效性和灵活性。该方法无需额外的3D训练,可以直接利用预训练的2D扩散模型,大大降低了训练成本。

🎯 应用场景

该研究成果可广泛应用于3D内容生成、虚拟现实、增强现实、游戏开发等领域。通过利用现有的2D生成模型,可以快速生成高质量的3D场景和物体。此外,UVGS表示也为3D内容的编辑和修复提供了新的途径,例如可以利用2D图像修复技术来修复3D模型的缺陷。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has demonstrated superior quality in modeling 3D objects and scenes. However, generating 3DGS remains challenging due to their discrete, unstructured, and permutation-invariant nature. In this work, we present a simple yet effective method to overcome these challenges. We utilize spherical mapping to transform 3DGS into a structured 2D representation, termed UVGS. UVGS can be viewed as multi-channel images, with feature dimensions as a concatenation of Gaussian attributes such as position, scale, color, opacity, and rotation. We further find that these heterogeneous features can be compressed into a lower-dimensional (e.g., 3-channel) shared feature space using a carefully designed multi-branch network. The compressed UVGS can be treated as typical RGB images. Remarkably, we discover that typical VAEs trained with latent diffusion models can directly generalize to this new representation without additional training. Our novel representation makes it effortless to leverage foundational 2D models, such as diffusion models, to directly model 3DGS. Additionally, one can simply increase the 2D UV resolution to accommodate more Gaussians, making UVGS a scalable solution compared to typical 3D backbones. This approach immediately unlocks various novel generation applications of 3DGS by inherently utilizing the already developed superior 2D generation capabilities. In our experiments, we demonstrate various unconditional, conditional generation, and inpainting applications of 3DGS based on diffusion models, which were previously non-trivial.