JGHand: Joint-Driven Animatable Hand Avater via 3D Gaussian Splatting

作者: Zhoutao Sun, Xukun Shen, Yong Hu, Yuyou Zhong, Xueyang Zhou

分类: cs.CV

发布日期: 2025-01-31

💡 一句话要点

提出JGHand,一种基于3D高斯溅射的关节驱动可动画手部Avatar,实现高质量实时渲染。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 手部建模 可动画Avatar 关节驱动 实时渲染 神经渲染 空间变换

📋 核心要点

- 现有铰接神经渲染技术难以兼顾手部模型的高质量渲染、实时性和可驱动性,尤其是在复杂姿态下。

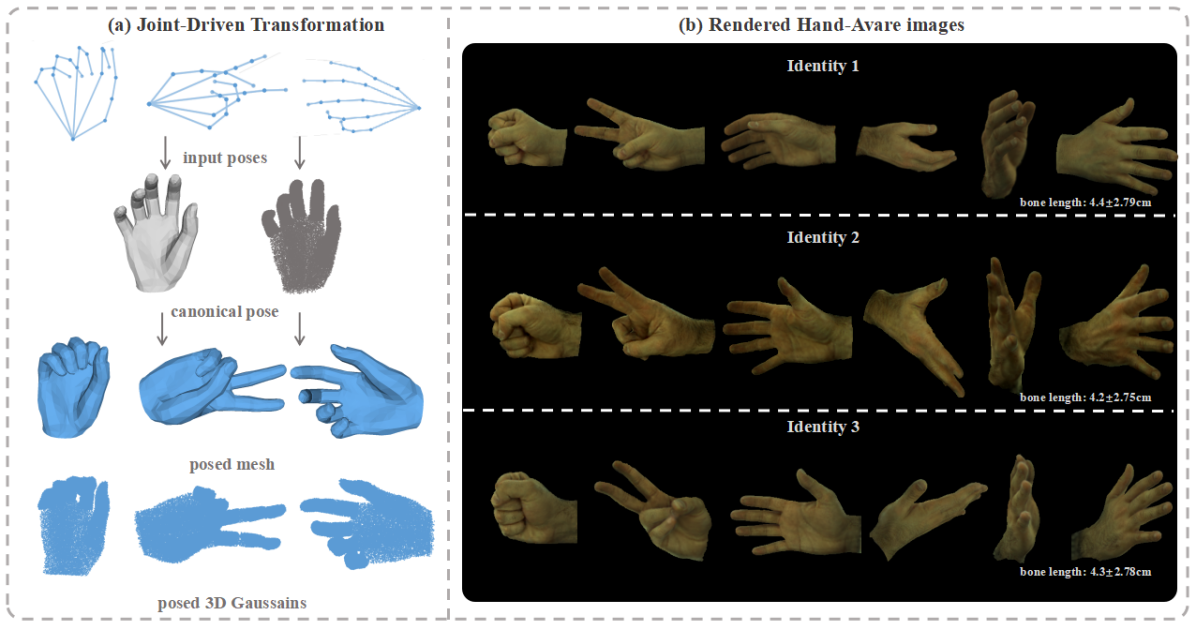

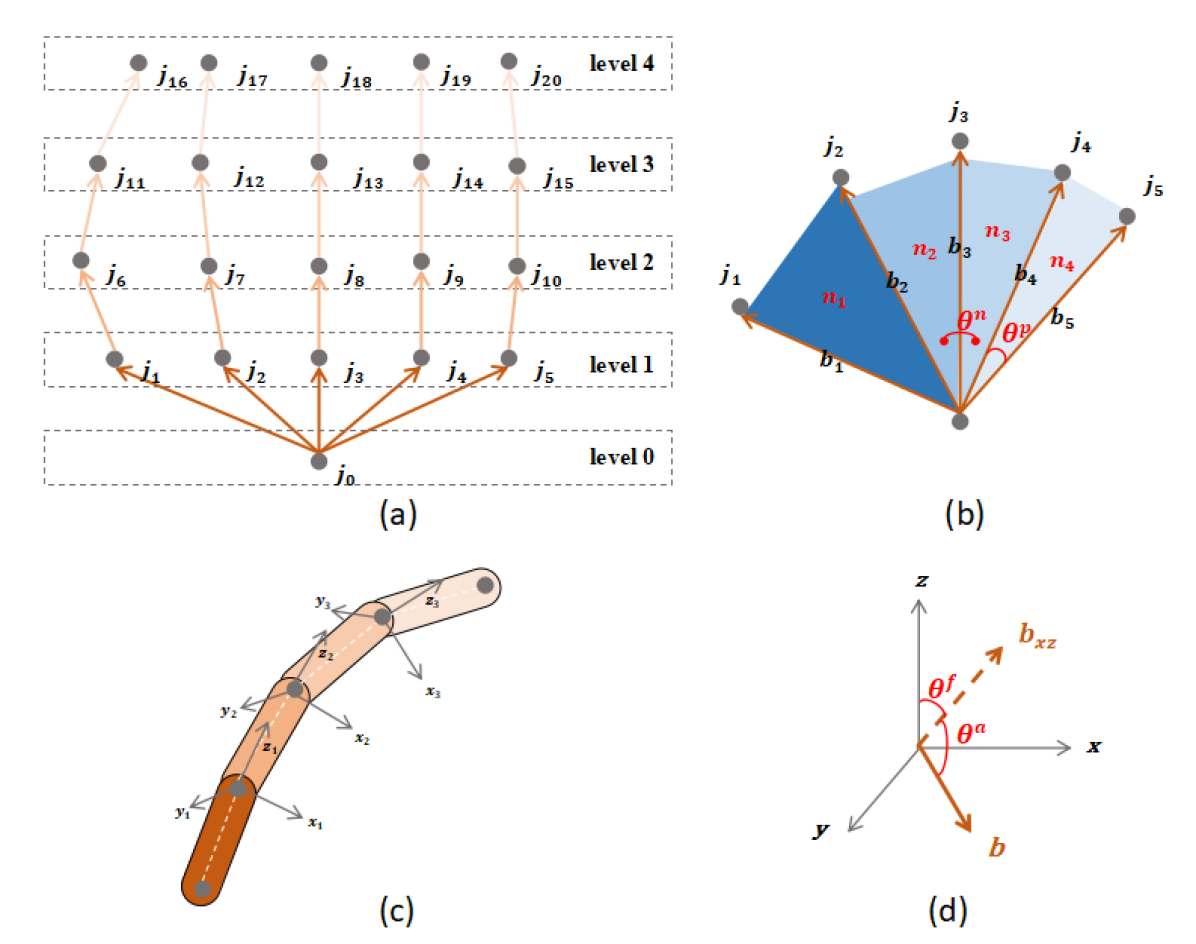

- JGHand通过引入基于3D关键点的可微空间变换过程,实现了从规范模板到任意骨骼长度和姿势网格的变形。

- 该方法还提出了一种基于逐像素深度的实时阴影模拟方法,并嵌入手部先验,实验结果表明其优于现有方法。

📝 摘要(中文)

本文提出了一种名为Jointly 3D Gaussian Hand (JGHand) 的新型关节驱动的3D高斯溅射(3DGS)手部表示方法,旨在为各种姿势和角色实时渲染高保真手部图像。与现有的铰接神经渲染技术不同,我们引入了一种基于3D关键点的空间变换可微过程,该过程支持从规范模板到具有任意骨骼长度和姿势的网格的变形。此外,我们提出了一种基于逐像素深度的实时阴影模拟方法,以模拟手指运动引起的自遮挡阴影。最后,我们嵌入了手部先验,并提出了一个仅由3D关键点驱动的可动画3DGS手部表示。通过全面的消融研究验证了我们方法中每个组件的有效性。在公共数据集上的实验结果表明,JGHand实现了实时渲染速度和增强的质量,超越了最先进的方法。

🔬 方法详解

问题定义:现有方法在手部建模中,难以同时保证渲染质量、实时性和可驱动性。尤其是在处理复杂的手部姿势和不同角色时,现有铰接神经渲染技术通常需要在渲染质量或速度上做出妥协。此外,模拟手指运动产生的自遮挡阴影也是一个挑战。

核心思路:JGHand的核心思路是利用3D高斯溅射(3DGS)作为手部表示的基础,并结合关节驱动的方式实现可动画。通过引入基于3D关键点的可微空间变换,将规范模板变形到目标姿势,从而实现对任意骨骼长度和姿势的建模。同时,利用逐像素深度信息进行实时阴影模拟,增强渲染真实感。

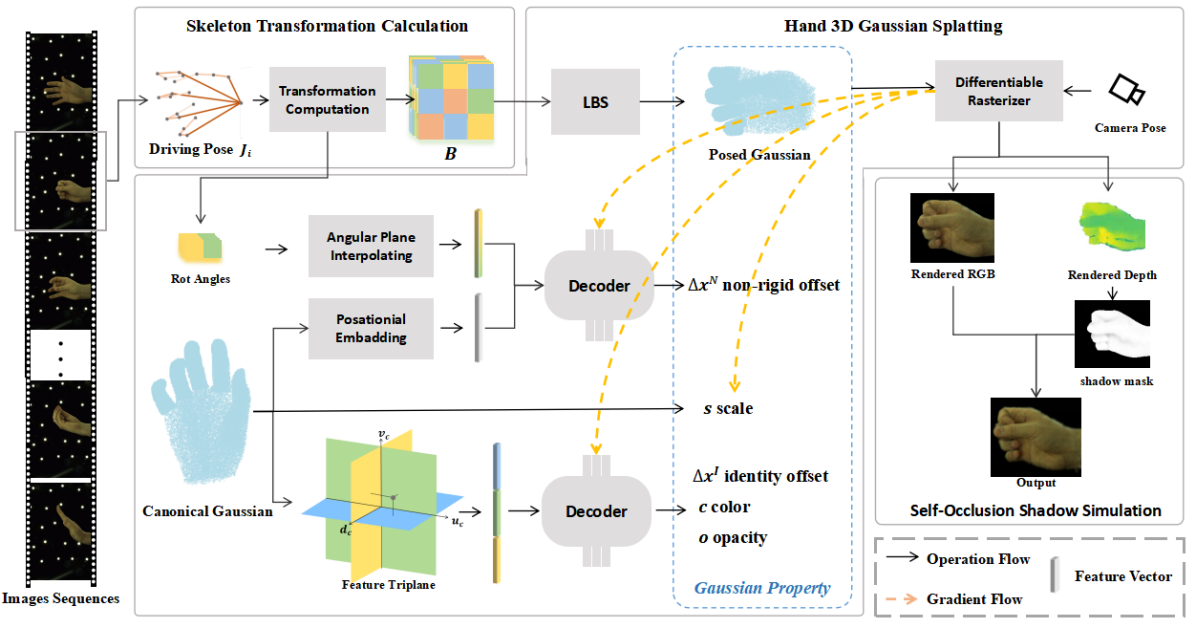

技术框架:JGHand的整体框架包括以下几个主要模块:1) 基于3D关键点的空间变换模块:负责将规范模板根据关节信息变形到目标姿势。2) 3D高斯溅射渲染模块:利用3DGS技术将变形后的手部模型渲染成图像。3) 实时阴影模拟模块:基于逐像素深度信息模拟手指运动产生的自遮挡阴影。4) 手部先验嵌入模块:利用手部先验知识约束模型的学习过程,提高渲染质量。

关键创新:JGHand的关键创新在于:1) 提出了基于3D关键点的可微空间变换过程,实现了对任意骨骼长度和姿势的建模,避免了传统方法中对固定骨骼长度的限制。2) 提出了一种基于逐像素深度的实时阴影模拟方法,能够有效地模拟手指运动产生的自遮挡阴影,增强了渲染的真实感。3) 将3DGS技术应用于可动画手部建模,实现了高质量的实时渲染。

关键设计:在空间变换模块中,使用了可微的蒙皮算法,保证了梯度能够有效地传递到3D关键点。在阴影模拟模块中,利用深度缓冲计算每个像素的遮挡关系,并根据遮挡关系调整像素的颜色。在3DGS渲染模块中,使用了球谐函数来表示高斯分布的颜色信息,并使用alpha blending进行渲染。

🖼️ 关键图片

📊 实验亮点

实验结果表明,JGHand在公共数据集上实现了优于现有方法的渲染质量和实时性。具体来说,JGHand在渲染质量指标(如PSNR和SSIM)上显著优于现有方法,同时保持了较高的渲染帧率,能够满足实时应用的需求。消融实验验证了各个模块的有效性,证明了基于3D关键点的空间变换和实时阴影模拟对提升渲染质量的重要性。

🎯 应用场景

JGHand在虚拟现实、增强现实、人机交互、游戏开发等领域具有广泛的应用前景。它可以用于创建逼真的虚拟手部模型,增强用户的沉浸感和交互体验。此外,JGHand还可以用于手势识别、动作捕捉等任务,为这些任务提供高质量的输入数据。未来,该技术有望应用于远程协作、虚拟手术等领域。

📄 摘要(原文)

Since hands are the primary interface in daily interactions, modeling high-quality digital human hands and rendering realistic images is a critical research problem. Furthermore, considering the requirements of interactive and rendering applications, it is essential to achieve real-time rendering and driveability of the digital model without compromising rendering quality. Thus, we propose Jointly 3D Gaussian Hand (JGHand), a novel joint-driven 3D Gaussian Splatting (3DGS)-based hand representation that renders high-fidelity hand images in real-time for various poses and characters. Distinct from existing articulated neural rendering techniques, we introduce a differentiable process for spatial transformations based on 3D key points. This process supports deformations from the canonical template to a mesh with arbitrary bone lengths and poses. Additionally, we propose a real-time shadow simulation method based on per-pixel depth to simulate self-occlusion shadows caused by finger movements. Finally, we embed the hand prior and propose an animatable 3DGS representation of the hand driven solely by 3D key points. We validate the effectiveness of each component of our approach through comprehensive ablation studies. Experimental results on public datasets demonstrate that JGHand achieves real-time rendering speeds with enhanced quality, surpassing state-of-the-art methods.