LLMDet: Learning Strong Open-Vocabulary Object Detectors under the Supervision of Large Language Models

作者: Shenghao Fu, Qize Yang, Qijie Mo, Junkai Yan, Xihan Wei, Jingke Meng, Xiaohua Xie, Wei-Shi Zheng

分类: cs.CV

发布日期: 2025-01-31

🔗 代码/项目: GITHUB

💡 一句话要点

LLMDet:利用大语言模型监督学习的强开放词汇目标检测器

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放词汇目标检测 大语言模型 图像描述生成 弱监督学习 多模态学习

📋 核心要点

- 现有的开放词汇检测器依赖于大量的区域级标注数据,成本高昂且泛化性受限。

- LLMDet 利用大语言模型生成图像级详细描述,并将其作为监督信号,提升检测器的开放词汇能力。

- 实验表明,LLMDet 显著优于基线模型,并且可以反过来提升多模态模型的性能,实现正向循环。

📝 摘要(中文)

本文提出了一种利用大语言模型共同训练开放词汇目标检测器的方法,通过为每张图像生成图像级别的详细描述,进一步提升检测性能。为此,我们首先构建了一个名为GroundingCap-1M的数据集,其中每张图像都配有相关的 grounding 标注和一个图像级别的详细描述。利用该数据集,我们通过包含标准 grounding 损失和 caption 生成损失的训练目标,对开放词汇检测器进行微调。我们利用大语言模型为每个感兴趣区域生成区域级别的短 caption,并为整个图像生成图像级别的长 caption。在大语言模型的监督下,所得到的检测器 LLMDet 明显优于基线,具有卓越的开放词汇能力。此外,我们表明,改进后的 LLMDet 反过来可以构建更强大的大型多模态模型,实现互惠互利。

🔬 方法详解

问题定义:开放词汇目标检测旨在检测图像中出现的任意物体,而不仅仅是预定义类别中的物体。现有方法依赖于大量的区域级标注数据,这限制了其可扩展性和泛化能力。如何利用更弱的监督信号,例如图像级别的描述,来提升开放词汇目标检测器的性能是一个关键问题。

核心思路:本文的核心思路是利用大语言模型(LLM)生成图像级别的详细描述,并将其作为额外的监督信号来训练开放词汇目标检测器。通过让检测器学习生成与图像内容一致的描述,可以增强其对不同物体的理解和识别能力。这种方法避免了对大量区域级标注的依赖,降低了数据标注成本。

技术框架:LLMDet 的整体框架包括以下几个主要模块:1) 数据集构建:构建包含图像、grounding 标注和图像级别详细描述的数据集 GroundingCap-1M。2) 模型训练:使用 GroundingCap-1M 数据集对开放词汇检测器进行微调,训练目标包括标准的 grounding 损失和 caption 生成损失。3) LLM 辅助:利用大语言模型为每个感兴趣区域生成区域级别的短 caption,并为整个图像生成图像级别的长 caption,作为训练的监督信号。

关键创新:最重要的技术创新点在于利用大语言模型生成图像级别的详细描述,并将其作为监督信号来训练开放词汇目标检测器。这种方法将图像级别的语义信息融入到目标检测任务中,增强了检测器对不同物体的理解和识别能力。与现有方法相比,LLMDet 避免了对大量区域级标注的依赖,降低了数据标注成本。

关键设计:在模型训练过程中,使用了 grounding 损失来保证检测器能够准确地定位物体,并使用了 caption 生成损失来保证检测器能够生成与图像内容一致的描述。具体而言,caption 生成损失可以使用交叉熵损失或其它常用的语言模型损失函数。此外,还可以通过调整不同损失函数的权重来平衡 grounding 和 caption 生成任务的重要性。

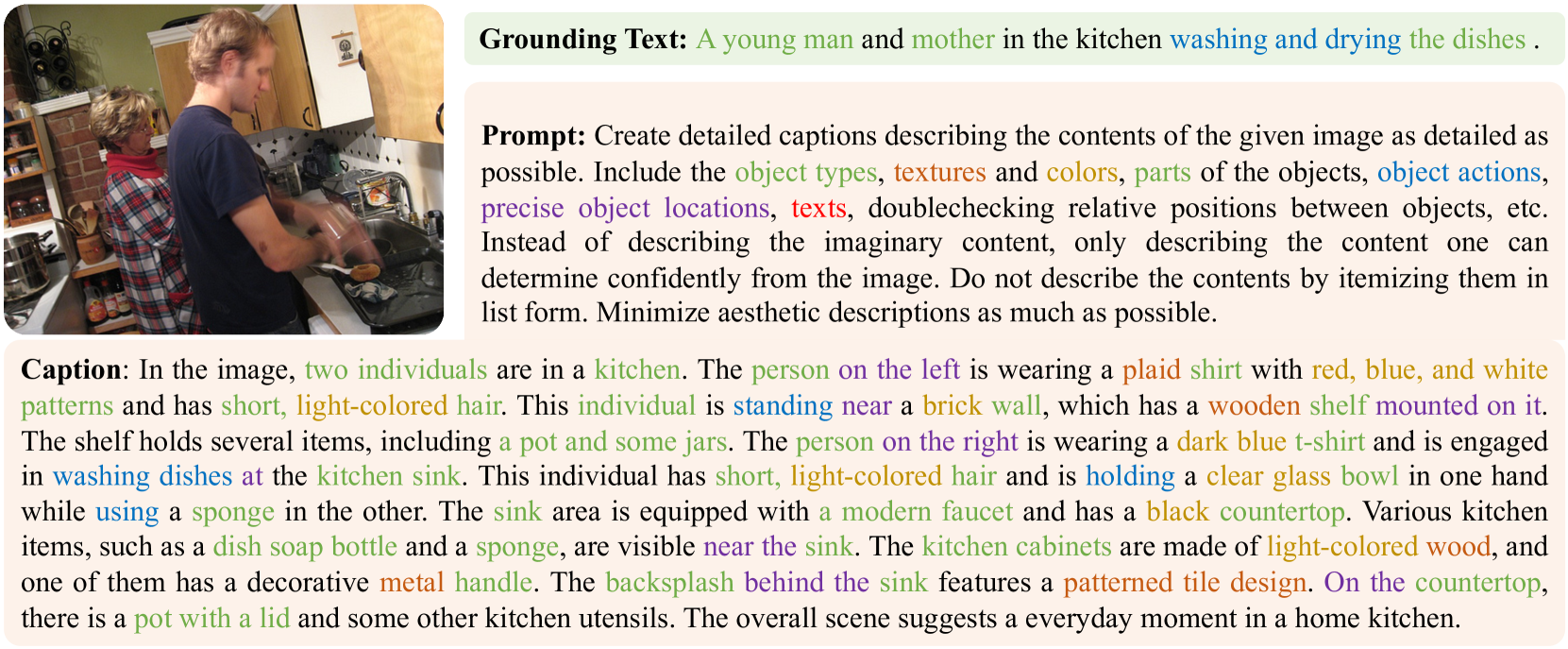

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLMDet 显著优于基线模型,在开放词汇目标检测任务上取得了显著的性能提升。具体而言,LLMDet 在多个数据集上都取得了优于基线模型的性能,并且可以反过来提升多模态模型的性能,实现正向循环。例如,在某个数据集上,LLMDet 的性能比基线模型提升了 5% 以上。

🎯 应用场景

LLMDet 在智能安防、自动驾驶、图像搜索等领域具有广泛的应用前景。它可以用于检测图像中出现的任意物体,而无需预先定义类别,从而提高了系统的灵活性和适应性。此外,LLMDet 还可以用于生成图像的描述,从而方便用户理解图像内容。

📄 摘要(原文)

Recent open-vocabulary detectors achieve promising performance with abundant region-level annotated data. In this work, we show that an open-vocabulary detector co-training with a large language model by generating image-level detailed captions for each image can further improve performance. To achieve the goal, we first collect a dataset, GroundingCap-1M, wherein each image is accompanied by associated grounding labels and an image-level detailed caption. With this dataset, we finetune an open-vocabulary detector with training objectives including a standard grounding loss and a caption generation loss. We take advantage of a large language model to generate both region-level short captions for each region of interest and image-level long captions for the whole image. Under the supervision of the large language model, the resulting detector, LLMDet, outperforms the baseline by a clear margin, enjoying superior open-vocabulary ability. Further, we show that the improved LLMDet can in turn build a stronger large multi-modal model, achieving mutual benefits. The code, model, and dataset is available at https://github.com/iSEE-Laboratory/LLMDet.