VoD-3DGS: View-opacity-Dependent 3D Gaussian Splatting

作者: Mateusz Nowak, Wojciech Jarosz, Peter Chin

分类: cs.CV, cs.GR, cs.LG

发布日期: 2025-01-29 (更新: 2025-01-31)

💡 一句话要点

提出视角-不透明度相关的3D高斯溅射,用于增强视角依赖渲染效果

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 视角依赖渲染 神经渲染 反射建模 高光渲染

📋 核心要点

- 传统3D高斯溅射难以区分场景物体与镜面反射,导致视角依赖渲染效果不佳。

- 通过引入视角依赖的透明度,增强3D高斯溅射模型,从而抑制不必要的高斯。

- 实验表明,该方法在多个数据集上实现了SOTA性能,渲染速度快,内存占用增加少。

📝 摘要(中文)

从图像重建3D场景极具挑战,因为光线与表面交互的方式取决于观察者位置和表面材质。传统计算机图形学中,材质可分为漫反射或镜面反射,它们与光线的交互方式不同。标准3D高斯溅射模型难以表示视角依赖的内容,因为它无法区分场景中的物体与镜面反射表面上的光线交互(如高光或反射)。本文提出通过引入额外的对称矩阵来增强每个3D高斯的透明度表示,从而扩展3D高斯溅射模型。这种改进允许基于观察者视角抑制某些高斯,从而更准确地表示视角相关的反射和镜面高光,同时不影响场景完整性。通过允许透明度具有视角依赖性,我们增强的模型在Mip-Nerf、Tanks&Temples、Deep Blending和Nerf-Synthetic数据集上实现了最先进的性能,且渲染速度无明显下降(>60FPS),仅略微增加了内存使用。

🔬 方法详解

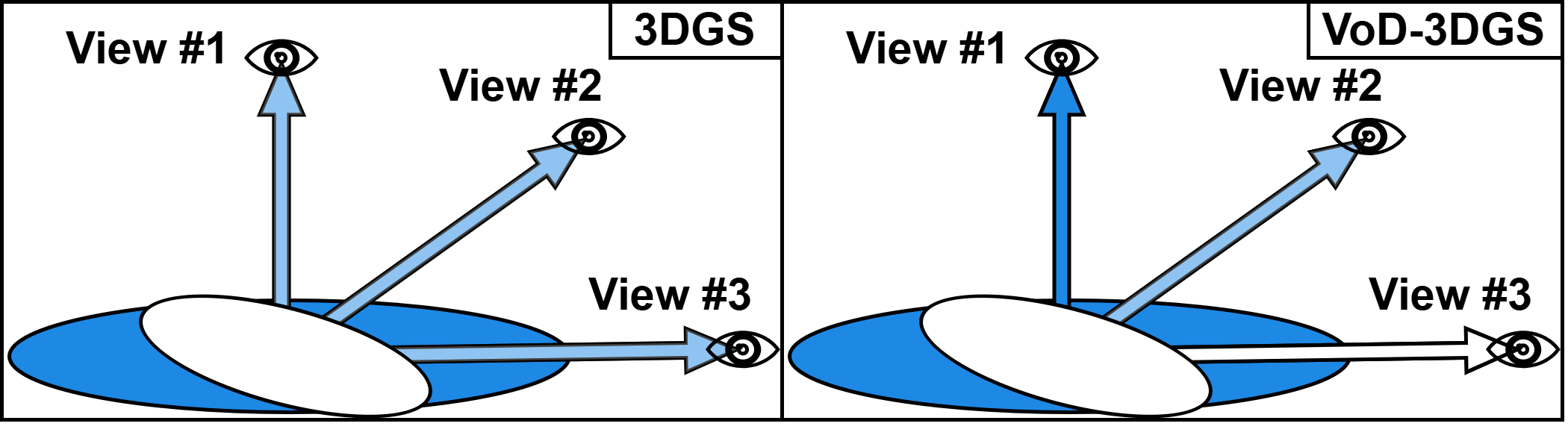

问题定义:现有3D高斯溅射方法难以有效建模视角依赖的渲染效果,尤其是在处理具有镜面反射或高光的场景时。这是因为标准3D高斯溅射无法区分物体本身的颜色和由于光照产生的反射效果,导致重建的3D场景在不同视角下出现不真实的渲染结果。现有方法无法很好地分离静态场景几何和动态视角依赖的光照效果。

核心思路:论文的核心思路是使3D高斯的透明度具有视角依赖性。通过引入一个额外的对称矩阵,每个高斯的透明度不再是一个标量,而是一个与视角相关的函数。这样,模型可以根据观察者的视角来抑制某些高斯,从而更好地表示镜面反射和高光等视角依赖的效果。这种设计允许模型区分静态的场景几何和动态的光照效果。

技术框架:该方法基于标准的3D高斯溅射框架,主要改进在于透明度表示部分。具体流程如下:1) 初始化3D高斯参数;2) 对于每个视角,计算视角相关的透明度;3) 使用视角相关的透明度进行渲染;4) 通过优化3D高斯参数(包括新引入的对称矩阵)来最小化渲染误差。整体架构与标准3D高斯溅射类似,但关键在于视角相关透明度的计算。

关键创新:最重要的技术创新点是引入了视角依赖的透明度表示。与现有方法相比,该方法能够更有效地分离静态场景几何和动态视角依赖的光照效果,从而更准确地表示镜面反射和高光等效果。本质区别在于,标准3D高斯溅射的透明度是静态的,而该方法的透明度是动态的,取决于观察者的视角。

关键设计:关键设计在于如何计算视角相关的透明度。论文引入了一个对称矩阵,该矩阵与视角向量进行运算,得到一个标量值,该值用于调整高斯的透明度。具体的数学公式在论文中有详细描述。此外,损失函数也需要进行相应的调整,以鼓励模型学习到正确的视角依赖的透明度。具体的参数设置和损失函数细节需要在论文中查找。

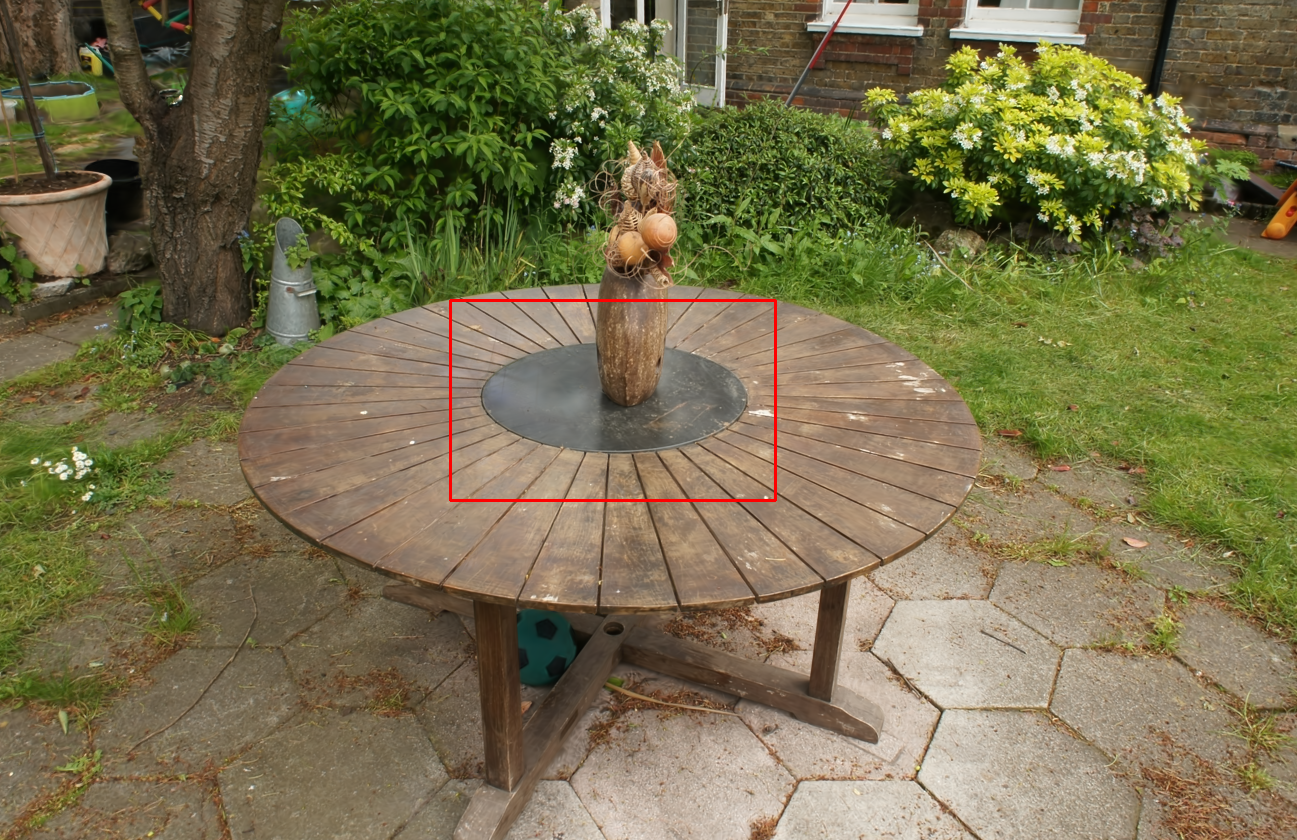

🖼️ 关键图片

📊 实验亮点

该方法在Mip-Nerf、Tanks&Temples、Deep Blending和Nerf-Synthetic数据集上实现了state-of-the-art的性能。在保证渲染速度高于60FPS的同时,仅引入了极小的内存开销。实验结果表明,该方法能够有效地表示视角依赖的反射和高光,显著提升了渲染质量。

🎯 应用场景

该研究成果可应用于增强现实、虚拟现实、游戏开发等领域,尤其是在需要高质量、真实感渲染的场景中。例如,可以用于创建更逼真的虚拟环境,或是在增强现实应用中更准确地叠加虚拟物体到真实场景中。该方法在电商展示、电影特效等领域也具有潜在应用价值。

📄 摘要(原文)

Reconstructing a 3D scene from images is challenging due to the different ways light interacts with surfaces depending on the viewer's position and the surface's material. In classical computer graphics, materials can be classified as diffuse or specular, interacting with light differently. The standard 3D Gaussian Splatting model struggles to represent view-dependent content, since it cannot differentiate an object within the scene from the light interacting with its specular surfaces, which produce highlights or reflections. In this paper, we propose to extend the 3D Gaussian Splatting model by introducing an additional symmetric matrix to enhance the opacity representation of each 3D Gaussian. This improvement allows certain Gaussians to be suppressed based on the viewer's perspective, resulting in a more accurate representation of view-dependent reflections and specular highlights without compromising the scene's integrity. By allowing the opacity to be view dependent, our enhanced model achieves state-of-the-art performance on Mip-Nerf, Tanks&Temples, Deep Blending, and Nerf-Synthetic datasets without a significant loss in rendering speed, achieving >60FPS, and only incurring a minimal increase in memory used.