VLMaterial: Procedural Material Generation with Large Vision-Language Models

作者: Beichen Li, Rundi Wu, Armando Solar-Lezama, Changxi Zheng, Liang Shi, Bernd Bickel, Wojciech Matusik

分类: cs.CV, cs.GR

发布日期: 2025-01-27 (更新: 2025-02-18)

备注: ICLR 2025 Spotlight

💡 一句话要点

VLMaterial:利用视觉-语言大模型生成程序化材质

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 程序化材质生成 视觉-语言模型 代码生成 材质外观设计 深度学习

📋 核心要点

- 创建程序化材质需要专业知识和大量人工,现有方法难以高效地从图像生成程序化材质。

- 本文提出利用视觉-语言大模型,将图像转换为Python程序形式的程序化材质描述。

- 通过程序级数据增强和开源数据集,显著提升了模型在合成和真实数据上的生成效果。

📝 摘要(中文)

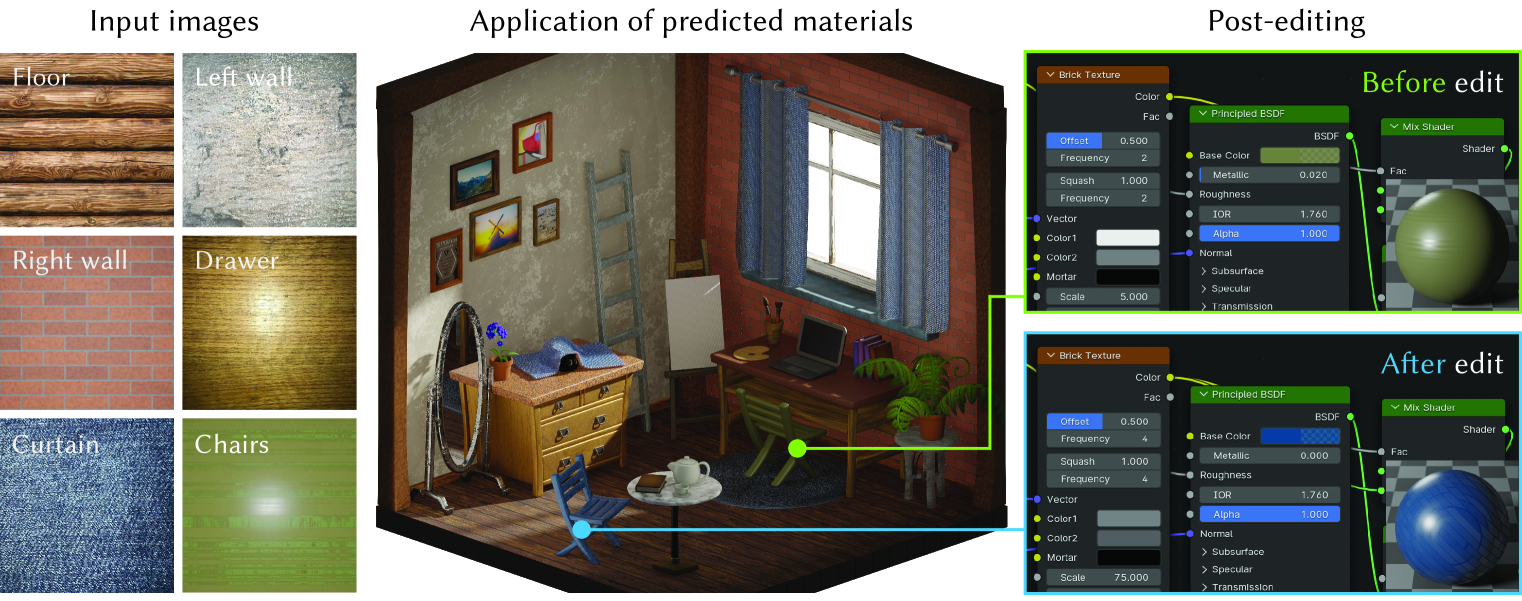

程序化材质以功能节点图的形式存在,在计算机图形学中被广泛用于设计照片级真实感的材质外观。它们允许用户进行直观和精确的编辑,以实现期望的视觉效果。然而,给定输入图像创建程序化材质需要专业的知识和大量的努力。本文利用将程序化材质转换为标准Python程序的能力,并微调一个大型预训练视觉-语言模型(VLM)来从输入图像生成此类程序。为了实现有效的微调,我们还贡献了一个开源程序化材质数据集,并提出通过提示另一个预训练的大型语言模型(LLM)来执行程序级别的增强。通过广泛的评估,我们表明我们的方法在合成和真实世界的例子中都优于以前的方法。

🔬 方法详解

问题定义:论文旨在解决从图像自动生成程序化材质的问题。现有方法通常需要手工设计或依赖有限的数据集,难以泛化到复杂的材质和真实场景。此外,程序化材质的创建需要专业知识,普通用户难以掌握。

核心思路:论文的核心思路是将程序化材质表示为Python程序,利用视觉-语言大模型(VLM)学习图像和程序之间的映射关系。通过将材质生成问题转化为代码生成问题,可以利用VLM强大的生成能力和代码的灵活性。

技术框架:整体框架包括以下几个阶段:1) 数据集构建:构建包含图像和对应程序化材质(Python代码)的数据集。2) 模型微调:使用预训练的VLM,如CodeGen,在构建的数据集上进行微调,使其能够根据输入图像生成对应的Python程序。3) 程序增强:利用大型语言模型(LLM)对生成的Python程序进行增强,例如修改变量名、调整代码结构等,以提高程序的多样性和鲁棒性。4) 材质渲染:将生成的Python程序转化为程序化材质,并进行渲染,得到最终的材质效果。

关键创新:论文的关键创新在于:1) 将程序化材质生成问题转化为代码生成问题,利用VLM的强大能力。2) 提出程序级别的增强方法,提高模型的泛化能力。3) 构建了一个开源的程序化材质数据集,促进了该领域的研究。

关键设计:在模型微调方面,使用了CodeGen模型,并采用了标准的Transformer架构。损失函数采用交叉熵损失,优化器使用AdamW。程序增强方面,使用了GPT-3等LLM,通过prompt engineering来生成不同的程序变体。数据集包含大量的合成数据和少量真实数据,并进行了数据清洗和预处理。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成和真实数据集上均优于现有方法。在材质相似度指标上,相比于之前的最佳方法,取得了显著的提升。通过程序级增强,模型的泛化能力得到了进一步提高,能够生成更加多样和鲁棒的程序化材质。

🎯 应用场景

该研究成果可应用于游戏开发、电影制作、工业设计等领域,帮助设计师快速生成各种逼真的材质,提高工作效率和创作质量。未来,该技术还可以扩展到其他类型的程序化内容生成,例如程序化建模、程序化动画等。

📄 摘要(原文)

Procedural materials, represented as functional node graphs, are ubiquitous in computer graphics for photorealistic material appearance design. They allow users to perform intuitive and precise editing to achieve desired visual appearances. However, creating a procedural material given an input image requires professional knowledge and significant effort. In this work, we leverage the ability to convert procedural materials into standard Python programs and fine-tune a large pre-trained vision-language model (VLM) to generate such programs from input images. To enable effective fine-tuning, we also contribute an open-source procedural material dataset and propose to perform program-level augmentation by prompting another pre-trained large language model (LLM). Through extensive evaluation, we show that our method outperforms previous methods on both synthetic and real-world examples.