Temporal Preference Optimization for Long-Form Video Understanding

作者: Rui Li, Xiaohan Wang, Yuhui Zhang, Orr Zohar, Zeyu Wang, Serena Yeung-Levy

分类: cs.CV, cs.AI, cs.CL, cs.LG, cs.RO

发布日期: 2025-01-23 (更新: 2025-09-01)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出时间偏好优化(TPO)框架,提升视频大模型在长视频中的时间定位能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长视频理解 时间定位 偏好学习 视频大模型 自训练

📋 核心要点

- 现有视频大模型在长视频中的时间定位能力不足,难以有效理解视频内容。

- 提出时间偏好优化(TPO)框架,通过偏好学习使模型区分准确和不准确的时间响应。

- 实验表明,TPO显著提升了模型在多个长视频理解基准上的性能,且减少了对人工标注的依赖。

📝 摘要(中文)

本文提出了一种名为时间偏好优化(TPO)的后训练框架,旨在提升视频大模型(video-LMMs)在长视频中的时间定位能力。TPO采用自训练方法,通过利用精心设计的偏好数据集,使模型能够区分良好定位和不太准确的时间响应。这些偏好数据集涵盖两种粒度:关注特定视频片段的局部时间定位,以及捕捉整个视频序列中扩展时间依赖性的综合时间定位。通过在这些偏好数据集上进行优化,TPO显著增强了时间理解能力,同时减少了对人工标注数据的依赖。在LongVideoBench、MLVU和Video-MME三个长视频理解基准上的大量实验表明,TPO在两个最先进的视频-LMM上均有效。值得注意的是,LLaVA-Video-TPO成为了Video-MME基准上领先的7B模型,突显了TPO作为一种可扩展且高效的解决方案在推进长视频理解中的时间推理方面的潜力。

🔬 方法详解

问题定义:现有视频大模型在处理长视频时,难以准确地进行时间定位,即无法精确地确定用户query所指代的视频片段。这限制了模型对长视频内容的深入理解和应用。现有方法通常依赖大量人工标注数据,成本高昂且难以扩展。

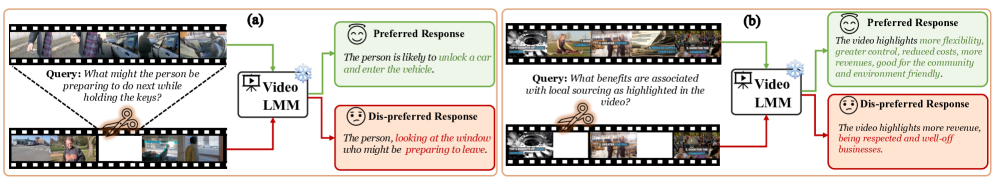

核心思路:TPO的核心思路是通过偏好学习,让模型学习区分“好”的时间定位结果和“坏”的时间定位结果。具体来说,就是构建偏好数据集,包含针对同一query的不同时间定位结果,并标注哪个结果更符合query的意图。然后,训练模型学习这种偏好关系,从而提升时间定位的准确性。

技术框架:TPO是一个后训练框架,可以应用于各种视频大模型。其主要流程包括:1) 构建偏好数据集:包含局部时间定位和综合时间定位两种粒度;2) 使用偏好数据集训练模型:采用对比学习或排序学习等方法,优化模型参数,使其能够区分不同的时间定位结果;3) 评估模型性能:在长视频理解基准上评估TPO的有效性。

关键创新:TPO的关键创新在于利用偏好学习来提升时间定位能力,避免了对大量人工标注数据的依赖。通过自训练的方式,模型可以从自身的预测结果中学习,不断提升时间理解能力。此外,TPO还考虑了不同粒度的时间定位,既关注局部细节,又关注全局上下文。

关键设计:TPO的关键设计包括:1) 偏好数据集的构建:需要精心设计query和时间定位结果,确保偏好关系明确且具有区分性;2) 损失函数的选择:可以使用对比损失、排序损失等,目标是拉近“好”的时间定位结果,推远“坏”的时间定位结果;3) 模型结构的调整:可以根据具体模型进行微调,例如调整注意力机制,使其更关注与query相关的时间片段。

🖼️ 关键图片

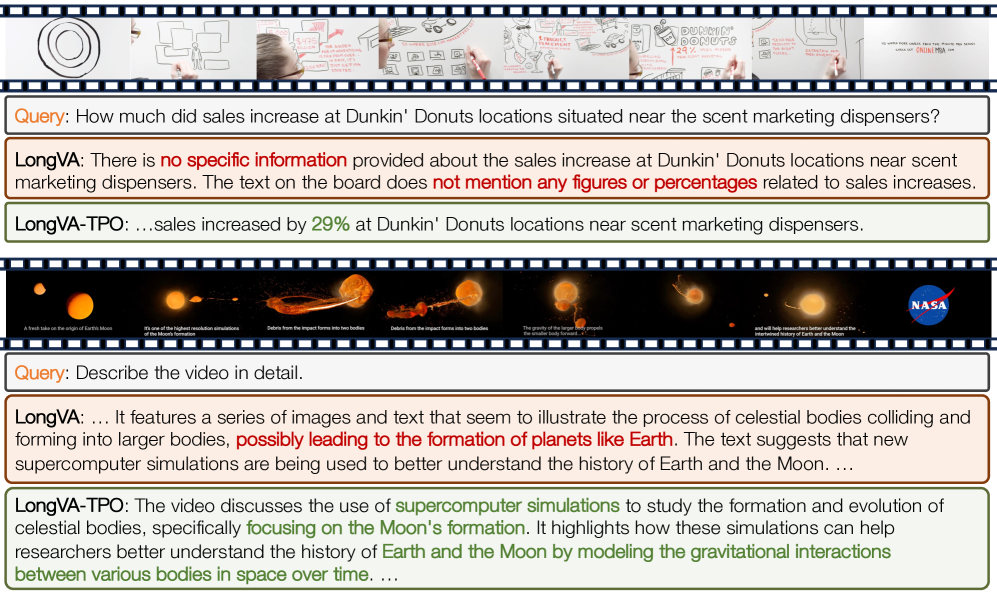

📊 实验亮点

实验结果表明,TPO能够显著提升视频大模型在长视频理解基准上的性能。例如,LLaVA-Video-TPO在Video-MME基准上成为了领先的7B模型,超过了其他同等规模的模型。此外,TPO还能够减少对人工标注数据的依赖,降低训练成本,具有良好的可扩展性。

🎯 应用场景

TPO技术可广泛应用于视频搜索、视频摘要、智能剪辑、视频问答等领域。通过提升模型对长视频的时间理解能力,可以更准确地检索到用户感兴趣的视频片段,自动生成视频摘要,辅助视频创作者进行智能剪辑,并实现更自然的视频问答交互。该技术具有重要的实际应用价值和商业前景。

📄 摘要(原文)

Despite significant advancements in video large multimodal models (video-LMMs), achieving effective temporal grounding in long-form videos remains a challenge for existing models. To address this limitation, we propose Temporal Preference Optimization (TPO), a novel post-training framework designed to enhance the temporal grounding capabilities of video-LMMs through preference learning. TPO adopts a self-training approach that enables models to differentiate between well-grounded and less accurate temporal responses by leveraging curated preference datasets at two granularities: localized temporal grounding, which focuses on specific video segments, and comprehensive temporal grounding, which captures extended temporal dependencies across entire video sequences. By optimizing on these preference datasets, TPO significantly enhances temporal understanding while reducing reliance on manually annotated data. Extensive experiments on three long-form video understanding benchmarks--LongVideoBench, MLVU, and Video-MME--demonstrate the effectiveness of TPO across two state-of-the-art video-LMMs. Notably, LLaVA-Video-TPO establishes itself as the leading 7B model on the Video-MME benchmark, underscoring the potential of TPO as a scalable and efficient solution for advancing temporal reasoning in long-form video understanding. Project page: https://ruili33.github.io/tpo_website.