MetaWild: A Multimodal Dataset for Animal Re-Identification with Environmental Metadata

作者: Yuzhuo Li, Di Zhao, Tingrui Qiao, Yihao Wu, Bo Pang, Yun Sing Koh

分类: cs.CV, cs.LG

发布日期: 2025-01-23 (更新: 2025-08-20)

备注: 7 pages, 6 figures

💡 一句话要点

MetaWild:提出包含环境元数据的多模态动物重识别数据集与元特征适配器。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 动物重识别 多模态学习 环境元数据 视觉-语言模型 数据集 元特征适配器 野生动物保护

📋 核心要点

- 现有动物重识别数据集主要依赖视觉信息,忽略了对动物行为有重要影响的环境元数据。

- 论文提出MetaWild数据集,并设计元特征适配器MFA,将环境元数据融入视觉-语言模型,提升重识别性能。

- 实验表明,结合MFA的ReID模型在MetaWild数据集上表现更优,验证了环境元数据对动物重识别的有效性。

📝 摘要(中文)

为了有效监测和保护野生动物种群,个体动物识别至关重要。计算机视觉的最新进展在动物重识别(Animal ReID)方面展现了潜力,但现有数据集仅依赖视觉数据,忽略了生态学家认为与动物行为和身份高度相关的环境元数据,如温度和昼夜节律。此外,多模态模型能够联合处理视觉和文本数据,为Animal ReID带来新机遇,但现有数据集未能充分利用这些模型的文本处理能力。因此,我们提出了MetaWild数据集,并设计了元特征适配器(MFA),一个轻量级模块,可集成到现有的基于视觉-语言模型的Animal ReID方法中,使ReID模型能够利用环境元数据和视觉信息来提高性能。在MetaWild上的实验表明,与仅使用视觉信息相比,将基线ReID模型与MFA结合使用以整合元数据始终能提高性能,验证了在重识别中整合元数据的有效性。我们希望提出的数据集能够激发对Animal ReID多模态方法的进一步探索。

🔬 方法详解

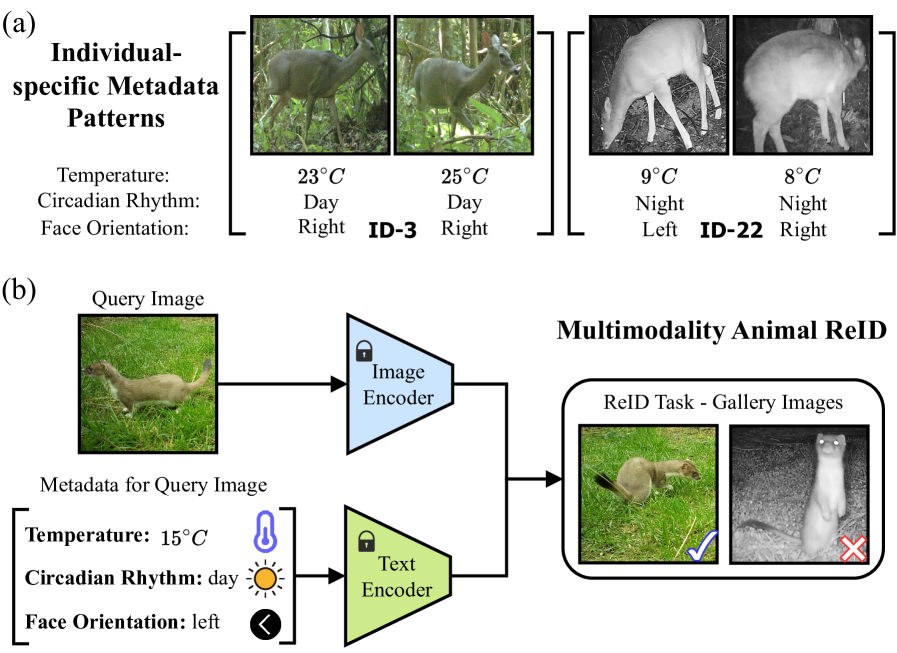

问题定义:现有动物重识别方法主要依赖视觉数据,忽略了环境元数据(如温度、时间等)对动物行为和身份的影响。这些元数据已被生态学家证实与动物个体识别高度相关。此外,现有数据集未能充分利用视觉-语言模型处理文本信息的能力,限制了多模态方法的应用潜力。

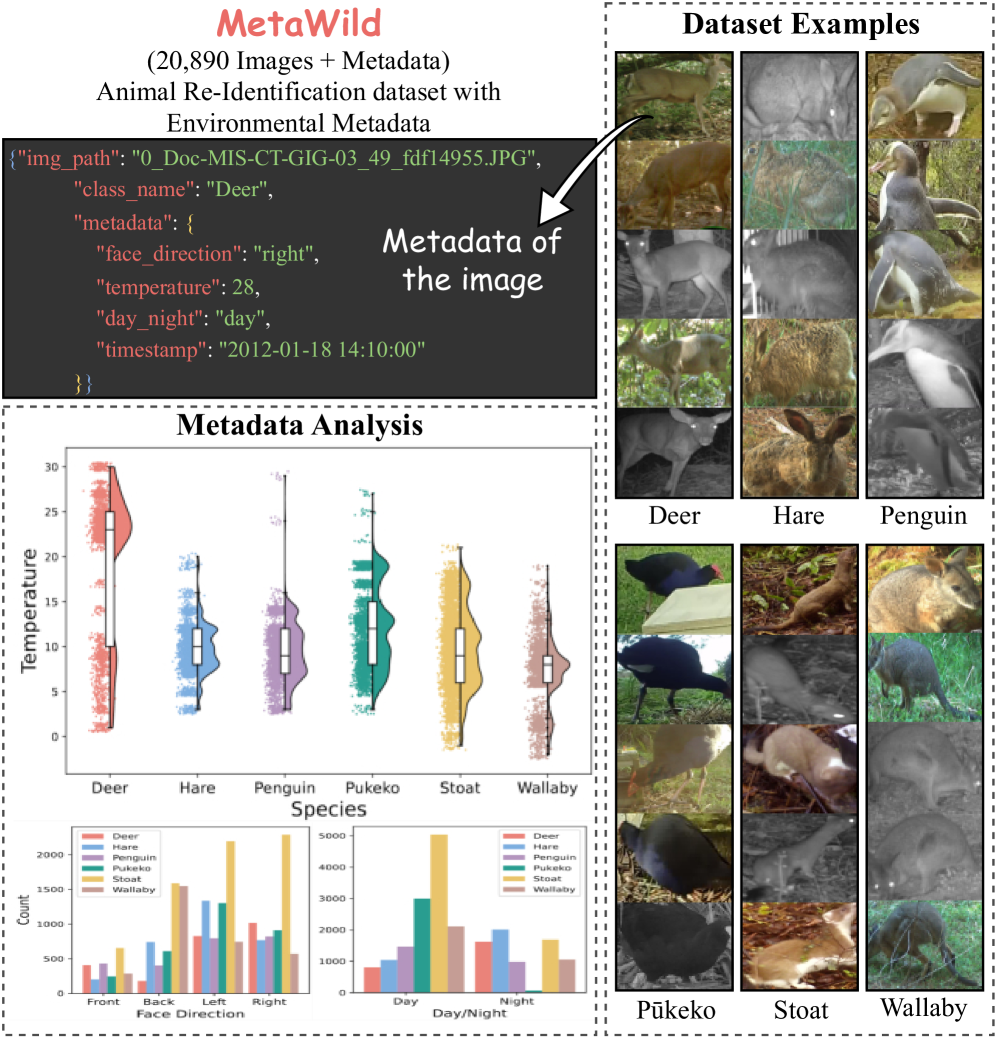

核心思路:论文的核心思路是构建一个包含视觉数据和环境元数据的多模态数据集MetaWild,并设计一个轻量级的元特征适配器(MFA),将环境元数据融入到现有的基于视觉-语言模型的动物重识别方法中。通过结合视觉信息和环境元数据,提升动物重识别的准确率。

技术框架:整体框架包含两个主要部分:MetaWild数据集的构建和元特征适配器(MFA)的设计。MetaWild数据集包含动物图像以及对应的环境元数据。MFA是一个轻量级模块,可以插入到现有的视觉-语言模型中,用于融合视觉特征和环境元数据。具体流程是,首先使用视觉-语言模型提取图像的视觉特征,然后将环境元数据通过MFA进行编码,最后将视觉特征和元数据特征进行融合,用于动物重识别。

关键创新:论文的关键创新在于提出了MetaWild数据集和元特征适配器(MFA)。MetaWild数据集是首个包含环境元数据的动物重识别数据集,为多模态动物重识别研究提供了基础。MFA是一个轻量级的模块,可以方便地集成到现有的视觉-语言模型中,实现环境元数据和视觉信息的有效融合。

关键设计:MFA的设计细节未知,摘要中只提到它是一个轻量级模块,可以插入到现有的视觉-语言模型中。具体如何编码环境元数据,以及如何将元数据特征与视觉特征进行融合,论文中没有详细说明。损失函数和网络结构等细节也未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,将基线ReID模型与MFA结合使用,整合环境元数据后,性能始终优于仅使用视觉信息的方法。这验证了在动物重识别中整合环境元数据的有效性。具体的性能提升幅度未知,需要在论文中查找详细的实验数据。

🎯 应用场景

该研究成果可应用于野生动物保护和监测领域,例如通过分析相机陷阱拍摄的图像和环境数据,自动识别个体动物,从而追踪动物的迁徙路线、种群数量和行为模式。这有助于制定更有效的保护策略,并评估保护措施的效果。未来,该方法还可以扩展到其他需要个体识别的场景,例如家畜管理和宠物追踪。

📄 摘要(原文)

Identifying individual animals within large wildlife populations is essential for effective wildlife monitoring and conservation efforts. Recent advancements in computer vision have shown promise in animal re-identification (Animal ReID) by leveraging data from camera traps. However, existing Animal ReID datasets rely exclusively on visual data, overlooking environmental metadata that ecologists have identified as highly correlated with animal behavior and identity, such as temperature and circadian rhythms. Moreover, the emergence of multimodal models capable of jointly processing visual and textual data presents new opportunities for Animal ReID, but existing datasets fail to leverage these models' text-processing capabilities, limiting their full potential. Additionally, to facilitate the use of metadata in existing ReID methods, we propose the Meta-Feature Adapter (MFA), a lightweight module that can be incorporated into existing vision-language model (VLM)-based Animal ReID methods, allowing ReID models to leverage both environmental metadata and visual information to improve ReID performance. Experiments on MetaWild show that combining baseline ReID models with MFA to incorporate metadata consistently improves performance compared to using visual information alone, validating the effectiveness of incorporating metadata in re-identification. We hope that our proposed dataset can inspire further exploration of multimodal approaches for Animal ReID.