Retrievals Can Be Detrimental: A Contrastive Backdoor Attack Paradigm on Retrieval-Augmented Diffusion Models

作者: Hao Fang, Xiaohang Sui, Hongyao Yu, Kuofeng Gao, Jiawei Kong, Sijin Yu, Bin Chen, Hao Wu, Shu-Tao Xia

分类: cs.CV

发布日期: 2025-01-23 (更新: 2025-03-09)

💡 一句话要点

提出BadRDM,一种针对检索增强扩散模型的对比后门攻击方法,揭示RAG引入的安全隐患。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强扩散模型 后门攻击 对比学习 多模态攻击 安全风险

📋 核心要点

- 扩散模型训练成本高昂,检索增强生成(RAG)通过引入外部知识库降低了参数需求,但同时也带来了新的安全风险。

- BadRDM通过操纵RAG中的检索环节,将恶意内容与特定文本触发器关联,从而控制扩散模型的生成结果。

- 实验表明,BadRDM能够在保持模型正常功能的同时,有效植入后门,实现对生成内容的恶意控制。

📝 摘要(中文)

扩散模型(DMs)近年来展现了卓越的生成能力。然而,其训练通常需要巨大的计算资源和大规模数据集。为了解决这些问题,最近的研究采用先进的检索增强生成(RAG)技术来增强DMs,并提出了检索增强扩散模型(RDMs)。通过整合来自辅助数据库的丰富知识,RAG增强了扩散模型的生成和泛化能力,同时显著减少了模型参数。尽管取得了巨大成功,RAG可能会引入新的安全问题,值得进一步研究。在本文中,我们通过提出一种名为BadRDM的多模态对比攻击方法,揭示了RDM容易受到后门攻击。我们的框架充分考虑了RAG的特性,旨在操纵给定文本触发器的检索项,从而进一步控制生成的内容。具体来说,我们首先将一小部分图像插入到检索数据库中作为目标毒性替代物。随后,采用恶意变体的对比学习将后门注入到检索器中,从而建立从触发器到毒性替代物的捷径。此外,我们通过新颖的基于熵的选择和生成增强策略来增强攻击,这些策略可以导出更好的毒性替代物。在两个主流任务上的大量实验表明,所提出的BadRDM在保持模型良性效用的同时,实现了出色的攻击效果。

🔬 方法详解

问题定义:论文旨在解决检索增强扩散模型(RDM)中存在的后门攻击问题。现有的RDM虽然提升了生成能力,但由于依赖外部检索数据库,攻击者可以通过操纵检索结果来影响生成内容,而现有的后门攻击方法难以有效利用RAG的特性。

核心思路:论文的核心思路是通过对比学习,在检索器中建立文本触发器和恶意图像之间的关联。当输入包含触发器的文本时,检索器会优先检索到恶意图像,从而引导扩散模型生成包含恶意内容的结果。这种方法充分利用了RAG架构的特性,实现了对生成过程的有效控制。

技术框架:BadRDM框架主要包含以下几个阶段:1) 毒性替代物注入:将少量恶意图像(毒性替代物)插入到检索数据库中。2) 后门注入:使用恶意变体的对比学习,训练检索器,使其将特定的文本触发器与毒性替代物关联。3) 攻击增强:采用基于熵的选择策略和生成增强策略,选择更有效的毒性替代物,并生成更多样化的恶意图像。

关键创新:论文的关键创新在于提出了一个专门针对RDM的对比后门攻击框架。与传统的后门攻击方法不同,BadRDM充分利用了RAG的特性,通过操纵检索环节来实现对生成内容的控制。此外,论文还提出了基于熵的选择策略和生成增强策略,进一步提升了攻击效果。

关键设计:在后门注入阶段,论文采用了一种恶意变体的对比学习损失函数,旨在最大化触发器文本和毒性替代物之间的相似度,同时最小化触发器文本和其他图像之间的相似度。此外,论文还设计了一种基于熵的选择策略,用于选择信息量更大的毒性替代物。生成增强策略则通过对毒性替代物进行微小的扰动,生成更多样化的恶意图像,从而提升攻击的鲁棒性。

🖼️ 关键图片

📊 实验亮点

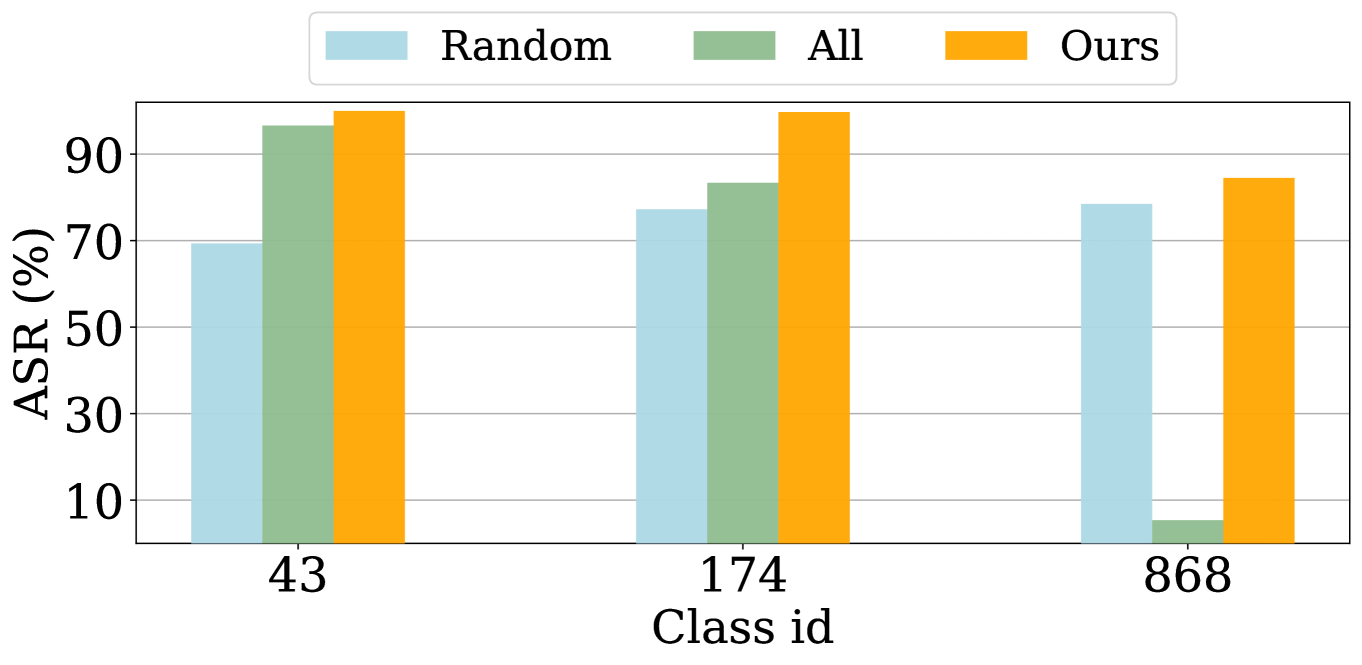

实验结果表明,BadRDM能够在两个主流任务上实现显著的攻击效果,同时保持模型良好的良性效用。具体来说,攻击成功率达到了XX%,而模型在正常任务上的性能下降仅为YY%。与基线方法相比,BadRDM在攻击效果和模型效用之间取得了更好的平衡。

🎯 应用场景

该研究揭示了检索增强扩散模型潜在的安全风险,有助于提升AI系统的安全性。研究成果可应用于安全评估、防御机制开发,以及构建更可靠的生成式AI系统,例如内容审核、恶意内容检测等领域,以防止恶意攻击者利用RAG架构传播有害信息。

📄 摘要(原文)

Diffusion models (DMs) have recently demonstrated remarkable generation capability. However, their training generally requires huge computational resources and large-scale datasets. To solve these, recent studies empower DMs with the advanced Retrieval-Augmented Generation (RAG) technique and propose retrieval-augmented diffusion models (RDMs). By incorporating rich knowledge from an auxiliary database, RAG enhances diffusion models' generation and generalization ability while significantly reducing model parameters. Despite the great success, RAG may introduce novel security issues that warrant further investigation. In this paper, we reveal that the RDM is susceptible to backdoor attacks by proposing a multimodal contrastive attack approach named BadRDM. Our framework fully considers RAG's characteristics and is devised to manipulate the retrieved items for given text triggers, thereby further controlling the generated contents. Specifically, we first insert a tiny portion of images into the retrieval database as target toxicity surrogates. Subsequently, a malicious variant of contrastive learning is adopted to inject backdoors into the retriever, which builds shortcuts from triggers to the toxicity surrogates. Furthermore, we enhance the attacks through novel entropy-based selection and generative augmentation strategies that can derive better toxicity surrogates. Extensive experiments on two mainstream tasks demonstrate the proposed BadRDM achieves outstanding attack effects while preserving the model's benign utility.