GS-LiDAR: Generating Realistic LiDAR Point Clouds with Panoramic Gaussian Splatting

作者: Junzhe Jiang, Chun Gu, Yurui Chen, Li Zhang

分类: cs.CV, cs.GR, eess.IV

发布日期: 2025-01-22 (更新: 2025-02-05)

💡 一句话要点

GS-LiDAR:利用全景高斯溅射生成逼真的LiDAR点云,提升自动驾驶系统仿真效果。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: LiDAR新视角合成 高斯溅射 自动驾驶 点云生成 全景渲染

📋 核心要点

- 现有LiDAR新视角合成方法依赖NeRF,计算成本高昂,且不适用于非对称的驾驶场景。

- GS-LiDAR利用带周期振动特性的2D高斯基元,精确重建驾驶场景中的静态和动态元素。

- 通过全景渲染技术和球谐系数,GS-LiDAR显著提升了点云的真实感,并在效率上优于现有方法。

📝 摘要(中文)

LiDAR新视角合成(NVS)已成为LiDAR模拟中的一项新兴任务,它提供来自新视角的有价值的模拟点云数据,以辅助自动驾驶系统。然而,现有的LiDAR NVS方法通常依赖于神经辐射场(NeRF)作为其3D表示,这在训练和渲染中都会产生巨大的计算成本。此外,NeRF及其变体是为对称场景设计的,这使得它们不适合驾驶场景。为了应对这些挑战,我们提出了一种新的框架GS-LiDAR,用于利用全景高斯溅射生成逼真的LiDAR点云。我们的方法采用具有周期性振动特性的2D高斯基元,从而能够精确地重建驾驶场景中的静态和动态元素。我们进一步引入了一种新的全景渲染技术,该技术具有显式的光线-溅射相交,并由全景LiDAR监督引导。通过将强度和光线衰减球谐(SH)系数合并到高斯基元中,我们增强了渲染点云的真实感。在KITTI-360和nuScenes上的大量实验表明,我们的方法在定量指标、视觉质量以及训练和渲染效率方面都具有优越性。

🔬 方法详解

问题定义:现有LiDAR新视角合成方法主要基于NeRF,存在计算量大、训练时间长的问题,难以满足自动驾驶系统对实时性和效率的需求。此外,NeRF及其变体更适合处理对称场景,而自动驾驶场景通常是非对称的,导致重建效果不佳。

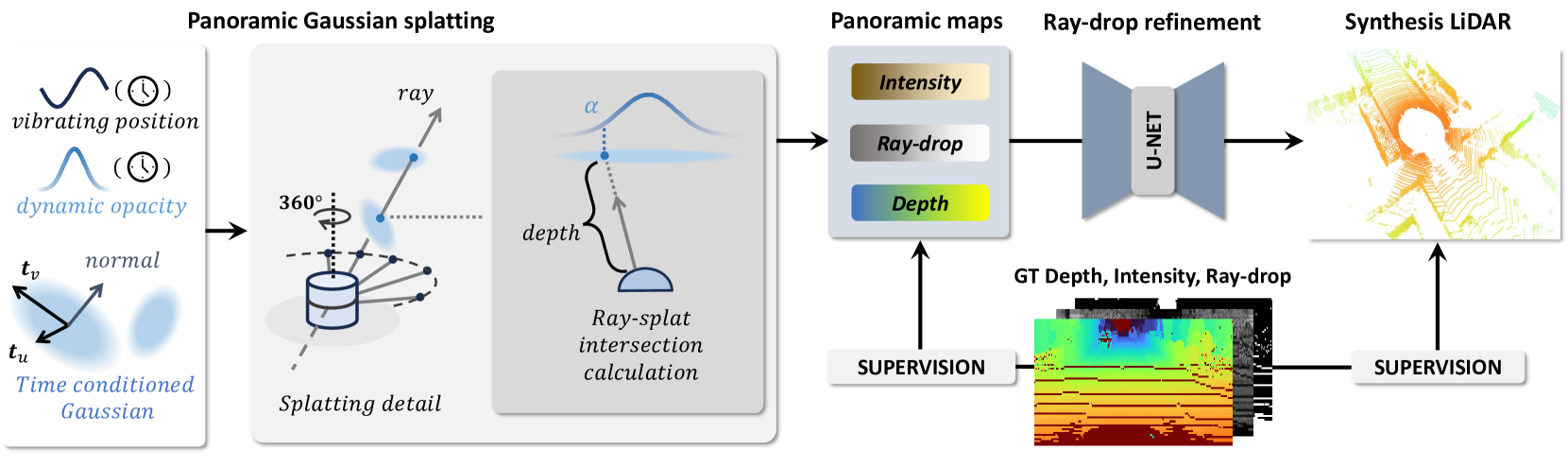

核心思路:GS-LiDAR的核心思路是利用高斯溅射(Gaussian Splatting)技术,用一系列带有属性的2D高斯基元来表示场景。通过优化这些高斯基元的参数,可以实现对场景的精确重建和新视角的渲染。同时,引入周期性振动特性来更好地处理动态物体,并采用全景渲染技术来适应LiDAR的特性。

技术框架:GS-LiDAR的整体框架包括以下几个主要阶段:1) 初始化:使用原始LiDAR数据初始化一组2D高斯基元,每个基元具有位置、尺度、旋转、颜色等属性。2) 优化:通过最小化渲染点云与真实LiDAR点云之间的差异,优化高斯基元的参数。优化过程中,引入周期性振动特性来处理动态物体。3) 渲染:使用全景渲染技术,将高斯基元投影到新的视角,生成新的LiDAR点云。渲染过程中,考虑光线衰减和遮挡等因素,以提高渲染质量。

关键创新:GS-LiDAR的关键创新在于以下几个方面:1) 提出了一种基于高斯溅射的LiDAR新视角合成方法,避免了NeRF的计算瓶颈。2) 引入了周期性振动特性,更好地处理了动态物体。3) 提出了一种全景渲染技术,适应了LiDAR的特性,提高了渲染质量。4) 将强度和光线衰减球谐(SH)系数合并到高斯基元中,增强了渲染点云的真实感。

关键设计:GS-LiDAR的关键设计包括:1) 使用2D高斯基元来表示场景,每个基元具有位置、尺度、旋转、颜色、透明度等属性。2) 引入周期性振动特性,通过学习振动幅度和频率来模拟动态物体的运动。3) 使用全景渲染技术,通过显式的光线-溅射相交计算,将高斯基元投影到新的视角。4) 使用L1损失和D-SSIM损失来约束渲染点云与真实LiDAR点云之间的差异。5) 使用Adam优化器来优化高斯基元的参数。

🖼️ 关键图片

📊 实验亮点

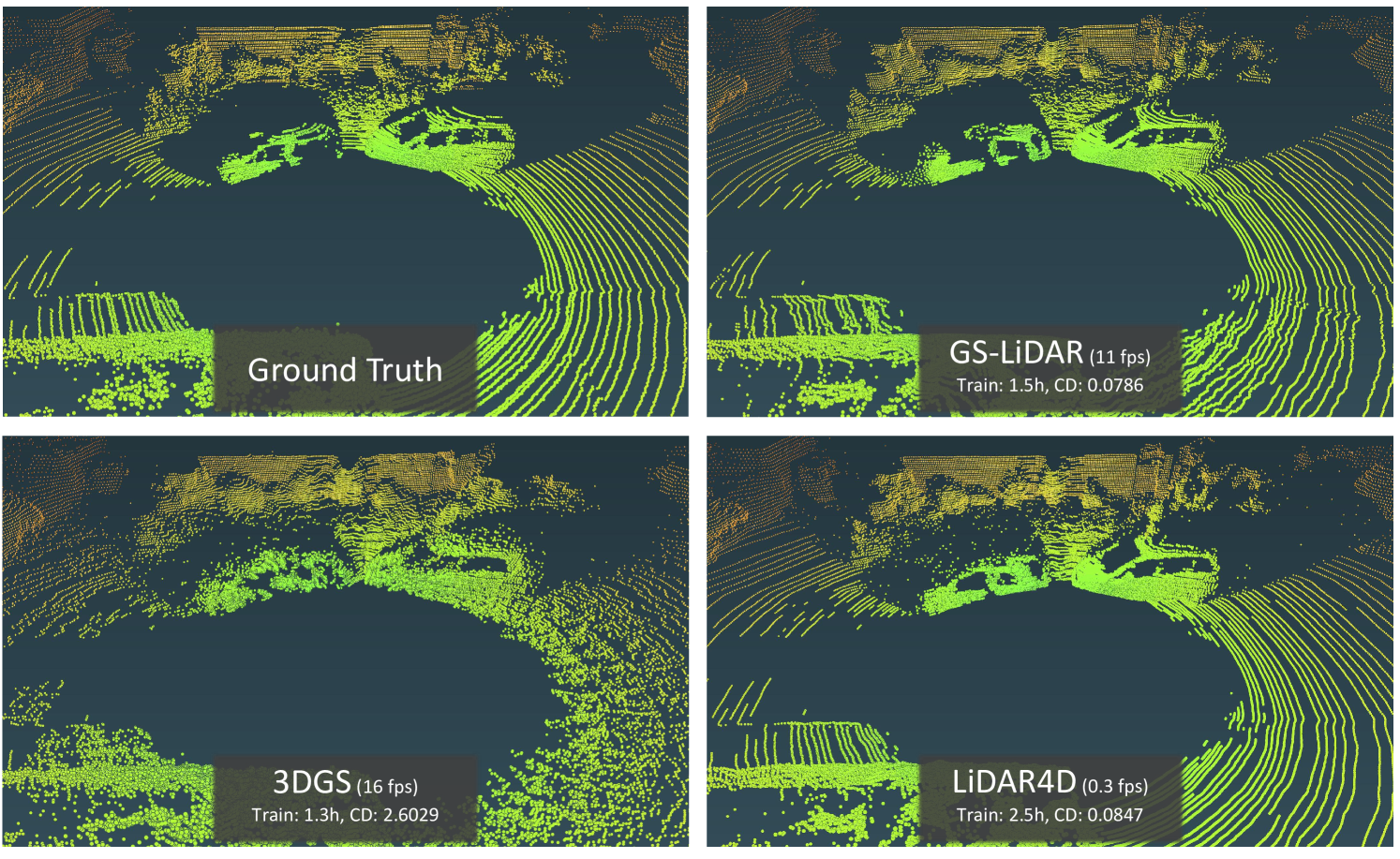

GS-LiDAR在KITTI-360和nuScenes数据集上进行了广泛的实验,结果表明,GS-LiDAR在定量指标(如PSNR、SSIM、L1距离)和视觉质量方面均优于现有的NeRF-based方法。此外,GS-LiDAR的训练和渲染效率也显著高于NeRF,训练时间缩短了约5倍,渲染速度提高了约10倍。这些结果表明,GS-LiDAR是一种高效、高质量的LiDAR新视角合成方法。

🎯 应用场景

GS-LiDAR在自动驾驶领域具有广泛的应用前景。它可以用于生成大量的LiDAR模拟数据,用于训练和评估自动驾驶算法。此外,GS-LiDAR还可以用于LiDAR传感器的故障诊断和性能评估,以及自动驾驶场景的重建和可视化。该研究的成果有助于提高自动驾驶系统的安全性和可靠性,加速自动驾驶技术的商业化进程。

📄 摘要(原文)

LiDAR novel view synthesis (NVS) has emerged as a novel task within LiDAR simulation, offering valuable simulated point cloud data from novel viewpoints to aid in autonomous driving systems. However, existing LiDAR NVS methods typically rely on neural radiance fields (NeRF) as their 3D representation, which incurs significant computational costs in both training and rendering. Moreover, NeRF and its variants are designed for symmetrical scenes, making them ill-suited for driving scenarios. To address these challenges, we propose GS-LiDAR, a novel framework for generating realistic LiDAR point clouds with panoramic Gaussian splatting. Our approach employs 2D Gaussian primitives with periodic vibration properties, allowing for precise geometric reconstruction of both static and dynamic elements in driving scenarios. We further introduce a novel panoramic rendering technique with explicit ray-splat intersection, guided by panoramic LiDAR supervision. By incorporating intensity and ray-drop spherical harmonic (SH) coefficients into the Gaussian primitives, we enhance the realism of the rendered point clouds. Extensive experiments on KITTI-360 and nuScenes demonstrate the superiority of our method in terms of quantitative metrics, visual quality, as well as training and rendering efficiency.