3D Object Manipulation in a Single Image using Generative Models

作者: Ruisi Zhao, Zechuan Zhang, Zongxin Yang, Yi Yang

分类: cs.CV

发布日期: 2025-01-22

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

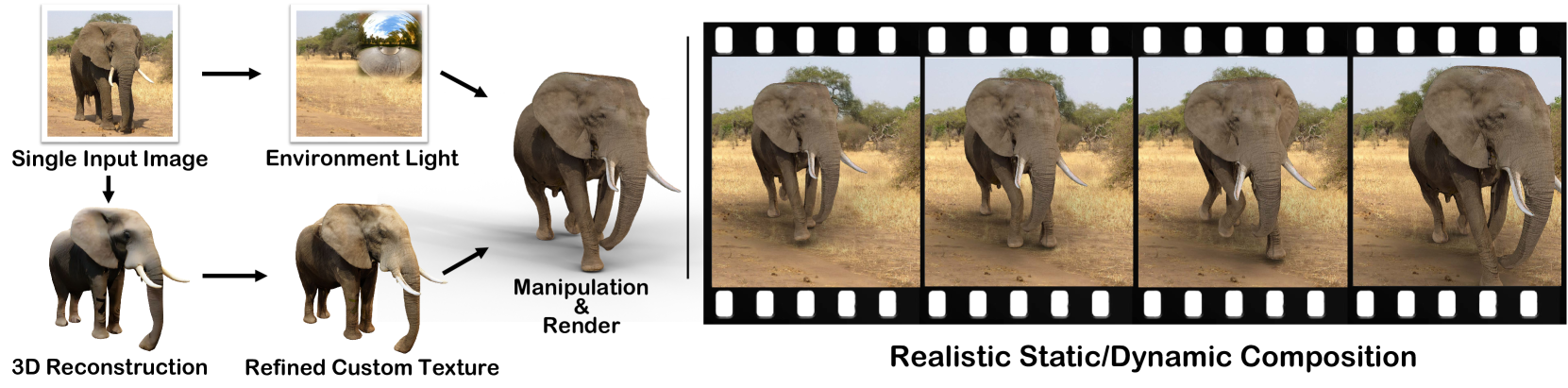

提出OMG3D框架,结合几何控制与扩散模型,实现单张图像中3D物体逼真操控与动态生成。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 3D物体操控 图像生成 扩散模型 几何控制 纹理细化

📋 核心要点

- 现有方法难以兼顾图像中物体的静态编辑和动态生成,且在物体外观和光照真实性方面存在不足。

- OMG3D框架将2D物体转换为3D,利用几何控制实现用户自定义修改和逼真运动,并结合扩散模型提升生成质量。

- 通过CustomRefiner细化纹理,IllumiCombiner处理光照,实验证明OMG3D在静态和动态场景中均表现出色,且计算资源需求较低。

📝 摘要(中文)

本文提出OMG3D,一个新颖的框架,旨在解决图像中物体操控问题,该问题不仅涉及编辑物体的外观,还赋予物体运动的能力。以往方法在同时处理静态编辑和动态生成方面面临挑战,并且难以保证物体外观和场景光照的逼真度。OMG3D集成了精确的几何控制与扩散模型的生成能力,从而显著提升了视觉效果。该框架首先将2D物体转换为3D,从而实现用户导向的修改和逼真的运动。为了解决纹理真实感问题,我们提出了CustomRefiner,一个纹理细化模块,它预训练一个定制的扩散模型,将3D粗糙模型的粗略渲染的细节和风格与原始图像对齐,进一步细化纹理。此外,我们引入了IllumiCombiner,一个光照处理模块,用于估计和校正背景光照,以匹配人类视觉感知,从而产生更逼真的阴影效果。大量实验表明,我们的方法在静态和动态场景中都具有出色的视觉性能。值得注意的是,所有这些步骤都可以使用一个NVIDIA 3090完成。

🔬 方法详解

问题定义:论文旨在解决单张图像中3D物体的操控问题,包括编辑物体外观和赋予物体运动。现有方法的痛点在于难以同时保证静态编辑和动态生成的质量,并且在物体纹理和光照的真实性方面存在不足,导致生成结果不够逼真。

核心思路:论文的核心思路是将2D物体转换为3D表示,从而利用3D几何控制的优势来实现精确的物体操控和运动模拟。同时,利用扩散模型的强大生成能力来提升物体纹理和光照的真实感,弥补3D建模可能带来的细节缺失。通过结合几何控制和生成模型,实现高质量的物体操控和动态生成。

技术框架:OMG3D框架主要包含以下几个模块:1) 2D-to-3D转换模块,将图像中的2D物体转换为3D表示;2) 几何操控模块,允许用户对3D物体进行修改和运动编辑;3) CustomRefiner纹理细化模块,利用预训练的扩散模型提升纹理真实感;4) IllumiCombiner光照处理模块,估计和校正背景光照,增强阴影效果。整体流程是从2D图像到3D表示,再进行操控和优化,最终生成高质量的操控结果。

关键创新:论文的关键创新在于将精确的几何控制与扩散模型的生成能力相结合。CustomRefiner和IllumiCombiner是两个重要的创新模块,前者通过预训练的扩散模型来细化纹理,后者通过光照估计和校正来增强真实感。这种结合使得OMG3D能够同时实现精确的物体操控和逼真的视觉效果,克服了现有方法的局限性。

关键设计:CustomRefiner模块的关键在于预训练一个定制的扩散模型,该模型能够学习原始图像的纹理细节和风格,并将这些信息用于细化3D粗糙模型的渲染结果。IllumiCombiner模块的关键在于光照估计和校正算法,该算法能够准确地估计背景光照,并调整生成物体的光照效果,使其与背景光照保持一致。具体的损失函数和网络结构等细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,OMG3D在静态和动态场景中均取得了出色的视觉效果。该方法能够生成逼真的物体纹理和光照效果,并且支持用户自定义的物体操控和运动编辑。值得一提的是,所有步骤仅需一张NVIDIA 3090即可完成,表明该方法具有较高的计算效率。

🎯 应用场景

OMG3D技术可应用于图像编辑、游戏开发、虚拟现实、电影特效等领域。例如,用户可以轻松地在照片中修改物体的姿态、添加运动效果,或者在虚拟场景中创建逼真的3D物体。该技术具有广泛的应用前景,能够提升用户体验和创作效率。

📄 摘要(原文)

Object manipulation in images aims to not only edit the object's presentation but also gift objects with motion. Previous methods encountered challenges in concurrently handling static editing and dynamic generation, while also struggling to achieve fidelity in object appearance and scene lighting. In this work, we introduce \textbf{OMG3D}, a novel framework that integrates the precise geometric control with the generative power of diffusion models, thus achieving significant enhancements in visual performance. Our framework first converts 2D objects into 3D, enabling user-directed modifications and lifelike motions at the geometric level. To address texture realism, we propose CustomRefiner, a texture refinement module that pre-train a customized diffusion model, aligning the details and style of coarse renderings of 3D rough model with the original image, further refine the texture. Additionally, we introduce IllumiCombiner, a lighting processing module that estimates and corrects background lighting to match human visual perception, resulting in more realistic shadow effects. Extensive experiments demonstrate the outstanding visual performance of our approach in both static and dynamic scenarios. Remarkably, all these steps can be done using one NVIDIA 3090. Project page is at https://whalesong-zrs.github.io/OMG3D-projectpage/