Event-based vision for egomotion estimation using precise event timing

作者: Hugh Greatorex, Michele Mastella, Madison Cotteret, Ole Richter, Elisabetta Chicca

分类: cs.CV, cs.AR, cs.RO

发布日期: 2025-01-20

备注: 10 pages, 7 figures. Supplementary material: 4 pages, 1 figure

💡 一句话要点

提出基于精确事件时间信息的事件相机运动估计方法,适用于低功耗机器人应用。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 事件相机 运动估计 脉冲神经网络 光流 低功耗 机器人 自主导航

📋 核心要点

- 传统基于惯性传感器的运动估计方法易受外部条件影响,且存在长期漂移导致精度下降。

- 提出一种完全基于事件的运动估计流程,直接处理事件流,无需帧间媒介,实现低延迟和节能。

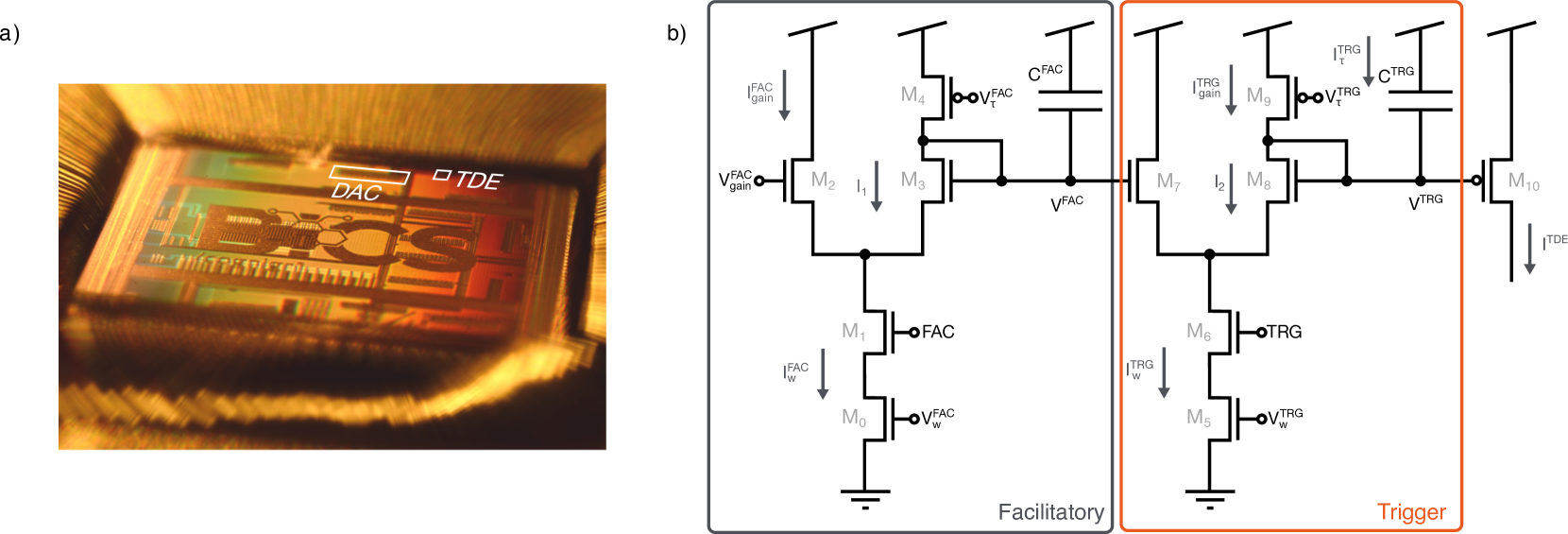

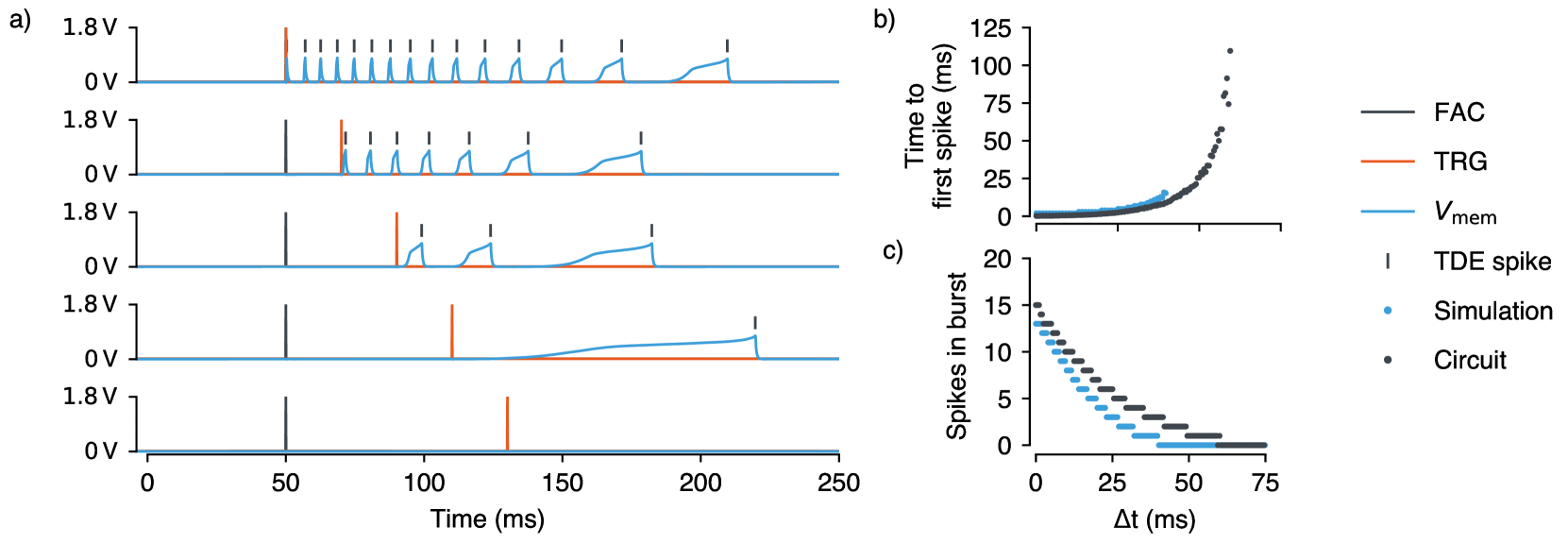

- 构建浅层脉冲神经网络,利用突触门控机制将事件时间转化为脉冲,编码光流速度,实现运动估计。

📝 摘要(中文)

本文提出了一种完全基于事件的运动估计流程,该流程直接在事件域中处理事件流。该方法消除了对基于帧的中间步骤的需求,从而实现了低延迟和节能的运动估计。我们构建了一个使用突触门控机制的浅层脉冲神经网络,将精确的事件时间转换为脉冲串。这些脉冲编码局部光流速度,并且网络提供基于事件的运动估计读数。我们在专用芯片上评估了网络的性能,证明了其在低延迟、低功耗运动估计方面的强大潜力。此外,更大网络的仿真表明,该系统在基于事件相机的运动估计任务中实现了最先进的精度,使其成为实时、功率受限的机器人应用的有希望的解决方案。

🔬 方法详解

问题定义:论文旨在解决在资源受限的机器人应用中,如何利用事件相机进行高效、低延迟的自身运动估计问题。传统方法,如基于惯性传感器的方法,容易受到环境干扰并产生累积误差。而传统的视觉方法计算复杂度高,不适合低功耗场景。

核心思路:论文的核心思路是直接在事件域中处理事件流,避免转换为帧图像,从而降低计算复杂度和延迟。通过构建一个浅层脉冲神经网络,将事件的精确时间信息转化为脉冲,进而编码局部光流速度,最终实现运动估计。这种方法充分利用了事件相机的高时间分辨率和低功耗特性。

技术框架:该方法主要包含以下几个阶段:1) 事件数据输入:事件相机捕获场景中的亮度变化,生成事件流。2) 脉冲神经网络:使用一个浅层脉冲神经网络,该网络利用突触门控机制将事件时间信息转化为脉冲。3) 光流编码:脉冲神经网络的输出编码了局部光流速度。4) 运动估计:基于编码的光流信息,进行运动估计,得到相机的自身运动参数。

关键创新:该方法最重要的创新点在于提出了一个完全基于事件的运动估计流程,无需将事件数据转换为帧图像。此外,利用脉冲神经网络直接处理事件流,并使用突触门控机制编码光流信息,也是一个重要的创新。这种方法能够充分利用事件相机的高时间分辨率和低功耗特性,实现高效、低延迟的运动估计。

关键设计:该方法使用了一个浅层脉冲神经网络,具体结构未知。突触门控机制是该网络的核心,其具体实现方式未知。论文中提到在专用芯片上进行了评估,但芯片的具体参数和配置未知。损失函数和训练方法也未详细描述。

🖼️ 关键图片

📊 实验亮点

论文在专用芯片上评估了所提出的方法,展示了其在低延迟、低功耗运动估计方面的潜力。仿真结果表明,该系统在基于事件相机的运动估计任务中达到了最先进的精度。虽然具体的性能数据和对比基线未在摘要中给出,但“state-of-the-art accuracy”表明该方法具有显著的优势。

🎯 应用场景

该研究成果可应用于自主导航、机器人等领域,尤其适用于对功耗和延迟有严格要求的场景,如无人机、移动机器人、可穿戴设备等。通过低功耗、低延迟的运动估计,可以提升机器人的自主性和环境适应能力,实现更高效、更可靠的导航和控制。

📄 摘要(原文)

Egomotion estimation is crucial for applications such as autonomous navigation and robotics, where accurate and real-time motion tracking is required. However, traditional methods relying on inertial sensors are highly sensitive to external conditions, and suffer from drifts leading to large inaccuracies over long distances. Vision-based methods, particularly those utilising event-based vision sensors, provide an efficient alternative by capturing data only when changes are perceived in the scene. This approach minimises power consumption while delivering high-speed, low-latency feedback. In this work, we propose a fully event-based pipeline for egomotion estimation that processes the event stream directly within the event-based domain. This method eliminates the need for frame-based intermediaries, allowing for low-latency and energy-efficient motion estimation. We construct a shallow spiking neural network using a synaptic gating mechanism to convert precise event timing into bursts of spikes. These spikes encode local optical flow velocities, and the network provides an event-based readout of egomotion. We evaluate the network's performance on a dedicated chip, demonstrating strong potential for low-latency, low-power motion estimation. Additionally, simulations of larger networks show that the system achieves state-of-the-art accuracy in egomotion estimation tasks with event-based cameras, making it a promising solution for real-time, power-constrained robotics applications.