Rethinking Early-Fusion Strategies for Improved Multimodal Image Segmentation

作者: Zhengwen Shen, Yulian Li, Han Zhang, Yuchen Weng, Jun Wang

分类: cs.CV

发布日期: 2025-01-19

备注: Accepted by ICASSP 2025

💡 一句话要点

提出基于早融合策略的EFNet,用于低照度下的高效多模态图像分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 语义分割 RGB-T图像 早融合 特征聚类

📋 核心要点

- 现有RGB-T语义分割方法通常采用双分支编码器和复杂融合策略,导致参数量和计算量巨大。

- 论文提出基于早融合策略的EFNet,并结合特征聚类,旨在降低模型复杂度和提升训练效率。

- 实验结果表明,该方法在多个数据集上优于现有技术,同时显著降低了参数量和计算量。

📝 摘要(中文)

本文提出了一种新颖的多模态融合网络(EFNet),该网络基于早融合策略和简单而有效的特征聚类,旨在训练高效的RGB-T语义分割模型,解决现有方法在多模态特征提取和融合过程中参数量大、计算量大的问题。此外,还提出了一种基于欧几里得距离的轻量级高效多尺度特征聚合解码器。在不同数据集上的实验验证了该方法的有效性,并且在参数量和计算量更低的情况下,性能优于以往的state-of-the-art方法。

🔬 方法详解

问题定义:现有的RGB-T语义分割方法,特别是那些依赖于双分支编码器和复杂特征融合策略的方法,在特征提取和融合阶段需要大量的参数更新和计算资源。这限制了它们在资源受限环境中的应用,并且增加了训练的难度和时间成本。因此,如何设计一种高效的多模态融合方法,在保证分割精度的同时,降低计算复杂度和参数量,是一个亟待解决的问题。

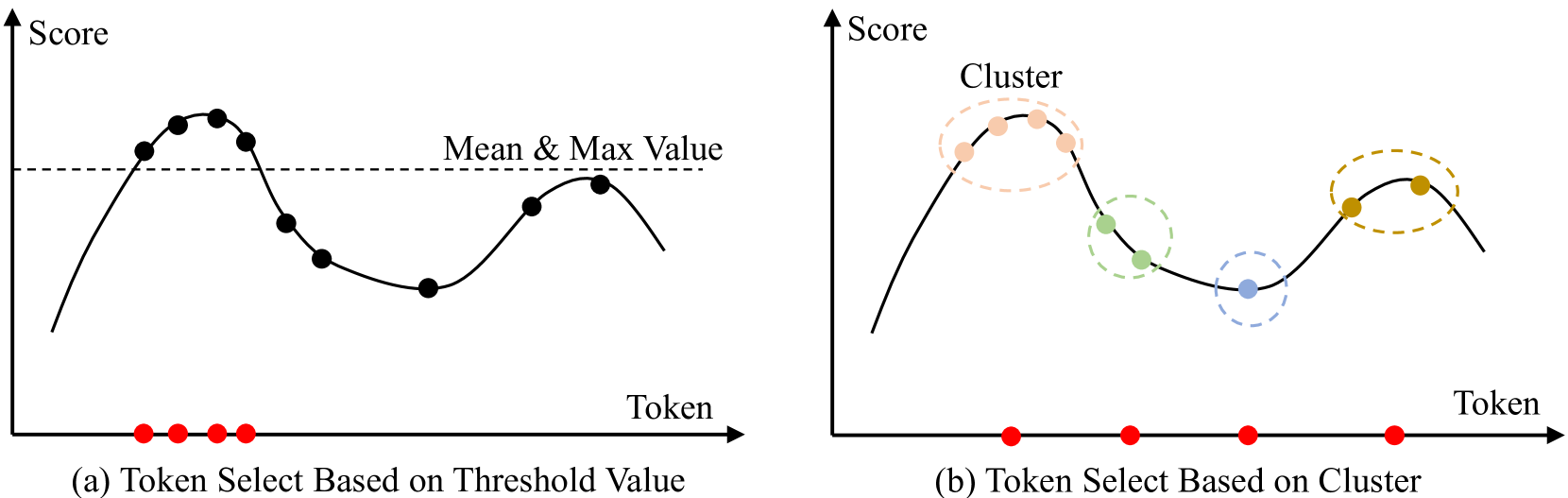

核心思路:论文的核心思路是采用早融合策略,将RGB和热成像图像在输入端进行融合,从而避免了在特征提取阶段进行复杂的多模态特征交互。此外,论文还提出了一个简单但有效的特征聚类方法,用于进一步提升模型的训练效率。通过这种方式,模型能够更有效地学习到多模态数据之间的关联性,从而提升分割性能。

技术框架:EFNet主要由三个部分组成:早融合模块、编码器和解码器。首先,RGB和热成像图像在早融合模块中进行融合,得到融合后的特征图。然后,融合后的特征图被送入编码器进行特征提取。最后,解码器利用提取到的特征进行语义分割。解码器采用了轻量级高效多尺度特征聚合策略,基于欧几里得距离进行特征聚合。

关键创新:论文的关键创新在于提出了基于早融合策略的EFNet,以及简单有效的特征聚类方法。与传统的双分支编码器相比,早融合策略能够显著降低模型的参数量和计算复杂度。特征聚类方法能够帮助模型更好地学习多模态数据之间的关联性,从而提升分割性能。此外,轻量级多尺度特征聚合解码器也贡献了性能的提升。

关键设计:早融合模块的具体实现方式未知,但可以推测是简单的通道拼接或加权融合。特征聚类方法的具体实现细节也未知,但可能是通过某种聚类算法将特征进行分组,然后对每个组进行单独处理。解码器中,欧几里得距离被用于衡量不同尺度特征之间的相似性,从而进行特征聚合。损失函数未知,但通常会采用交叉熵损失或Dice损失。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EFNet在多个RGB-T语义分割数据集上取得了state-of-the-art的性能,同时显著降低了参数量和计算量。具体性能数据和对比基线未知,但摘要中明确指出EFNet优于以往的方法,并且具有更低的参数和计算需求。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、安防监控等领域。在这些场景中,低照度条件下的语义分割至关重要。通过融合RGB和热成像信息,可以提高系统在恶劣光照条件下的感知能力,从而提升系统的安全性和可靠性。未来,该方法有望进一步扩展到其他多模态图像分割任务中。

📄 摘要(原文)

RGB and thermal image fusion have great potential to exhibit improved semantic segmentation in low-illumination conditions. Existing methods typically employ a two-branch encoder framework for multimodal feature extraction and design complicated feature fusion strategies to achieve feature extraction and fusion for multimodal semantic segmentation. However, these methods require massive parameter updates and computational effort during the feature extraction and fusion. To address this issue, we propose a novel multimodal fusion network (EFNet) based on an early fusion strategy and a simple but effective feature clustering for training efficient RGB-T semantic segmentation. In addition, we also propose a lightweight and efficient multi-scale feature aggregation decoder based on Euclidean distance. We validate the effectiveness of our method on different datasets and outperform previous state-of-the-art methods with lower parameters and computation.