Decomposing and Fusing Intra- and Inter-Sensor Spatio-Temporal Signal for Multi-Sensor Wearable Human Activity Recognition

作者: Haoyu Xie, Haoxuan Li, Chunyuan Zheng, Haonan Yuan, Guorui Liao, Jun Liao, Li Liu

分类: cs.CV, cs.AI, cs.HC

发布日期: 2025-01-19 (更新: 2025-04-25)

💡 一句话要点

提出DecomposeWHAR模型,有效分解融合多传感器时空信号,提升可穿戴人体活动识别精度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 可穿戴设备 人体活动识别 多传感器融合 深度学习 时空建模 自注意力机制 状态空间模型

📋 核心要点

- 现有WHAR方法未能有效区分和利用传感器内和传感器间变量的时空关系,限制了识别精度。

- DecomposeWHAR模型通过分解和融合策略,分别建模传感器内局部时序特征和传感器间动态空间相关性。

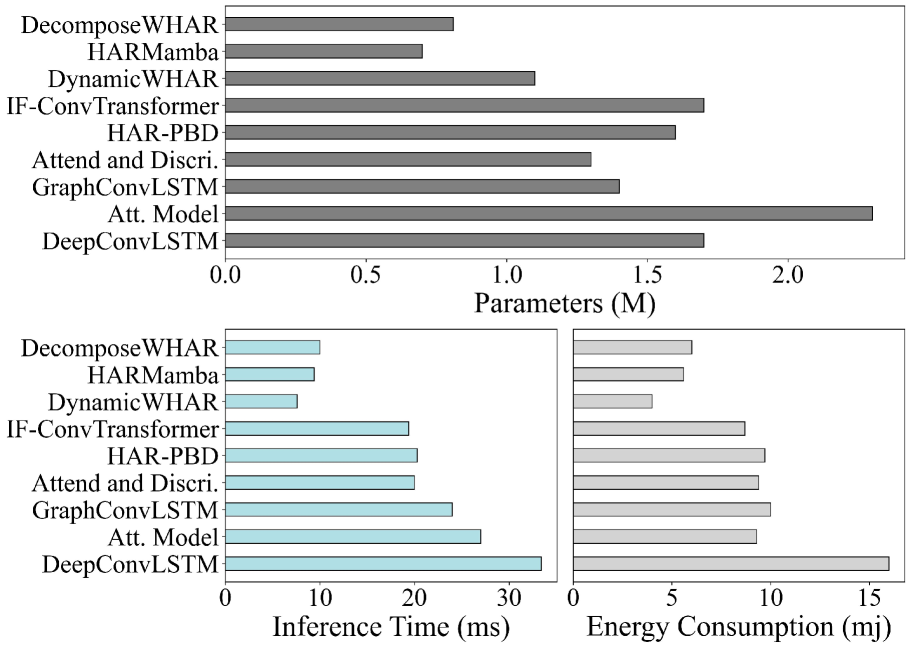

- 实验结果表明,DecomposeWHAR在多个WHAR数据集上显著优于现有方法,同时保持了良好的计算效率。

📝 摘要(中文)

可穿戴人体活动识别(WHAR)是普适计算中的一个重要研究领域。多传感器同步测量已被证明比单传感器更有效。然而,现有的WHAR方法使用共享卷积核对每个传感器变量进行无差别的时序特征提取,无法有效捕获传感器内和传感器间变量的时空关系。我们提出了DecomposeWHAR模型,该模型由分解阶段和融合阶段组成,以更好地建模模态变量之间的关系。分解阶段通过改进的深度可分离卷积创建每个传感器内变量的高维表示,以捕获局部时间特征,同时保留其独特的特征。融合阶段首先捕获传感器内变量之间的关系,并在通道和变量级别融合它们的特征。使用状态空间模型(SSM)对长程时间依赖性进行建模,然后通过自注意力机制动态捕获跨传感器交互,突出传感器间的空间相关性。我们的模型在三个广泛使用的WHAR数据集上表现出卓越的性能,显著优于最先进的模型,同时保持可接受的计算效率。

🔬 方法详解

问题定义:现有可穿戴人体活动识别方法在处理多传感器数据时,通常采用共享卷积核提取时序特征,忽略了不同传感器变量间的差异性以及传感器内和传感器间时空关系的复杂性。这种一视同仁的处理方式限制了模型对关键特征的有效学习,导致识别精度不高。

核心思路:DecomposeWHAR的核心思路是将多传感器数据处理过程分解为两个阶段:分解阶段和融合阶段。分解阶段专注于提取每个传感器内部的时序特征,保留其独特性;融合阶段则侧重于建模传感器间的空间关系,从而更全面地理解人体活动。这种分解-融合的策略旨在更有效地利用多传感器数据中的信息。

技术框架:DecomposeWHAR模型主要包含两个阶段:分解阶段和融合阶段。在分解阶段,模型使用改进的深度可分离卷积对每个传感器变量进行高维表示,提取局部时序特征。在融合阶段,首先捕获传感器内变量之间的关系,并在通道和变量级别进行特征融合。然后,使用状态空间模型(SSM)建模长程时序依赖,最后通过自注意力机制动态捕获跨传感器交互,突出传感器间的空间相关性。

关键创新:DecomposeWHAR的关键创新在于其分解-融合的框架,以及针对传感器内和传感器间关系的不同建模方法。与传统方法直接使用共享卷积核提取特征不同,DecomposeWHAR首先分解每个传感器的特征,然后通过融合机制将这些特征结合起来,从而更好地捕捉多传感器数据的复杂性。此外,利用SSM建模长程时序依赖,并使用自注意力机制动态捕捉跨传感器交互,也是重要的创新点。

关键设计:在分解阶段,使用了改进的深度可分离卷积,以减少计算量并保留每个传感器的独特性。在融合阶段,使用了通道和变量级别的特征融合,以更全面地利用传感器内信息。状态空间模型(SSM)用于建模长程时序依赖,自注意力机制用于动态捕捉跨传感器交互。具体的参数设置和损失函数细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

DecomposeWHAR模型在三个广泛使用的WHAR数据集上取得了显著的性能提升,超越了当前最先进的模型。具体性能数据和提升幅度在论文中进行了详细展示(未知)。该模型在保持较高识别精度的同时,也具有可接受的计算效率,使其更具实用价值。

🎯 应用场景

DecomposeWHAR模型可应用于各种需要高精度人体活动识别的场景,例如智能家居、运动健康监测、老年人跌倒检测、康复训练等。通过准确识别用户的活动状态,可以为用户提供个性化的服务和支持,提高生活质量和安全性。未来,该模型还可以扩展到其他多模态传感器数据融合的应用中。

📄 摘要(原文)

Wearable Human Activity Recognition (WHAR) is a prominent research area within ubiquitous computing. Multi-sensor synchronous measurement has proven to be more effective for WHAR than using a single sensor. However, existing WHAR methods use shared convolutional kernels for indiscriminate temporal feature extraction across each sensor variable, which fails to effectively capture spatio-temporal relationships of intra-sensor and inter-sensor variables. We propose the DecomposeWHAR model consisting of a decomposition phase and a fusion phase to better model the relationships between modality variables. The decomposition creates high-dimensional representations of each intra-sensor variable through the improved Depth Separable Convolution to capture local temporal features while preserving their unique characteristics. The fusion phase begins by capturing relationships between intra-sensor variables and fusing their features at both the channel and variable levels. Long-range temporal dependencies are modeled using the State Space Model (SSM), and later cross-sensor interactions are dynamically captured through a self-attention mechanism, highlighting inter-sensor spatial correlations. Our model demonstrates superior performance on three widely used WHAR datasets, significantly outperforming state-of-the-art models while maintaining acceptable computational efficiency.