Lost in Translation, Found in Context: Sign Language Translation with Contextual Cues

作者: Youngjoon Jang, Haran Raajesh, Liliane Momeni, Gül Varol, Andrew Zisserman

分类: cs.CV

发布日期: 2025-01-16 (更新: 2025-03-29)

备注: CVPR 2025 Camera Ready, Project page: https://www.robots.ox.ac.uk/~vgg/research/litfic/

💡 一句话要点

提出结合上下文线索的手语翻译框架,提升翻译准确性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 手语翻译 上下文建模 大型语言模型 多模态融合 自然语言处理

📋 核心要点

- 现有手语翻译方法忽略了上下文信息,导致翻译准确性受限,难以达到人类翻译水平。

- 提出一种结合视觉特征和上下文线索的手语翻译框架,利用大型语言模型生成更准确的口语翻译。

- 在BOBSL和How2Sign数据集上验证,显著提升了翻译质量,并优于现有方法。

📝 摘要(中文)

本文旨在将连续手语翻译成口语文本。受人类译员依赖上下文进行准确翻译的启发,我们将额外的上下文线索与手语视频结合,融入到一个新的翻译框架中。具体来说,除了编码输入视频的视觉手语识别特征外,我们还整合了来自以下方面的补充文本信息:(i)描述背景节目的字幕,(ii)先前句子的翻译,以及(iii)转录手语的伪词汇。这些信息被自动提取,并与视觉特征一起输入到预训练的大型语言模型(LLM)中,我们对该模型进行微调,以生成文本形式的口语翻译。通过广泛的消融研究,我们展示了每个输入线索对翻译性能的积极贡献。我们在BOBSL(目前可用的最大的英国手语数据集)上训练和评估了我们的方法。结果表明,与先前在BOBSL上报告的结果以及我们作为基线实施的最新方法相比,我们的上下文方法显著提高了翻译质量。此外,我们还通过将其应用于美国手语数据集How2Sign,证明了我们方法的通用性,并取得了具有竞争力的结果。

🔬 方法详解

问题定义:现有手语翻译系统主要依赖视觉信息,忽略了上下文语境,导致翻译结果不够准确自然。人类译员在翻译时会充分利用上下文信息,例如背景描述、之前的对话内容等。因此,如何将上下文信息融入到手语翻译系统中,是提升翻译质量的关键挑战。

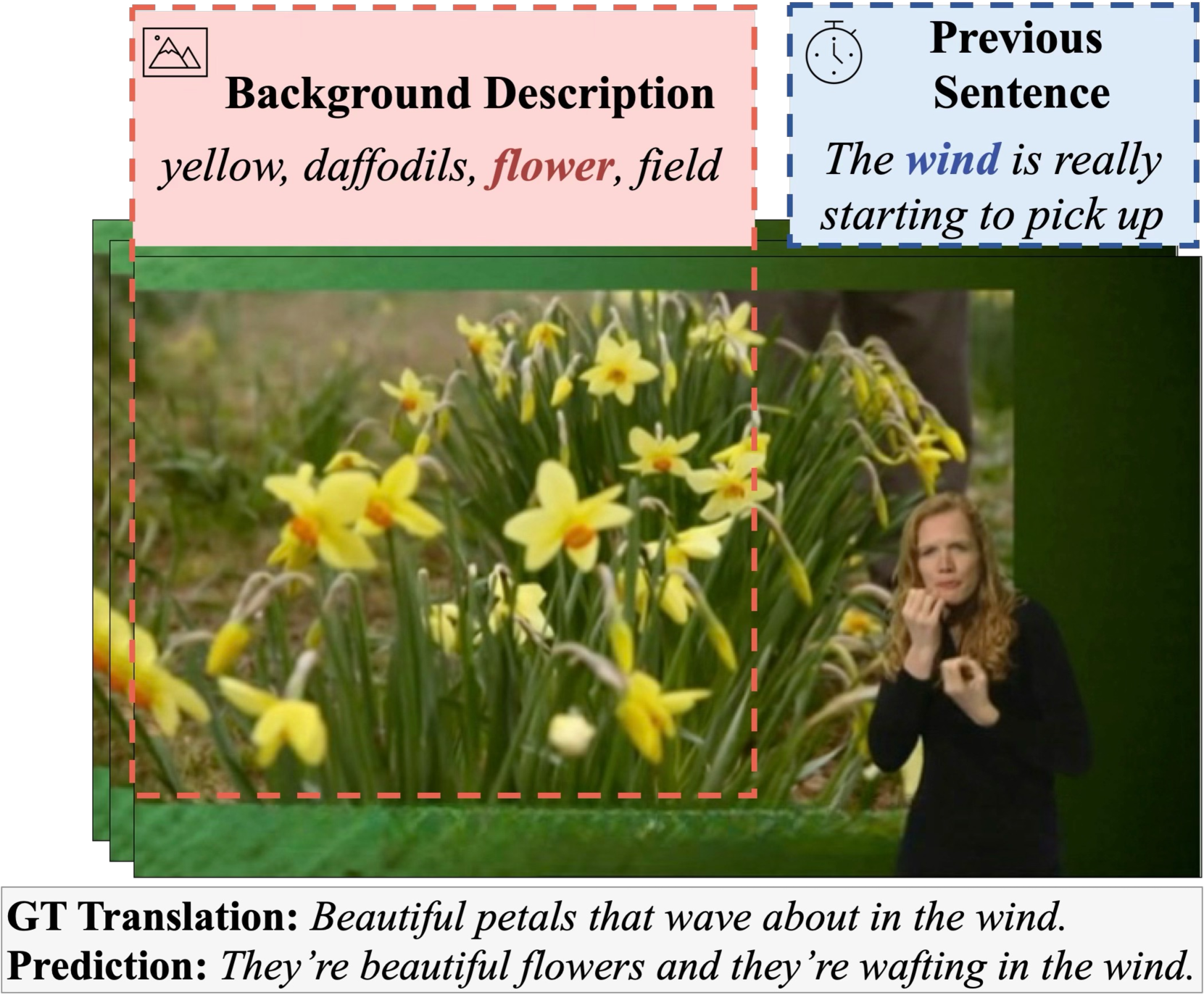

核心思路:本文的核心思路是模仿人类译员的工作方式,将多种上下文信息(如背景字幕、前文翻译、伪词汇)与视觉特征相结合,输入到大型语言模型中,利用其强大的语言建模能力,生成更准确的口语翻译。这种方法旨在弥补传统手语翻译系统对上下文理解的不足。

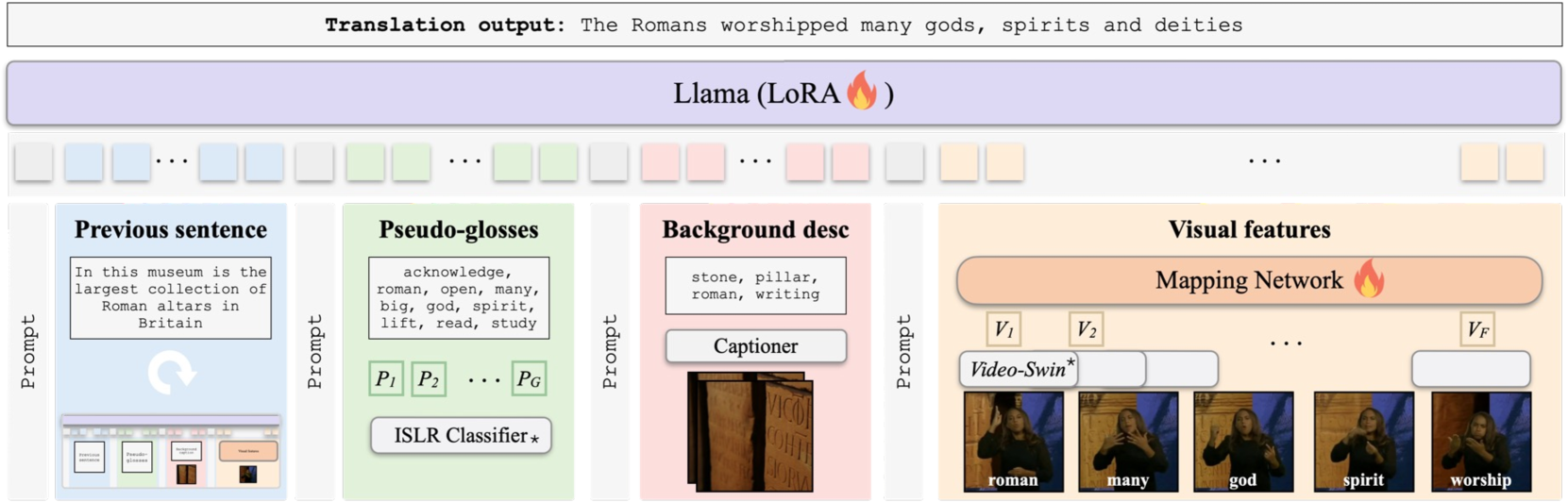

技术框架:该框架包含以下主要模块:1) 视觉特征提取:从手语视频中提取视觉特征,用于识别手语动作。2) 上下文信息提取:自动提取背景字幕、前文翻译和伪词汇等上下文信息。3) 特征融合:将视觉特征和上下文信息进行融合。4) 大型语言模型(LLM):将融合后的特征输入到预训练的LLM中,并进行微调,以生成口语翻译。整体流程是先提取多模态特征,然后通过LLM进行翻译。

关键创新:该方法最重要的创新点在于将多种上下文信息融入到手语翻译过程中,并利用大型语言模型进行翻译。与传统方法相比,该方法能够更好地理解手语的含义,并生成更准确自然的口语翻译。此外,自动提取上下文信息也减少了人工干预。

关键设计:关键设计包括:1) 上下文信息的选择:选择了背景字幕、前文翻译和伪词汇等对翻译有重要影响的上下文信息。2) 特征融合方式:采用了合适的特征融合方法,将视觉特征和上下文信息有效地结合起来。3) 大型语言模型的选择和微调:选择了合适的预训练LLM,并针对手语翻译任务进行了微调。具体的参数设置和网络结构细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

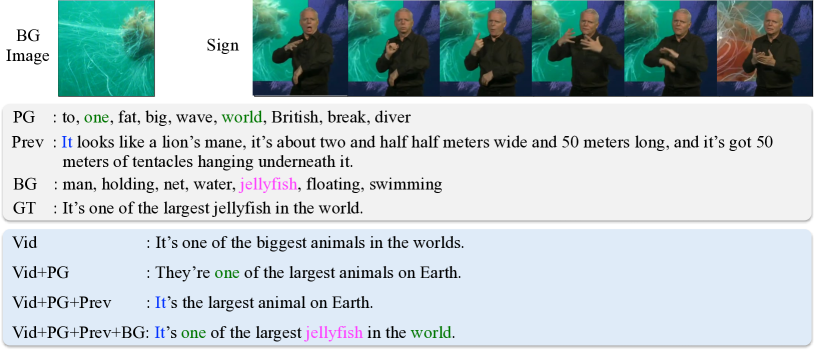

📊 实验亮点

实验结果表明,该方法在BOBSL数据集上显著优于之前的最佳结果和基线方法。通过消融实验,验证了每种上下文线索对翻译性能的积极贡献。此外,该方法在How2Sign数据集上也取得了具有竞争力的结果,证明了其通用性。具体的性能提升数据需要在论文中查找(未知)。

🎯 应用场景

该研究成果可应用于多种场景,例如:为听障人士提供实时手语翻译服务,辅助手语教学,以及开发智能手语翻译设备。该技术有助于消除听障人士与健听人士之间的沟通障碍,促进社会融合,并具有广阔的应用前景。

📄 摘要(原文)

Our objective is to translate continuous sign language into spoken language text. Inspired by the way human interpreters rely on context for accurate translation, we incorporate additional contextual cues together with the signing video, into a new translation framework. Specifically, besides visual sign recognition features that encode the input video, we integrate complementary textual information from (i) captions describing the background show, (ii) translation of previous sentences, as well as (iii) pseudo-glosses transcribing the signing. These are automatically extracted and inputted along with the visual features to a pre-trained large language model (LLM), which we fine-tune to generate spoken language translations in text form. Through extensive ablation studies, we show the positive contribution of each input cue to the translation performance. We train and evaluate our approach on BOBSL -- the largest British Sign Language dataset currently available. We show that our contextual approach significantly enhances the quality of the translations compared to previously reported results on BOBSL, and also to state-of-the-art methods that we implement as baselines. Furthermore, we demonstrate the generality of our approach by applying it also to How2Sign, an American Sign Language dataset, and achieve competitive results.