VanGogh: A Unified Multimodal Diffusion-based Framework for Video Colorization

作者: Zixun Fang, Zhiheng Liu, Kai Zhu, Yu Liu, Ka Leong Cheng, Wei Zhai, Yang Cao, Zheng-Jun Zha

分类: cs.CV

发布日期: 2025-01-16

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

VanGogh:一种用于视频着色的统一多模态扩散框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频着色 多模态融合 扩散模型 深度引导 时间一致性 光流损失 Qformer

📋 核心要点

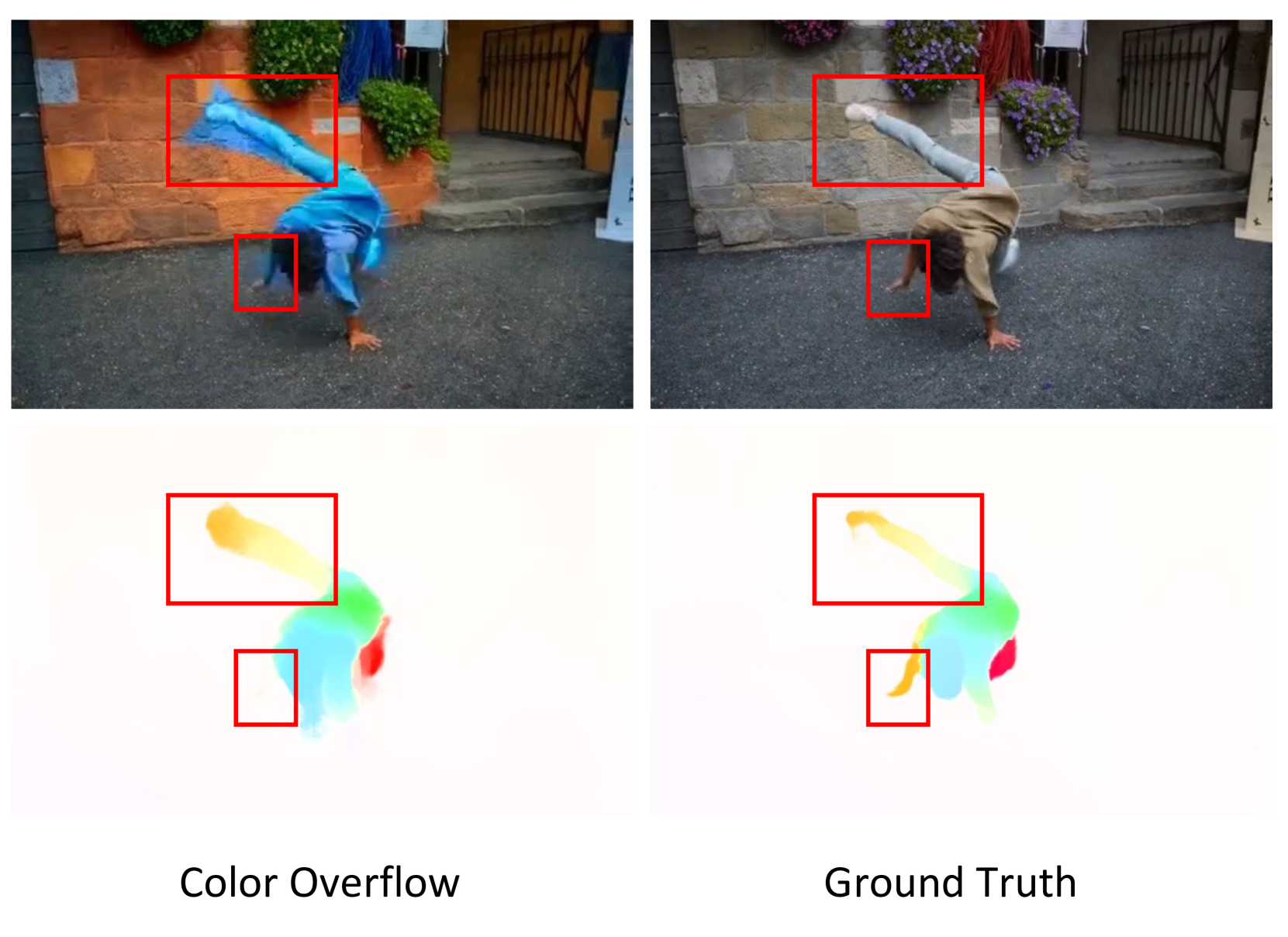

- 现有视频着色方法在处理复杂运动和语义时,容易出现颜色溢出和缺乏控制的问题。

- VanGogh框架通过双Qformer融合多模态特征,并结合深度引导和光流损失,提升着色效果。

- 实验结果表明,VanGogh在时间一致性和色彩保真度方面优于现有方法,并支持用户控制。

📝 摘要(中文)

本文提出了一种名为VanGogh的统一多模态扩散框架,用于解决视频着色问题。现有方法在复杂运动或多样语义线索下,常出现颜色溢出和缺乏全面控制的问题。VanGogh利用双Qformer对齐和融合来自多个模态的特征,并结合深度引导的生成过程和光流损失,以减少颜色溢出。此外,还采用了颜色注入策略和亮度通道替换来提高泛化能力并减轻闪烁伪影。该设计使得用户可以对生成过程进行全局和局部控制,从而生成更高质量的彩色视频。大量的定性和定量评估以及用户研究表明,VanGogh实现了卓越的时间一致性和色彩保真度。

🔬 方法详解

问题定义:视频着色的目标是将灰度视频转换为生动的彩色视频,同时保持时间一致性和结构完整性。现有方法在处理复杂运动或多样语义信息时,容易出现颜色溢出,并且缺乏对着色过程的全面控制,导致着色效果不佳。

核心思路:VanGogh的核心思路是利用多模态信息(如深度信息和光流信息)来引导扩散模型进行视频着色。通过融合不同模态的特征,可以更准确地理解视频内容,从而生成更逼真、时间一致性更好的彩色视频。此外,该方法还允许用户对生成过程进行全局和局部控制,以满足不同的着色需求。

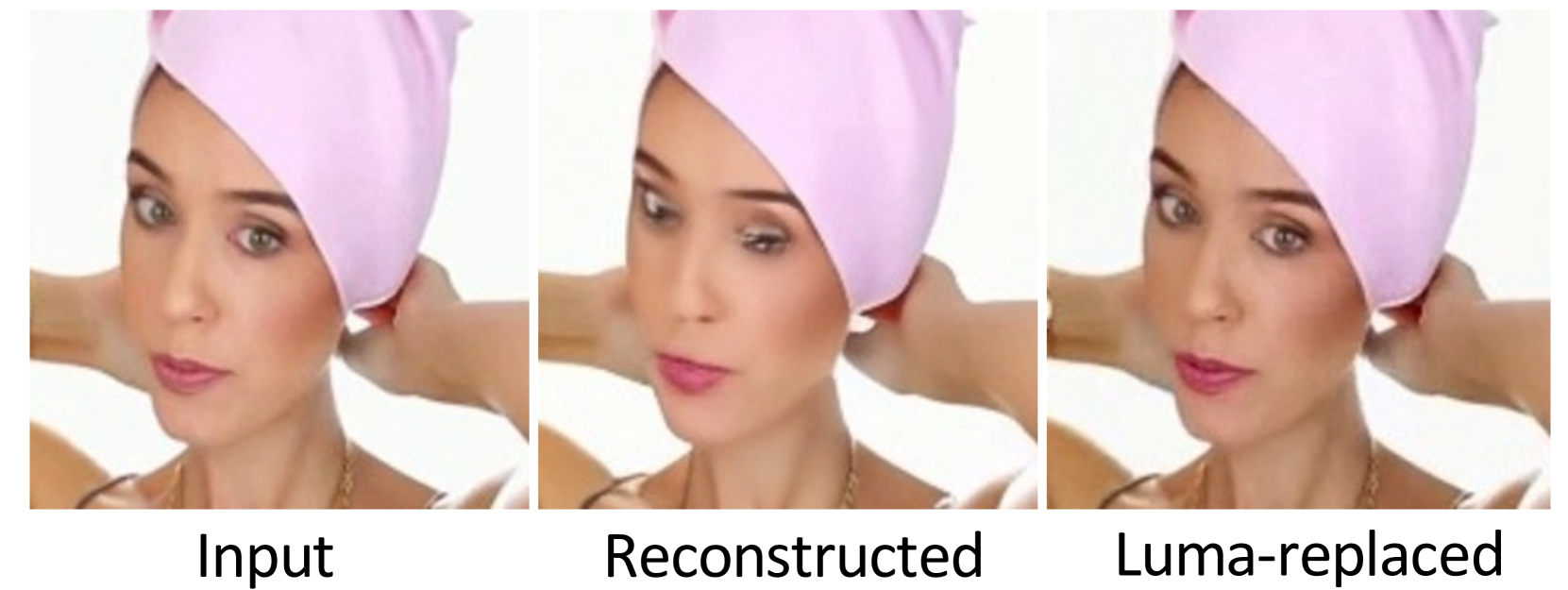

技术框架:VanGogh框架主要包含以下几个模块:1) 双Qformer:用于对齐和融合来自多个模态(如灰度视频、深度图、光流)的特征。2) 扩散模型:用于生成彩色视频,以灰度视频和融合后的多模态特征作为条件。3) 深度引导生成:利用深度信息引导扩散模型的生成过程,以减少颜色溢出。4) 光流损失:用于约束生成视频的时间一致性。5) 颜色注入策略和亮度通道替换:用于提高泛化能力并减轻闪烁伪影。

关键创新:VanGogh的关键创新在于:1) 提出了一个统一的多模态扩散框架,可以有效地融合来自多个模态的信息。2) 引入了深度引导的生成过程和光流损失,以提高着色质量和时间一致性。3) 提出了颜色注入策略和亮度通道替换,以提高泛化能力并减轻闪烁伪影。与现有方法相比,VanGogh能够生成更高质量、时间一致性更好的彩色视频,并且允许用户进行全局和局部控制。

关键设计:双Qformer的具体结构未知,但其作用是提取和对齐多模态特征。深度引导生成可能涉及将深度信息作为条件输入到扩散模型中,或者使用深度信息来调整扩散模型的采样过程。光流损失的具体形式未知,但其目标是最小化相邻帧之间的颜色差异。颜色注入策略和亮度通道替换的具体实现方式未知,但它们旨在提高泛化能力和减轻闪烁伪影。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VanGogh在时间一致性和色彩保真度方面优于现有方法。定性和定量评估以及用户研究均表明,VanGogh能够生成更高质量的彩色视频,并提供更好的用户体验。具体的性能数据和对比基线未知,但论文强调了其优越性。

🎯 应用场景

VanGogh可应用于老旧电影修复、黑白视频着色、艺术创作等领域。该技术能够将历史影像资料转化为更具吸引力的彩色版本,提升用户观看体验。同时,该框架支持用户控制,为视频着色提供了更大的灵活性,可应用于个性化视频内容创作。

📄 摘要(原文)

Video colorization aims to transform grayscale videos into vivid color representations while maintaining temporal consistency and structural integrity. Existing video colorization methods often suffer from color bleeding and lack comprehensive control, particularly under complex motion or diverse semantic cues. To this end, we introduce VanGogh, a unified multimodal diffusion-based framework for video colorization. VanGogh tackles these challenges using a Dual Qformer to align and fuse features from multiple modalities, complemented by a depth-guided generation process and an optical flow loss, which help reduce color overflow. Additionally, a color injection strategy and luma channel replacement are implemented to improve generalization and mitigate flickering artifacts. Thanks to this design, users can exercise both global and local control over the generation process, resulting in higher-quality colorized videos. Extensive qualitative and quantitative evaluations, and user studies, demonstrate that VanGogh achieves superior temporal consistency and color fidelity.Project page: https://becauseimbatman0.github.io/VanGogh.