Scaling up self-supervised learning for improved surgical foundation models

作者: Tim J. M. Jaspers, Ronald L. P. D. de Jong, Yiping Li, Carolus H. J. Kusters, Franciscus H. A. Bakker, Romy C. van Jaarsveld, Gino M. Kuiper, Richard van Hillegersberg, Jelle P. Ruurda, Willem M. Brinkman, Josien P. W. Pluim, Peter H. N. de With, Marcel Breeuwer, Yasmina Al Khalil, Fons van der Sommen

分类: cs.CV

发布日期: 2025-01-16

期刊: Medical Image Analysis, 2025

DOI: 10.1016/j.media.2025.103873

🔗 代码/项目: GITHUB

💡 一句话要点

提出SurgeNetXL,通过大规模自监督学习显著提升手术计算机视觉的基础模型性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 手术计算机视觉 自监督学习 基础模型 大规模预训练 语义分割 阶段识别 CVS分类

📋 核心要点

- 现有手术计算机视觉应用受限于缺乏大规模预训练的基础模型,导致泛化能力不足。

- 论文提出SurgeNetXL,通过在超大规模手术视频数据集上进行自监督预训练,学习通用的手术视觉特征。

- 实验表明,SurgeNetXL在多个手术任务上显著优于现有模型,尤其在数据稀缺场景下表现更佳。

📝 摘要(中文)

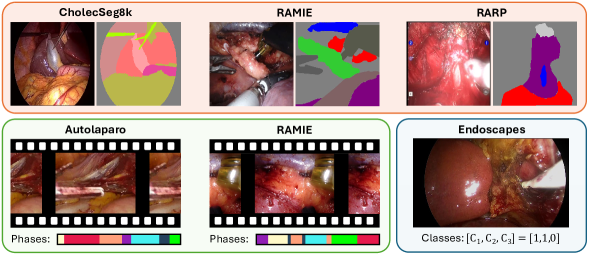

本研究旨在解决手术计算机视觉领域缺乏大规模预训练基础模型的问题。论文提出了SurgeNetXL,这是一个新的手术基础模型,在手术计算机视觉领域树立了新的标杆。SurgeNetXL在迄今为止最大的手术数据集(超过470万帧视频)上进行训练,在涵盖四种手术程序和三个任务(语义分割、阶段识别和CVS分类)的六个数据集上实现了始终如一的顶级性能。与性能最佳的手术基础模型相比,SurgeNetXL在语义分割、阶段识别和CVS分类方面的平均改进分别为2.4%、9.0%和12.6%。此外,在各自的任务中,SurgeNetXL的性能也优于最佳的基于ImageNet的变体,分别提高了14.4%、4.0%和1.6%。本研究还深入探讨了扩展预训练数据集、延长训练时间和优化模型架构等关键问题,为手术计算机视觉领域未来的研究奠定了基础。所有模型和SurgeNetXL数据集的一个子集(包括超过200万帧视频)均已公开。

🔬 方法详解

问题定义:手术计算机视觉领域缺乏像ImageNet那样的大规模预训练模型,导致模型在不同手术类型和任务上的泛化能力受限。现有方法通常依赖于小规模数据集或ImageNet预训练,难以充分利用手术视频中的丰富信息。

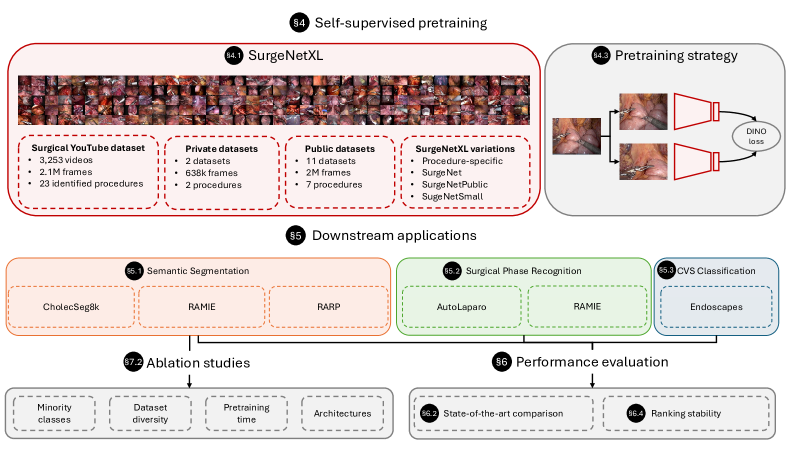

核心思路:论文的核心思路是通过大规模自监督学习,从海量未标注的手术视频数据中学习通用的视觉表征。通过扩展预训练数据集的规模,延长训练时间,并针对手术视频的特点优化模型架构,从而提升模型的性能和泛化能力。

技术框架:SurgeNetXL的整体框架包括数据预处理、自监督预训练和下游任务微调三个主要阶段。首先,对大规模手术视频数据集进行清洗和预处理。然后,采用自监督学习方法(具体方法未知)在预处理后的数据上进行预训练,学习通用的视觉特征。最后,将预训练好的模型在不同的下游任务(如语义分割、阶段识别和CVS分类)上进行微调,以适应特定任务的需求。

关键创新:最重要的技术创新点在于构建了迄今为止最大的手术视频数据集,并成功地利用该数据集训练了一个高性能的手术基础模型。此外,论文还深入探讨了扩展预训练数据集、延长训练时间和优化模型架构等关键问题,为手术计算机视觉领域未来的研究提供了重要的指导。

关键设计:论文中关于自监督学习的具体方法、损失函数、网络结构等技术细节描述不足,属于未知信息。但可以推测,模型架构可能基于Transformer或卷积神经网络,并针对手术视频的特点进行了优化。训练过程中可能采用了数据增强、学习率调整等策略。

🖼️ 关键图片

📊 实验亮点

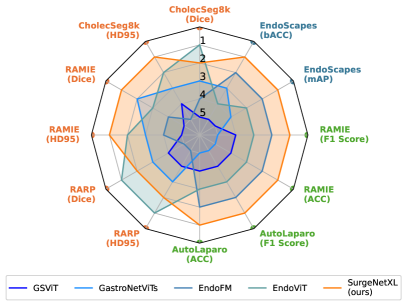

SurgeNetXL在语义分割、阶段识别和CVS分类任务上均取得了显著的性能提升。与最佳手术基础模型相比,平均改进分别为2.4%、9.0%和12.6%。与最佳ImageNet预训练模型相比,在各自任务中分别提高了14.4%、4.0%和1.6%。这些结果表明,大规模自监督预训练能够有效提升手术计算机视觉模型的性能。

🎯 应用场景

SurgeNetXL的潜在应用领域包括手术机器人辅助、术中导航、手术技能评估和培训等。该研究的实际价值在于提高手术的安全性、效率和准确性,并为开发更智能的手术辅助系统奠定基础。未来,SurgeNetXL有望成为手术计算机视觉领域的基础模型,推动该领域的发展。

📄 摘要(原文)

Foundation models have revolutionized computer vision by achieving vastly superior performance across diverse tasks through large-scale pretraining on extensive datasets. However, their application in surgical computer vision has been limited. This study addresses this gap by introducing SurgeNetXL, a novel surgical foundation model that sets a new benchmark in surgical computer vision. Trained on the largest reported surgical dataset to date, comprising over 4.7 million video frames, SurgeNetXL achieves consistent top-tier performance across six datasets spanning four surgical procedures and three tasks, including semantic segmentation, phase recognition, and critical view of safety (CVS) classification. Compared with the best-performing surgical foundation models, SurgeNetXL shows mean improvements of 2.4, 9.0, and 12.6 percent for semantic segmentation, phase recognition, and CVS classification, respectively. Additionally, SurgeNetXL outperforms the best-performing ImageNet-based variants by 14.4, 4.0, and 1.6 percent in the respective tasks. In addition to advancing model performance, this study provides key insights into scaling pretraining datasets, extending training durations, and optimizing model architectures specifically for surgical computer vision. These findings pave the way for improved generalizability and robustness in data-scarce scenarios, offering a comprehensive framework for future research in this domain. All models and a subset of the SurgeNetXL dataset, including over 2 million video frames, are publicly available at: https://github.com/TimJaspers0801/SurgeNet.