Few-Shot Adaptation of Training-Free Foundation Model for 3D Medical Image Segmentation

作者: Xingxin He, Yifan Hu, Zhaoye Zhou, Mohamed Jarraya, Fang Liu

分类: cs.CV

发布日期: 2025-01-15

💡 一句话要点

提出FATE-SAM,实现免训练的3D医学图像分割小样本自适应

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学图像分割 小样本学习 免训练 SAM 3D分割 体积一致性 基础模型

📋 核心要点

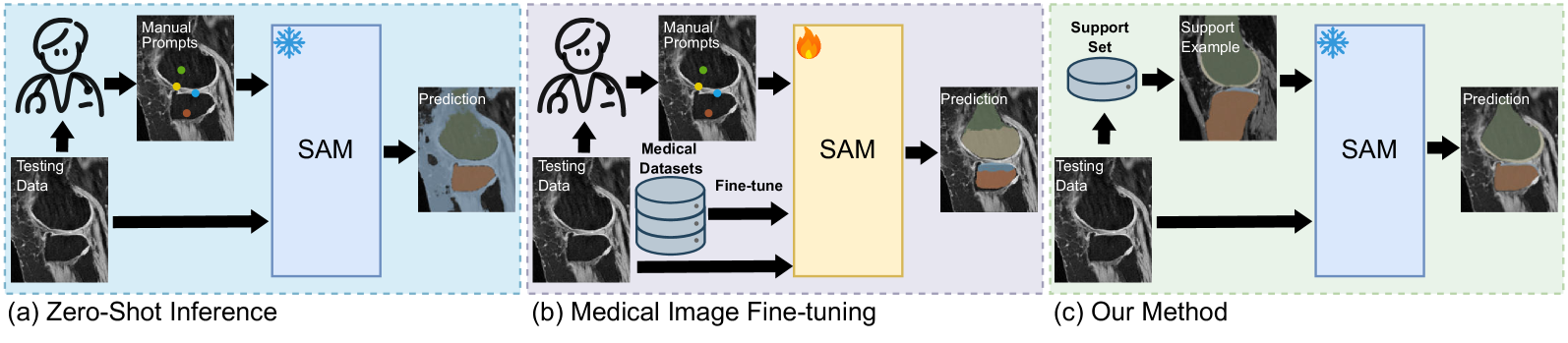

- 现有SAM模型在医学图像分割中面临挑战,主要原因是其在自然图像上训练,缺乏医学领域的专业知识,需要大量标注数据和专家干预。

- FATE-SAM通过重组SAM2的预训练模块,利用少量样本学习解剖知识,实现免提示的小样本自适应分割,无需模型微调。

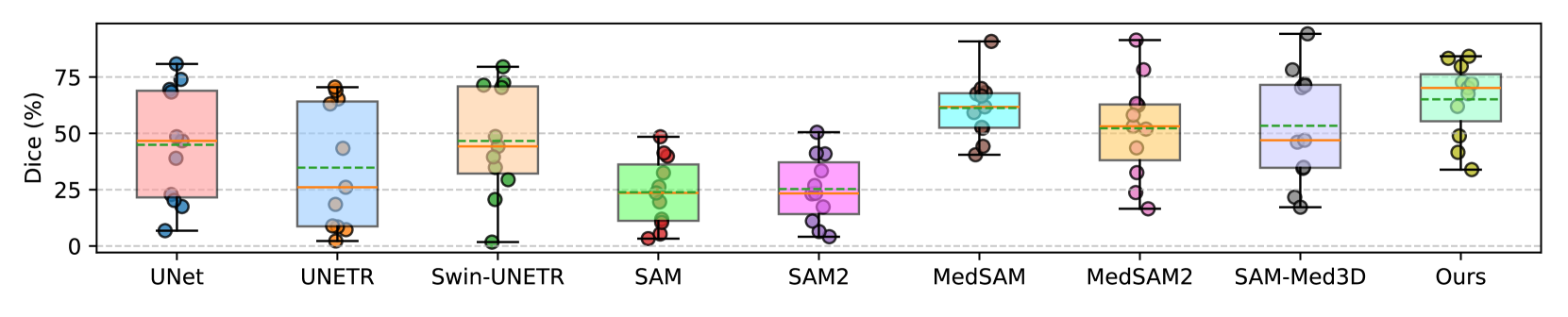

- 实验结果表明,FATE-SAM在多个医学数据集上实现了鲁棒和准确的分割,优于零样本SAM和微调的医学SAM方法,降低了对数据和专家的依赖。

📝 摘要(中文)

视觉基础模型在各种图像分析任务中取得了显著进展。在图像分割任务中,诸如SAM之类的基础模型可以通过用户提供的提示实现通用零样本分割。然而,SAM主要在自然图像上训练,缺乏医学成像的领域专业知识。这给SAM在医学图像分割中的应用带来了挑战,包括需要在专门的医学数据集上进行广泛的微调,以及依赖于手动提示,这两者都需要大量的人工和医学专家的干预。本文介绍了一种免训练SAM的小样本自适应方法(FATE-SAM),该方法旨在使先进的Segment Anything Model 2(SAM2)适应于3D医学图像分割。FATE-SAM重新组合SAM2的预训练模块以实现小样本自适应,利用少量的支持样本来捕获解剖学知识并执行免提示分割,而无需模型微调。为了处理医学图像的体积特性,我们结合了一种体积一致性机制,以增强3D切片之间的空间连贯性。我们在多个医学成像数据集上评估了FATE-SAM,并将其与监督学习方法、零样本SAM方法和微调的医学SAM方法进行了比较。结果表明,FATE-SAM提供了稳健而准确的分割,同时消除了对大型注释数据集和专家干预的需求。FATE-SAM为医学图像分割提供了一种实用、高效的解决方案,使其更易于临床应用。

🔬 方法详解

问题定义:现有方法,特别是直接应用SAM等通用视觉基础模型于3D医学图像分割,面临两个主要痛点。一是领域泛化性不足,SAM在自然图像上训练,对医学图像的解剖结构和成像特点理解不足。二是需要大量的标注数据进行微调,或者依赖人工提示,这两种方式都耗时耗力,且需要医学专家的参与。因此,如何在少量标注数据甚至无需标注的情况下,实现对3D医学图像的精确分割是一个亟待解决的问题。

核心思路:FATE-SAM的核心思路是利用预训练的SAM2模型,通过重组其内部模块,实现对医学图像的小样本自适应。关键在于,避免对整个模型进行微调,而是利用少量支持样本,学习特定解剖结构的特征表示,并将其融入到SAM2的分割流程中。这样既能保留SAM2的通用分割能力,又能使其适应医学图像的特殊性。

技术框架:FATE-SAM的整体框架主要包含以下几个模块:1) 特征提取模块:利用SAM2的图像编码器提取输入图像和少量支持样本的特征。2) 特征融合模块:将支持样本的特征融入到输入图像的特征中,从而使模型能够感知到目标解剖结构的特点。3) 分割模块:利用SAM2的解码器,基于融合后的特征生成分割结果。4) 体积一致性模块:为了保证3D分割结果的空间连贯性,引入体积一致性损失,约束相邻切片的分割结果。

关键创新:FATE-SAM最重要的创新点在于其免训练的小样本自适应能力。与传统的微调方法不同,FATE-SAM无需对整个模型进行训练,而是通过重组预训练模块,实现对特定解剖结构的快速学习。此外,体积一致性模块的引入,有效提升了3D分割结果的空间连贯性,使其更符合医学图像的特点。

关键设计:在特征融合模块中,论文可能采用了注意力机制或者其他特征融合策略,将支持样本的特征有效地融入到输入图像的特征中。体积一致性损失的具体形式可能采用了Dice损失或者交叉熵损失,用于约束相邻切片的分割结果。具体的网络结构和参数设置需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

FATE-SAM在多个医学图像数据集上进行了评估,包括但不限于肝脏、肾脏、肿瘤等。实验结果表明,FATE-SAM在小样本情况下,分割精度显著优于零样本SAM方法,并且与需要大量标注数据训练的监督学习方法相比,性能相当甚至更优。此外,FATE-SAM的推理速度也很快,可以满足临床应用的实时性要求。

🎯 应用场景

FATE-SAM在医学图像分析领域具有广泛的应用前景,例如辅助诊断、手术规划、疗效评估等。它可以用于分割各种器官和病灶,例如肿瘤、血管、神经等。由于其小样本自适应能力,FATE-SAM可以快速应用于新的医学成像模态和解剖结构,降低了对大量标注数据的依赖,使得医学图像分割技术更易于临床应用。

📄 摘要(原文)

Vision foundation models have achieved remarkable progress across various image analysis tasks. In the image segmentation task, foundation models like the Segment Anything Model (SAM) enable generalizable zero-shot segmentation through user-provided prompts. However, SAM primarily trained on natural images, lacks the domain-specific expertise of medical imaging. This limitation poses challenges when applying SAM to medical image segmentation, including the need for extensive fine-tuning on specialized medical datasets and a dependency on manual prompts, which are both labor-intensive and require intervention from medical experts. This work introduces the Few-shot Adaptation of Training-frEe SAM (FATE-SAM), a novel method designed to adapt the advanced Segment Anything Model 2 (SAM2) for 3D medical image segmentation. FATE-SAM reassembles pre-trained modules of SAM2 to enable few-shot adaptation, leveraging a small number of support examples to capture anatomical knowledge and perform prompt-free segmentation, without requiring model fine-tuning. To handle the volumetric nature of medical images, we incorporate a Volumetric Consistency mechanism that enhances spatial coherence across 3D slices. We evaluate FATE-SAM on multiple medical imaging datasets and compare it with supervised learning methods, zero-shot SAM approaches, and fine-tuned medical SAM methods. Results show that FATE-SAM delivers robust and accurate segmentation while eliminating the need for large annotated datasets and expert intervention. FATE-SAM provides a practical, efficient solution for medical image segmentation, making it more accessible for clinical applications.