Computerized Assessment of Motor Imitation for Distinguishing Autism in Video (CAMI-2DNet)

作者: Kaleab A. Kinfu, Carolina Pacheco, Alice D. Sperry, Deana Crocetti, Bahar Tunçgenç, Stewart H. Mostofsky, René Vidal

分类: cs.CV

发布日期: 2025-01-15 (更新: 2025-12-26)

备注: This work has been accepted for publication in IEEE Transactions on Biomedical Engineering

DOI: 10.1109/TBME.2025.3637089

💡 一句话要点

提出CAMI-2DNet,一种基于深度学习的运动模仿评估方法,用于区分自闭症患者。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 自闭症谱系障碍 运动模仿评估 深度学习 编码器-解码器 解耦表示

📋 核心要点

- 传统运动模仿评估方法主观且耗时,依赖人工标注,限制了其可扩展性和客观性。

- CAMI-2DNet利用深度学习的编码器-解码器结构,学习与干扰因素解耦的运动表征,实现自动评估。

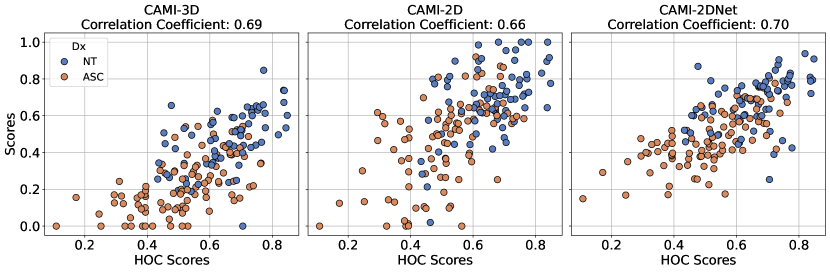

- 实验表明,CAMI-2DNet在区分自闭症儿童和神经典型儿童方面优于CAMI-2D,且与人工评分高度相关。

📝 摘要(中文)

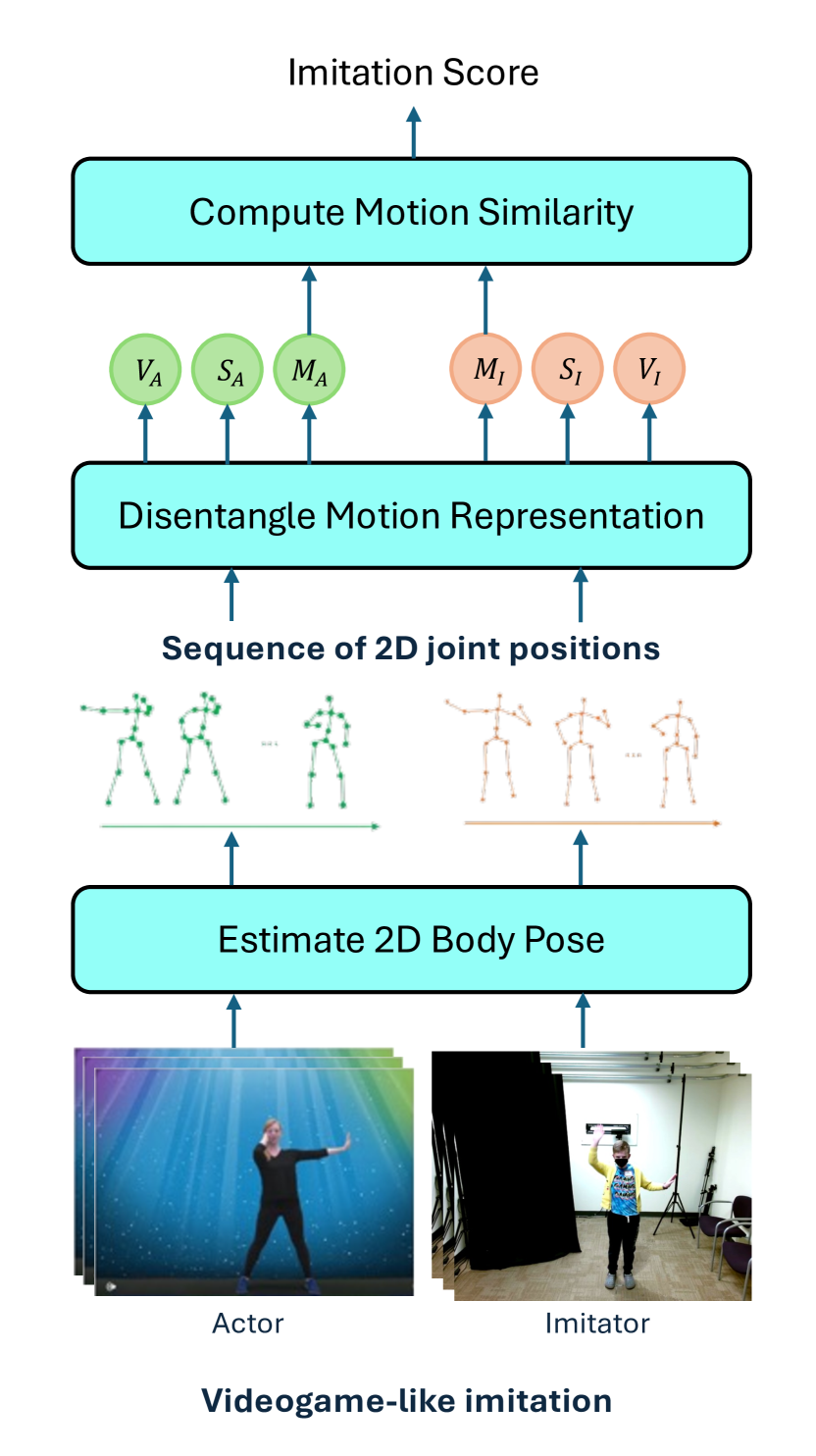

运动模仿障碍在自闭症谱系障碍(ASCs)患者中普遍存在,这表明运动模仿可以作为解决自闭症异质性的一个表型。传统的运动模仿评估方法是主观的、劳动密集型的,并且需要大量的人工训练。现代计算机化运动模仿评估(CAMI)方法,例如用于运动捕捉数据的CAMI-3D和用于视频数据的CAMI-2D,主观性较低。然而,它们依赖于劳动密集型的数据归一化和清洗技术,以及用于算法训练的人工标注。为了解决这些挑战,我们提出CAMI-2DNet,一种可扩展且可解释的基于深度学习的视频数据运动模仿评估方法,它消除了数据归一化、清洗和标注的需要。CAMI-2DNet使用编码器-解码器架构将视频映射到运动编码,该编码与诸如体型和相机视角等干扰因素分离。为了学习解耦表示,我们采用通过虚拟角色运动重定向生成的合成数据,通过重组运动、体型和相机视角,以及真实的参与者数据。为了自动评估个体模仿演员的程度,我们计算他们的运动编码之间的相似性分数,并使用它来区分患有ASCs的个体与神经典型(NT)个体。我们的比较分析表明,CAMI-2DNet与人类评分具有很强的相关性,同时在区分ASCs与NT儿童方面优于CAMI-2D。此外,CAMI-2DNet的性能与CAMI-3D相当,同时通过直接在视频数据上操作,而无需专门的数据归一化和人工标注,提供了更大的实用性。

🔬 方法详解

问题定义:论文旨在解决传统运动模仿评估方法的主观性、劳动密集性和对人工标注的依赖性问题。现有方法,如CAMI-2D,需要耗时的数据归一化和清洗,限制了其在实际应用中的可扩展性。

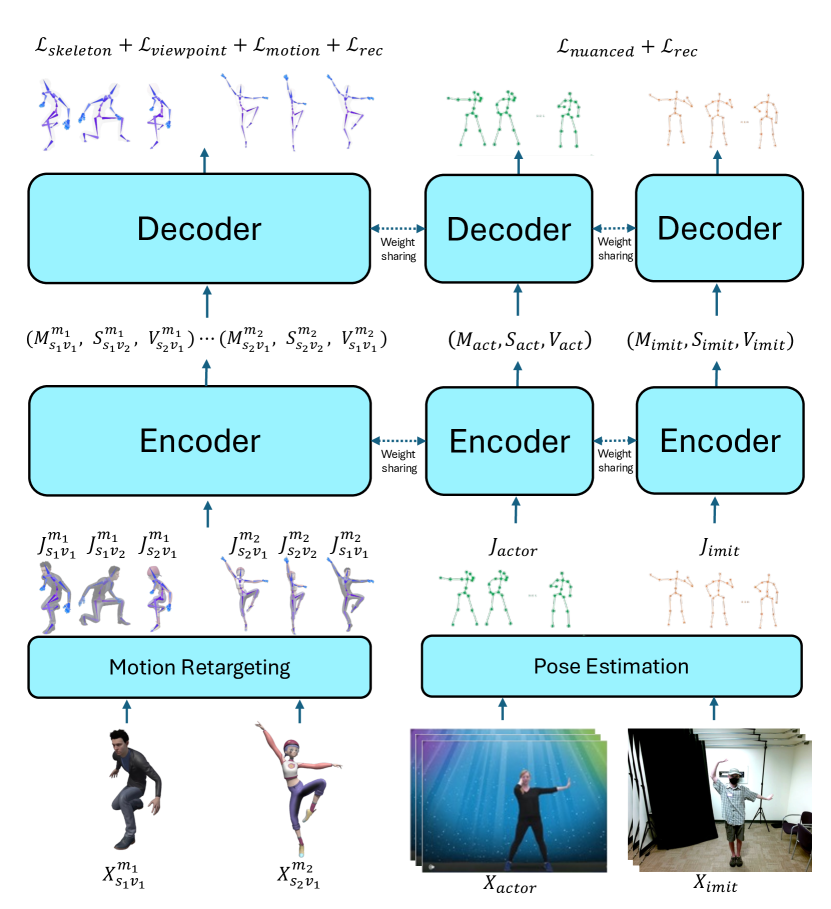

核心思路:论文的核心思路是利用深度学习自动学习运动模仿的表征,并将其与体型、视角等无关因素解耦。通过学习解耦的运动表征,可以更准确地评估个体的模仿能力,并减少对人工标注的依赖。

技术框架:CAMI-2DNet采用编码器-解码器架构。编码器将视频数据映射到运动编码,解码器则从运动编码重建视频。该框架使用合成数据和真实数据进行训练,其中合成数据通过运动重定向生成,用于学习解耦的运动表征。通过计算个体运动编码之间的相似性分数,可以评估其模仿能力。

关键创新:CAMI-2DNet的关键创新在于其能够自动学习与干扰因素解耦的运动表征,从而消除了对数据归一化、清洗和人工标注的需要。与CAMI-2D相比,CAMI-2DNet具有更强的可扩展性和客观性。

关键设计:CAMI-2DNet使用合成数据进行训练,这些数据通过重组运动、体型和相机视角生成,以促进解耦表示的学习。损失函数的设计旨在鼓励运动编码捕获运动信息,同时忽略体型和视角等干扰因素。具体的网络结构和参数设置未知,需要在论文中查找。

🖼️ 关键图片

📊 实验亮点

CAMI-2DNet在区分自闭症儿童和神经典型儿童方面表现出色,与人工评分具有很强的相关性,并且优于CAMI-2D。虽然论文中没有给出具体的性能数据,但强调了CAMI-2DNet在无需人工标注的情况下,性能与CAMI-3D相当,后者依赖于运动捕捉数据,表明CAMI-2DNet具有更高的实用性。

🎯 应用场景

CAMI-2DNet可应用于自闭症谱系障碍的早期诊断和评估,为临床医生提供客观、高效的辅助工具。该方法还可用于运动康复、人机交互等领域,例如评估患者的运动能力或提高机器人的模仿学习能力。未来,该技术有望促进个性化治疗方案的制定和康复效果的提升。

📄 摘要(原文)

Motor imitation impairments are commonly reported in individuals with autism spectrum conditions (ASCs), suggesting that motor imitation could be used as a phenotype for addressing autism heterogeneity. Traditional methods for assessing motor imitation are subjective, labor-intensive, and require extensive human training. Modern Computerized Assessment of Motor Imitation (CAMI) methods, such as CAMI-3D for motion capture data and CAMI-2D for video data, are less subjective. However, they rely on labor-intensive data normalization and cleaning techniques, and human annotations for algorithm training. To address these challenges, we propose CAMI-2DNet, a scalable and interpretable deep learning-based approach to motor imitation assessment in video data, which eliminates the need for data normalization, cleaning and annotation. CAMI-2DNet uses an encoder-decoder architecture to map a video to a motion encoding that is disentangled from nuisance factors such as body shape and camera views. To learn a disentangled representation, we employ synthetic data generated by motion retargeting of virtual characters through the reshuffling of motion, body shape, and camera views, as well as real participant data. To automatically assess how well an individual imitates an actor, we compute a similarity score between their motion encodings, and use it to discriminate individuals with ASCs from neurotypical (NT) individuals. Our comparative analysis demonstrates that CAMI-2DNet has a strong correlation with human scores while outperforming CAMI-2D in discriminating ASC vs NT children. Moreover, CAMI-2DNet performs comparably to CAMI-3D while offering greater practicality by operating directly on video data and without the need for ad-hoc data normalization and human annotations.