LayerAnimate: Layer-level Control for Animation

作者: Yuxue Yang, Lue Fan, Zuzeng Lin, Feng Wang, Zhaoxiang Zhang

分类: cs.CV

发布日期: 2025-01-14 (更新: 2025-03-22)

备注: Project page: https://layeranimate.github.io

💡 一句话要点

LayerAnimate:提出层级控制的视频扩散框架,赋能动画创作。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 动画生成 视频扩散模型 层级控制 图像分割 数据增强

📋 核心要点

- 现有动画生成方法缺乏对动画层级的精细控制,限制了创作的灵活性和可控性。

- LayerAnimate通过层级感知的视频扩散框架,实现对动画层级的独立控制和操作。

- 实验结果表明,LayerAnimate在动画质量、控制精度和用户体验方面均优于现有方法。

📝 摘要(中文)

本文提出LayerAnimate,一种新颖的层级感知的视频扩散框架,旨在通过层级控制实现对动画的精细操作。传统动画制作将视觉元素分解为离散的层,以便独立处理草图、细化、着色和中间帧生成。现有的动画生成视频方法通常将动画视为与真实世界视频不同的数据领域,缺乏层级的精细控制。为了弥合这一差距,LayerAnimate应运而生。由于专业动画资产的商业敏感性,层级感知框架的开发面临着严重的数据稀缺挑战。为了解决这一限制,我们提出了一种数据管理流程,其特点是自动元素分割和基于运动的分层合并。通过定量和定性比较以及用户研究,我们证明LayerAnimate在动画质量、控制精度和可用性方面优于当前方法,使其成为专业动画师和业余爱好者的有效工具。该框架为层级动画应用和创作灵活性开辟了新的可能性。

🔬 方法详解

问题定义:现有动画生成方法通常将动画视为一个整体,缺乏对动画内部各图层的精细控制能力。这使得用户难以对动画的特定部分进行修改和调整,限制了创作的灵活性。此外,专业动画数据具有商业敏感性,难以获取,导致训练数据不足。

核心思路:LayerAnimate的核心思路是构建一个层级感知的视频扩散框架,将动画分解为多个图层,并允许用户对每个图层进行独立控制。通过这种方式,用户可以更灵活地编辑和修改动画,实现更精细的创作。同时,论文提出了一种数据管理流程,以解决数据稀缺问题。

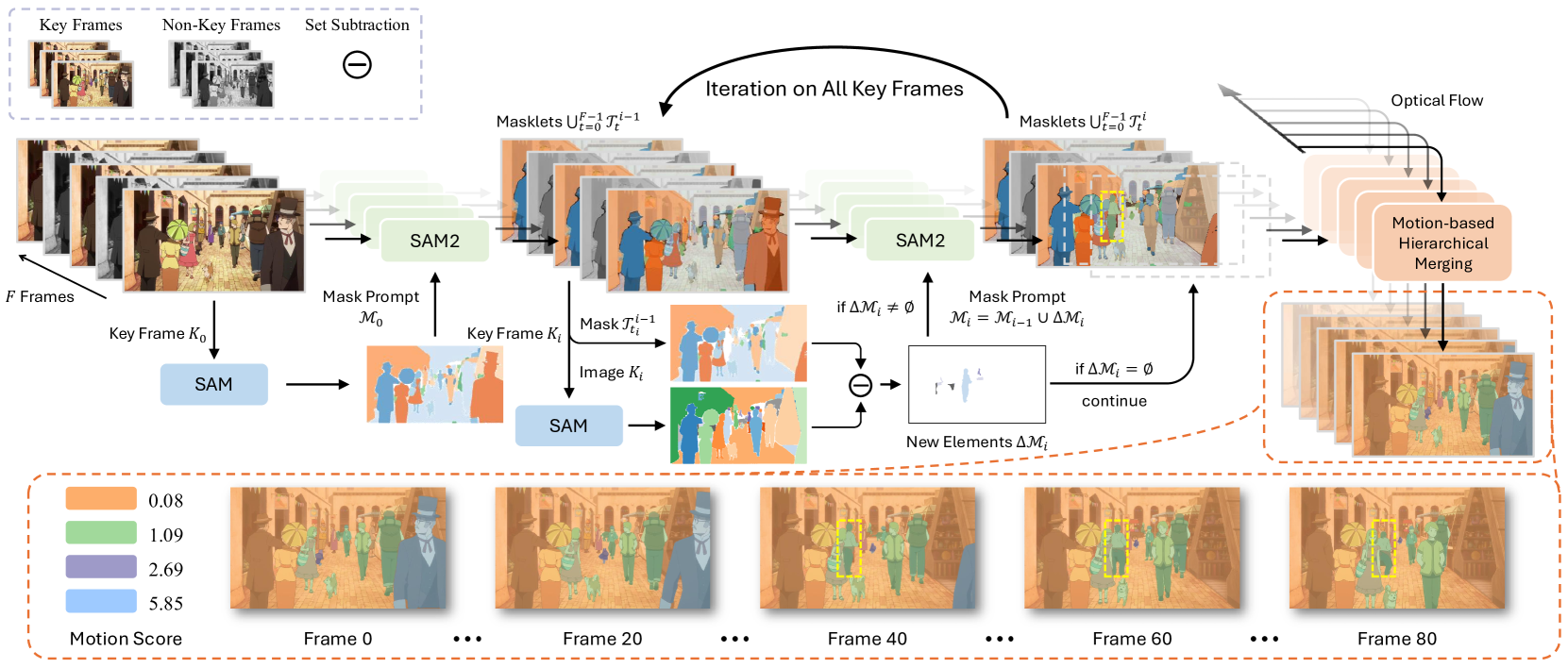

技术框架:LayerAnimate框架包含以下主要模块:1) 层级感知的视频扩散模型:该模型能够生成具有多个图层的动画视频。2) 层级控制接口:用户可以通过该接口对每个图层进行独立控制,例如修改图层的位置、颜色和形状。3) 数据管理流程:该流程包括自动元素分割和基于运动的分层合并,用于生成训练数据。

关键创新:LayerAnimate的关键创新在于其层级感知的视频扩散框架和层级控制接口。该框架能够将动画分解为多个图层,并允许用户对每个图层进行独立控制,从而实现更精细的动画创作。此外,数据管理流程有效缓解了数据稀缺问题。

关键设计:论文中数据管理流程包含自动元素分割和基于运动的分层合并两个步骤。自动元素分割使用预训练的分割模型将视频帧分割成不同的元素。基于运动的分层合并则根据元素的运动相似性将它们合并到不同的图层中。损失函数方面,使用了标准的扩散模型损失函数,并针对层级控制添加了额外的正则化项,以保证图层之间的连贯性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LayerAnimate在动画质量、控制精度和用户体验方面均优于现有方法。具体来说,LayerAnimate生成的动画视频在视觉效果上更逼真,用户可以更精确地控制动画的各个图层,并且用户对LayerAnimate的整体满意度更高。用户研究表明,LayerAnimate显著提升了动画创作的效率和灵活性。

🎯 应用场景

LayerAnimate可应用于动画制作、游戏开发、广告设计等领域。它能够帮助专业动画师更高效地创作高质量的动画作品,同时也为业余爱好者提供了更易于使用的动画创作工具。该研究有望推动动画制作技术的进步,并促进动画产业的发展。

📄 摘要(原文)

Traditional animation production decomposes visual elements into discrete layers to enable independent processing for sketching, refining, coloring, and in-betweening. Existing anime generation video methods typically treat animation as a distinct data domain different from real-world videos, lacking fine-grained control at the layer level. To bridge this gap, we introduce LayerAnimate, a novel video diffusion framework with layer-aware architecture that empowers the manipulation of layers through layer-level controls. The development of a layer-aware framework faces a significant data scarcity challenge due to the commercial sensitivity of professional animation assets. To address the limitation, we propose a data curation pipeline featuring Automated Element Segmentation and Motion-based Hierarchical Merging. Through quantitative and qualitative comparisons, and user study, we demonstrate that LayerAnimate outperforms current methods in terms of animation quality, control precision, and usability, making it an effective tool for both professional animators and amateur enthusiasts. This framework opens up new possibilities for layer-level animation applications and creative flexibility. Our code is available at https://layeranimate.github.io.