SplatMAP: Online Dense Monocular SLAM with 3D Gaussian Splatting

作者: Yue Hu, Rong Liu, Meida Chen, Peter Beerel, Andrew Feng

分类: cs.CV

发布日期: 2025-01-13 (更新: 2025-04-11)

期刊: Proceedings of the ACM SIGGRAPH Symposium on Interactive 3D Graphics and Games (I3D '25) May 2025

DOI: 10.1145/3728310

💡 一句话要点

SplatMAP:结合3D高斯溅射的在线稠密单目SLAM,提升重建质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目SLAM 三维重建 高斯溅射 几何优化 实时渲染

📋 核心要点

- 传统单目SLAM和SfM难以精确捕捉场景细节,NeRF计算成本高,现有3DGS方法忽略了几何精度。

- SplatMAP结合稠密SLAM与3DGS,利用SLAM信息自适应稠密化和几何引导优化,提升重建质量。

- 实验表明,SplatMAP在Replica和TUM-RGBD数据集上均取得了SOTA结果,显著提升了PSNR、SSIM和LPIPS指标。

📝 摘要(中文)

从单目视频中实现高保真3D重建仍然具有挑战性,因为传统方法(如SfM和单目SLAM)在精确捕捉场景细节方面存在固有限制。虽然神经辐射场(NeRF)等可微渲染技术解决了一些挑战,但其高计算成本使其不适合实时应用。此外,现有的3D高斯溅射(3DGS)方法通常侧重于光度一致性,忽略了几何精度,并且未能利用SLAM的动态深度和姿态更新来改进场景。我们提出了一个将稠密SLAM与3DGS集成的框架,用于实时、高保真稠密重建。我们的方法引入了SLAM信息自适应稠密化,通过利用来自SLAM的稠密点云来动态更新和稠密化高斯模型。此外,我们结合了几何引导优化,它结合了边缘感知几何约束和光度一致性,以共同优化3DGS场景表示的外观和几何形状,从而实现详细而准确的SLAM映射重建。在Replica和TUM-RGBD数据集上的实验证明了我们方法的有效性,在单目系统中取得了最先进的结果。

🔬 方法详解

问题定义:论文旨在解决单目视频稠密三维重建中,现有方法难以兼顾重建质量、计算效率和几何精度的难题。传统方法如SfM和SLAM在细节捕捉上存在不足,而NeRF虽然能实现高保真重建,但计算量巨大,难以实时应用。现有的3DGS方法虽然效率较高,但往往只关注光度一致性,忽略了几何精度,导致重建结果不够准确。

核心思路:论文的核心思路是将稠密SLAM与3DGS相结合,利用SLAM提供的深度和姿态信息来指导3DGS的优化和稠密化,从而在保证重建质量的同时,提高计算效率和几何精度。通过SLAM提供初始几何信息,并利用几何约束和光度一致性联合优化3DGS,实现更准确的场景重建。

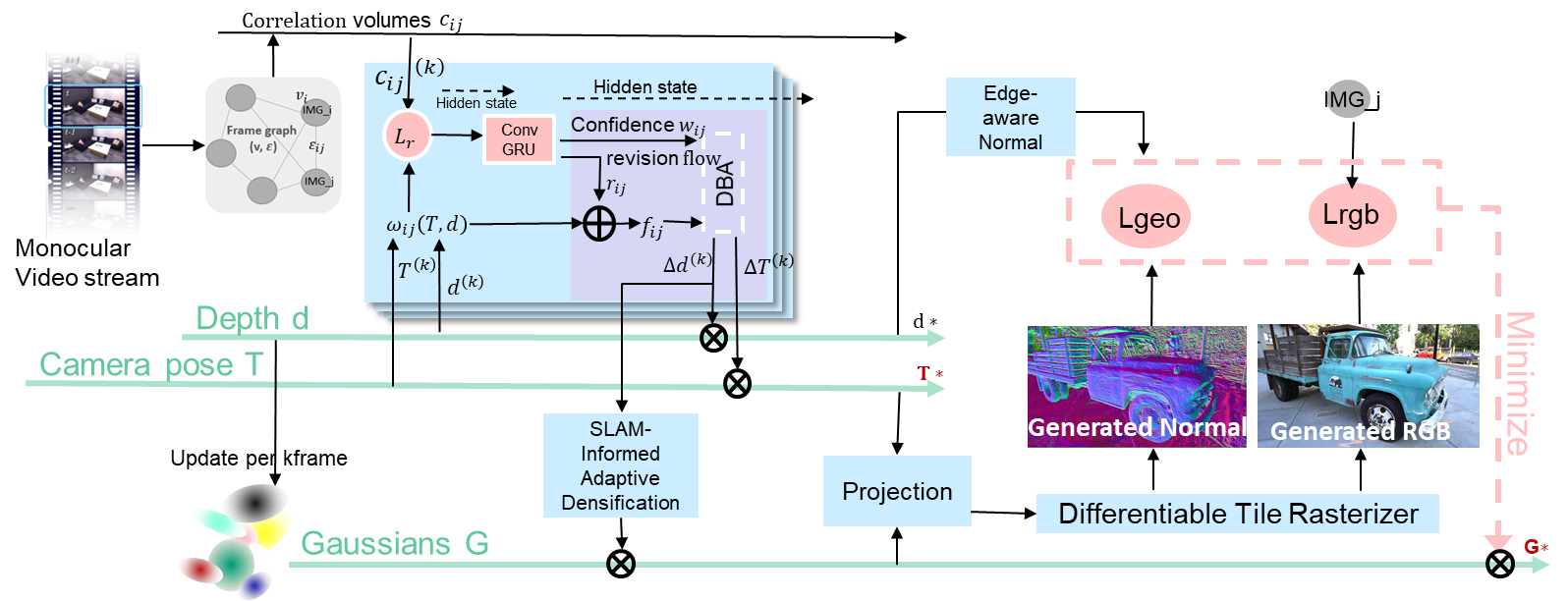

技术框架:SplatMAP框架主要包含两个关键模块:SLAM信息自适应稠密化和几何引导优化。首先,利用稠密SLAM生成初始点云,并将其转换为3DGS表示。然后,通过SLAM信息自适应稠密化模块,根据SLAM提供的深度信息动态更新和稠密化高斯模型。最后,通过几何引导优化模块,结合边缘感知几何约束和光度一致性,联合优化高斯模型的参数,包括位置、颜色、方差等。

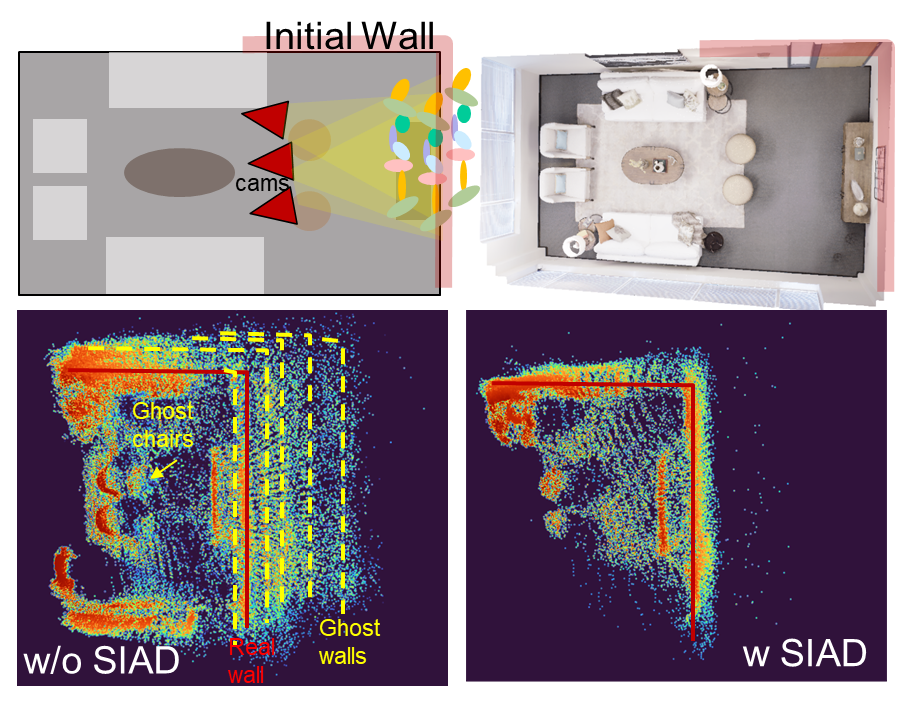

关键创新:论文的关键创新在于将SLAM的几何信息融入到3DGS的优化过程中。传统的3DGS方法主要依赖于光度一致性进行优化,容易陷入局部最优。而SplatMAP通过引入SLAM提供的深度信息和几何约束,可以更好地指导3DGS的优化,从而提高重建的几何精度。此外,SLAM信息自适应稠密化模块可以根据SLAM提供的深度信息动态调整高斯模型的密度,从而在保证重建质量的同时,减少计算量。

关键设计:SLAM信息自适应稠密化模块的关键设计在于如何根据SLAM提供的深度信息来确定高斯模型的密度。论文采用了一种基于深度误差的自适应策略,即在深度误差较大的区域增加高斯模型的密度,而在深度误差较小的区域减少高斯模型的密度。几何引导优化模块的关键设计在于如何平衡几何约束和光度一致性。论文采用了一种加权损失函数,其中几何约束的权重根据边缘信息进行调整,从而在边缘区域更加重视几何约束,而在平滑区域更加重视光度一致性。

🖼️ 关键图片

📊 实验亮点

SplatMAP在Replica数据集上取得了PSNR 36.864,SSIM 0.985,LPIPS 0.040的成绩,相比之前的SOTA方法分别提升了10.7%、6.4%和49.4%。在TUM-RGBD数据集上,SplatMAP也超越了最接近的基线方法,在PSNR、SSIM和LPIPS指标上分别提升了10.2%、6.6%和34.7%。这些结果表明SplatMAP在单目稠密三维重建方面具有显著优势。

🎯 应用场景

SplatMAP在机器人导航、增强现实、虚拟现实、三维地图构建等领域具有广泛的应用前景。它可以用于构建高精度、实时的三维场景模型,为机器人提供更准确的环境感知,为AR/VR应用提供更逼真的沉浸式体验,并为三维地图构建提供更高效的解决方案。该研究的突破将推动单目视觉在复杂环境下的应用。

📄 摘要(原文)

Achieving high-fidelity 3D reconstruction from monocular video remains challenging due to the inherent limitations of traditional methods like Structure-from-Motion (SfM) and monocular SLAM in accurately capturing scene details. While differentiable rendering techniques such as Neural Radiance Fields (NeRF) address some of these challenges, their high computational costs make them unsuitable for real-time applications. Additionally, existing 3D Gaussian Splatting (3DGS) methods often focus on photometric consistency, neglecting geometric accuracy and failing to exploit SLAM's dynamic depth and pose updates for scene refinement. We propose a framework integrating dense SLAM with 3DGS for real-time, high-fidelity dense reconstruction. Our approach introduces SLAM-Informed Adaptive Densification, which dynamically updates and densifies the Gaussian model by leveraging dense point clouds from SLAM. Additionally, we incorporate Geometry-Guided Optimization, which combines edge-aware geometric constraints and photometric consistency to jointly optimize the appearance and geometry of the 3DGS scene representation, enabling detailed and accurate SLAM mapping reconstruction. Experiments on the Replica and TUM-RGBD datasets demonstrate the effectiveness of our approach, achieving state-of-the-art results among monocular systems. Specifically, our method achieves a PSNR of 36.864, SSIM of 0.985, and LPIPS of 0.040 on Replica, representing improvements of 10.7%, 6.4%, and 49.4%, respectively, over the previous SOTA. On TUM-RGBD, our method outperforms the closest baseline by 10.2%, 6.6%, and 34.7% in the same metrics. These results highlight the potential of our framework in bridging the gap between photometric and geometric dense 3D scene representations, paving the way for practical and efficient monocular dense reconstruction.