BRIGHT: A globally distributed multimodal building damage assessment dataset with very-high-resolution for all-weather disaster response

作者: Hongruixuan Chen, Jian Song, Olivier Dietrich, Clifford Broni-Bediako, Weihao Xuan, Junjue Wang, Xinlei Shao, Yimin Wei, Junshi Xia, Cuiling Lan, Konrad Schindler, Naoto Yokoya

分类: cs.CV, cs.AI, eess.IV, eess.SP

发布日期: 2025-01-10 (更新: 2025-10-09)

🔗 代码/项目: GITHUB

💡 一句话要点

提出BRIGHT多模态建筑损伤评估数据集,用于全天候灾害响应AI模型训练。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 建筑损伤评估 多模态遥感 SAR影像 光学影像 灾害响应 深度学习 数据集 全天候

📋 核心要点

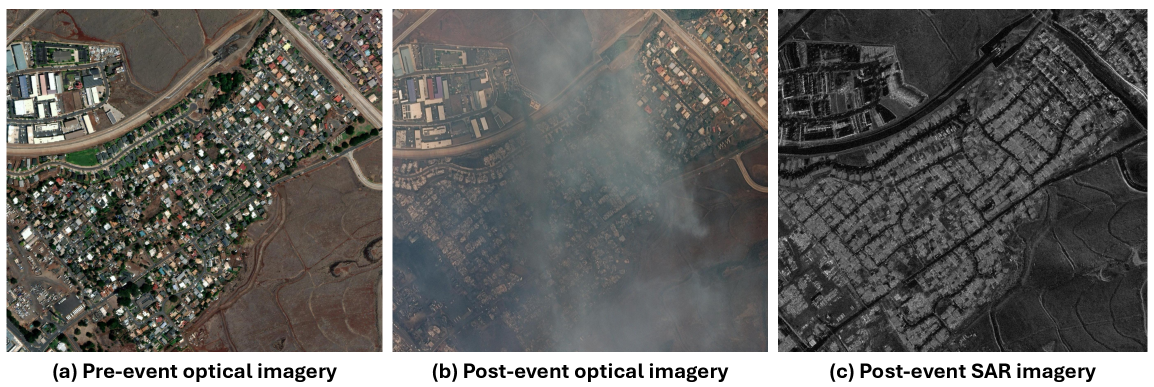

- 现有建筑损伤评估方法依赖光学遥感数据,受限于天气和光照条件,无法实现全天候快速响应。

- BRIGHT数据集结合光学和SAR影像,覆盖多种灾害类型和全球区域,旨在促进全天候灾害响应AI模型的发展。

- 实验验证了基于BRIGHT数据集训练的AI模型具有良好的可迁移性和鲁棒性,为灾害响应提供了有力支持。

📝 摘要(中文)

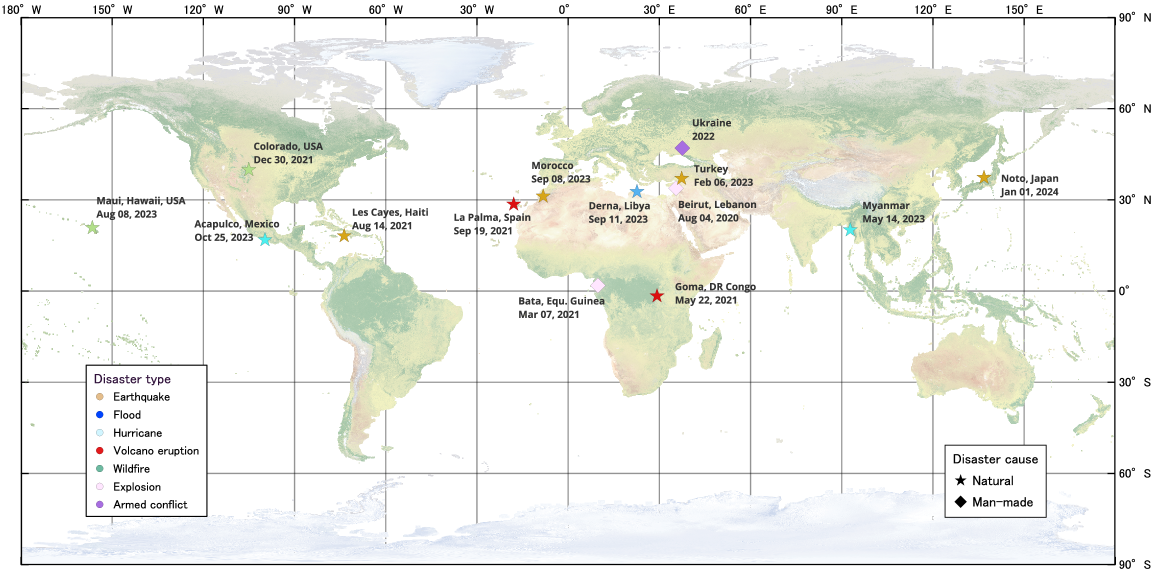

灾害事件频繁发生,对人类生命和财产造成重大损失。地球观测(EO)数据能够快速全面地进行建筑损伤评估(BDA),这对于灾后减少伤亡和指导救援工作至关重要。目前的研究主要集中在使用光学EO数据开发AI模型,以实现对未见过的灾害事件的精确映射。然而,基于光学数据的解决方案受到晴朗天气和日照时间的限制,阻碍了对灾害的及时响应。集成多模态(MM)EO数据,特别是光学和SAR图像的结合,可以实现全天候、昼夜灾害响应。尽管有这种潜力,但由于缺乏合适的基准数据集,鲁棒的多模态AI模型的开发受到了限制。本文提出了一个使用甚高分辨率光学和SAR图像的BDA数据集(BRIGHT),以支持基于AI的全天候灾害响应。据我们所知,BRIGHT是第一个开放获取、全球分布、事件多样的MM数据集,专门用于支持基于AI的灾害响应。它涵盖了全球14个地区的五种自然灾害和两种人为灾害,特别关注最需要外部援助的发展中国家。BRIGHT中的光学和SAR图像的空间分辨率在0.3-1米之间,提供了单个建筑物的详细表示,使其成为精确BDA的理想选择。在我们的实验中,我们测试了七个使用BRIGHT训练的先进AI模型,以验证其可迁移性和鲁棒性。数据集和代码可在https://github.com/ChenHongruixuan/BRIGHT获得。BRIGHT也是2025年IEEE GRSS数据融合竞赛的官方数据集。

🔬 方法详解

问题定义:现有建筑损伤评估方法主要依赖光学遥感数据,但光学数据易受天气条件(如云层覆盖)和光照条件的影响,导致无法在全天候条件下快速、准确地进行灾害评估。这阻碍了灾害发生后的及时响应和救援工作。因此,需要一种能够克服这些限制的方法,实现全天候的建筑损伤评估。

核心思路:论文的核心思路是利用多模态遥感数据,特别是结合光学和SAR(合成孔径雷达)影像,来克服光学数据在全天候条件下的局限性。SAR影像不受天气和光照条件的影响,可以提供互补的信息,从而实现更鲁棒和可靠的建筑损伤评估。此外,通过构建一个包含多种灾害类型和全球分布的数据集,可以训练出具有更好泛化能力的AI模型。

技术框架:BRIGHT数据集的构建流程主要包括以下几个阶段:1) 数据收集:收集全球范围内不同灾害事件的光学和SAR影像数据。2) 数据标注:对影像数据进行精确的建筑损伤标注。3) 数据整理:将数据整理成统一的格式,并进行划分,用于训练、验证和测试。4) 模型训练与验证:使用BRIGHT数据集训练不同的AI模型,并验证其在建筑损伤评估任务上的性能。

关键创新:BRIGHT数据集的关键创新在于:1) 它是第一个开放获取、全球分布、事件多样的多模态建筑损伤评估数据集,专门用于支持基于AI的灾害响应。2) 它结合了甚高分辨率的光学和SAR影像,提供了单个建筑物的详细表示,使其成为精确BDA的理想选择。3) 它涵盖了多种灾害类型和全球区域,特别关注最需要外部援助的发展中国家。

关键设计:BRIGHT数据集包含0.3-1米分辨率的光学和SAR影像,覆盖五种自然灾害和两种人为灾害。标注信息包括建筑物的损伤等级。论文使用七种先进的AI模型进行实验,包括常用的图像分割和目标检测模型。具体的参数设置、损失函数和网络结构等技术细节在论文的实验部分有详细描述。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了基于BRIGHT数据集训练的七种先进AI模型在建筑损伤评估任务上的性能。实验结果表明,这些模型具有良好的可迁移性和鲁棒性,能够有效地应用于不同灾害类型和地区的建筑损伤评估。具体的性能数据(如精度、召回率等)可以在论文的实验部分找到。

🎯 应用场景

BRIGHT数据集可用于训练和评估各种AI模型,以实现自动化、快速和准确的建筑损伤评估。这对于灾害响应、救援规划、灾后重建以及风险评估等领域具有重要应用价值。该数据集能够促进全天候灾害响应系统的发展,提高灾害应对能力,减少人员伤亡和财产损失。

📄 摘要(原文)

Disaster events occur around the world and cause significant damage to human life and property. Earth observation (EO) data enables rapid and comprehensive building damage assessment (BDA), an essential capability in the aftermath of a disaster to reduce human casualties and to inform disaster relief efforts. Recent research focuses on the development of AI models to achieve accurate mapping of unseen disaster events, mostly using optical EO data. However, solutions based on optical data are limited to clear skies and daylight hours, preventing a prompt response to disasters. Integrating multimodal (MM) EO data, particularly the combination of optical and SAR imagery, makes it possible to provide all-weather, day-and-night disaster responses. Despite this potential, the development of robust multimodal AI models has been constrained by the lack of suitable benchmark datasets. In this paper, we present a BDA dataset using veRy-hIGH-resoluTion optical and SAR imagery (BRIGHT) to support AI-based all-weather disaster response. To the best of our knowledge, BRIGHT is the first open-access, globally distributed, event-diverse MM dataset specifically curated to support AI-based disaster response. It covers five types of natural disasters and two types of man-made disasters across 14 regions worldwide, with a particular focus on developing countries where external assistance is most needed. The optical and SAR imagery in BRIGHT, with a spatial resolution between 0.3-1 meters, provides detailed representations of individual buildings, making it ideal for precise BDA. In our experiments, we have tested seven advanced AI models trained with our BRIGHT to validate the transferability and robustness. The dataset and code are available at https://github.com/ChenHongruixuan/BRIGHT. BRIGHT also serves as the official dataset for the 2025 IEEE GRSS Data Fusion Contest.