Self-Supervised Partial Cycle-Consistency for Multi-View Matching

作者: Fedor Taggenbrock, Gertjan Burghouts, Ronald Poppe

分类: cs.CV

发布日期: 2025-01-10

备注: Accepted to VISAPP 2025

💡 一句话要点

提出自监督偏置循环一致性,用于多视角匹配

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多视角匹配 自监督学习 循环一致性 部分重叠 特征提取

📋 核心要点

- 多视角匹配任务中,现有方法难以有效处理视角间的部分重叠问题,导致匹配精度下降。

- 论文提出自监督偏置循环一致性方法,利用伪掩码和多种循环变体,提升特征提取网络的视角不变性。

- 在DIVOTrack数据集上,该方法相比现有自监督方法,F1分数提升4.3个百分点,且对训练数据重叠度不敏感。

📝 摘要(中文)

在多摄像头系统中,跨部分重叠的摄像头视角匹配目标至关重要,这需要一个视角不变的特征提取网络。使用循环一致性训练此类网络可以避免耗费人力的标注。本文扩展了循环一致性的数学公式,以处理部分重叠的情况。我们引入了一个伪掩码,引导训练损失考虑部分重叠。此外,我们还提出了几种相互补充的循环变体,并提出了一种时间发散的场景采样方案,以改善此自监督设置的数据输入。在具有挑战性的DIVOTrack数据集上的跨摄像头匹配实验表明了我们方法的优点。与自监督最先进技术相比,通过我们的综合贡献,我们实现了高4.3个百分点的F1分数。我们的改进对训练数据中减少的重叠具有鲁棒性,并在需要在许多人之间进行少量匹配的具有挑战性的场景中实现了显着改进。使用我们的方法训练的自监督特征网络可以有效地匹配各种多摄像头设置中的对象,从而为大规模多摄像头场景理解等复杂任务提供机会。

🔬 方法详解

问题定义:多视角匹配旨在关联不同摄像头视角下的同一目标。现有方法在处理部分重叠视角时,容易受到背景干扰,导致特征提取不准确,匹配性能下降。尤其是在人群场景中,目标数量多且遮挡严重,匹配难度进一步增加。

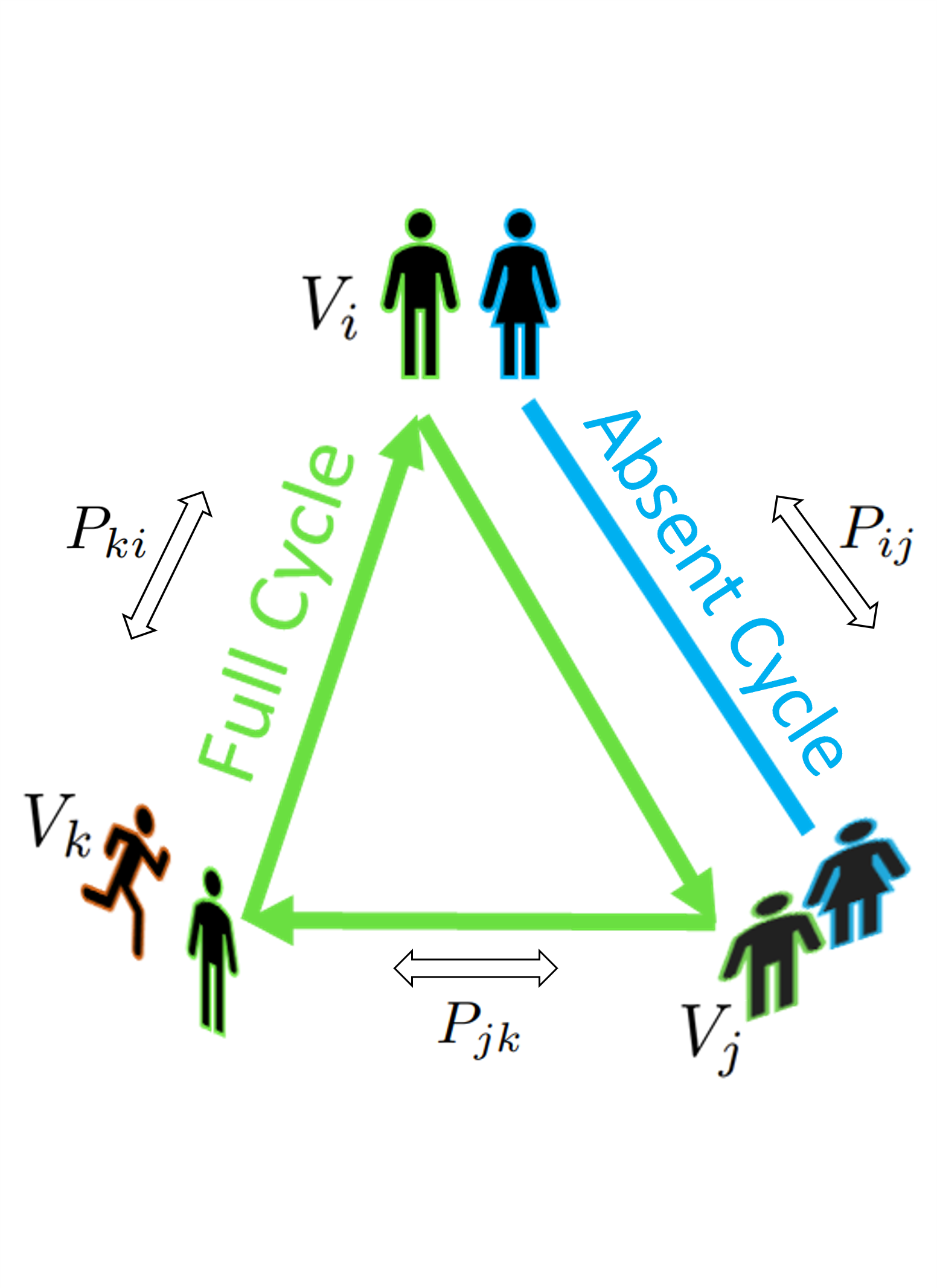

核心思路:论文的核心思路是利用自监督学习,通过循环一致性约束来学习视角不变的特征表示。通过构建从一个视角到另一个视角再返回原始视角的循环,保证特征的一致性。为了处理部分重叠,引入伪掩码来指导损失函数的计算,使其关注重叠区域。

技术框架:整体框架包含特征提取网络和循环一致性损失计算模块。首先,从不同视角提取图像特征。然后,构建多个循环变体,例如A->B->A, A->B->C->A等,以增加训练的多样性。利用伪掩码来约束循环一致性损失,使其只在重叠区域计算。最后,使用时间发散的场景采样策略,增加训练数据的多样性。

关键创新:最重要的创新点在于提出了自监督偏置循环一致性,通过伪掩码来处理部分重叠问题。与传统的循环一致性方法相比,该方法能够更有效地利用部分重叠的信息,提高特征提取的鲁棒性。此外,多种循环变体的引入也增加了训练的稳定性。

关键设计:伪掩码的设计是关键。它通过计算不同视角之间的可见区域来生成,用于指导循环一致性损失的计算。损失函数的设计也至关重要,需要平衡不同循环变体之间的贡献。时间发散的场景采样策略通过选择不同时间段的场景,增加训练数据的多样性,避免模型过拟合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在DIVOTrack数据集上取得了显著的性能提升,F1分数比现有自监督方法高4.3个百分点。即使在训练数据重叠度较低的情况下,该方法仍然表现出良好的鲁棒性。此外,该方法在需要在许多人之间进行少量匹配的具有挑战性的场景中也取得了显著改进,证明了其在复杂场景下的有效性。

🎯 应用场景

该研究成果可应用于多摄像头监控系统、三维重建、机器人导航等领域。例如,在智能安防中,可以利用该方法实现跨摄像头的人员追踪和行为分析。在机器人导航中,可以利用该方法实现多视角环境感知和地图构建。该方法为大规模多摄像头场景理解提供了新的思路。

📄 摘要(原文)

Matching objects across partially overlapping camera views is crucial in multi-camera systems and requires a view-invariant feature extraction network. Training such a network with cycle-consistency circumvents the need for labor-intensive labeling. In this paper, we extend the mathematical formulation of cycle-consistency to handle partial overlap. We then introduce a pseudo-mask which directs the training loss to take partial overlap into account. We additionally present several new cycle variants that complement each other and present a time-divergent scene sampling scheme that improves the data input for this self-supervised setting. Cross-camera matching experiments on the challenging DIVOTrack dataset show the merits of our approach. Compared to the self-supervised state-of-the-art, we achieve a 4.3 percentage point higher F1 score with our combined contributions. Our improvements are robust to reduced overlap in the training data, with substantial improvements in challenging scenes that need to make few matches between many people. Self-supervised feature networks trained with our method are effective at matching objects in a range of multi-camera settings, providing opportunities for complex tasks like large-scale multi-camera scene understanding.