A Multimodal Dataset for Enhancing Industrial Task Monitoring and Engagement Prediction

作者: Naval Kishore Mehta, Arvind, Himanshu Kumar, Abeer Banerjee, Sumeet Saurav, Sanjay Singh

分类: cs.CV

发布日期: 2025-01-10

备注: Accepted at the 20th International Conference on Human-Robot Interaction (HRI) 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出MIAM多模态数据集,用于提升工业任务监控和人机协作中的行为预测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态数据集 工业活动监控 人机协作 参与度预测 动作识别

📋 核心要点

- 现有单模态方法难以捕捉非结构化工业环境中操作员行为的复杂性,限制了人机协作研究的进展。

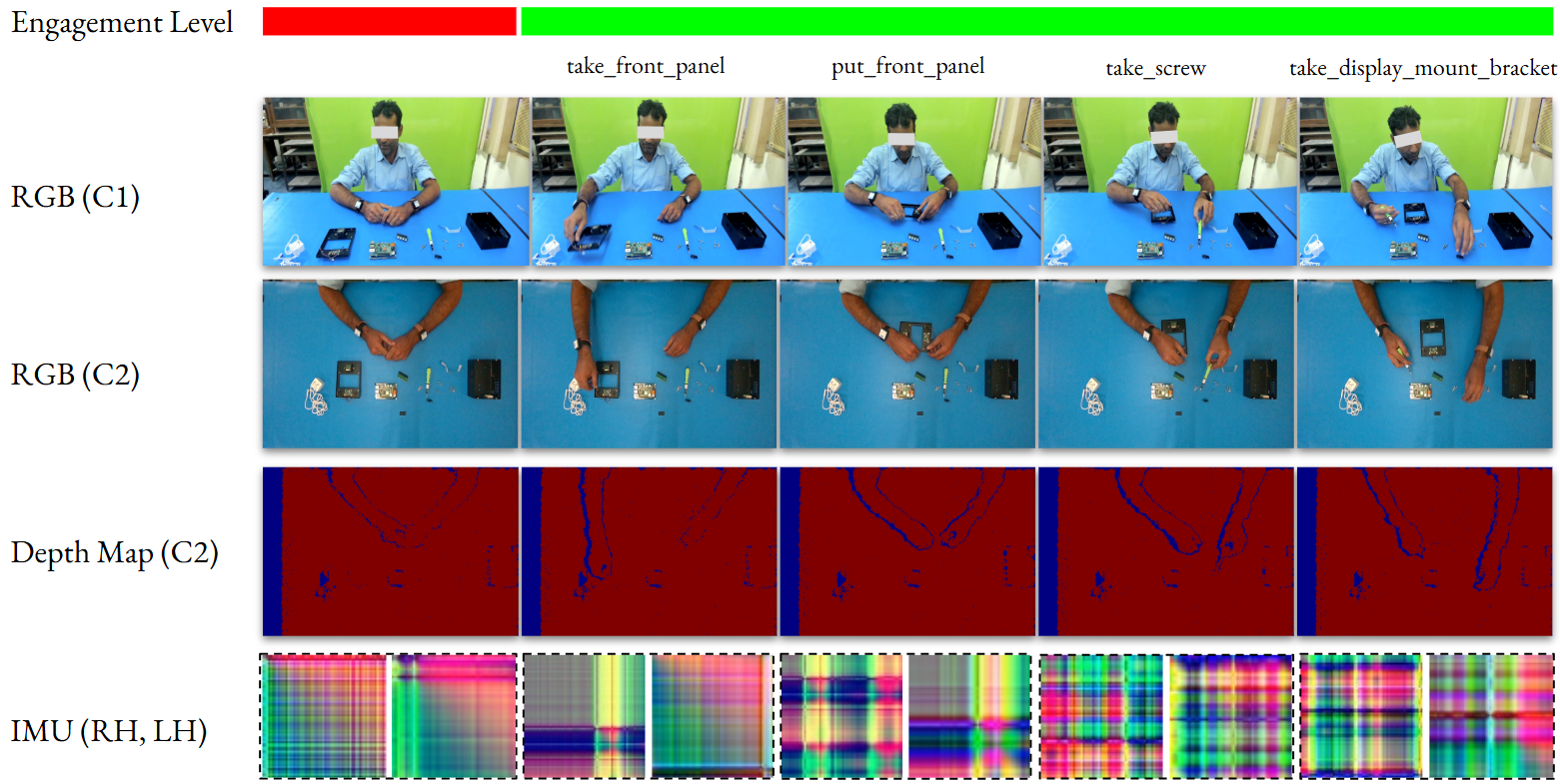

- MIAM数据集整合了多视角RGB、深度和IMU数据,并对真实工业任务中的操作员行为进行了详细标注。

- 提出的多模态网络融合RGB、IMU和骨骼数据,提高了工业任务中操作员参与度预测的准确性。

📝 摘要(中文)

本文提出了一种新的多模态工业活动监控(MIAM)数据集,旨在解决人机协作研究中,在复杂、真实环境中检测和解释操作员行为、参与度和对象交互的难题。该数据集包含真实装配和拆卸任务的多视角RGB、深度和惯性测量单元(IMU)数据,共22个会话,290分钟的未裁剪视频,并对任务执行和操作员行为进行了详细标注。其独特之处在于集成了多种数据模态,并强调真实的、未裁剪的工业工作流程,这对于推进人机协作和操作员监控的研究至关重要。此外,本文还提出了一种多模态网络,融合RGB帧、IMU数据和骨骼序列来预测工业任务中的参与度水平,提高了识别参与状态的准确性,为动态工业环境中操作员绩效监控提供了一个鲁棒的解决方案。数据集和代码可在https://github.com/navalkishoremehta95/MIAM/ 获取。

🔬 方法详解

问题定义:论文旨在解决在复杂工业环境中,准确检测和理解操作员的动作、参与度以及与物体的交互的问题。现有方法,特别是单模态方法,难以充分捕捉真实工业场景的复杂性和动态性,导致在人机协作和操作员监控方面的性能不足。

核心思路:论文的核心思路是利用多模态数据融合来更全面地理解操作员的行为。通过结合RGB图像、深度信息和IMU数据,可以获得更丰富的场景信息和操作员的运动状态,从而提高动作识别、对象交互检测和参与度预测的准确性。

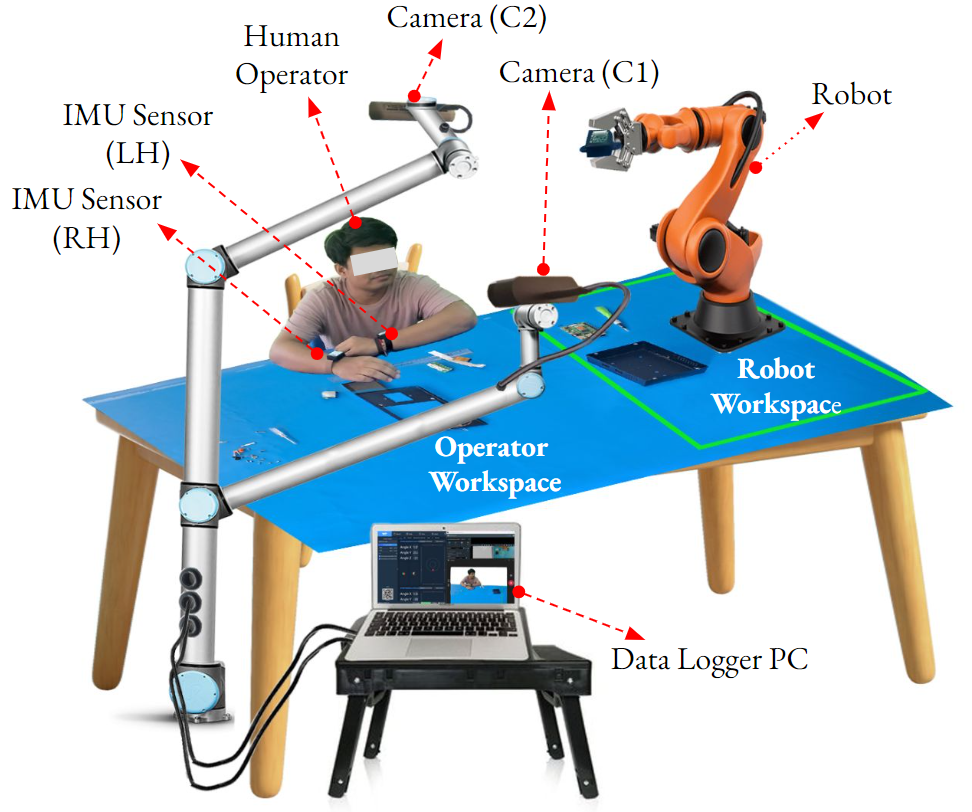

技术框架:整体框架包含数据采集和模型训练两个主要阶段。数据采集阶段使用多视角RGB相机、深度相机和IMU传感器同步记录操作员执行工业任务的过程。模型训练阶段,提出的多模态网络将RGB帧、IMU数据和骨骼序列作为输入,通过融合不同模态的信息来预测操作员的参与度。

关键创新:该论文的关键创新在于构建了一个新的多模态工业活动监控(MIAM)数据集,该数据集专注于真实的、未裁剪的工业工作流程,并集成了多种数据模态。此外,提出的多模态网络能够有效地融合不同模态的信息,从而提高操作员参与度预测的准确性。与现有方法相比,该方法更注重真实场景的应用,并利用多模态数据来提升性能。

关键设计:多模态网络的设计是关键。具体来说,网络结构需要能够有效地提取和融合来自不同模态的特征。例如,可以使用卷积神经网络(CNN)处理RGB图像,循环神经网络(RNN)处理IMU数据序列,并使用图神经网络(GNN)处理骨骼序列。融合策略的选择也很重要,例如可以使用注意力机制来动态地调整不同模态的权重。损失函数的设计需要考虑参与度预测的特点,例如可以使用交叉熵损失函数或回归损失函数。

🖼️ 关键图片

📊 实验亮点

论文提出的多模态网络在MIAM数据集上进行了评估,实验结果表明,该方法能够显著提高操作员参与度预测的准确性。具体性能数据和与其他基线方法的对比结果在论文中进行了详细展示。通过融合RGB、IMU和骨骼数据,该方法能够更准确地识别操作员的参与状态,为动态工业环境中的操作员绩效监控提供了一个鲁棒的解决方案。

🎯 应用场景

该研究成果可应用于智能制造、人机协作、工业安全等领域。通过实时监控操作员的行为和参与度,可以及时发现潜在的安全风险,提高生产效率,并为操作员提供个性化的指导和反馈。未来,该技术有望进一步应用于远程操作、自动化培训等场景,提升工业生产的智能化水平。

📄 摘要(原文)

Detecting and interpreting operator actions, engagement, and object interactions in dynamic industrial workflows remains a significant challenge in human-robot collaboration research, especially within complex, real-world environments. Traditional unimodal methods often fall short of capturing the intricacies of these unstructured industrial settings. To address this gap, we present a novel Multimodal Industrial Activity Monitoring (MIAM) dataset that captures realistic assembly and disassembly tasks, facilitating the evaluation of key meta-tasks such as action localization, object interaction, and engagement prediction. The dataset comprises multi-view RGB, depth, and Inertial Measurement Unit (IMU) data collected from 22 sessions, amounting to 290 minutes of untrimmed video, annotated in detail for task performance and operator behavior. Its distinctiveness lies in the integration of multiple data modalities and its emphasis on real-world, untrimmed industrial workflows-key for advancing research in human-robot collaboration and operator monitoring. Additionally, we propose a multimodal network that fuses RGB frames, IMU data, and skeleton sequences to predict engagement levels during industrial tasks. Our approach improves the accuracy of recognizing engagement states, providing a robust solution for monitoring operator performance in dynamic industrial environments. The dataset and code can be accessed from https://github.com/navalkishoremehta95/MIAM/.