Consistent Flow Distillation for Text-to-3D Generation

作者: Runjie Yan, Yinbo Chen, Xiaolong Wang

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-01-09

备注: Project page: https://runjie-yan.github.io/cfd/

💡 一句话要点

提出一致性流蒸馏(CFD)方法,提升文本到3D生成的质量和多样性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 文本到3D生成 扩散模型 一致性流蒸馏 多视角一致性 3D重建

📋 核心要点

- SDS方法在文本到3D生成中存在视觉质量和多样性不足的问题,源于其最大似然估计的特性。

- CFD方法利用扩散模型的梯度信息,并强调多视角图像流的一致性,从而提升3D生成的质量。

- 实验结果表明,CFD方法在文本到3D生成任务中,显著优于现有的SDS方法。

📝 摘要(中文)

Score Distillation Sampling (SDS) 在利用图像生成模型进行3D生成方面取得了显著进展。然而,其最大似然估计的特性常常导致视觉质量和多样性的下降,限制了其在3D应用中的有效性。为了解决这些局限性,我们提出了Consistent Flow Distillation (CFD)。我们首先利用扩散ODE或SDE采样过程的梯度来指导3D生成。从基于梯度的采样角度来看,我们发现跨不同视角的2D图像流的一致性对于高质量3D生成至关重要。为了实现这一点,我们在3D对象上引入多视角一致的高斯噪声,可以从各个视角渲染以计算流梯度。实验表明,CFD通过一致的流,显著优于以往的文本到3D生成方法。

🔬 方法详解

问题定义:现有的Score Distillation Sampling (SDS)方法在文本到3D生成任务中,由于其最大似然估计的特性,容易导致生成的3D模型视觉质量下降,缺乏多样性。这限制了SDS方法在实际3D应用中的有效性。因此,需要一种新的方法来提升3D生成的质量和多样性。

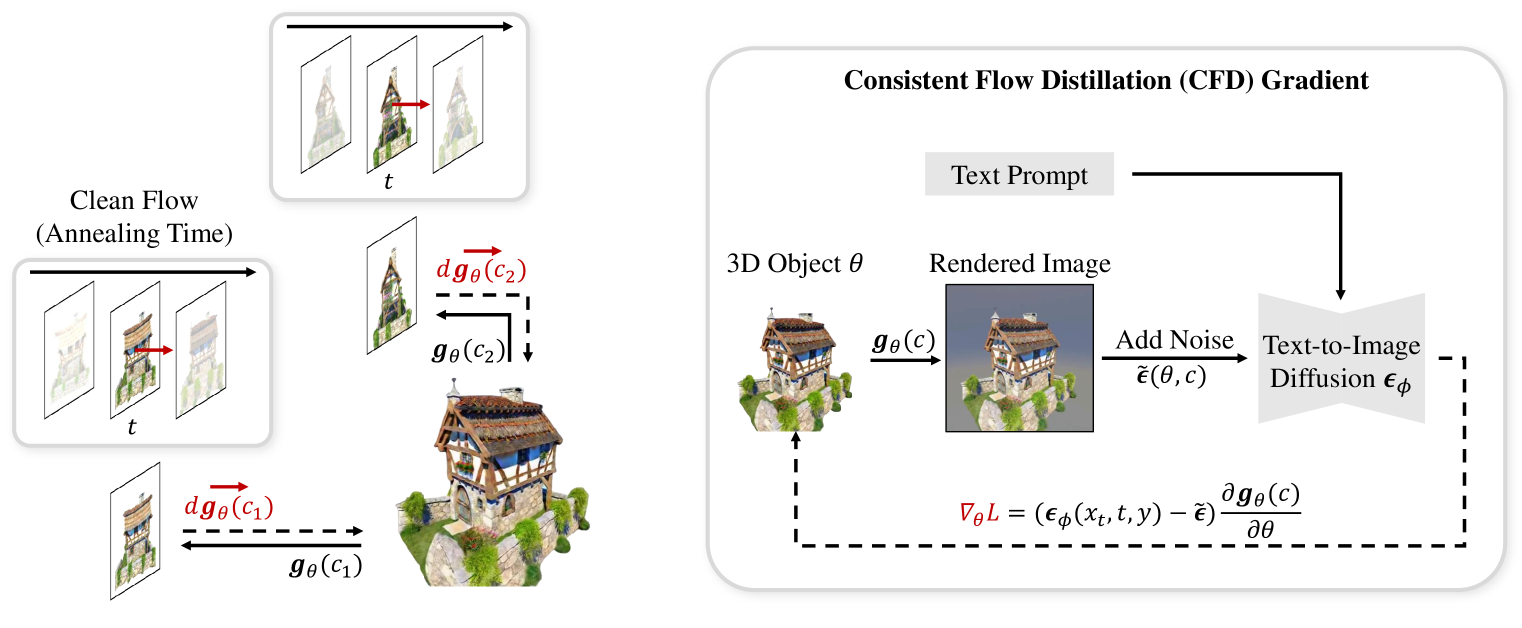

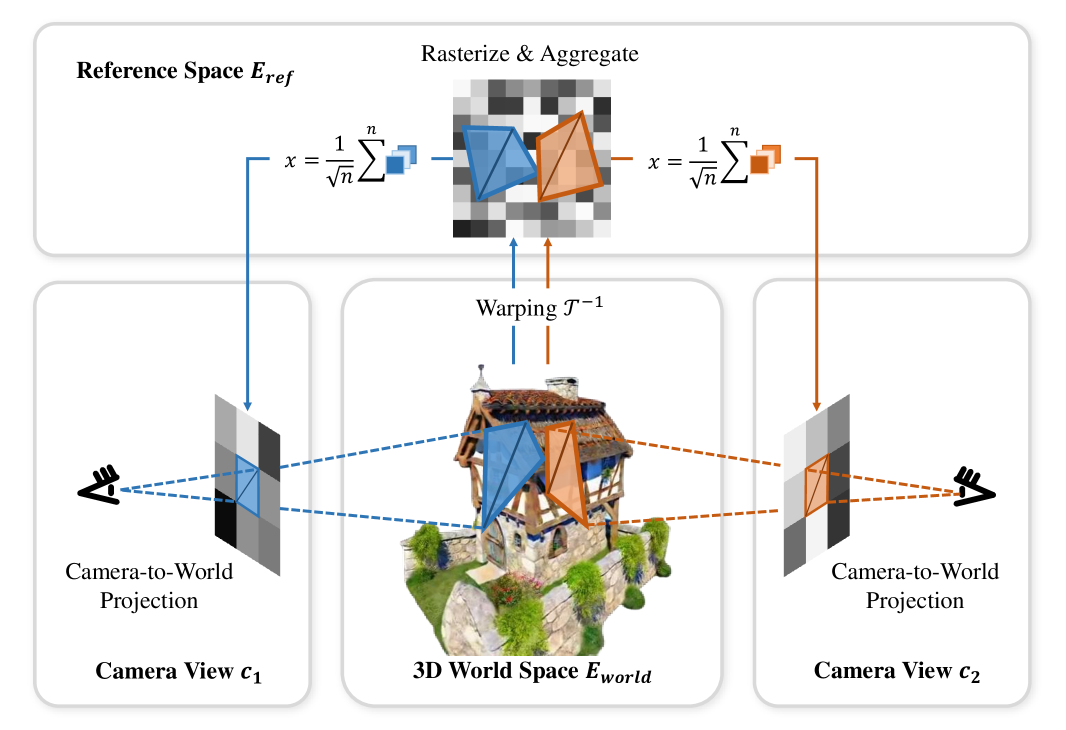

核心思路:论文的核心思路是利用扩散ODE或SDE采样过程的梯度来指导3D生成,并强调多视角图像流的一致性。作者认为,从不同视角观察到的2D图像流应该保持一致,这种一致性对于生成高质量的3D模型至关重要。通过引入多视角一致的高斯噪声,可以有效地计算和优化这种一致性。

技术框架:CFD方法的技术框架主要包括以下几个步骤:1) 使用文本提示作为输入;2) 初始化一个3D模型;3) 从多个视角渲染3D模型,得到2D图像;4) 在2D图像上添加多视角一致的高斯噪声;5) 利用扩散模型计算噪声图像的梯度;6) 使用梯度信息更新3D模型,使其生成的图像更符合文本提示,并保持多视角一致性;7) 重复步骤3-6,直到3D模型收敛。

关键创新:CFD方法的关键创新在于引入了多视角一致性约束。传统的SDS方法只关注单个视角的图像质量,而忽略了不同视角之间的一致性。CFD方法通过在3D对象上引入多视角一致的高斯噪声,并利用扩散模型的梯度信息来优化这种一致性,从而显著提升了3D生成的质量和多样性。与现有方法的本质区别在于,CFD方法不仅仅追求单个视角的图像质量,更关注不同视角之间的一致性。

关键设计:CFD方法的关键设计包括:1) 多视角一致高斯噪声的生成方式,需要保证从不同视角观察到的噪声具有一致性;2) 扩散模型的选择和训练,需要选择一个能够生成高质量图像的扩散模型;3) 梯度计算和更新策略,需要选择合适的优化器和学习率,以保证3D模型能够稳定收敛;4) 损失函数的设计,需要同时考虑图像质量和多视角一致性。

🖼️ 关键图片

📊 实验亮点

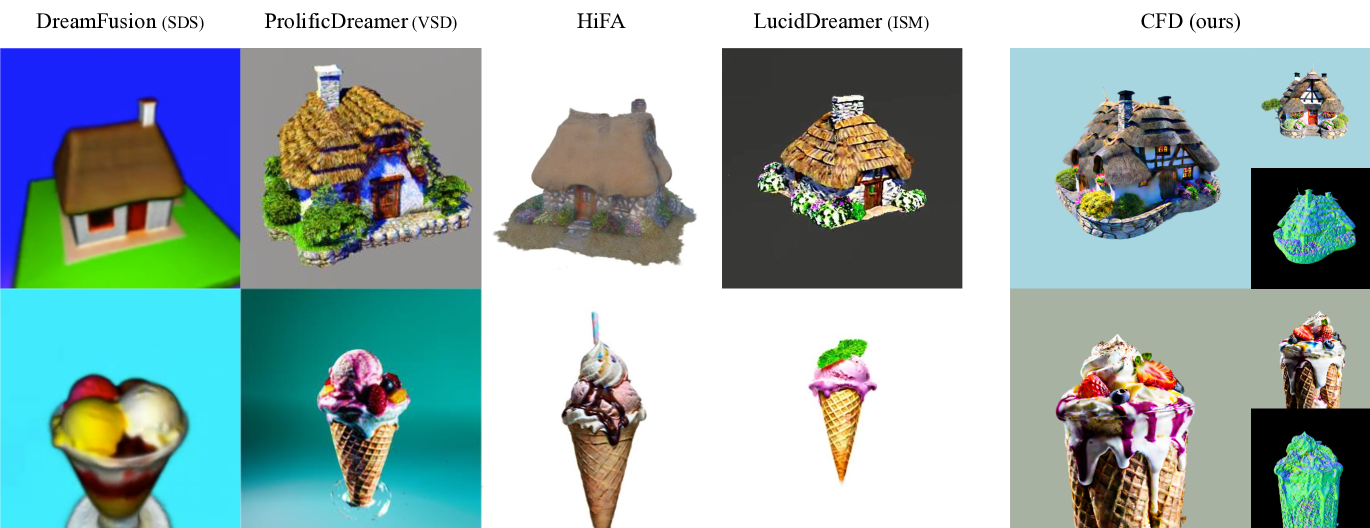

CFD方法在文本到3D生成任务中取得了显著的性能提升。实验结果表明,CFD方法生成的3D模型在视觉质量和多样性方面均优于现有的SDS方法。具体而言,CFD方法能够生成更加清晰、逼真、细节丰富的3D模型,并且能够更好地满足用户的文本提示要求。定量指标和定性结果均表明,CFD方法是一种有效的文本到3D生成方法。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、增强现实、游戏开发、电影制作等领域。通过高质量的文本到3D生成,可以快速创建各种3D模型,降低3D内容创作的门槛,并为用户提供更加丰富和逼真的体验。未来,该技术有望进一步发展,实现更加精细和个性化的3D内容生成。

📄 摘要(原文)

Score Distillation Sampling (SDS) has made significant strides in distilling image-generative models for 3D generation. However, its maximum-likelihood-seeking behavior often leads to degraded visual quality and diversity, limiting its effectiveness in 3D applications. In this work, we propose Consistent Flow Distillation (CFD), which addresses these limitations. We begin by leveraging the gradient of the diffusion ODE or SDE sampling process to guide the 3D generation. From the gradient-based sampling perspective, we find that the consistency of 2D image flows across different viewpoints is important for high-quality 3D generation. To achieve this, we introduce multi-view consistent Gaussian noise on the 3D object, which can be rendered from various viewpoints to compute the flow gradient. Our experiments demonstrate that CFD, through consistent flows, significantly outperforms previous methods in text-to-3D generation.