SEGS-SLAM: Structure-enhanced 3D Gaussian Splatting SLAM with Appearance Embedding

作者: Tianci Wen, Zhiang Liu, Yongchun Fang

分类: cs.CV

发布日期: 2025-01-09 (更新: 2025-07-13)

备注: ICCV 2025 accept;code, video, demos, and project are available at Project page https://segs-slam.github.io/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

SEGS-SLAM:提出结构增强的3D高斯溅射SLAM,提升光照真实感映射质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 SLAM 光照真实感映射 结构增强 外观嵌入 机器人导航 虚拟现实

📋 核心要点

- 现有3D高斯溅射SLAM方法未能充分捕捉场景结构,导致结构不一致,且难以应对外观突变。

- SEGS-SLAM利用结构化点云初始化3D高斯分布,并提出运动外观嵌入(AfME)建模外观变化。

- 实验表明,SEGS-SLAM在单目、立体和RGB-D数据集上显著提升了光照真实感映射质量。

📝 摘要(中文)

本文提出了一种结构增强的3D高斯溅射SLAM方法,称为SEGS-SLAM,旨在解决现有算法在SLAM问题中未能充分捕捉底层结构以及难以应对突变外观变化的问题,从而实现高质量的光照真实感映射。该方法的核心贡献包括:首先,提出了一个结构增强的光照真实感映射(SEPM)框架,首次利用高度结构化的点云来初始化结构化的3D高斯分布,显著提高了渲染质量。其次,提出了运动外观嵌入(AfME),使3D高斯分布能够更好地建模不同相机姿态下的图像外观变化。在单目、立体和RGB-D数据集上的大量实验表明,SEGS-SLAM在光照真实感映射质量方面显著优于最先进的方法,例如,在TUM RGB-D数据集上,单目相机相比MonoGS的PSNR提高了19.86%。

🔬 方法详解

问题定义:现有的基于3D高斯溅射的SLAM方法在构建场景地图时,通常无法充分利用场景的结构信息,导致重建的场景在结构上存在不一致性。此外,由于光照、视角等因素的影响,图像的外观会发生突变,现有的方法难以有效地建模这些外观变化,从而影响了渲染质量。因此,论文旨在解决如何在3D高斯溅射SLAM中更好地利用场景结构信息,并有效地建模外观变化,以提高光照真实感映射的质量。

核心思路:论文的核心思路是利用结构化的点云信息来初始化3D高斯分布,从而更好地捕捉场景的结构信息。同时,通过引入运动外观嵌入(AfME),使3D高斯分布能够更好地建模不同相机姿态下的图像外观变化。这样,既能保证重建场景的结构一致性,又能提高渲染质量。

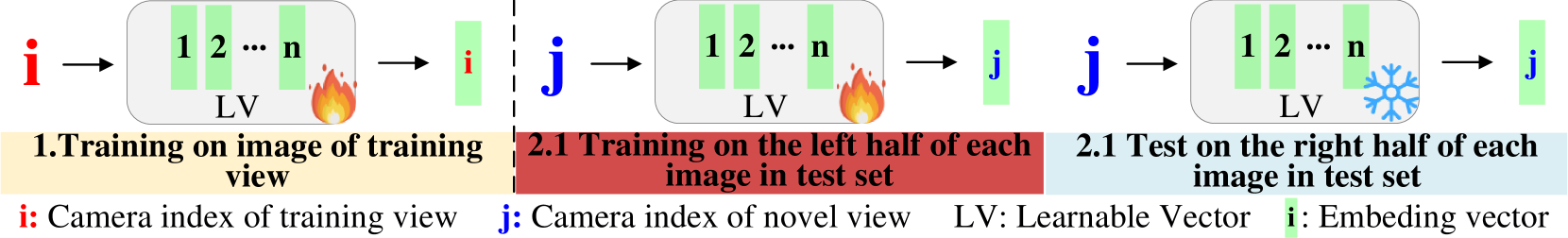

技术框架:SEGS-SLAM的整体框架主要包括两个关键模块:结构增强的光照真实感映射(SEPM)和运动外观嵌入(AfME)。SEPM模块负责利用结构化的点云信息初始化3D高斯分布,从而提高场景的结构一致性。AfME模块负责建模不同相机姿态下的图像外观变化,从而提高渲染质量。整个流程包括:输入图像序列,利用SEPM初始化3D高斯,然后利用AfME进行外观嵌入,最后进行渲染和优化。

关键创新:论文的关键创新在于两个方面:一是提出了结构增强的光照真实感映射(SEPM)框架,首次将结构化的点云信息引入到3D高斯溅射SLAM中,从而提高了场景的结构一致性。二是提出了运动外观嵌入(AfME),使3D高斯分布能够更好地建模不同相机姿态下的图像外观变化。与现有方法相比,SEGS-SLAM能够更好地捕捉场景的结构信息,并有效地建模外观变化,从而提高了光照真实感映射的质量。

关键设计:在SEPM模块中,论文利用预先存在的结构化点云(例如由其他SLAM系统或深度传感器获取)来初始化3D高斯分布的中心位置和协方差矩阵。在AfME模块中,论文设计了一个基于神经网络的嵌入模块,该模块以相机姿态作为输入,输出一个外观嵌入向量,该向量被用来调整3D高斯分布的颜色和透明度。损失函数包括渲染损失(例如L1损失或PSNR损失)和正则化损失,用于约束3D高斯分布的形状和大小。

🖼️ 关键图片

📊 实验亮点

SEGS-SLAM在多个数据集上进行了评估,包括TUM RGB-D、EuRoC等。实验结果表明,SEGS-SLAM在光照真实感映射质量方面显著优于最先进的方法。例如,在TUM RGB-D数据集上,单目相机相比MonoGS的PSNR提高了19.86%。此外,SEGS-SLAM在结构一致性方面也取得了显著的提升,能够更好地捕捉场景的结构信息。

🎯 应用场景

SEGS-SLAM在机器人导航、自动驾驶、虚拟现实和增强现实等领域具有广泛的应用前景。它可以用于构建高质量的3D场景地图,为机器人提供更准确的环境感知信息,从而提高导航和定位的精度。此外,SEGS-SLAM还可以用于生成逼真的虚拟场景,为用户提供沉浸式的体验。未来,该技术有望应用于更多需要高质量3D重建和渲染的场景。

📄 摘要(原文)

3D Gaussian splatting (3D-GS) has recently revolutionized novel view synthesis in the simultaneous localization and mapping (SLAM) problem. However, most existing algorithms fail to fully capture the underlying structure, resulting in structural inconsistency. Additionally, they struggle with abrupt appearance variations, leading to inconsistent visual quality. To address these problems, we propose SEGS-SLAM, a structure-enhanced 3D Gaussian Splatting SLAM, which achieves high-quality photorealistic mapping. Our main contributions are two-fold. First, we propose a structure-enhanced photorealistic mapping (SEPM) framework that, for the first time, leverages highly structured point cloud to initialize structured 3D Gaussians, leading to significant improvements in rendering quality. Second, we propose Appearance-from-Motion embedding (AfME), enabling 3D Gaussians to better model image appearance variations across different camera poses. Extensive experiments on monocular, stereo, and RGB-D datasets demonstrate that SEGS-SLAM significantly outperforms state-of-the-art (SOTA) methods in photorealistic mapping quality, e.g., an improvement of $19.86\%$ in PSNR over MonoGS on the TUM RGB-D dataset for monocular cameras. The project page is available at https://segs-slam.github.io/.