Optimizing Multitask Industrial Processes with Predictive Action Guidance

作者: Naval Kishore Mehta, Arvind, Shyam Sunder Prasad, Sumeet Saurav, Sanjay Singh

分类: cs.CV

发布日期: 2025-01-09

💡 一句话要点

提出MMTFRU网络,结合OAMU单元,优化多任务工业流程中的操作指导。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 工业流程优化 活动预测 人机协作 Transformer网络

📋 核心要点

- 现有方法难以应对人为操作的可变性和主观偏好,导致任务预测和指导不准确。

- 提出MMTFRU网络,通过多模态融合提升预测精度,并结合OAMU单元提供主动操作指导。

- 在Meccano和EPIC-Kitchens-55数据集上验证,证明了其在动态环境中的有效性。

📝 摘要(中文)

为了维持生产力并确保符合装配标准,监控复杂的装配过程至关重要。然而,人为操作的可变性和主观的任务偏好使得准确的任务预测和指导变得复杂。为了解决这些挑战,我们引入了多模态Transformer融合和循环单元(MMTFRU)网络,用于以自我为中心的活动预测,利用多模态融合来提高预测准确性。该系统与操作员动作监控单元(OAMU)集成,提供主动的操作员指导,防止装配过程中的偏差。OAMU采用两种策略:(1)Top-5 MMTF-RU预测,结合参考图和动作字典,用于下一步推荐;(2)Top-1 MMTF-RU预测,与参考图集成,用于检测序列偏差,并通过熵信息置信度机制预测异常分数。我们还引入了时间加权序列准确率(TWSA)来评估操作员效率并确保及时完成任务。我们的方法在工业Meccano数据集和大规模EPIC-Kitchens-55数据集上进行了验证,证明了其在动态环境中的有效性。

🔬 方法详解

问题定义:论文旨在解决复杂工业装配过程中,由于人为因素导致的任务预测不准确和操作指导不足的问题。现有方法难以有效处理操作员动作的多样性和主观性,导致装配过程易出现偏差,影响生产效率和质量。

核心思路:论文的核心思路是利用多模态信息融合来更准确地预测操作员的下一步动作,并基于预测结果提供主动的操作指导。通过结合视觉、听觉等多种模态的信息,可以更全面地理解操作员的意图,从而提高预测的准确性和鲁棒性。

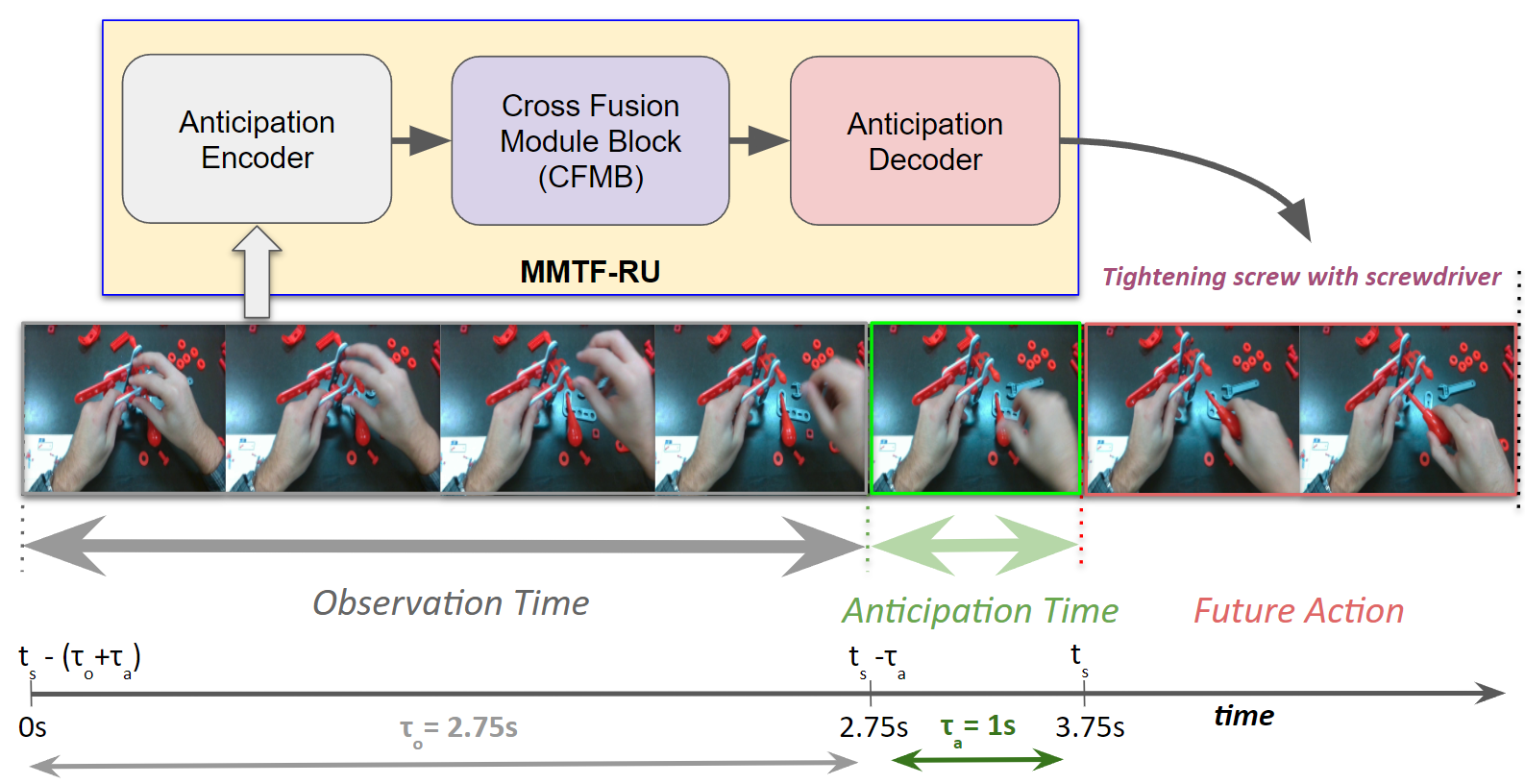

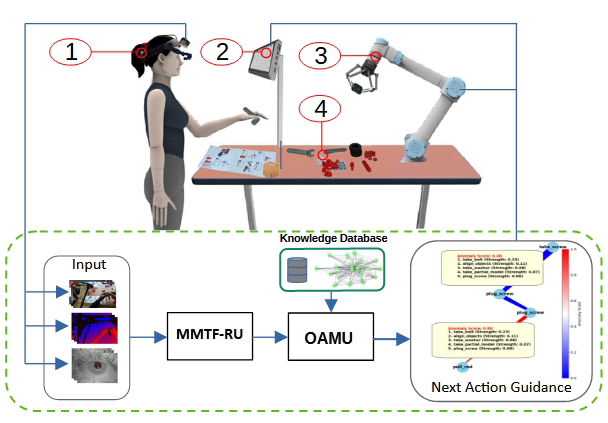

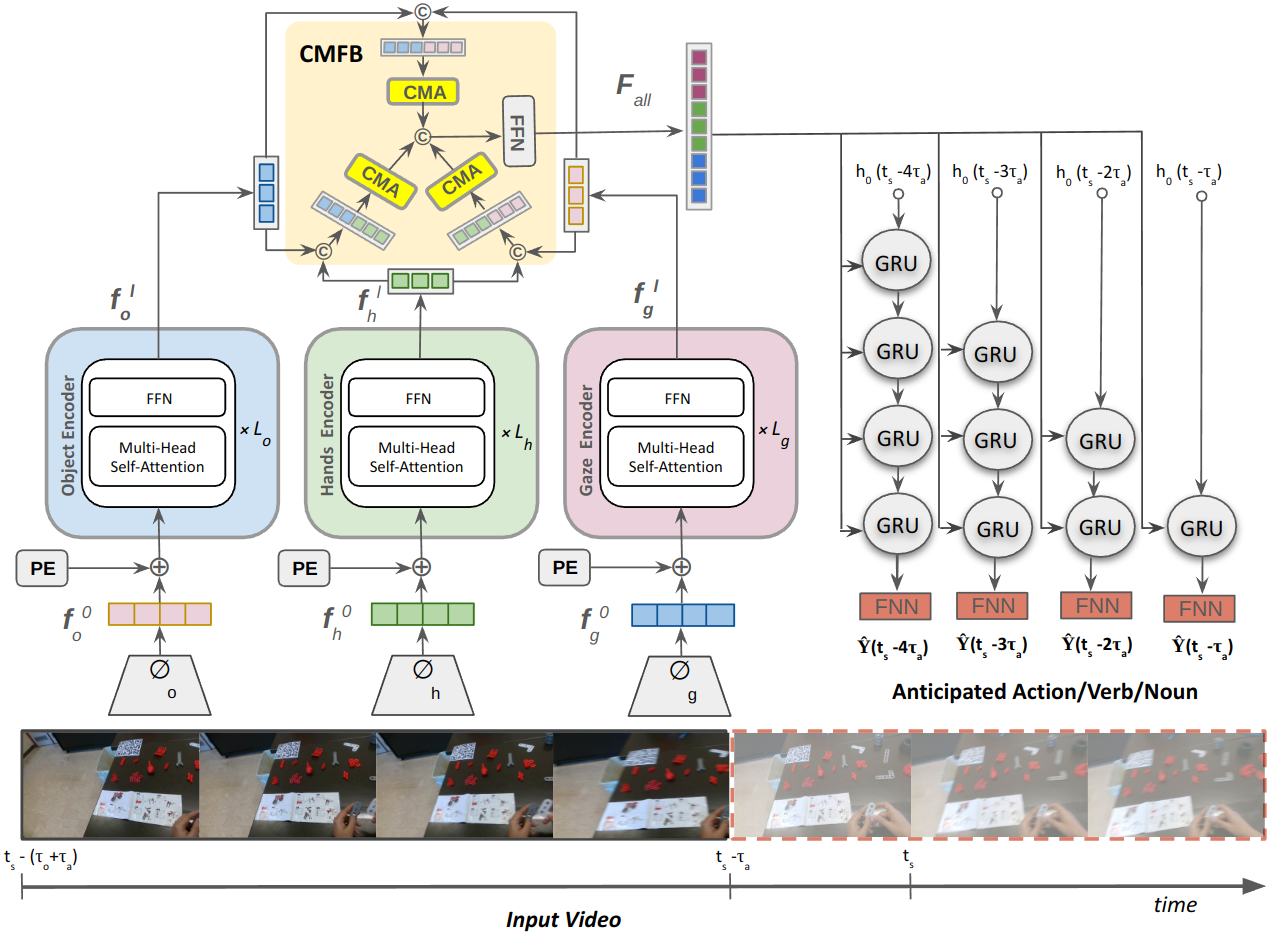

技术框架:整体框架包含两个主要部分:MMTFRU网络和OAMU单元。MMTFRU网络负责对以自我为中心的活动进行预测,OAMU单元则基于MMTFRU的预测结果,结合参考图和动作字典,为操作员提供下一步推荐,并检测序列偏差。框架还包括一个时间加权序列准确率(TWSA)指标,用于评估操作员的效率。

关键创新:论文的关键创新在于MMTFRU网络的多模态融合机制和OAMU单元的主动指导策略。MMTFRU网络通过Transformer和循环单元的结合,有效地融合了不同模态的信息,提高了预测精度。OAMU单元则通过Top-K预测和参考图的结合,实现了对操作员的实时指导和偏差检测。

关键设计:MMTFRU网络采用了多头注意力机制的Transformer结构,用于捕捉不同模态信息之间的关联。OAMU单元使用了熵信息置信度机制来评估预测结果的可靠性,并根据置信度调整指导策略。时间加权序列准确率(TWSA)则通过对不同时间步的预测结果赋予不同的权重,更准确地评估操作员的效率。

🖼️ 关键图片

📊 实验亮点

论文在工业Meccano数据集和大规模EPIC-Kitchens-55数据集上进行了验证,证明了该方法的有效性。实验结果表明,MMTFRU网络能够显著提高活动预测的准确性,并且OAMU单元能够有效地检测序列偏差并提供及时的操作指导。具体性能数据未知,但论文强调了其在动态环境中的有效性。

🎯 应用场景

该研究成果可应用于各种工业装配流程的优化,例如汽车制造、电子产品组装等。通过提供主动的操作指导和实时偏差检测,可以显著提高生产效率、降低错误率,并确保产品质量。未来,该技术还可以扩展到其他需要人机协作的领域,例如医疗手术、远程维修等。

📄 摘要(原文)

Monitoring complex assembly processes is critical for maintaining productivity and ensuring compliance with assembly standards. However, variability in human actions and subjective task preferences complicate accurate task anticipation and guidance. To address these challenges, we introduce the Multi-Modal Transformer Fusion and Recurrent Units (MMTFRU) Network for egocentric activity anticipation, utilizing multimodal fusion to improve prediction accuracy. Integrated with the Operator Action Monitoring Unit (OAMU), the system provides proactive operator guidance, preventing deviations in the assembly process. OAMU employs two strategies: (1) Top-5 MMTF-RU predictions, combined with a reference graph and an action dictionary, for next-step recommendations; and (2) Top-1 MMTF-RU predictions, integrated with a reference graph, for detecting sequence deviations and predicting anomaly scores via an entropy-informed confidence mechanism. We also introduce Time-Weighted Sequence Accuracy (TWSA) to evaluate operator efficiency and ensure timely task completion. Our approach is validated on the industrial Meccano dataset and the largescale EPIC-Kitchens-55 dataset, demonstrating its effectiveness in dynamic environments.