A Flexible and Scalable Framework for Video Moment Search

作者: Chongzhi Zhang, Xizhou Zhu, Aixin Sun

分类: cs.IR, cs.CV

发布日期: 2025-01-09

💡 一句话要点

提出SPR框架,解决长视频中高效灵活的排序视频片段检索问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频片段检索 长视频理解 排序学习 近似最近邻搜索 多模态融合

📋 核心要点

- 现有视频片段检索方法通常假设存在单一完美匹配片段,推理效率低,且难以处理长视频。

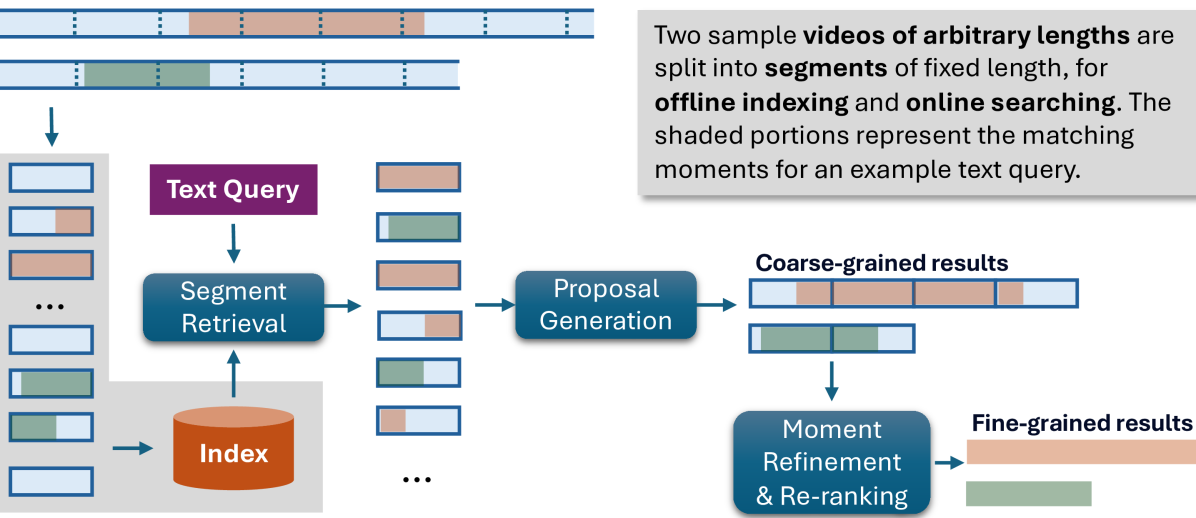

- SPR框架将检索过程分解为片段检索、候选片段生成和片段优化三个独立阶段,实现高效检索。

- 实验表明,SPR框架在TVR-Ranking数据集上取得了SOTA性能,并显著降低了计算成本。

📝 摘要(中文)

本文提出了一种灵活且可扩展的视频片段检索框架,用于在视频集中检索与用户查询相关的排序片段列表,该任务被称为排序视频片段检索(RVMR)。该框架名为Segment-Proposal-Ranking (SPR),将搜索过程简化为三个独立阶段:片段检索、候选片段生成和片段优化与重排序。具体而言,视频被分割成等长片段,并预先计算嵌入向量并离线索引,从而实现高效检索,不受视频长度限制。为了实现可扩展的在线检索,片段和查询都被投影到共享特征空间,以实现近似最近邻(ANN)搜索。检索到的片段随后被合并为粗粒度的候选片段。然后,设计了一个优化和重排序模块,用于重新排序和调整粗粒度候选片段的时间戳。在TVR-Ranking数据集上的评估表明,我们的框架实现了最先进的性能,并显著降低了计算成本和处理时间。灵活的设计还允许独立改进每个阶段,使SPR非常适合大规模应用。

🔬 方法详解

问题定义:论文旨在解决排序视频片段检索(RVMR)问题,即给定一段文本查询,从视频集中检索出与查询相关的、排序后的视频片段列表。现有方法通常假设存在单一完美匹配片段,且在处理长视频时效率低下,难以扩展到大规模视频库。

核心思路:论文的核心思路是将复杂的视频片段检索任务分解为三个独立的、可优化的阶段:片段检索、候选片段生成和片段优化与重排序。通过预计算片段嵌入并使用近似最近邻搜索,实现高效的片段检索。然后,将检索到的片段合并为粗粒度的候选片段,并通过优化模块进行精细调整。

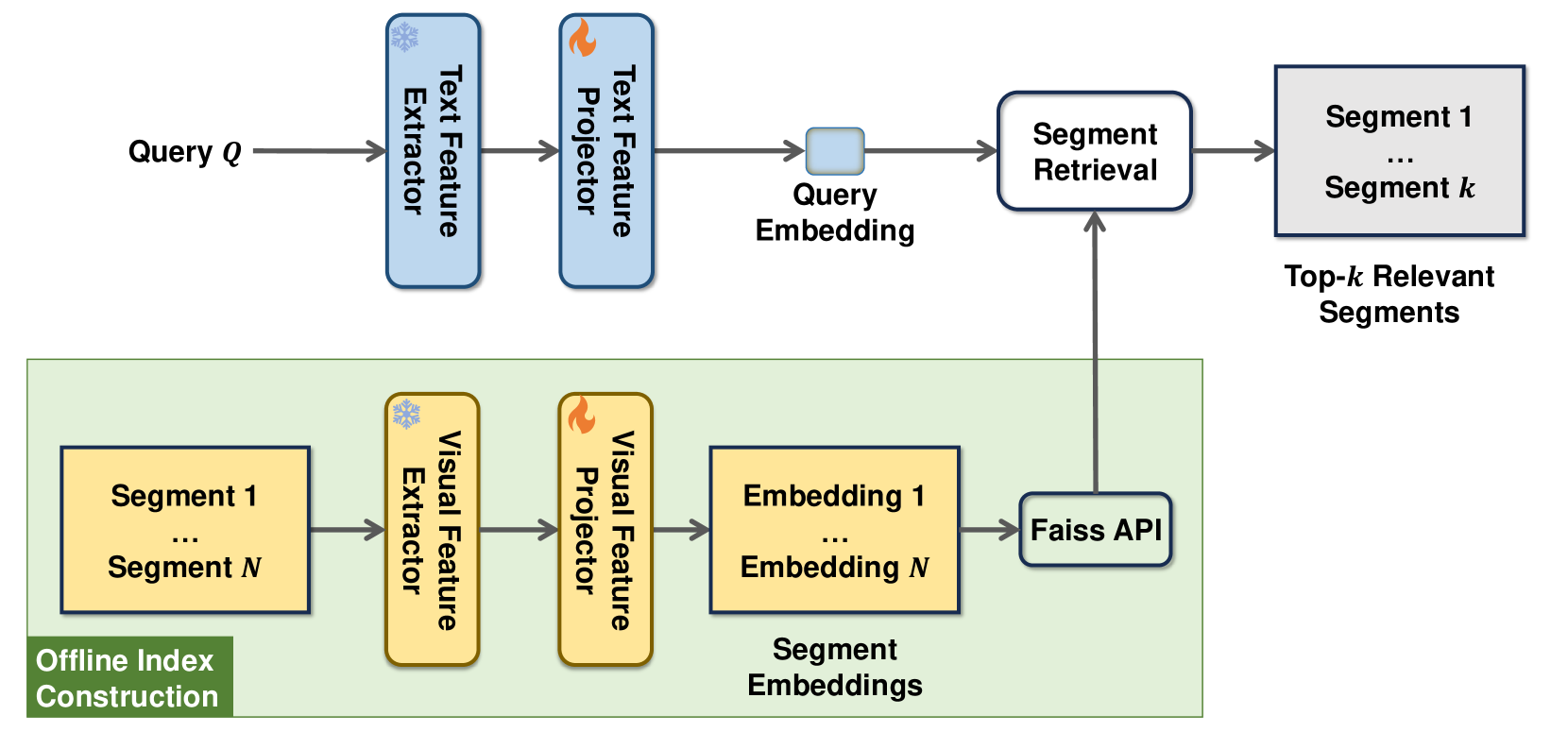

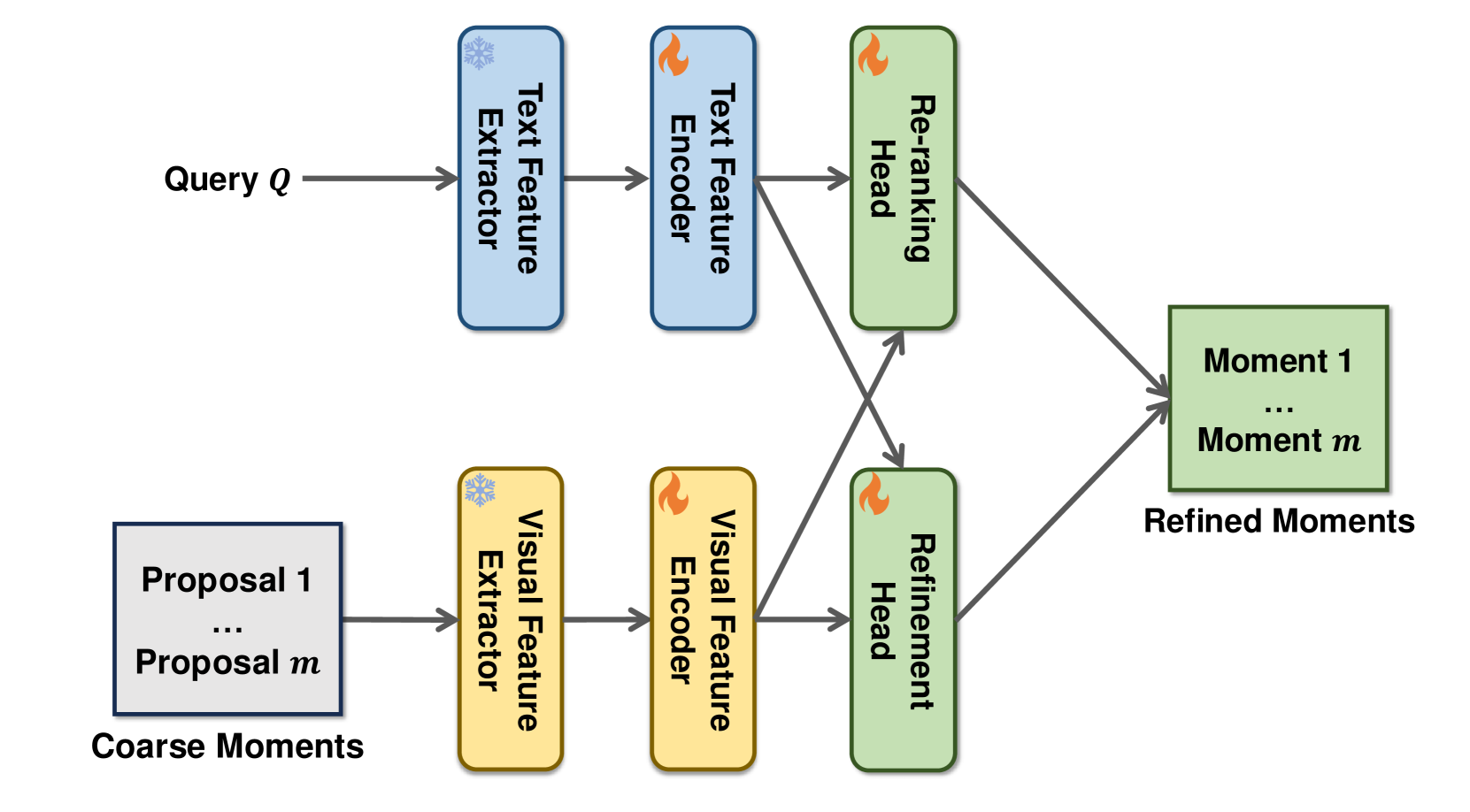

技术框架:SPR框架包含以下三个主要阶段: 1. 片段检索:将视频分割成等长片段,预先计算片段的嵌入向量,并构建离线索引。使用近似最近邻搜索(ANN)在共享特征空间中检索与文本查询最相关的片段。 2. 候选片段生成:将检索到的片段合并成粗粒度的候选片段。这一步旨在将相邻的、相关的片段组合在一起,形成更完整的视频片段候选。 3. 片段优化与重排序:使用优化模块对候选片段的时间戳进行调整,并根据相关性对候选片段进行重排序。该模块旨在提高片段的精确度和排序质量。

关键创新:SPR框架的关键创新在于其模块化和可扩展的设计。将检索过程分解为独立的阶段,允许针对每个阶段进行单独的优化和改进。此外,通过预计算片段嵌入和使用近似最近邻搜索,实现了高效的片段检索,使其能够处理长视频和大规模视频库。

关键设计: * 片段嵌入:使用预训练的视频和文本编码器(例如,CLIP)将视频片段和文本查询投影到共享特征空间。 * 近似最近邻搜索(ANN):使用诸如FAISS之类的库来构建片段嵌入的索引,并执行高效的近似最近邻搜索。 * 片段合并策略:设计合理的策略来合并相邻的、相关的片段,以生成粗粒度的候选片段。 * 优化模块:使用回归模型或排序模型来调整候选片段的时间戳和排序。

🖼️ 关键图片

📊 实验亮点

SPR框架在TVR-Ranking数据集上取得了state-of-the-art的性能,并且显著降低了计算成本和处理时间。具体来说,SPR框架在R@1指标上超越了之前的最佳方法,并且在处理长视频时具有更高的效率。实验结果表明,SPR框架具有良好的可扩展性和鲁棒性。

🎯 应用场景

该研究成果可应用于视频内容搜索、智能视频编辑、视频推荐系统等领域。例如,用户可以通过文本描述快速找到视频中感兴趣的片段,视频编辑人员可以利用该技术快速定位到需要编辑的场景,视频平台可以根据用户的搜索历史推荐相关的视频片段。该技术在大规模视频数据分析和理解方面具有重要的应用价值。

📄 摘要(原文)

Video moment search, the process of finding relevant moments in a video corpus to match a user's query, is crucial for various applications. Existing solutions, however, often assume a single perfect matching moment, struggle with inefficient inference, and have limitations with hour-long videos. This paper introduces a flexible and scalable framework for retrieving a ranked list of moments from collection of videos in any length to match a text query, a task termed Ranked Video Moment Retrieval (RVMR). Our framework, called Segment-Proposal-Ranking (SPR), simplifies the search process into three independent stages: segment retrieval, proposal generation, and moment refinement with re-ranking. Specifically, videos are divided into equal-length segments with precomputed embeddings indexed offline, allowing efficient retrieval regardless of video length. For scalable online retrieval, both segments and queries are projected into a shared feature space to enable approximate nearest neighbor (ANN) search. Retrieved segments are then merged into coarse-grained moment proposals. Then a refinement and re-ranking module is designed to reorder and adjust timestamps of the coarse-grained proposals. Evaluations on the TVR-Ranking dataset demonstrate that our framework achieves state-of-the-art performance with significant reductions in computational cost and processing time. The flexible design also allows for independent improvements to each stage, making SPR highly adaptable for large-scale applications.