Scalable Cosmic AI Inference using Cloud Serverless Computing

作者: Mills Staylor, Amirreza Dolatpour Fathkouhi, Md Khairul Islam, Kaleigh O'Hara, Ryan Ghiles Goudjil, Geoffrey Fox, Judy Fox

分类: cs.CV, astro-ph.IM

发布日期: 2025-01-08 (更新: 2025-10-09)

🔗 代码/项目: GITHUB

💡 一句话要点

提出CAI框架,利用云端Serverless计算加速宇宙学AI推断,降低成本。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 宇宙学 天文图像处理 深度学习 Serverless计算 云计算 红移预测 AI推理

📋 核心要点

- 现有深度学习天文图像处理方法计算资源需求大,限制了其可访问性,难以满足大规模数据处理的需求。

- CAI框架利用云端Serverless计算,结合预训练基础模型,实现高效、可扩展且低成本的天文图像推断。

- 实验表明,CAI在红移预测任务中,速度远超HPC,成本极低,并能有效处理TB级数据。

📝 摘要(中文)

大规模天文图像数据处理和预测对于天文学家至关重要,能够提供关于天体、宇宙历史和演化的关键见解。虽然现代深度学习模型提供了高预测精度,但它们通常需要大量的计算资源,这使得它们资源密集且限制了可访问性。我们引入了基于云的天文学推断(CAI)框架来应对这些挑战。这种可扩展的解决方案通过函数即服务(FaaS)将预训练的基础模型与serverless云基础设施集成。CAI能够在没有大量硬件的情况下对天文图像进行高效且可扩展的推断。以红移预测的基础模型为例,我们进行了广泛的实验,涵盖用户设备、高性能计算(HPC)服务器和云。使用AstroMAE模型进行红移预测证明了CAI的可扩展性和效率,在仅28秒内完成了对12.6 GB数据集的推断,而HPC GPU需要140.8秒,HPC CPU需要1793秒。CAI还实现了显著更高的吞吐量,达到每秒18.04亿比特(bps),并且随着数据大小的增加,保持了近乎恒定的推断时间,所有这些都以最小的计算成本(每次实验低于5美元)实现。我们还处理了高达1 TB的大规模数据,以展示CAI在大规模数据上的有效性。因此,CAI为天文学界提供了一种高度可扩展、可访问且经济高效的推断解决方案。代码可在https://github.com/UVA-MLSys/AI-for-Astronomy 获取。

🔬 方法详解

问题定义:论文旨在解决大规模天文图像数据处理和预测中,深度学习模型计算资源需求高、可访问性受限的问题。现有方法通常依赖于昂贵的硬件设施(如高性能GPU服务器),这限制了研究人员的使用,尤其是在资源有限的情况下。此外,传统HPC环境在处理突发的大规模数据时,可能面临扩展性和效率瓶颈。

核心思路:论文的核心思路是利用云端Serverless计算的弹性伸缩能力,结合预训练的基础模型,构建一个可扩展、高效且低成本的天文图像推断框架。通过将计算任务分解为独立的函数,并由云平台自动管理资源分配,可以避免传统硬件设施的限制,并实现按需付费,从而降低成本。

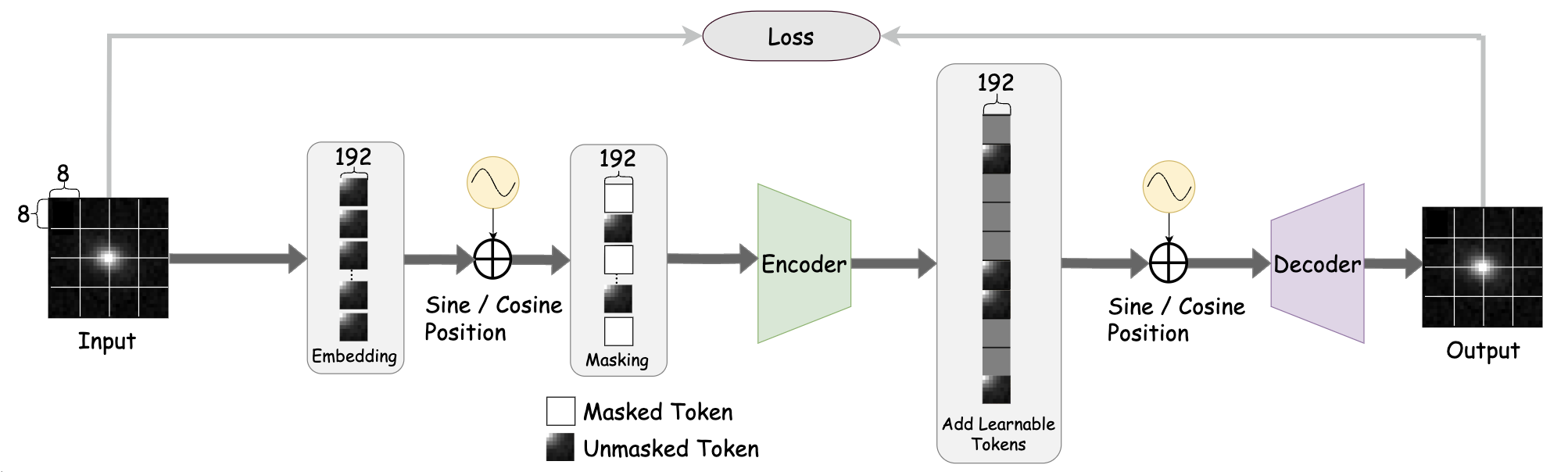

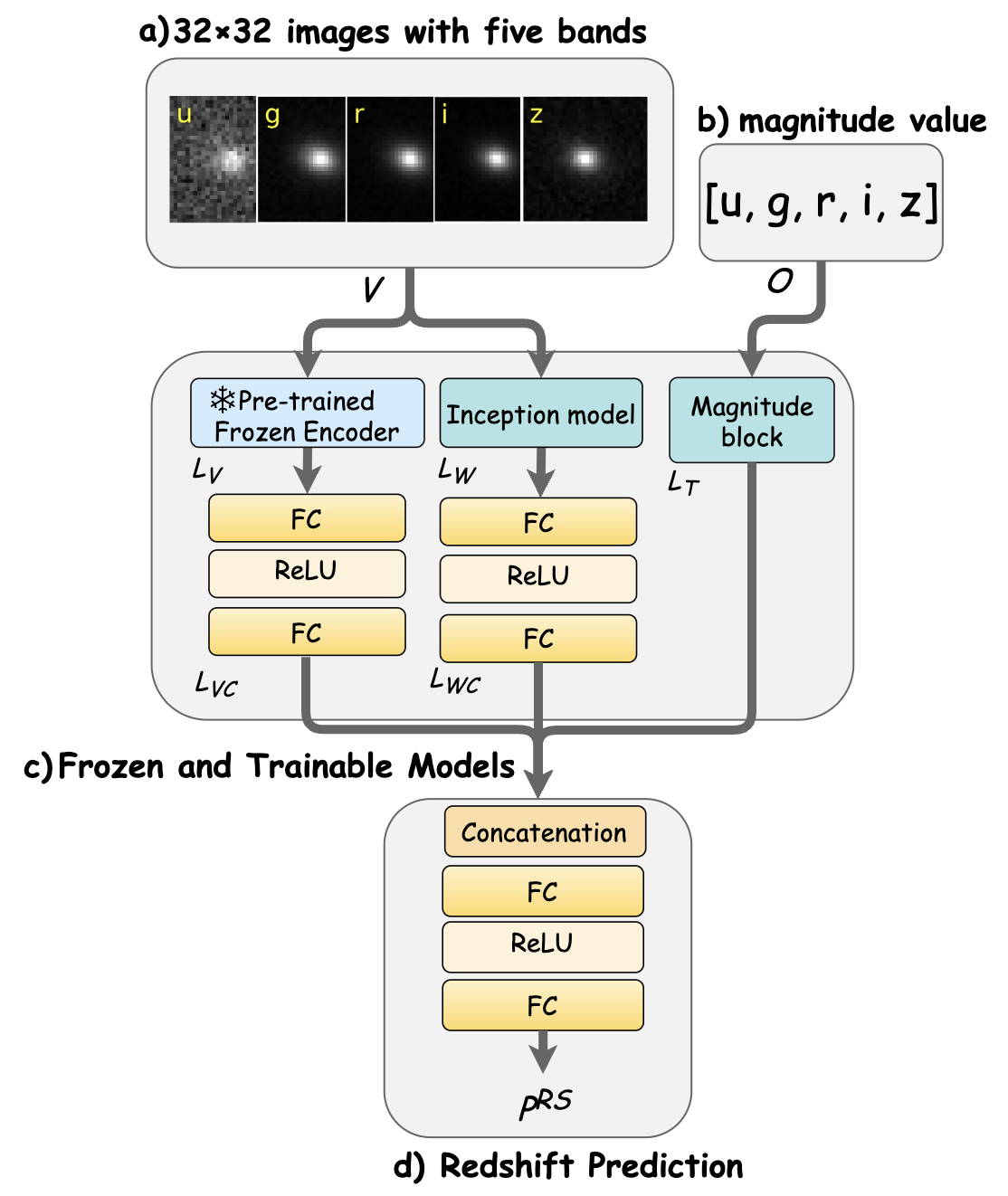

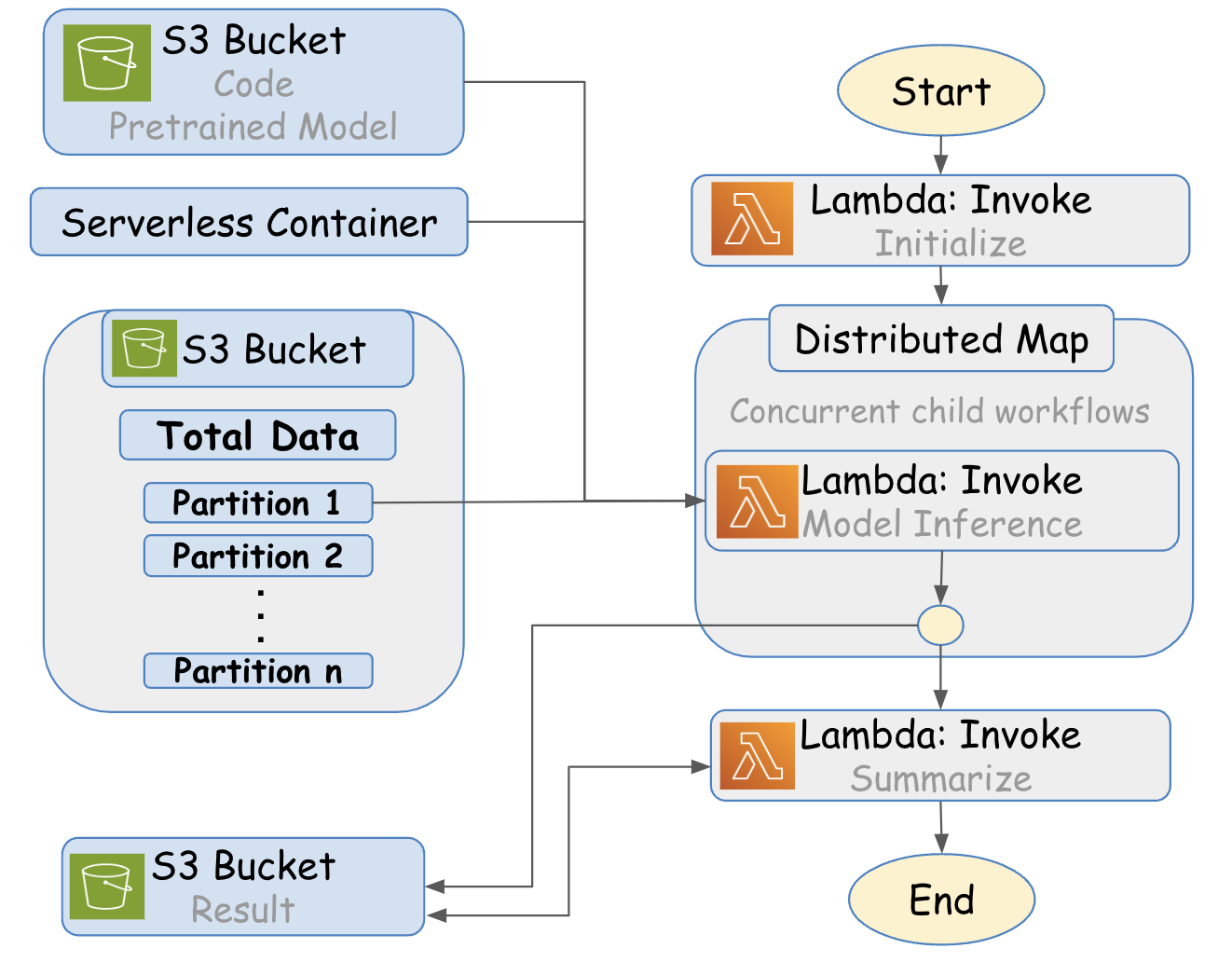

技术框架:CAI框架的核心是Function-as-a-Service (FaaS)架构。研究人员将预训练的深度学习模型(例如AstroMAE)部署为云函数,并利用云平台的事件触发机制,对天文图像数据进行推断。整体流程包括:数据上传至云存储、云函数被触发、模型加载并执行推断、结果存储。框架的关键组件包括:预训练基础模型、Serverless计算平台(例如AWS Lambda、Google Cloud Functions)、云存储服务。

关键创新:CAI框架的关键创新在于将预训练的基础模型与Serverless计算相结合,为天文图像处理提供了一种新的解决方案。与传统的HPC方法相比,CAI具有更高的可扩展性、更低的成本和更好的易用性。此外,CAI框架能够自动管理资源分配,无需人工干预,从而简化了部署和维护过程。

关键设计:论文中没有详细描述具体的参数设置或网络结构,因为重点在于框架的设计和性能评估。关键设计在于如何优化云函数的部署和执行,以实现最佳的性能和成本效益。例如,可以通过调整云函数的内存大小、并发数等参数,来优化推断速度和资源利用率。此外,还可以利用云平台的缓存机制,减少模型加载时间,提高整体效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CAI框架在红移预测任务中表现出色。在12.6 GB数据集上,CAI仅用28秒完成推断,而HPC GPU需要140.8秒,HPC CPU需要1793秒。CAI的吞吐量高达18.04 Gbps,且成本极低,每次实验低于5美元。此外,CAI能够有效处理高达1TB的大规模数据,证明了其在大规模数据处理方面的能力。

🎯 应用场景

CAI框架可广泛应用于天文图像处理领域,例如星系分类、红移预测、宇宙学参数估计等。该框架能够帮助天文学家更高效地处理大规模天文数据,加速科学发现。此外,CAI框架的Serverless架构也为其他科学计算领域提供了借鉴,例如基因组学、气候模拟等。

📄 摘要(原文)

Large-scale astronomical image data processing and prediction are essential for astronomers, providing crucial insights into celestial objects, the universe's history, and its evolution. While modern deep learning models offer high predictive accuracy, they often demand substantial computational resources, making them resource-intensive and limiting accessibility. We introduce the Cloud-based Astronomy Inference (CAI) framework to address these challenges. This scalable solution integrates pre-trained foundation models with serverless cloud infrastructure through a Function-as-a-Service (FaaS). CAI enables efficient and scalable inference on astronomical images without extensive hardware. Using a foundation model for redshift prediction as a case study, our extensive experiments cover user devices, HPC (High-Performance Computing) servers, and Cloud. Using redshift prediction with the AstroMAE model demonstrated CAI's scalability and efficiency, achieving inference on a 12.6 GB dataset in only 28 seconds compared to 140.8 seconds on HPC GPUs and 1793 seconds on HPC CPUs. CAI also achieved significantly higher throughput, reaching 18.04 billion bits per second (bps), and maintained near-constant inference times as data sizes increased, all at minimal computational cost (under $5 per experiment). We also process large-scale data up to 1 TB to show CAI's effectiveness at scale. CAI thus provides a highly scalable, accessible, and cost-effective inference solution for the astronomy community. The code is accessible at https://github.com/UVA-MLSys/AI-for-Astronomy.