SMIR: Efficient Synthetic Data Pipeline To Improve Multi-Image Reasoning

作者: Andrew Li, Rahul Thapa, Rahul Chalamala, Qingyang Wu, Kezhen Chen, James Zou

分类: cs.CV

发布日期: 2025-01-07 (更新: 2025-02-15)

💡 一句话要点

SMIR:高效合成数据流水线提升多图推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多图推理 合成数据 视觉语言模型 数据生成流水线 多模态学习

📋 核心要点

- 现有方法在多图推理数据集构建上存在资源消耗大和缺乏有效评估基准的挑战。

- SMiR通过多模态嵌入提取相关图像,整合视觉和描述信息,并利用LLM生成高质量指令,高效构建数据集。

- SMiR生成了16万合成样本,并提出了SMiR-Bench基准,实验证明了其在提升开源VLM多图推理能力上的有效性。

📝 摘要(中文)

视觉-语言模型(VLM)在理解单张图像方面表现出色,这得益于高质量的指令数据集。然而,由于两个关键挑战,多图推理在开源社区中仍未得到充分探索:(1)扩展具有相关图像和复杂推理指令的数据集需要大量资源,(2)缺乏用于多图任务的鲁棒评估基准。为了解决这些问题,我们引入了SMiR,一个用于多图推理的合成数据生成流水线,以及使用该流水线生成的高质量数据集。SMiR通过多模态嵌入高效地提取相关图像,整合视觉和描述信息,并利用开源LLM生成高质量指令。使用这种方法,我们生成了16万个合成训练样本,为闭源解决方案提供了一种经济高效的替代方案。此外,我们还提出了SMiR-Bench,一个多图推理基准,包含200个跨越七个复杂推理任务的多样化示例。SMiR-Bench是多轮的,并采用VLM评判器来评估自由形式的响应,从而全面评估模型在跨模态中的表达能力和推理能力。我们通过微调开源VLM并在SMiR-Bench上评估它们来证明SMiR的有效性。

🔬 方法详解

问题定义:论文旨在解决多图推理任务中数据集构建困难和评估基准不足的问题。现有方法构建多图推理数据集成本高昂,且缺乏有效的评估方法来衡量模型的多模态推理能力。

核心思路:论文的核心思路是利用合成数据生成流水线SMiR,高效地生成大规模、高质量的多图推理数据集。通过结合多模态嵌入、视觉信息和LLM,SMiR能够自动创建包含相关图像和复杂推理指令的训练样本,从而降低数据集构建成本。

技术框架:SMiR流水线主要包含以下几个阶段:1) 图像提取:使用多模态嵌入从大规模图像库中提取相关图像;2) 信息整合:整合图像的视觉信息和描述信息;3) 指令生成:利用开源LLM生成高质量的推理指令;4) 数据集构建:将生成的图像和指令组合成训练样本。此外,论文还提出了SMiR-Bench,一个用于评估多图推理能力的基准测试。

关键创新:SMiR的关键创新在于其高效的合成数据生成方法,该方法能够以较低的成本生成大规模、高质量的多图推理数据集。与传统的手动标注方法相比,SMiR能够显著降低数据集构建成本,并提高数据集的多样性和复杂性。此外,SMiR-Bench提供了一个全面的评估基准,能够更准确地衡量模型的多模态推理能力。

关键设计:在图像提取阶段,使用了预训练的多模态嵌入模型来计算图像之间的相似度,从而提取相关图像。在指令生成阶段,使用了开源LLM,并对其进行了微调,以生成更符合多图推理任务需求的指令。SMiR-Bench采用了多轮对话的形式,并使用VLM作为评判器,以更全面地评估模型的推理能力。

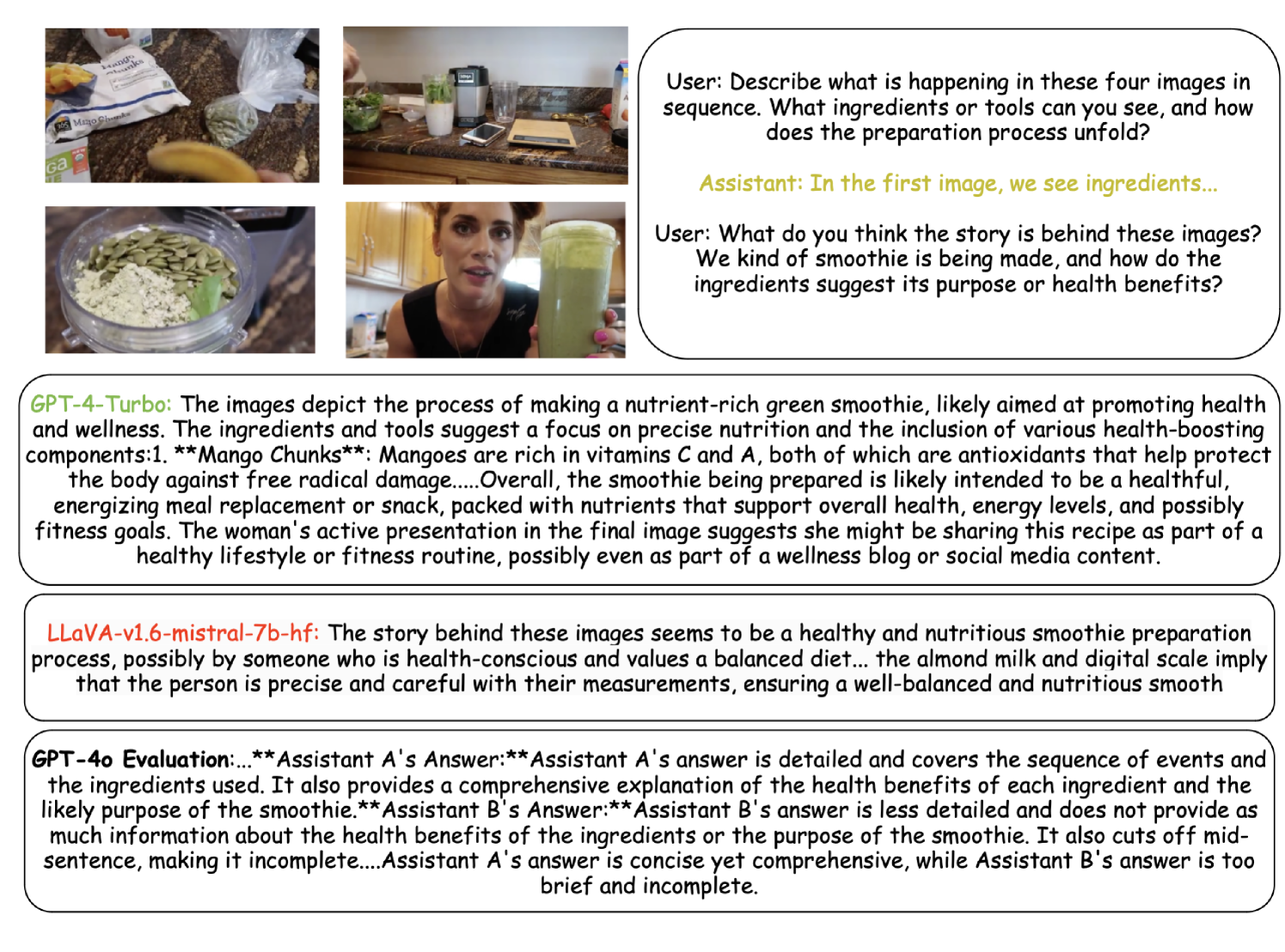

🖼️ 关键图片

📊 实验亮点

论文通过SMiR生成了16万个合成训练样本,并在SMiR-Bench上评估了微调后的开源VLM。实验结果表明,使用SMiR生成的数据集能够显著提升VLM的多图推理能力。具体性能数据未知,但论文强调了SMiR在成本效益方面的优势,为开源社区提供了一种可行的多图推理模型训练方案。

🎯 应用场景

该研究成果可应用于智能问答、视觉对话、机器人导航等领域。通过使用SMiR生成的数据集训练VLM,可以提升模型在复杂场景下的多图推理能力,从而实现更智能的人机交互和更高效的决策制定。未来,该方法可以扩展到其他多模态推理任务,例如视频理解和跨模态检索。

📄 摘要(原文)

Vision-Language Models (VLMs) excel at understanding single images, aided by high-quality instruction datasets. However, multi-image reasoning remains underexplored in the open-source community due to two key challenges: (1) scaling datasets with correlated images and complex reasoning instructions is resource-intensive, and (2) robust evaluation benchmarks for multi-image tasks are lacking. To address this, we introduce SMiR, a synthetic data-generation pipeline for multi-image reasoning, along with a high-quality dataset generated using this pipeline. SMiR efficiently extracts correlated images via multimodal embeddings, integrates visual and descriptive information, and leverages open-source LLMs to generate quality instructions. Using this approach, we produce 160K synthetic training samples, offering a cost-effective alternative to closed-source solutions. Additionally, we present SMiR-Bench, a multi-image reasoning benchmark comprising 200 diverse examples across seven complex reasoning tasks. SMiR-Bench is multi-turn and employs a VLM judge to evaluate free-form responses, providing a comprehensive assessment of model expressiveness and reasoning capability across modalities. We demonstrate the effectiveness of SMiR by fine-tuning open-source VLMs and evaluating them on SMiR-Bench.