DehazeGS: Seeing Through Fog with 3D Gaussian Splatting

作者: Jinze Yu, Yiqun Wang, Aiheng Jiang, Zhengda Lu, Jianwei Guo, Yong Li, Hongxing Qin, Xiaopeng Zhang

分类: cs.CV

发布日期: 2025-01-07 (更新: 2025-12-02)

备注: 9 pages,5 figures. Accepted by AAAI2026. visualizations are available at https://dehazegs.github.io/

💡 一句话要点

提出DehazeGS,利用3D高斯溅射实现雾天图像的去雾和高质量新视角合成。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 去雾 新视角合成 3D高斯溅射 大气散射模型 显式表达 雾天场景 图像重建

📋 核心要点

- 现有NeRF去雾方法计算成本高,且隐式表示限制了细节恢复能力。

- DehazeGS利用显式高斯表示,通过物理前向渲染模拟雾天图像形成。

- 实验表明,DehazeGS在真实和合成雾天数据集上均达到SOTA性能。

📝 摘要(中文)

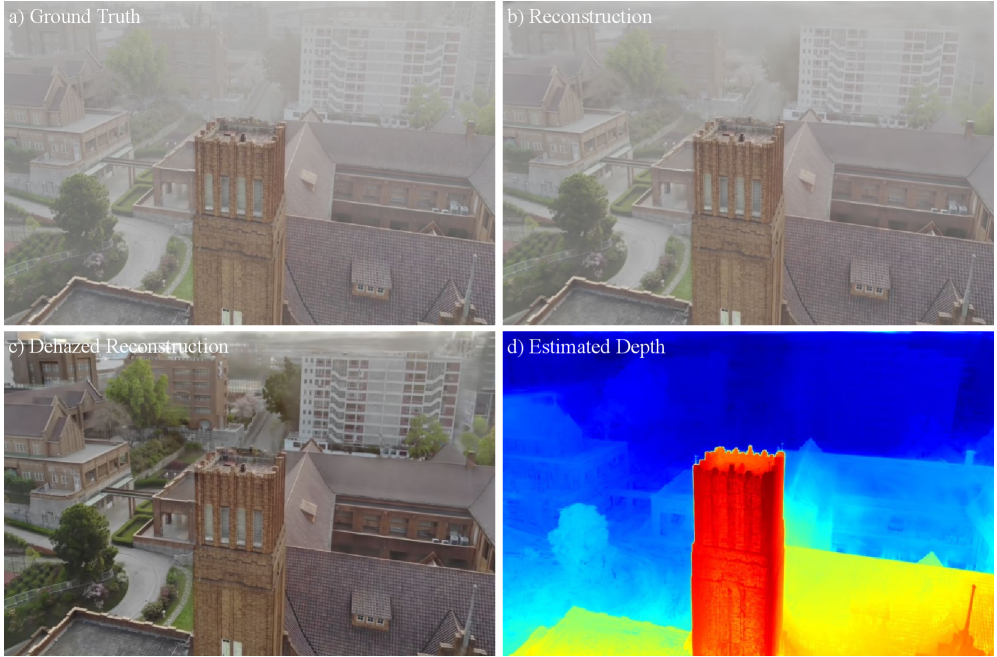

当前的新视角合成方法通常针对高质量和清晰的输入图像设计。然而,在雾天场景中,散射和衰减会显著降低渲染质量。虽然已经开发了基于NeRF的去雾方法,但它们依赖于深度全连接神经网络和逐射线采样策略,导致计算成本高昂。此外,NeRF的隐式表示限制了其从雾霾场景中恢复精细细节的能力。为了克服这些限制,我们提出学习一种显式高斯表示,通过物理前向渲染过程来解释雾天图像的形成机制。我们的方法DehazeGS仅使用多视角雾天图像作为输入,重建和渲染无雾场景。具体而言,基于大气散射模型,我们通过深度到透射率的映射,直接在高斯基元上建立透射函数来模拟雾的形成。在训练过程中,我们联合学习大气光和散射系数,同时优化雾天场景的高斯表示。在推理时,我们消除高斯分布中散射和衰减的影响,并直接渲染场景以获得去雾视图。在真实和合成雾天数据集上的实验表明,DehazeGS实现了最先进的性能。

🔬 方法详解

问题定义:论文旨在解决雾天场景下新视角合成质量差的问题。现有基于NeRF的去雾方法计算量大,且NeRF的隐式表达难以恢复雾天场景中的精细细节。因此,如何高效且高质量地从雾天图像中重建场景并合成新视角是本论文要解决的核心问题。

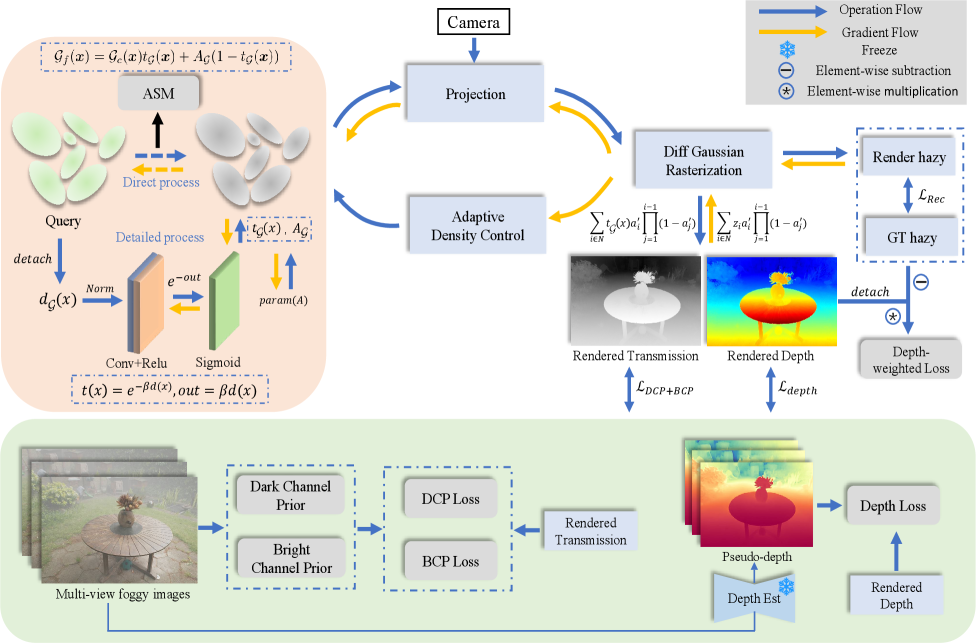

核心思路:论文的核心思路是利用3D高斯溅射(3D Gaussian Splatting)的显式表达能力,结合大气散射模型,直接在高斯基元上模拟雾的形成和去除过程。通过显式地建模雾的透射率和散射效应,可以更有效地进行去雾和新视角合成。

技术框架:DehazeGS的整体框架包括以下几个主要步骤:1) 输入多视角的雾天图像;2) 初始化3D高斯分布;3) 基于大气散射模型,建立深度到透射率的映射,将透射函数直接作用于高斯基元;4) 联合优化高斯分布的参数、大气光和散射系数;5) 在推理阶段,消除散射和衰减的影响,渲染去雾后的新视角图像。

关键创新:DehazeGS的关键创新在于将3D高斯溅射与大气散射模型相结合,实现了显式的雾天建模和去雾。与NeRF等隐式表达方法相比,高斯溅射具有更快的渲染速度和更强的细节表达能力。此外,直接在高斯基元上建立透射函数,避免了复杂的射线采样过程,提高了计算效率。

关键设计:论文的关键设计包括:1) 使用深度信息估计每个高斯基元的透射率;2) 设计损失函数,联合优化高斯分布参数、大气光和散射系数,包括L1损失、SSIM损失和深度损失等;3) 使用自适应密度控制策略,动态调整高斯基元的数量,以更好地重建场景。

🖼️ 关键图片

📊 实验亮点

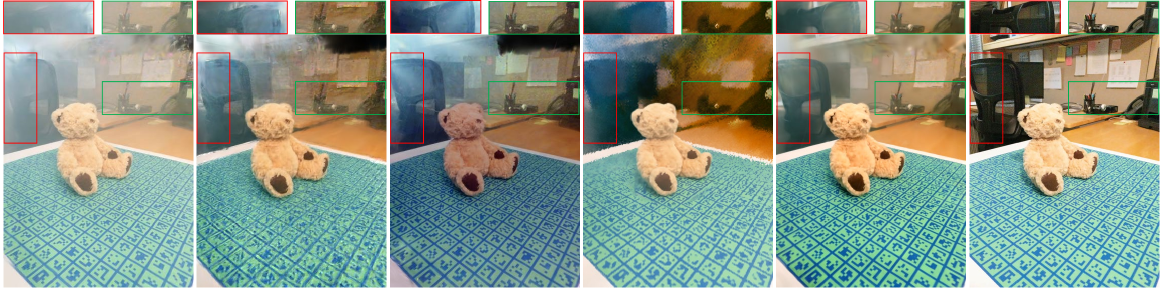

DehazeGS在合成和真实雾天数据集上均取得了SOTA性能。例如,在合成数据集上,DehazeGS的PSNR指标相比于基线方法提升了2-3dB。在真实数据集上,DehazeGS能够生成更清晰、更真实的去雾图像,并且在细节恢复方面表现更佳。此外,DehazeGS的渲染速度也远快于基于NeRF的方法。

🎯 应用场景

DehazeGS在自动驾驶、机器人导航、安防监控等领域具有广泛的应用前景。在这些场景中,雾天会严重影响视觉系统的性能。通过DehazeGS,可以有效去除雾霾,提高视觉系统的感知能力,从而提升系统的安全性和可靠性。此外,该方法还可以应用于文化遗产的数字化保护,恢复受雾霾影响的历史照片和视频。

📄 摘要(原文)

Current novel view synthesis methods are typically designed for high-quality and clean input images. However, in foggy scenes, scattering and attenuation can significantly degrade the quality of rendering. Although NeRF-based dehazing approaches have been developed, their reliance on deep fully connected neural networks and per-ray sampling strategies leads to high computational costs. Furthermore, NeRF's implicit representation limits its ability to recover fine-grained details from hazy scenes. To overcome these limitations, we propose learning an explicit Gaussian representation to explain the formation mechanism of foggy images through a physically forward rendering process. Our method, DehazeGS, reconstructs and renders fog-free scenes using only multi-view foggy images as input. Specifically, based on the atmospheric scattering model, we simulate the formation of fog by establishing the transmission function directly onto Gaussian primitives via depth-to-transmission mapping. During training, we jointly learn the atmospheric light and scattering coefficients while optimizing the Gaussian representation of foggy scenes. At inference time, we remove the effects of scattering and attenuation in Gaussian distributions and directly render the scene to obtain dehazed views. Experiments on both real-world and synthetic foggy datasets demonstrate that DehazeGS achieves state-of-the-art performance. visualizations are available at https://dehazegs.github.io/