HaWoR: World-Space Hand Motion Reconstruction from Egocentric Videos

作者: Jinglei Zhang, Jiankang Deng, Chao Ma, Rolandos Alexandros Potamias

分类: cs.CV

发布日期: 2025-01-06

💡 一句话要点

HaWoR:提出一种从第一视角视频重建世界坐标系下手部运动的高保真方法

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 手部运动重建 第一视角视频 SLAM 相机轨迹估计 运动填充 三维重建 人机交互

📋 核心要点

- 现有3D手部姿态估计方法主要关注相机坐标系下的单帧重建,忽略了第一视角视频中手部在世界坐标系中的运动。

- HaWoR通过解耦手部运动重建和相机轨迹估计,在相机坐标系中重建手部运动,并在世界坐标系中估计相机轨迹。

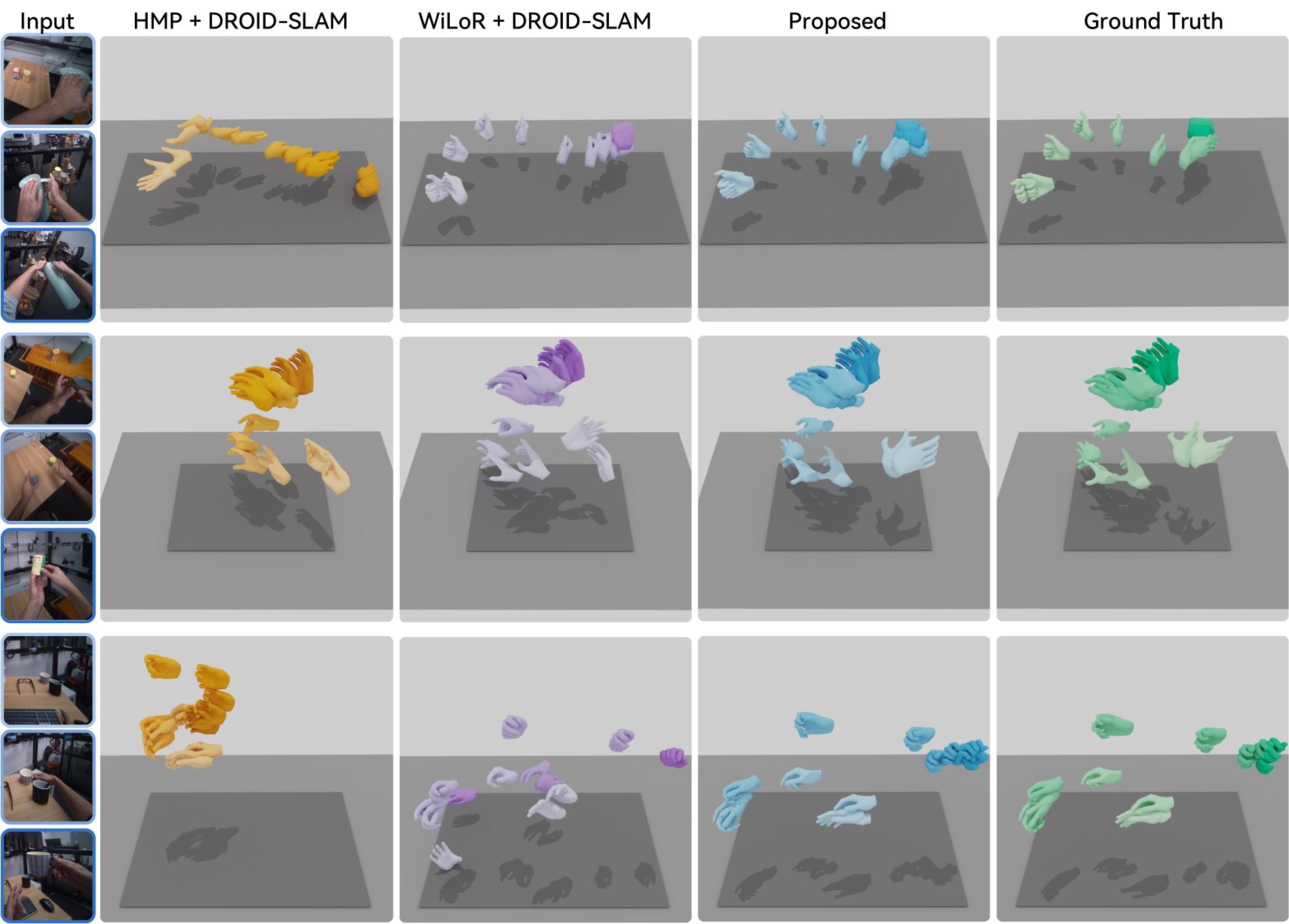

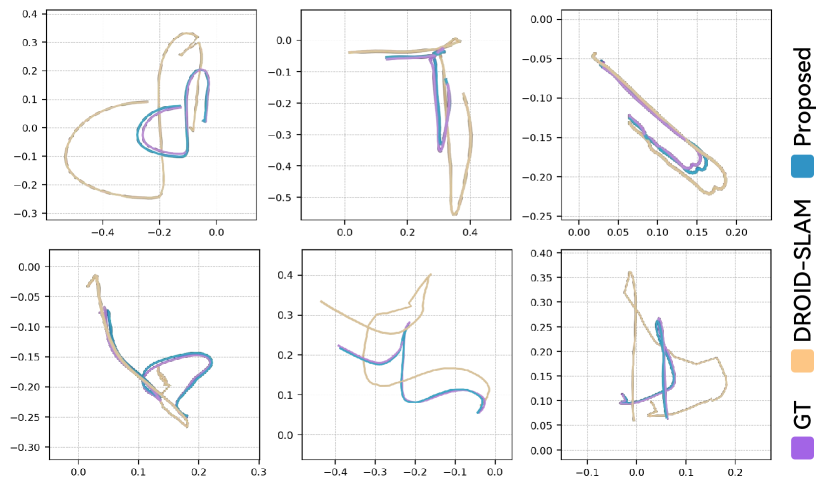

- 实验结果表明,HaWoR在手部运动重建和世界坐标系相机轨迹估计方面均达到了当前最优性能。

📝 摘要(中文)

尽管3D手部姿态估计取得了进展,但当前方法主要集中于相机坐标系下的单图像3D手部重建,忽略了手在世界坐标系中的运动。这种局限性阻碍了它们在第一视角视频设置中的直接应用,因为在第一视角视频中,手和相机都在持续运动。本文提出了HaWoR,一种从第一视角视频重建世界坐标系下手部运动的高保真方法。我们通过解耦任务来实现这一目标,即在相机坐标系中重建手部运动,并在世界坐标系中估计相机轨迹。为了实现精确的相机轨迹估计,我们提出了一个自适应的第一视角SLAM框架,该框架解决了传统SLAM方法的缺点,在具有挑战性的相机动态下提供了鲁棒的性能。为了确保鲁棒的手部运动轨迹,即使手移出视野范围,我们设计了一种新颖的运动填充网络,有效地完成了序列中缺失的帧。通过广泛的定量和定性评估,我们证明了HaWoR在不同的第一视角基准数据集下手部运动重建和世界坐标系相机轨迹估计方面都达到了最先进的性能。

🔬 方法详解

问题定义:论文旨在解决从第一视角视频中重建世界坐标系下手部运动的问题。现有方法主要集中于相机坐标系下的单帧手部姿态估计,无法直接应用于手和相机都在运动的第一视角视频场景。传统SLAM方法在具有挑战性的相机动态下表现不佳,手部运动超出视野范围时,重建轨迹容易中断。

核心思路:论文的核心思路是将问题解耦为两个子问题:相机坐标系下的手部运动重建和世界坐标系下的相机轨迹估计。通过分别解决这两个问题,可以更有效地重建世界坐标系下的手部运动。这种解耦策略允许针对每个子问题设计专门的解决方案,从而提高整体性能。

技术框架:HaWoR的整体框架包含两个主要模块:自适应第一视角SLAM框架和运动填充网络。首先,自适应SLAM框架用于估计相机在世界坐标系中的轨迹。然后,使用现有的手部姿态估计方法在相机坐标系中重建手部运动。最后,运动填充网络用于填充手部运动轨迹中缺失的帧,从而获得完整的手部运动轨迹。

关键创新:论文的关键创新在于提出了自适应第一视角SLAM框架和运动填充网络。自适应SLAM框架能够应对具有挑战性的相机动态,提供更准确的相机轨迹估计。运动填充网络能够有效地填充手部运动轨迹中缺失的帧,从而获得更完整的手部运动轨迹。

关键设计:自适应SLAM框架可能包含自适应调整的关键帧选择策略,以应对快速的相机运动。运动填充网络可能采用基于Transformer或LSTM的序列模型,利用上下文信息预测缺失的帧。损失函数可能包含重建损失和运动平滑损失,以确保重建的手部运动轨迹的准确性和平滑性。具体的网络结构和参数设置在论文中应该有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

HaWoR在多个第一视角基准数据集上取得了state-of-the-art的性能。具体的数据提升幅度未知,但摘要中强调了在手部运动重建和世界坐标系相机轨迹估计两方面均优于现有方法。实验结果证明了HaWoR在处理具有挑战性的相机动态和手部遮挡等问题上的有效性。

🎯 应用场景

该研究成果可应用于虚拟现实(VR)、增强现实(AR)、人机交互等领域。例如,在VR游戏中,可以利用该技术重建用户的手部运动,实现更自然、更沉浸式的交互体验。在机器人控制领域,可以利用该技术使机器人能够理解和模仿人类的手部动作,从而实现更智能的协作。

📄 摘要(原文)

Despite the advent in 3D hand pose estimation, current methods predominantly focus on single-image 3D hand reconstruction in the camera frame, overlooking the world-space motion of the hands. Such limitation prohibits their direct use in egocentric video settings, where hands and camera are continuously in motion. In this work, we propose HaWoR, a high-fidelity method for hand motion reconstruction in world coordinates from egocentric videos. We propose to decouple the task by reconstructing the hand motion in the camera space and estimating the camera trajectory in the world coordinate system. To achieve precise camera trajectory estimation, we propose an adaptive egocentric SLAM framework that addresses the shortcomings of traditional SLAM methods, providing robust performance under challenging camera dynamics. To ensure robust hand motion trajectories, even when the hands move out of view frustum, we devise a novel motion infiller network that effectively completes the missing frames of the sequence. Through extensive quantitative and qualitative evaluations, we demonstrate that HaWoR achieves state-of-the-art performance on both hand motion reconstruction and world-frame camera trajectory estimation under different egocentric benchmark datasets. Code and models are available on https://hawor-project.github.io/ .