Spiking monocular event based 6D pose estimation for space application

作者: Jonathan Courtois, Benoît Miramond, Alain Pegatoquet

分类: cs.CV, cs.LG

发布日期: 2025-01-06

备注: 6 pages, 2 figures, 1 table. This paper has been presented in the Thursday 19 September poster session at the SPAICE 2024 conference (17-19 September 2024)

期刊: SPAICE2024: The First Joint European Space Agency / IAA Conference on AI in and for Space, 394-399, 2024

💡 一句话要点

提出基于脉冲神经网络的单目事件相机6D位姿估计方法,用于空间应用

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 脉冲神经网络 6D位姿估计 空间应用 在轨服务 主动碎片移除 低功耗 SEENIC数据集

📋 核心要点

- 现有航天器位姿估计算法精度有待提高,且传统方法功耗较高,难以满足空间应用需求。

- 提出一种完全基于事件的解决方案,利用脉冲神经网络和事件相机,旨在降低功耗并提升位姿估计效率。

- 在SEENIC数据集上验证了所提方法,小型脉冲神经网络S2E2实现了较好的位姿估计结果,为后续研究奠定基础。

📝 摘要(中文)

随着在轨服务(OOS)和主动碎片移除(ADR)任务的日益增长,航天器位姿估计算法正被开发,利用深度学习来提高这项复杂任务的精度,并找到最有效的解决方案。 随着生物启发式低功耗解决方案(如脉冲神经网络和基于事件的处理和相机)的进步,以及它们最近在空间应用方面的工作,我们建议研究一种完全基于事件的解决方案的可行性,以改进基于事件的航天器位姿估计。 在本文中,我们使用由事件相机在试验台上捕获的真实事件帧,处理了第一个基于事件的数据集SEENIC。 我们展示了这种用例的第一个基于事件的解决方案的方法和结果,其中我们的小型脉冲端到端网络(S2E2)解决方案实现了超过21厘米位置误差和14度旋转误差的有趣结果,这是实现用于嵌入式航天器位姿估计的完全基于事件的处理的第一步。

🔬 方法详解

问题定义:论文旨在解决航天器在轨服务和主动碎片移除任务中,利用低功耗、高效率的视觉方案进行精确6D位姿估计的问题。现有方法通常依赖于传统相机和深度学习,计算量大,功耗高,难以满足空间应用的资源约束。

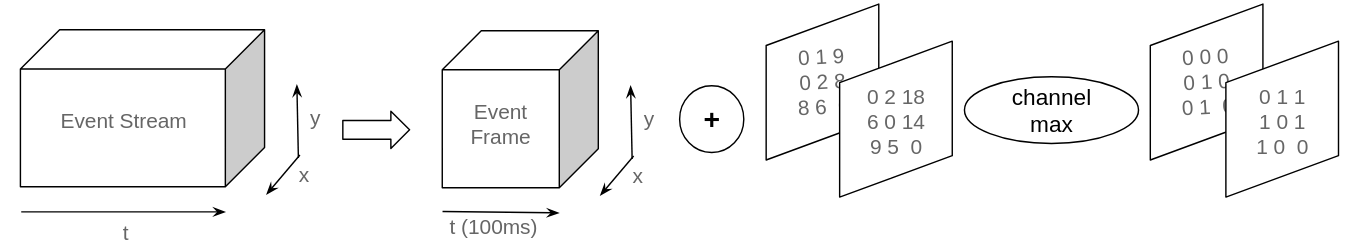

核心思路:论文的核心思路是利用事件相机和脉冲神经网络(SNN)的优势。事件相机仅在像素亮度发生变化时才产生数据,大幅降低数据量和功耗。SNN是一种生物启发式神经网络,具有低功耗、高并行性的特点,适合在资源受限的环境中部署。

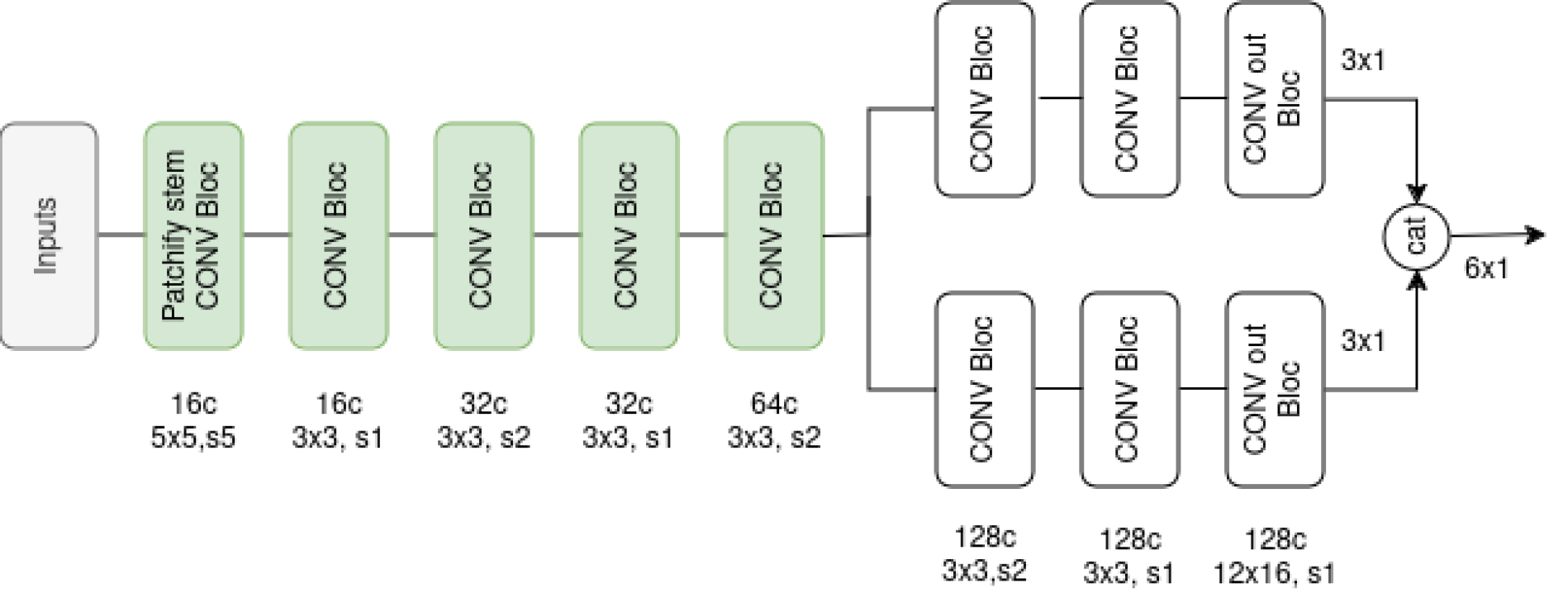

技术框架:论文提出了一个端到端的脉冲神经网络(S2E2)用于直接从事件数据估计6D位姿。整体流程包括:1)使用事件相机获取场景的事件流数据;2)将事件流数据输入到S2E2网络中;3)S2E2网络输出航天器的6D位姿估计结果。

关键创新:该研究的关键创新在于首次将脉冲神经网络和事件相机结合,应用于航天器6D位姿估计。与传统的基于帧的图像处理方法相比,该方法具有更低的功耗和更高的处理效率。此外,构建了首个基于事件的航天器位姿估计数据集SEENIC。

关键设计:S2E2网络是一个小型化的脉冲神经网络,具体网络结构未知。论文中没有详细描述损失函数和训练策略,但强调了端到端训练的重要性。关键在于如何有效地将事件数据编码为SNN可以处理的脉冲信号,以及如何设计SNN的网络结构以提取有效的位姿信息。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

论文在SEENIC数据集上进行了实验,结果表明,所提出的S2E2网络能够实现较好的位姿估计性能,位置误差优于21厘米,旋转误差优于14度。虽然性能指标还有提升空间,但这是首次基于事件相机和脉冲神经网络实现航天器位姿估计,为后续研究奠定了基础。

🎯 应用场景

该研究成果可应用于在轨服务(OOS)、主动碎片移除(ADR)等空间任务中,为航天器提供低功耗、高精度的位姿估计能力。该技术还有潜力应用于其他资源受限的场景,如无人机、机器人等,实现高效的视觉感知和导航。

📄 摘要(原文)

With the growing interest in on On-orbit servicing (OOS) and Active Debris Removal (ADR) missions, spacecraft poses estimation algorithms are being developed using deep learning to improve the precision of this complex task and find the most efficient solution. With the advances of bio-inspired low-power solutions, such a spiking neural networks and event-based processing and cameras, and their recent work for space applications, we propose to investigate the feasibility of a fully event-based solution to improve event-based pose estimation for spacecraft. In this paper, we address the first event-based dataset SEENIC with real event frames captured by an event-based camera on a testbed. We show the methods and results of the first event-based solution for this use case, where our small spiking end-to-end network (S2E2) solution achieves interesting results over 21cm position error and 14degree rotation error, which is the first step towards fully event-based processing for embedded spacecraft pose estimation.