HOGSA: Bimanual Hand-Object Interaction Understanding with 3D Gaussian Splatting Based Data Augmentation

作者: Wentian Qu, Jiahe Li, Jian Cheng, Jian Shi, Chenyu Meng, Cuixia Ma, Hongan Wang, Xiaoming Deng, Yinda Zhang

分类: cs.CV

发布日期: 2025-01-06

备注: Accepted by AAAI2025

💡 一句话要点

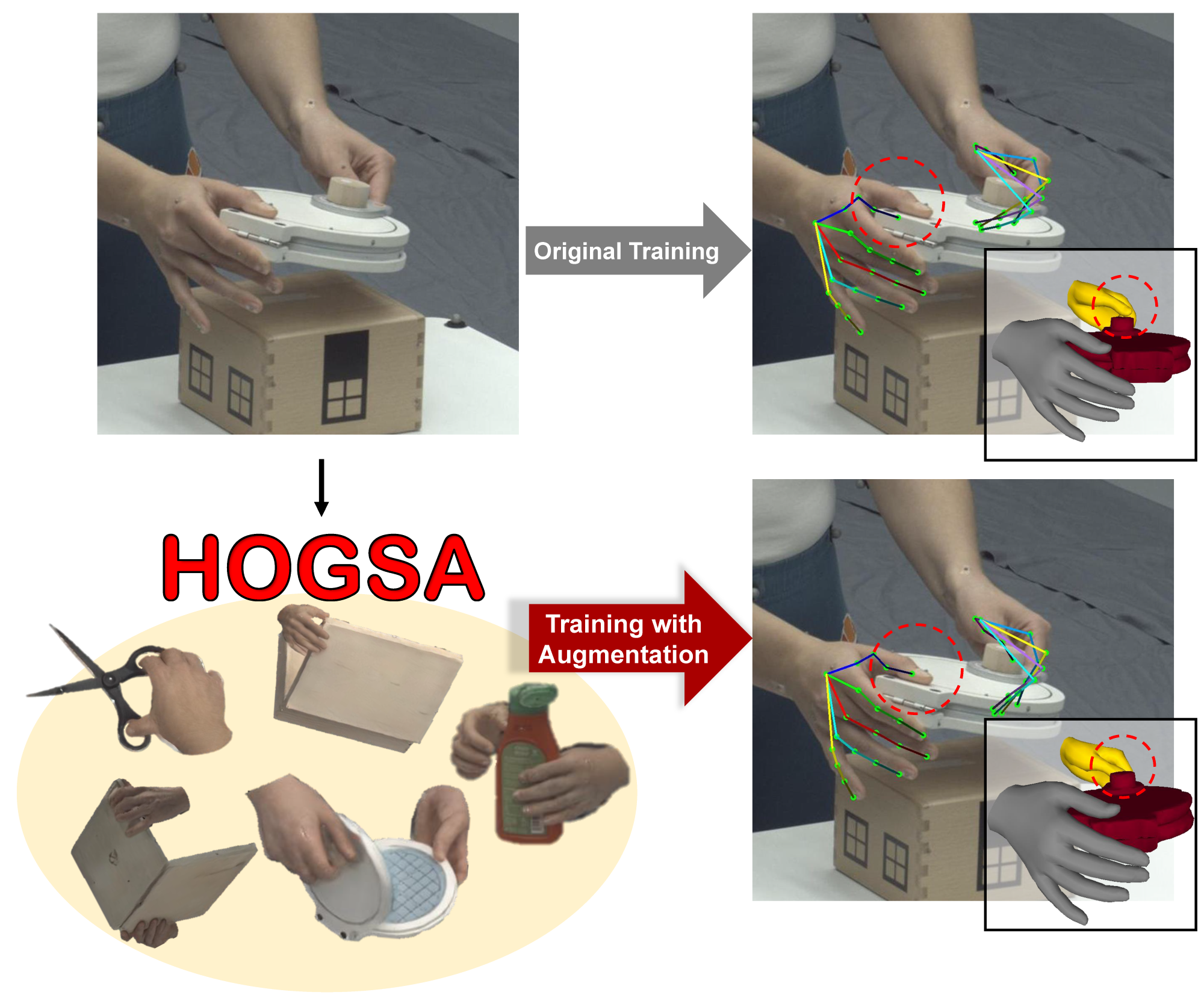

提出基于3D高斯溅射的数据增强框架,用于提升双手动目标交互理解

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 双手动目标交互 数据增强 3D高斯溅射 姿态优化 机器人操作

📋 核心要点

- 双手动目标交互理解面临数据稀缺和遮挡严重的问题,限制了相关算法的性能提升。

- 利用3D高斯溅射技术,对物体和手进行建模,并结合姿态优化,生成大量逼真的增强数据。

- 在H2O和Arctic数据集上的实验表明,该数据增强方法能有效提升双手动目标交互理解的基线性能。

📝 摘要(中文)

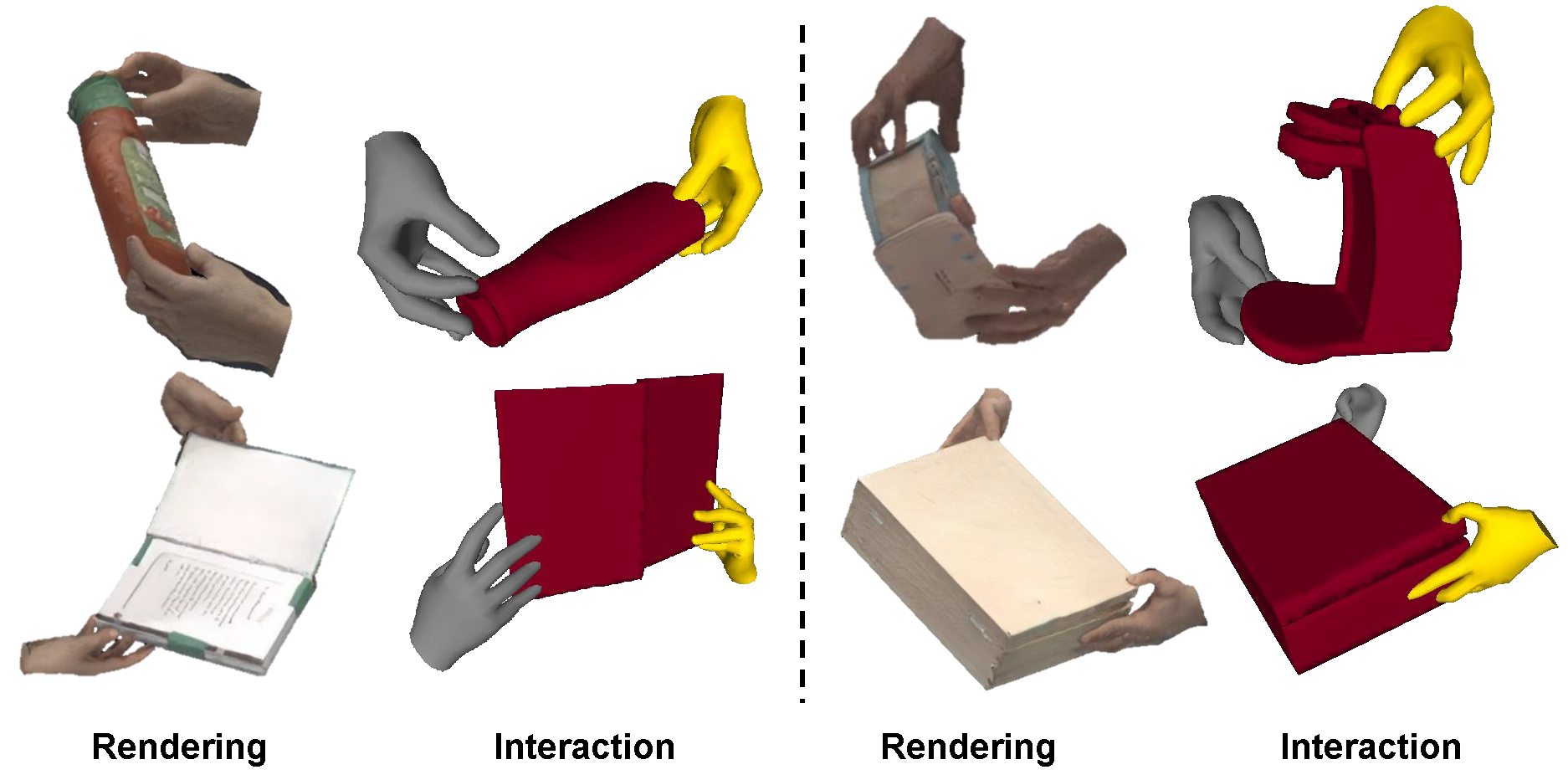

本文提出了一种新的基于3D高斯溅射(3DGS)的数据增强框架,用于双手动目标交互理解。由于手与物体之间严重的遮挡以及高自由度的运动,高质量、大规模数据集的收集和标注非常困难,这阻碍了双手动目标交互相关基线的进一步改进。该框架能够将现有数据集扩充为具有各种手-物姿态和视点的大规模逼真数据。首先,使用基于网格的3DGS来建模物体和手,并设计了一个超分辨率模块来处理多分辨率输入图像导致的渲染模糊问题。其次,扩展了单手抓取姿态优化模块,使其适用于双手-物体交互,从而生成各种双手-物体交互姿态,显著扩展数据集的姿态分布。第三,分析了所提出的数据增强的不同方面对双手动目标交互理解的影响。在H2O和Arctic两个基准数据集上进行了数据增强,验证了该方法可以提高基线的性能。

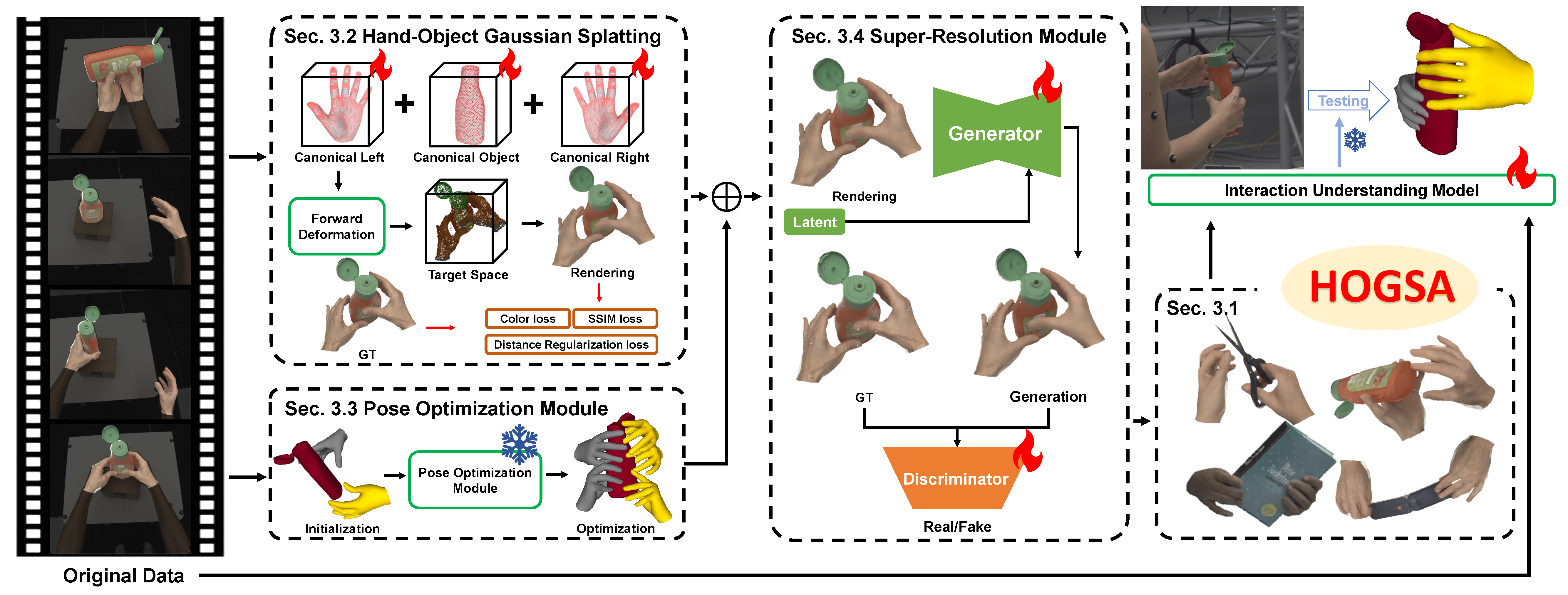

🔬 方法详解

问题定义:双手动目标交互理解任务面临着数据量不足和手与物体之间严重遮挡的问题。现有的数据集难以覆盖各种交互姿态和视角,导致模型泛化能力受限。此外,手动标注大规模高质量数据集的成本很高,阻碍了相关研究的进展。

核心思路:论文的核心思路是利用3D高斯溅射(3DGS)技术,对现有的少量真实数据进行增强,生成大量逼真的合成数据。通过扩展数据集的规模和多样性,提高模型的泛化能力和鲁棒性。3DGS能够高效地渲染高质量的图像,并且可以方便地控制物体和手的姿态。

技术框架:该框架主要包含以下几个模块:1) 基于网格的3DGS建模:使用3DGS对物体和手进行建模,将它们表示为一组带有属性的高斯球。2) 超分辨率模块:为了解决多分辨率输入图像导致的渲染模糊问题,设计了一个超分辨率模块,提高渲染图像的清晰度。3) 双手姿态优化模块:扩展了单手抓取姿态优化模块,使其能够生成各种双手-物体交互姿态,从而扩展数据集的姿态分布。4) 数据增强:利用上述模块生成大量具有不同姿态和视角的合成数据,并将其与真实数据混合,用于训练模型。

关键创新:该论文的关键创新在于将3DGS技术应用于双手动目标交互的数据增强。与传统的基于GAN的数据增强方法相比,3DGS能够生成更高质量、更逼真的图像,并且可以精确地控制物体和手的姿态。此外,该论文还提出了一个超分辨率模块和一个双手姿态优化模块,进一步提高了数据增强的效果。

关键设计:超分辨率模块的具体网络结构未知,但其目标是提升渲染图像的分辨率和清晰度。双手姿态优化模块的具体实现细节未知,但其需要考虑双手之间的协同运动和与物体的交互关系。损失函数的设计可能包括渲染损失、姿态损失和对抗损失等,以保证生成图像的逼真度和姿态的合理性。具体的参数设置未知。

🖼️ 关键图片

📊 实验亮点

该方法在H2O和Arctic两个基准数据集上进行了验证,实验结果表明,使用该方法进行数据增强可以显著提高双手动目标交互理解的基线性能。具体的性能提升幅度未知,但论文强调了该方法在扩展数据集规模和多样性方面的有效性,从而提升了模型的泛化能力。

🎯 应用场景

该研究成果可应用于机器人操作、虚拟现实、人机交互等领域。例如,可以利用增强后的数据训练机器人,使其能够更好地理解和执行双手动目标交互任务。在虚拟现实中,可以生成更逼真的手部交互场景,提高用户的沉浸感。此外,该方法还可以用于辅助设计和评估人机交互界面。

📄 摘要(原文)

Understanding of bimanual hand-object interaction plays an important role in robotics and virtual reality. However, due to significant occlusions between hands and object as well as the high degree-of-freedom motions, it is challenging to collect and annotate a high-quality, large-scale dataset, which prevents further improvement of bimanual hand-object interaction-related baselines. In this work, we propose a new 3D Gaussian Splatting based data augmentation framework for bimanual hand-object interaction, which is capable of augmenting existing dataset to large-scale photorealistic data with various hand-object pose and viewpoints. First, we use mesh-based 3DGS to model objects and hands, and to deal with the rendering blur problem due to multi-resolution input images used, we design a super-resolution module. Second, we extend the single hand grasping pose optimization module for the bimanual hand object to generate various poses of bimanual hand-object interaction, which can significantly expand the pose distribution of the dataset. Third, we conduct an analysis for the impact of different aspects of the proposed data augmentation on the understanding of the bimanual hand-object interaction. We perform our data augmentation on two benchmarks, H2O and Arctic, and verify that our method can improve the performance of the baselines.