Distillation-Enhanced Physical Adversarial Attacks

作者: Wei Liu, Yonglin Wu, Chaoqun Li, Zhuodong Liu, Huanqian Yan

分类: cs.CV

发布日期: 2025-01-04

备注: 7 pages, 5 figures

💡 一句话要点

提出一种基于知识蒸馏的物理对抗攻击方法,提升隐蔽性和攻击性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 物理对抗攻击 知识蒸馏 对抗样本 隐蔽性 攻击性能 深度学习 自动驾驶

📋 核心要点

- 物理对抗攻击旨在发现AI系统的脆弱性,但现有方法难以兼顾攻击效果和补丁的隐蔽性。

- 该论文提出利用知识蒸馏,将无约束空间中优化的“教师”补丁知识迁移到隐蔽颜色空间中的“学生”补丁。

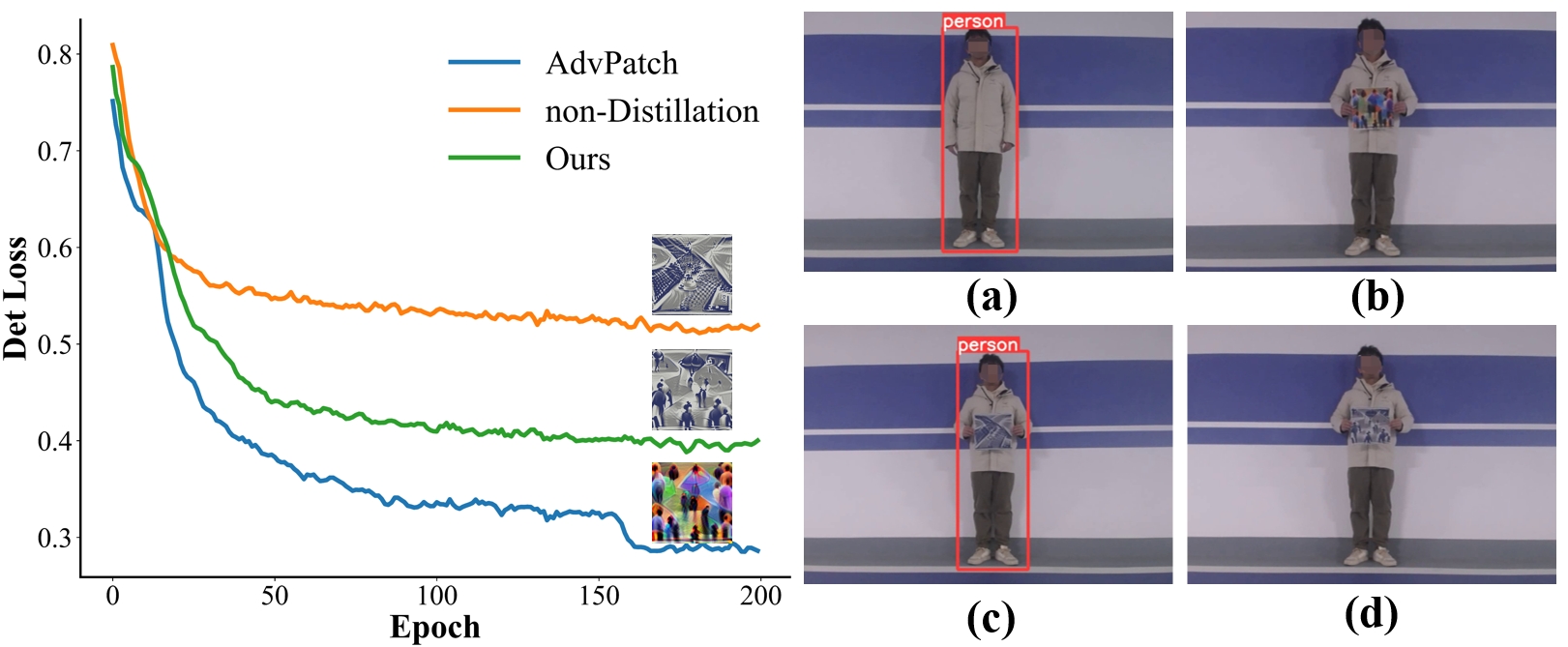

- 实验表明,该方法在保持补丁隐蔽性的前提下,能够将攻击性能提升20%,具有实际应用价值。

📝 摘要(中文)

物理对抗补丁的研究对于识别基于人工智能的识别系统中的漏洞以及开发更鲁棒的深度学习模型至关重要。虽然最近的研究主要集中在提高补丁的隐蔽性以获得更大的实际应用性,但在隐蔽性和攻击性能之间实现有效的平衡仍然是一个重大挑战。为了解决这个问题,我们提出了一种利用知识蒸馏的新型物理对抗攻击方法。具体来说,我们首先定义一个针对目标环境量身定制的隐蔽颜色空间,以确保平滑的融合。然后,我们在一个无约束的颜色空间中优化一个对抗补丁,作为“教师”补丁。最后,我们使用对抗知识蒸馏模块将教师补丁的知识转移到“学生”补丁,指导隐蔽补丁的优化。实验结果表明,我们的方法在保持隐蔽性的同时,将攻击性能提高了20%,突出了其应用价值。

🔬 方法详解

问题定义:物理对抗攻击旨在通过在物理世界中添加扰动来欺骗AI系统,例如在交通标志上粘贴对抗补丁,使自动驾驶系统错误识别。现有方法的痛点在于,为了保证补丁的隐蔽性(例如颜色与背景融合),往往会牺牲攻击效果,导致攻击成功率降低。如何在保证隐蔽性的同时,提升攻击性能是一个关键挑战。

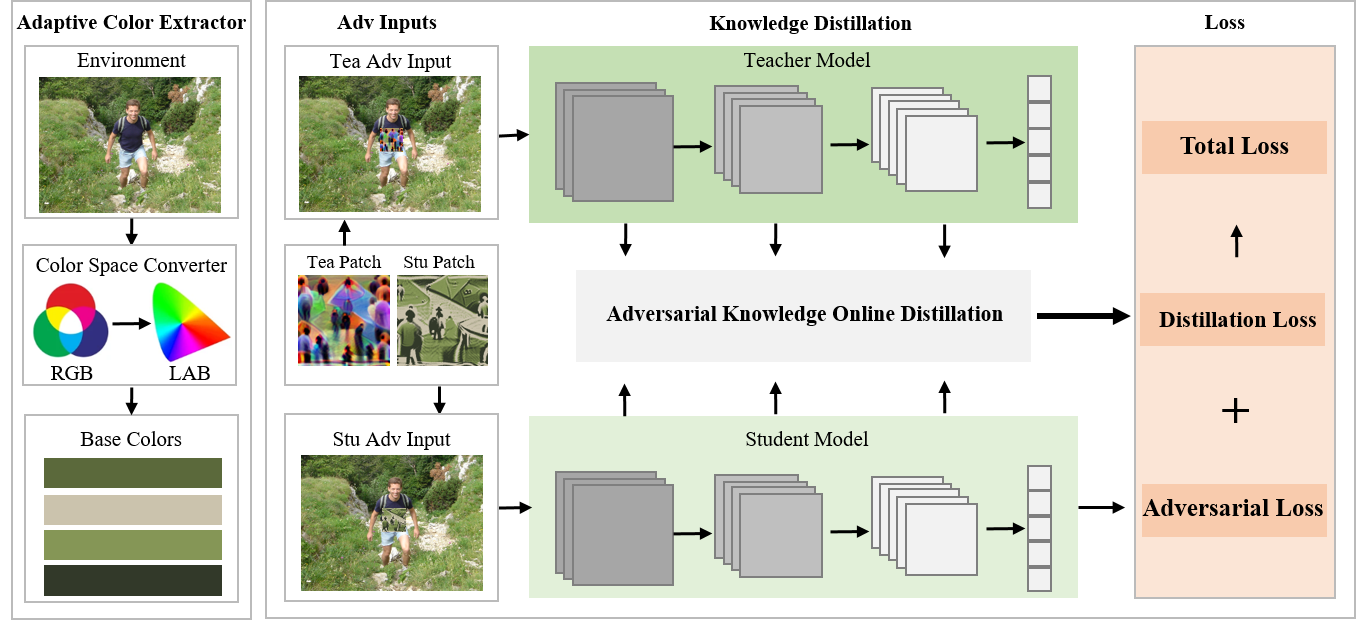

核心思路:该论文的核心思路是利用知识蒸馏,将一个在无约束颜色空间中优化的、攻击性能强的“教师”补丁的知识,迁移到一个在隐蔽颜色空间中优化的“学生”补丁。这样,学生补丁就可以在保持隐蔽性的同时,尽可能地继承教师补丁的攻击能力。

技术框架:整体框架包含以下几个主要步骤:1) 定义一个针对目标环境的隐蔽颜色空间,用于约束学生补丁的颜色,保证其与背景融合。2) 在无约束颜色空间中优化一个教师补丁,使其具有强大的攻击能力。3) 使用对抗知识蒸馏模块,将教师补丁的知识迁移到学生补丁,指导学生补丁的优化。4) 将优化后的学生补丁应用于物理世界,进行对抗攻击。

关键创新:该方法最重要的技术创新点在于将知识蒸馏引入物理对抗攻击领域,通过教师-学生模型的训练方式,实现了隐蔽性和攻击性能的有效平衡。与直接在隐蔽颜色空间中优化对抗补丁相比,该方法能够更好地利用无约束空间中的攻击信息,从而提升攻击性能。

关键设计:关键设计包括:1) 隐蔽颜色空间的定义,需要根据目标环境进行选择,例如选择与背景颜色相近的颜色范围。2) 教师补丁的优化目标,通常是最大化目标模型的分类错误率。3) 对抗知识蒸馏模块的设计,可以使用不同的损失函数来衡量教师和学生补丁之间的差异,例如KL散度损失或对抗损失。4) 学生补丁的优化算法,可以使用梯度下降等优化算法,同时需要对学生补丁的颜色进行约束,使其保持在隐蔽颜色空间内。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在保持补丁隐蔽性的前提下,能够将攻击性能提升20%。这意味着,相比于现有方法,该方法生成的对抗补丁更难被人类或防御机制检测到,同时能够更有效地欺骗目标AI系统。具体的性能指标和对比基线在论文中进行了详细的描述。

🎯 应用场景

该研究成果可应用于提升自动驾驶系统、智能监控系统等AI系统的安全性。通过评估和改进这些系统对物理对抗攻击的鲁棒性,可以有效防止恶意攻击,保障系统的可靠运行。此外,该方法也可用于生成更具隐蔽性的对抗样本,用于评估和提升深度学习模型的防御能力。

📄 摘要(原文)

The study of physical adversarial patches is crucial for identifying vulnerabilities in AI-based recognition systems and developing more robust deep learning models. While recent research has focused on improving patch stealthiness for greater practical applicability, achieving an effective balance between stealth and attack performance remains a significant challenge. To address this issue, we propose a novel physical adversarial attack method that leverages knowledge distillation. Specifically, we first define a stealthy color space tailored to the target environment to ensure smooth blending. Then, we optimize an adversarial patch in an unconstrained color space, which serves as the 'teacher' patch. Finally, we use an adversarial knowledge distillation module to transfer the teacher patch's knowledge to the 'student' patch, guiding the optimization of the stealthy patch. Experimental results show that our approach improves attack performance by 20%, while maintaining stealth, highlighting its practical value.