Aesthetic Matters in Music Perception for Image Stylization: A Emotion-driven Music-to-Visual Manipulation

作者: Junjie Xu, Xingjiao Wu, Tanren Yao, Zihao Zhang, Jiayang Bei, Wu Wen, Liang He

分类: cs.CV

发布日期: 2025-01-03

💡 一句话要点

EmoMV:提出情感驱动的音乐到视觉图像风格化方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 音乐情感分析 图像风格化 情感驱动 多模态融合 人机交互 脑电图 视觉艺术

📋 核心要点

- 现有图像处理方法在情感表达的直观理解和精确控制方面仍面临挑战,音乐研究也较少关注情感维度及其与视觉艺术的融合。

- EmoMV的核心思想是将音乐的情感信息作为驱动,通过分析音乐元素并将其情感映射到图像的颜色、光照等视觉属性上,实现图像风格化。

- 实验结果表明,EmoMV能够有效地将音乐的情感内容转化为视觉上引人注目的图像,并在多模态情感融合方面有所提升。

📝 摘要(中文)

本文提出了一种情感驱动的音乐到视觉图像处理方法EmoMV,旨在通过音乐的情感信息来操控图像风格。EmoMV结合了音乐元素的自底向上处理(如音高和节奏)以及情感信息自顶向下地应用于视觉方面(如颜色和光照)。为了评估EmoMV的有效性,我们采用了一个多尺度框架,包括图像质量指标、美学评估和脑电图(EEG)测量,以捕捉实时的情感反应。实验结果表明,EmoMV能够有效地将音乐的情感内容转化为具有视觉吸引力的图像,从而推进多模态情感融合,并为创意产业和交互技术开辟新的途径。

🔬 方法详解

问题定义:现有图像风格化方法难以精确捕捉和表达情感信息,而音乐的情感维度在视觉艺术中的应用也相对较少。因此,该论文旨在解决如何利用音乐的情感信息来驱动图像风格化,从而创造更具表现力和情感共鸣的视觉作品。现有方法主要依赖人工设计或数据驱动,缺乏对音乐情感的理解和利用。

核心思路:EmoMV的核心思路是将音乐的情感信息作为图像风格化的驱动力。通过分析音乐的音高、节奏等元素,提取其情感特征,并将这些情感特征映射到图像的颜色、光照等视觉属性上。这种方法旨在建立音乐情感与视觉表达之间的直接联系,从而实现更自然、更具情感表现力的图像风格化。

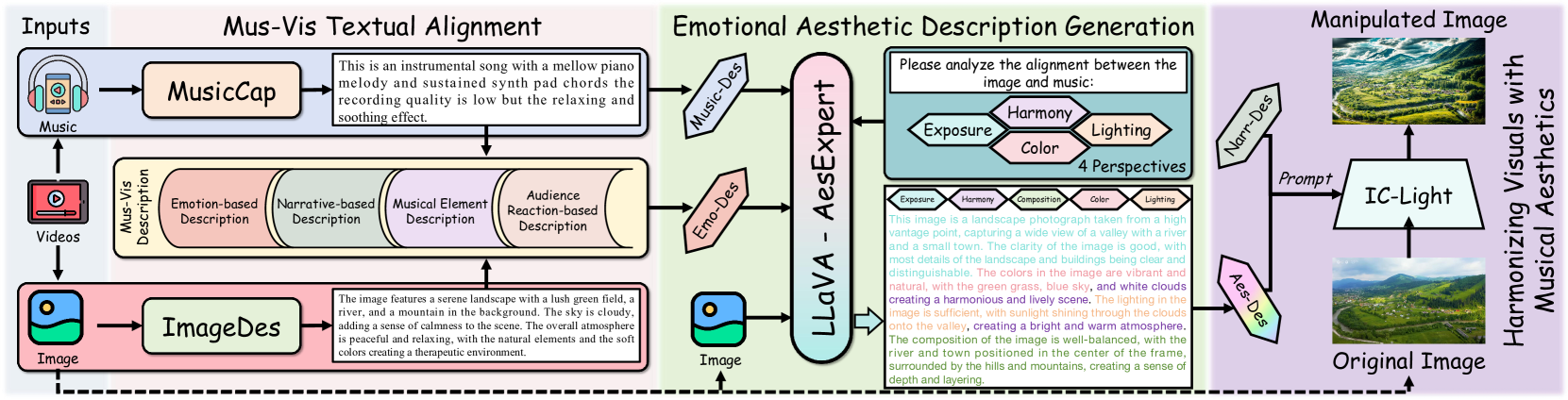

技术框架:EmoMV的整体框架包含以下几个主要模块:1) 音乐情感分析模块:负责从音乐中提取情感特征。2) 视觉属性映射模块:将音乐情感特征映射到图像的颜色、光照等视觉属性。3) 图像风格化模块:根据映射后的视觉属性对图像进行风格化处理。4) 评估模块:采用多尺度框架,包括图像质量指标、美学评估和脑电图(EEG)测量,以评估风格化图像的质量和情感表达效果。

关键创新:EmoMV的关键创新在于其情感驱动的音乐到视觉图像风格化方法。与传统方法相比,EmoMV能够更有效地利用音乐的情感信息来控制图像风格,从而创造更具表现力和情感共鸣的视觉作品。此外,EmoMV还采用了多尺度评估框架,能够更全面地评估风格化图像的质量和情感表达效果。

关键设计:在音乐情感分析模块中,可能使用了预训练的音乐情感识别模型或手工设计的特征提取方法。在视觉属性映射模块中,可能使用了神经网络或规则引擎来实现情感特征到视觉属性的映射。在图像风格化模块中,可能使用了现有的图像风格迁移算法或自定义的图像处理方法。具体的参数设置、损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

EmoMV通过多尺度评估框架验证了其有效性,该框架包括图像质量指标、美学评估和脑电图(EEG)测量。实验结果表明,EmoMV能够有效地将音乐的情感内容转化为具有视觉吸引力的图像。具体的性能数据和对比基线未知,但EEG测量结果表明EmoMV能够捕捉到用户对风格化图像的实时情感反应。

🎯 应用场景

EmoMV具有广泛的应用前景,包括:1) 创意产业:为音乐家和视觉艺术家提供新的创作工具和灵感。2) 交互技术:增强人机交互的情感表达能力,例如,根据用户选择的音乐自动生成个性化的视觉内容。3) 心理治疗:通过音乐和视觉的结合,帮助患者表达和释放情感。未来,EmoMV有望成为多模态情感计算领域的重要组成部分。

📄 摘要(原文)

Emotional information is essential for enhancing human-computer interaction and deepening image understanding. However, while deep learning has advanced image recognition, the intuitive understanding and precise control of emotional expression in images remain challenging. Similarly, music research largely focuses on theoretical aspects, with limited exploration of its emotional dimensions and their integration with visual arts. To address these gaps, we introduce EmoMV, an emotion-driven music-to-visual manipulation method that manipulates images based on musical emotions. EmoMV combines bottom-up processing of music elements-such as pitch and rhythm-with top-down application of these emotions to visual aspects like color and lighting. We evaluate EmoMV using a multi-scale framework that includes image quality metrics, aesthetic assessments, and EEG measurements to capture real-time emotional responses. Our results demonstrate that EmoMV effectively translates music's emotional content into visually compelling images, advancing multimodal emotional integration and opening new avenues for creative industries and interactive technologies.