IAM: Enhancing RGB-D Instance Segmentation with New Benchmarks

作者: Aecheon Jung, Soyun Choi, Junhong Min, Sungeun Hong

分类: cs.CV

发布日期: 2025-01-03

💡 一句话要点

提出RGB-D实例分割新基准IAM,并提出有效的数据融合方法,提升场景理解能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: RGB-D分割 实例分割 基准数据集 数据融合 场景理解

📋 核心要点

- 现有RGB-D分割数据集主要集中于语义分割,缺乏实例级别的标注,限制了对场景中独立物体的精细化理解。

- 论文核心在于构建了三个新的RGB-D实例分割基准数据集,并提出了一种简单有效的RGB-D数据融合方法。

- 通过在新建基准上评估现有模型,揭示了它们的优缺点,并验证了所提出的数据融合方法的有效性。

📝 摘要(中文)

图像分割在提供人类辅助和增强自主性方面至关重要。特别是,利用视觉和深度信息的RGB-D分割,比仅使用RGB的方法更能丰富场景理解,因此受到了越来越多的关注。然而,现有工作主要集中在语义分割上,缺乏实例级别的RGB-D分割数据集,这限制了当前方法对细粒度细节的捕捉。为了弥补这一差距,我们引入了三个RGB-D实例分割基准,这些数据集具有通用性,支持从室内导航到机器人操作等广泛应用。此外,我们对这些基准上的各种基线模型进行了广泛评估,分析了它们的优缺点,为未来的研究提供了指导。最后,我们提出了一种简单而有效的RGB-D数据集成方法,并通过大量评估验证了其有效性,为更细致的场景理解提供了一个强大的框架。

🔬 方法详解

问题定义:现有的RGB-D分割研究主要集中在语义分割上,缺乏针对实例分割的数据集。这意味着模型无法区分同一类别中的不同个体,例如区分场景中的不同椅子或不同杯子。这限制了RGB-D分割在需要精细物体识别和操作的任务中的应用,例如机器人操作和室内导航。现有方法的痛点在于无法充分利用RGB-D数据进行细粒度的实例级场景理解。

核心思路:论文的核心思路是通过构建新的RGB-D实例分割数据集来填补现有研究的空白,并提出一种有效的数据融合方法,以充分利用RGB和深度信息。通过提供高质量的实例级标注,可以训练模型来区分同一类别中的不同个体,从而实现更精细的场景理解。数据融合方法旨在有效地结合RGB和深度信息,以提高分割的准确性和鲁棒性。

技术框架:整体框架包括三个主要部分:1) 构建RGB-D实例分割数据集;2) 评估现有基线模型在新建数据集上的性能;3) 提出并验证RGB-D数据融合方法。数据集构建涉及数据采集、标注和验证。基线模型评估旨在了解现有方法在实例分割任务中的表现。数据融合方法的设计旨在有效地结合RGB和深度信息,以提高分割性能。

关键创新:论文的关键创新点在于:1) 构建了三个新的RGB-D实例分割基准数据集,这些数据集具有高质量的实例级标注,可以用于训练和评估RGB-D实例分割模型;2) 提出了一种简单而有效的RGB-D数据融合方法,该方法可以有效地结合RGB和深度信息,以提高分割的准确性和鲁棒性。与现有方法相比,该方法更注重实例级别的区分,并充分利用了深度信息。

关键设计:关于数据融合方法的具体细节未知,摘要中只提到“simple yet effective method”。数据集构建的关键在于标注的准确性和一致性,以及数据集的多样性,以覆盖不同的场景和物体。基线模型的选择需要考虑其在RGB-D分割领域的代表性,以及其在实例分割任务中的性能。损失函数和网络结构的选择需要根据具体任务和数据集进行调整。

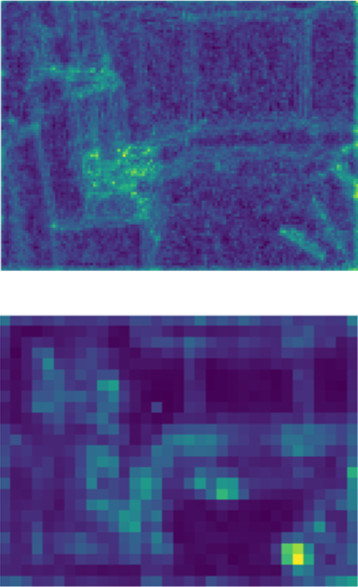

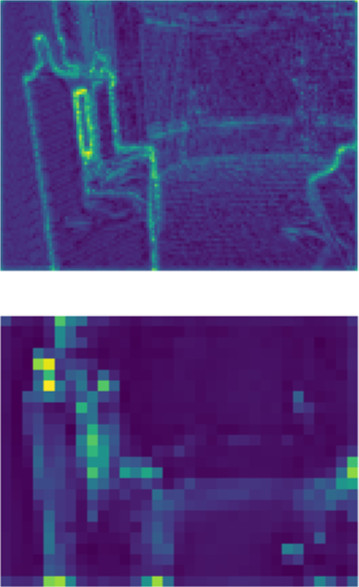

🖼️ 关键图片

📊 实验亮点

论文通过在新建的RGB-D实例分割基准上评估现有模型,揭示了它们在实例分割任务中的优缺点。同时,论文提出的RGB-D数据融合方法在实验中表现出良好的性能,证明了其有效性。具体的性能数据和提升幅度在摘要中未提及,属于未知信息。

🎯 应用场景

该研究成果可广泛应用于机器人操作、室内导航、增强现实等领域。例如,机器人可以利用RGB-D实例分割来识别和抓取特定物体,从而实现更智能的自动化操作。在室内导航中,可以帮助机器人理解周围环境,避开障碍物并找到目标位置。在增强现实中,可以将虚拟物体与真实场景中的特定物体进行精确对齐。

📄 摘要(原文)

Image segmentation is a vital task for providing human assistance and enhancing autonomy in our daily lives. In particular, RGB-D segmentation-leveraging both visual and depth cues-has attracted increasing attention as it promises richer scene understanding than RGB-only methods. However, most existing efforts have primarily focused on semantic segmentation and thus leave a critical gap. There is a relative scarcity of instance-level RGB-D segmentation datasets, which restricts current methods to broad category distinctions rather than fully capturing the fine-grained details required for recognizing individual objects. To bridge this gap, we introduce three RGB-D instance segmentation benchmarks, distinguished at the instance level. These datasets are versatile, supporting a wide range of applications from indoor navigation to robotic manipulation. In addition, we present an extensive evaluation of various baseline models on these benchmarks. This comprehensive analysis identifies both their strengths and shortcomings, guiding future work toward more robust, generalizable solutions. Finally, we propose a simple yet effective method for RGB-D data integration. Extensive evaluations affirm the effectiveness of our approach, offering a robust framework for advancing toward more nuanced scene understanding.