Asymmetric Reinforcing against Multi-modal Representation Bias

作者: Xiyuan Gao, Bing Cao, Pengfei Zhu, Nannan Wang, Qinghua Hu

分类: cs.CV

发布日期: 2025-01-02

备注: Accepted by AAAI 2025

💡 一句话要点

提出非对称增强方法ARM,解决多模态表征偏差问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 表征偏差 非对称增强 条件互信息 模态融合

📋 核心要点

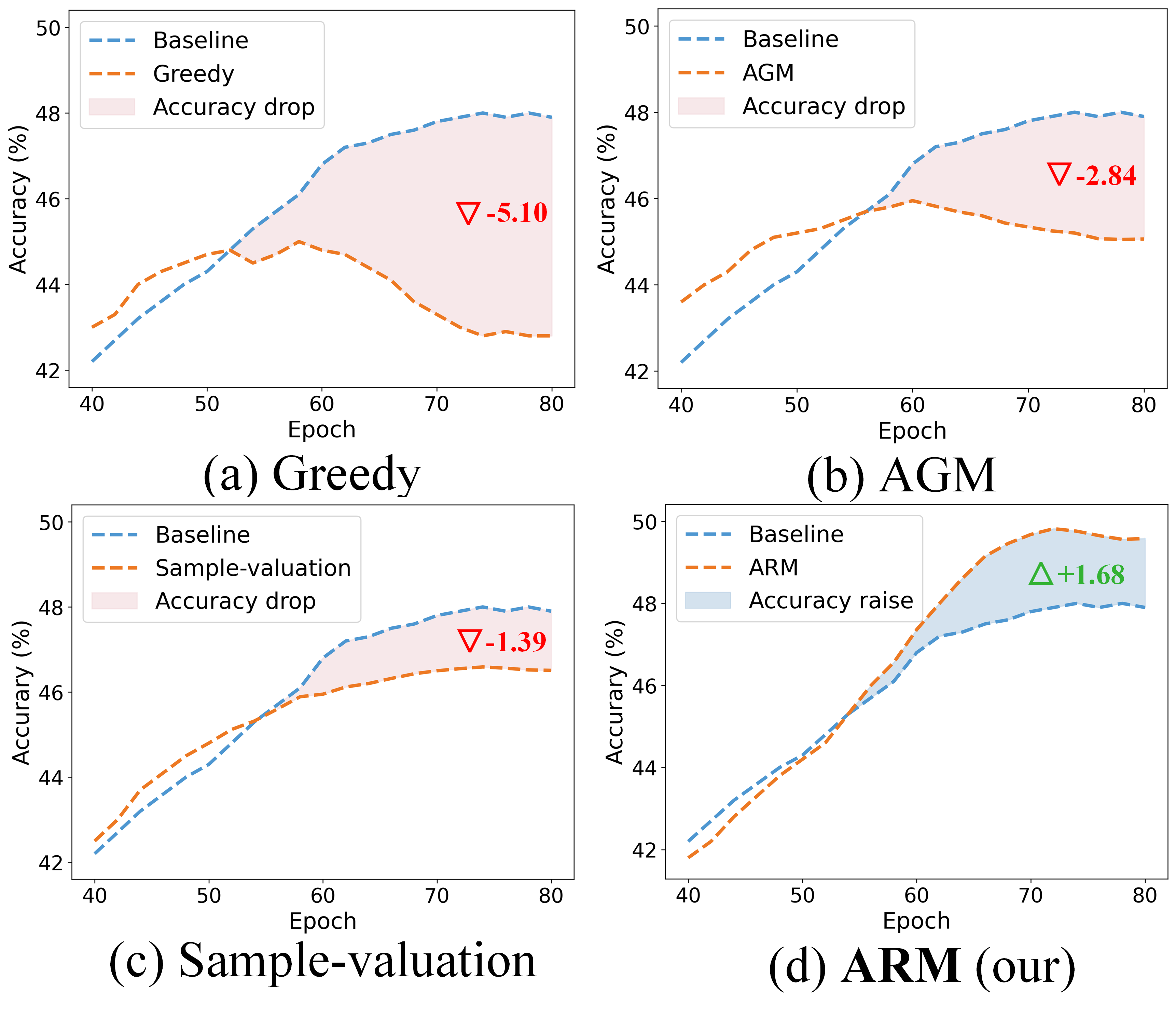

- 现有方法在平衡多模态表征偏差时,过度关注弱势模态增强,忽略了主导模态的潜在性能损失。

- 提出非对称增强方法ARM,通过条件互信息动态增强弱势模态,同时维持主导模态的表征能力。

- 实验结果表明,ARM能有效提升多模态学习性能,并在缓解不平衡多模态学习方面取得显著进展。

📝 摘要(中文)

多模态学习的优势在于整合来自不同来源的信息,提供丰富而全面的见解。然而,在实际场景中,多模态系统经常面临动态模态贡献的挑战,即不同模态的主导地位可能随环境变化,导致多模态学习的次优性能。现有方法主要增强弱势模态以平衡多模态表征偏差,这不可避免地从局部模态的角度进行优化,容易导致主导模态的性能下降。为了解决这个问题,我们提出了一种非对称增强方法(ARM)来对抗多模态表征偏差。我们的ARM通过条件互信息动态地增强弱势模态,同时保持主导模态的表征能力。此外,我们提供了一个深入的分析,即优化某些模态可能会导致信息丢失,并阻止利用多模态数据的全部优势。通过探索模态之间的主导地位并缩小贡献差距,我们显著提高了多模态学习的性能,并在缓解不平衡多模态学习方面取得了显著进展。

🔬 方法详解

问题定义:多模态学习中,不同模态的贡献度会动态变化,某些模态可能占据主导地位,而其他模态则相对较弱。现有方法通常侧重于增强弱势模态,以平衡模态间的表征偏差。然而,这种策略可能会损害主导模态的性能,导致整体性能下降。因此,如何有效地平衡模态贡献,同时避免损害主导模态的表征能力,是本文要解决的关键问题。

核心思路:本文的核心思路是采用非对称增强策略。不同于以往方法一味地增强弱势模态,ARM方法在增强弱势模态的同时,通过条件互信息来约束主导模态的表征能力,避免其性能下降。这种非对称的方式能够更好地适应动态变化的模态贡献,从而提升整体性能。

技术框架:ARM方法的技术框架主要包含以下几个模块:1) 模态表征提取模块:用于提取各个模态的特征表示。2) 模态重要性评估模块:用于评估各个模态的贡献度或重要性。3) 非对称增强模块:根据模态重要性评估结果,对弱势模态进行增强,同时通过条件互信息约束主导模态。4) 多模态融合模块:将增强后的模态表征进行融合,得到最终的预测结果。

关键创新:本文最重要的技术创新点在于提出了非对称增强策略,即在增强弱势模态的同时,通过条件互信息来维持主导模态的表征能力。这种策略能够更好地适应动态变化的模态贡献,避免了以往方法中主导模态性能下降的问题。

关键设计:ARM的关键设计包括:1) 模态重要性评估方法:如何准确评估各个模态的贡献度是关键。2) 条件互信息约束:如何有效地利用条件互信息来约束主导模态,避免其性能下降。3) 增强策略:如何选择合适的增强方法来提升弱势模态的表征能力。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了ARM方法的有效性。实验结果表明,ARM方法在多个多模态数据集上取得了显著的性能提升,尤其是在模态贡献不平衡的情况下。与现有方法相比,ARM方法能够更好地平衡模态贡献,避免主导模态的性能下降,从而获得更高的整体性能。

🎯 应用场景

该研究成果可广泛应用于多模态数据分析与理解领域,例如视频内容理解、多模态情感识别、多模态医学诊断等。通过有效平衡不同模态的贡献,可以提升系统的鲁棒性和准确性,从而在实际应用中获得更好的性能。未来,该方法有望应用于更复杂的场景,例如自动驾驶、人机交互等。

📄 摘要(原文)

The strength of multimodal learning lies in its ability to integrate information from various sources, providing rich and comprehensive insights. However, in real-world scenarios, multi-modal systems often face the challenge of dynamic modality contributions, the dominance of different modalities may change with the environments, leading to suboptimal performance in multimodal learning. Current methods mainly enhance weak modalities to balance multimodal representation bias, which inevitably optimizes from a partialmodality perspective, easily leading to performance descending for dominant modalities. To address this problem, we propose an Asymmetric Reinforcing method against Multimodal representation bias (ARM). Our ARM dynamically reinforces the weak modalities while maintaining the ability to represent dominant modalities through conditional mutual information. Moreover, we provide an in-depth analysis that optimizing certain modalities could cause information loss and prevent leveraging the full advantages of multimodal data. By exploring the dominance and narrowing the contribution gaps between modalities, we have significantly improved the performance of multimodal learning, making notable progress in mitigating imbalanced multimodal learning.