CRRG-CLIP: Automatic Generation of Chest Radiology Reports and Classification of Chest Radiographs

作者: Jianfei Xu, Thanet Markchom, Huizhi Liang

分类: cs.CV, cs.AI

发布日期: 2024-12-31

💡 一句话要点

提出CRRG-CLIP模型,实现胸部X光片报告自动生成与疾病分类

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 胸部X光片 报告生成 图像分类 Faster R-CNN GPT-2 CLIP模型 对比学习 医学影像

📋 核心要点

- 放射科报告编写面临图像复杂和数量庞大的挑战,经验丰富的医生在高强度工作下也难以保证准确性和一致性。

- CRRG-CLIP模型通过Faster R-CNN定位关键区域,结合GPT-2生成报告,并利用CLIP模型进行无监督图像分类。

- 实验表明,报告生成模块性能与基线模型相当甚至超越,分类模块在AUC和准确率上显著优于现有方法。

📝 摘要(中文)

本研究提出CRRG-CLIP模型,用于自动生成胸部X光片报告和进行胸片分类,旨在解决放射科报告编写的复杂性和低效性问题。该模型包含报告生成模块和图像分类模块。生成模块利用Faster R-CNN识别X光片中的解剖区域,使用二元分类器选择关键区域,并使用GPT-2生成语义连贯的报告。分类模块采用无监督对比语言图像预训练(CLIP)模型,以应对标注数据集成本高和特征不足的挑战。实验结果表明,生成模块在BLEU、METEOR和ROUGE-L指标上与高性能基线模型相当,并在BLEU-2、BLEU-3、BLEU-4和ROUGE-L指标上优于GPT-4o模型。分类模块在AUC和准确率方面显著超越了现有最佳模型。该研究表明,所提出的模型在报告生成方面实现了高准确性、可读性和流畅性,同时利用未标注的X光片-报告对进行多模态对比训练,增强了分类性能。

🔬 方法详解

问题定义:放射科医生需要花费大量时间和精力编写胸部X光片的报告,尤其是在面对大量图像和复杂病例时,容易出现效率低下和报告质量不稳定的问题。现有方法通常依赖于人工标注的大量数据集,且特征提取能力有限,难以满足实际需求。

核心思路:CRRG-CLIP模型的核心思路是将报告生成和图像分类两个任务结合起来,利用Faster R-CNN和GPT-2的强大生成能力,以及CLIP模型的无监督学习能力,实现高效、准确的报告生成和疾病分类。通过多模态对比学习,模型能够更好地理解图像和文本之间的关系,从而提升性能。

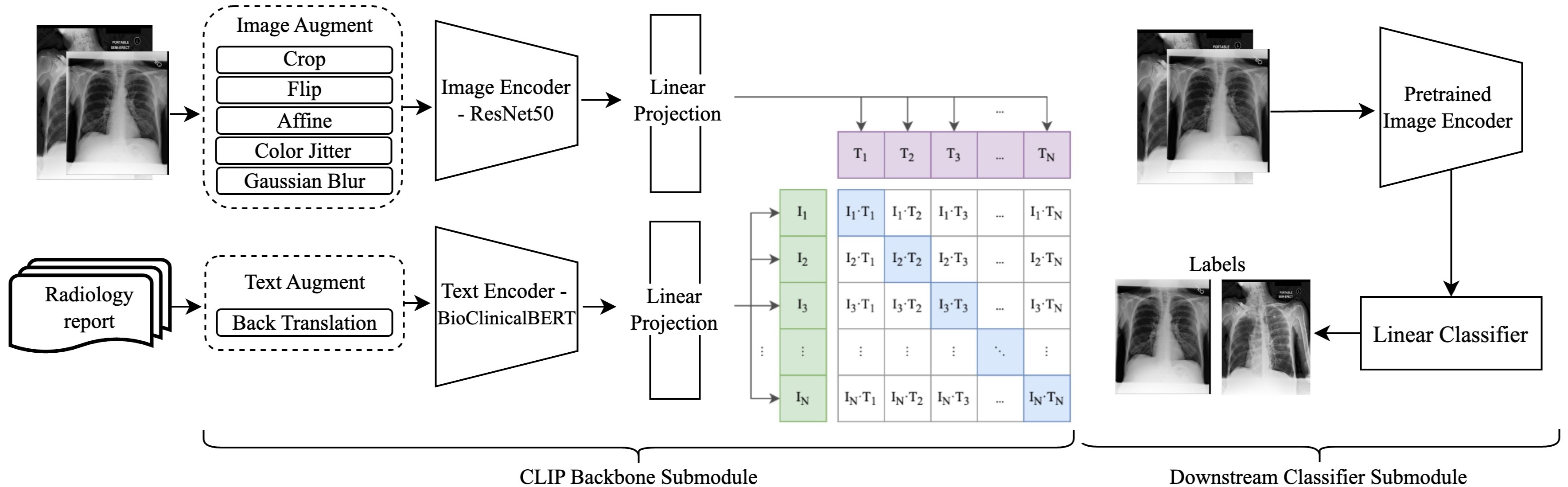

技术框架:CRRG-CLIP模型包含两个主要模块:报告生成模块和图像分类模块。报告生成模块首先使用Faster R-CNN检测X光片中的解剖区域,然后使用二元分类器选择关键区域,最后使用GPT-2生成报告。图像分类模块则直接使用预训练的CLIP模型,通过对比学习的方式,将图像和报告嵌入到同一语义空间中,从而实现图像分类。

关键创新:该模型最重要的创新点在于将Faster R-CNN、GPT-2和CLIP模型结合起来,形成一个端到端的报告生成和图像分类系统。此外,利用CLIP模型的无监督学习能力,避免了对大量标注数据的依赖,降低了训练成本。

关键设计:在报告生成模块中,Faster R-CNN用于检测解剖区域,其输出被用作GPT-2的输入。GPT-2采用标准的Transformer结构,并使用交叉熵损失函数进行训练。在图像分类模块中,CLIP模型使用对比损失函数进行训练,目标是使相似的图像-文本对在嵌入空间中更接近,而不相似的图像-文本对更远离。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CRRG-CLIP模型的报告生成模块在BLEU、METEOR和ROUGE-L指标上与高性能基线模型相当,并在BLEU-2、BLEU-3、BLEU-4和ROUGE-L指标上优于GPT-4o模型。分类模块在AUC和准确率方面显著超越了现有最佳模型,证明了该模型在报告生成和图像分类方面的有效性。

🎯 应用场景

CRRG-CLIP模型可应用于医疗影像辅助诊断领域,减轻放射科医生的工作负担,提高诊断效率和准确性。该模型还可用于医学教育和研究,帮助医生学习和理解X光片报告的生成过程。未来,该模型有望推广到其他医学影像领域,实现更广泛的应用。

📄 摘要(原文)

The complexity of stacked imaging and the massive number of radiographs make writing radiology reports complex and inefficient. Even highly experienced radiologists struggle to maintain accuracy and consistency in interpreting radiographs under prolonged high-intensity work. To address these issues, this work proposes the CRRG-CLIP Model (Chest Radiology Report Generation and Radiograph Classification Model), an end-to-end model for automated report generation and radiograph classification. The model consists of two modules: the radiology report generation module and the radiograph classification module. The generation module uses Faster R-CNN to identify anatomical regions in radiographs, a binary classifier to select key regions, and GPT-2 to generate semantically coherent reports. The classification module uses the unsupervised Contrastive Language Image Pretraining (CLIP) model, addressing the challenges of high-cost labelled datasets and insufficient features. The results show that the generation module performs comparably to high-performance baseline models on BLEU, METEOR, and ROUGE-L metrics, and outperformed the GPT-4o model on BLEU-2, BLEU-3, BLEU-4, and ROUGE-L metrics. The classification module significantly surpasses the state-of-the-art model in AUC and Accuracy. This demonstrates that the proposed model achieves high accuracy, readability, and fluency in report generation, while multimodal contrastive training with unlabelled radiograph-report pairs enhances classification performance.