STORM: Spatio-Temporal Reconstruction Model for Large-Scale Outdoor Scenes

作者: Jiawei Yang, Jiahui Huang, Yuxiao Chen, Yan Wang, Boyi Li, Yurong You, Apoorva Sharma, Maximilian Igl, Peter Karkus, Danfei Xu, Boris Ivanovic, Yue Wang, Marco Pavone

分类: cs.CV, cs.LG

发布日期: 2024-12-31

备注: Project page at: https://jiawei-yang.github.io/STORM/

💡 一句话要点

STORM:用于大规模室外场景的时空重建模型,实现高效动态场景重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景重建 时空重建 3D高斯 自监督学习 Transformer 场景流估计 室外场景

📋 核心要点

- 现有动态场景重建方法依赖逐场景优化和密集观测,泛化性差且易受噪声伪标签影响。

- STORM利用Transformer架构,通过自监督场景流聚合3D高斯,实现高效的动态场景重建。

- 实验表明,STORM在重建精度和速度上均优于现有方法,并在场景流估计方面有显著提升。

📝 摘要(中文)

本文提出了STORM,一种时空重建模型,旨在从稀疏观测中重建动态室外场景。现有的动态重建方法通常依赖于逐场景优化、密集的时空观测以及强运动监督,导致优化时间过长,对新视角或场景的泛化能力有限,以及由噪声动态伪标签引起的质量下降。为了解决这些挑战,STORM利用数据驱动的Transformer架构,通过单次前向传播直接推断动态3D场景表示——由3D高斯及其速度参数化。其关键设计是利用自监督场景流聚合所有帧的3D高斯,将其变换到目标时间步,从而实现任意视点在任何时刻的完整(即“非模态”)重建。作为一个涌现属性,STORM仅使用重建损失即可自动捕获动态实例并生成高质量掩码。在公共数据集上的大量实验表明,STORM实现了精确的动态场景重建,在动态区域超越了最先进的逐场景优化方法(+4.3到6.6 PSNR)和现有的前馈方法(+2.1到+4.7 PSNR)。STORM在200毫秒内重建大规模室外场景,支持实时渲染,并在场景流估计方面优于竞争对手,将3D EPE提高了0.422米,Acc5提高了28.02%。除了重建之外,我们还展示了我们模型的四个额外应用,说明了自监督学习在更广泛的动态场景理解中的潜力。

🔬 方法详解

问题定义:现有动态场景重建方法主要面临三个痛点:一是依赖于逐场景优化,计算成本高昂;二是需要密集的时空观测,限制了其在稀疏数据下的应用;三是依赖于强运动监督,容易受到噪声伪标签的影响,导致重建质量下降。这些问题限制了动态场景重建技术在大规模室外环境中的应用。

核心思路:STORM的核心思路是利用数据驱动的Transformer架构,直接从稀疏观测中推断动态3D场景表示。通过自监督学习,模型能够学习到场景中物体的运动规律,从而实现对动态场景的准确重建。这种方法避免了逐场景优化,降低了对密集观测的依赖,并减少了对运动监督的需求。

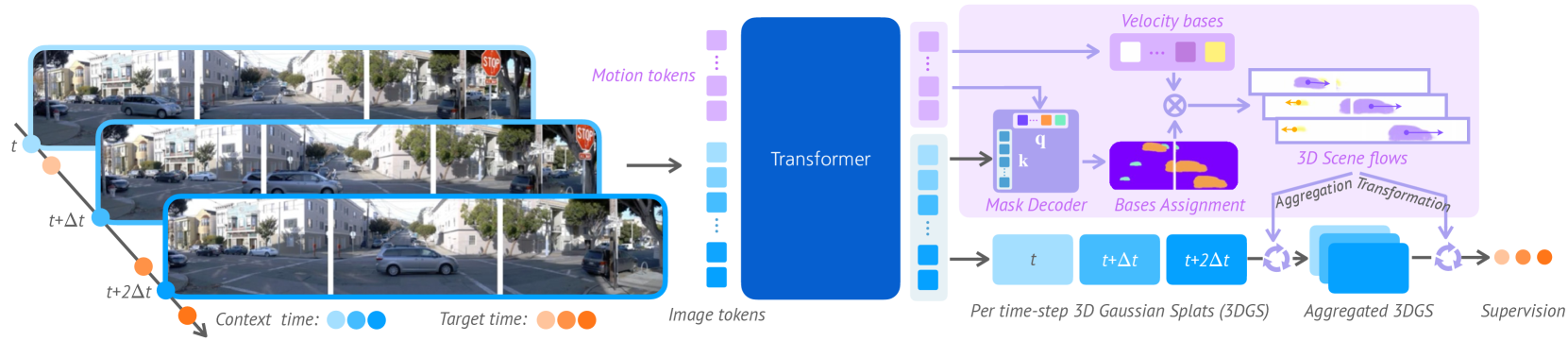

技术框架:STORM的整体架构包含以下几个主要模块:1) 特征提取模块:从输入图像中提取特征;2) 3D高斯表示模块:将场景表示为一组3D高斯及其速度;3) 自监督场景流模块:利用自监督学习估计场景中物体的运动;4) Transformer聚合模块:利用Transformer架构聚合所有帧的3D高斯,并将其变换到目标时间步;5) 重建模块:从聚合后的3D高斯中重建场景。

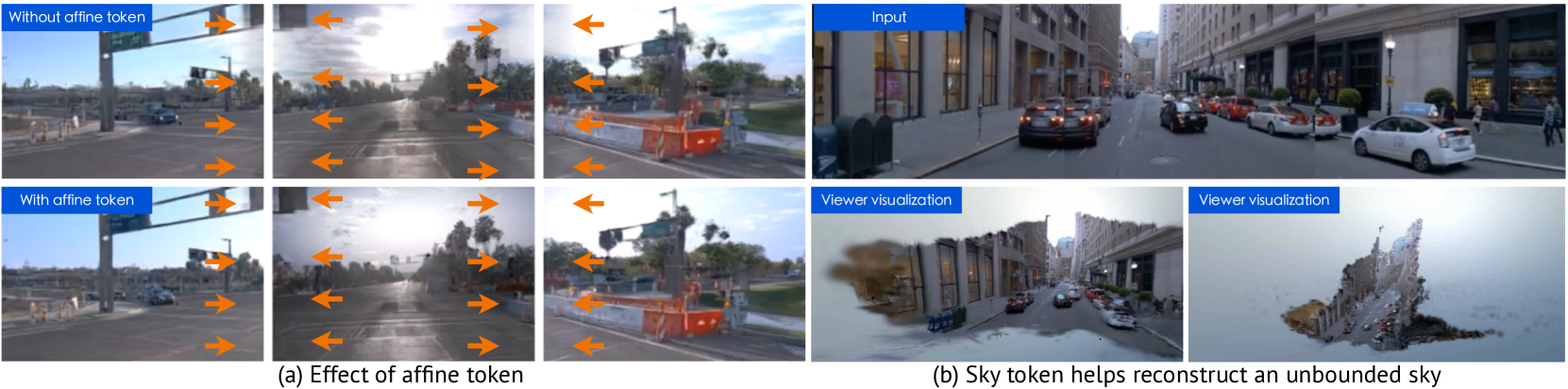

关键创新:STORM最重要的技术创新点在于其利用自监督场景流来聚合不同帧的3D高斯表示。这种方法使得模型能够学习到场景中物体的运动规律,从而实现对动态场景的准确重建。与现有方法相比,STORM不需要密集的时空观测和强运动监督,具有更好的泛化能力和鲁棒性。

关键设计:STORM的关键设计包括:1) 使用3D高斯及其速度来参数化动态场景;2) 利用Transformer架构来聚合不同帧的3D高斯;3) 使用自监督场景流损失来训练模型;4) 使用重建损失来优化模型参数。具体的损失函数包括重建损失、场景流损失等。网络结构方面,采用了标准的Transformer结构,并针对3D高斯表示进行了优化。

🖼️ 关键图片

📊 实验亮点

STORM在公共数据集上取得了显著的性能提升。在动态区域,STORM超越了最先进的逐场景优化方法,PSNR提高了4.3到6.6 dB,超越了现有的前馈方法,PSNR提高了2.1到4.7 dB。此外,STORM在场景流估计方面也优于竞争对手,将3D EPE降低了0.422米,Acc5提高了28.02%。该模型能够在200毫秒内重建大规模室外场景,支持实时渲染。

🎯 应用场景

STORM具有广泛的应用前景,包括自动驾驶、机器人导航、增强现实、虚拟现实等领域。该模型可以用于重建动态交通场景,帮助自动驾驶车辆更好地理解周围环境。此外,STORM还可以用于创建逼真的虚拟环境,为用户提供沉浸式的体验。未来,该技术有望应用于城市规划、游戏开发等领域。

📄 摘要(原文)

We present STORM, a spatio-temporal reconstruction model designed for reconstructing dynamic outdoor scenes from sparse observations. Existing dynamic reconstruction methods often rely on per-scene optimization, dense observations across space and time, and strong motion supervision, resulting in lengthy optimization times, limited generalization to novel views or scenes, and degenerated quality caused by noisy pseudo-labels for dynamics. To address these challenges, STORM leverages a data-driven Transformer architecture that directly infers dynamic 3D scene representations--parameterized by 3D Gaussians and their velocities--in a single forward pass. Our key design is to aggregate 3D Gaussians from all frames using self-supervised scene flows, transforming them to the target timestep to enable complete (i.e., "amodal") reconstructions from arbitrary viewpoints at any moment in time. As an emergent property, STORM automatically captures dynamic instances and generates high-quality masks using only reconstruction losses. Extensive experiments on public datasets show that STORM achieves precise dynamic scene reconstruction, surpassing state-of-the-art per-scene optimization methods (+4.3 to 6.6 PSNR) and existing feed-forward approaches (+2.1 to 4.7 PSNR) in dynamic regions. STORM reconstructs large-scale outdoor scenes in 200ms, supports real-time rendering, and outperforms competitors in scene flow estimation, improving 3D EPE by 0.422m and Acc5 by 28.02%. Beyond reconstruction, we showcase four additional applications of our model, illustrating the potential of self-supervised learning for broader dynamic scene understanding.