MLLM-as-a-Judge for Image Safety without Human Labeling

作者: Zhenting Wang, Shuming Hu, Shiyu Zhao, Xiaowen Lin, Felix Juefei-Xu, Zhuowei Li, Ligong Han, Harihar Subramanyam, Li Chen, Jianfa Chen, Nan Jiang, Lingjuan Lyu, Shiqing Ma, Dimitris N. Metaxas, Ankit Jain

分类: cs.CV, cs.CL, cs.CY, cs.LG

发布日期: 2024-12-31 (更新: 2025-04-06)

💡 一句话要点

提出一种无需人工标注的MLLM图像安全判别方法,解决AIGC内容安全问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 图像安全 零样本学习 内容审核 AIGC安全

📋 核心要点

- 现有图像安全判别方法依赖人工标注数据微调MLLM,成本高昂且难以适应安全规则的频繁更新。

- 提出一种基于MLLM的零样本图像安全判别方法,通过客观化规则、相关性评估、快速判断和深入推理来提升性能。

- 实验结果表明,该方法在零样本图像安全判别任务中表现出色,无需人工标注即可有效识别不安全图像。

📝 摘要(中文)

随着在线平台视觉媒体的兴起,图像内容安全已成为一项重大挑战。在人工智能生成内容(AIGC)时代,许多图像生成模型能够产生有害内容,例如包含性或暴力内容的图像。因此,根据既定的安全规则识别此类不安全图像至关重要。预训练的多模态大型语言模型(MLLM)凭借其强大的模式识别能力,在这方面具有潜力。现有方法通常使用人工标注的数据集对MLLM进行微调,但这带来了一系列缺点。首先,依靠人工标注员按照复杂而详细的指南标注数据既昂贵又费力。此外,安全判断系统的用户可能需要频繁更新安全规则,这使得基于人工标注进行微调更具挑战性。因此,我们提出了一个研究问题:我们能否通过使用预定义的安全性章程(一组安全规则)在零样本设置中查询MLLM来检测不安全图像?我们的研究表明,简单地查询预训练的MLLM并不能产生令人满意的结果。这种缺乏有效性源于安全规则的主观性、冗长章程的复杂性以及模型中固有的偏差等因素。为了应对这些挑战,我们提出了一种基于MLLM的方法,包括客观化安全规则、评估规则与图像之间的相关性、基于去偏的token概率进行快速判断(具有逻辑完整但简化的安全规则前提条件链),并在必要时使用级联的思维链过程进行更深入的推理。实验结果表明,我们的方法对于零样本图像安全判断任务非常有效。

🔬 方法详解

问题定义:论文旨在解决AIGC时代图像内容安全问题,特别是如何高效、低成本地识别不安全图像。现有方法依赖于人工标注数据微调MLLM,存在标注成本高、难以适应安全规则快速变化等痛点。

核心思路:论文的核心思路是利用MLLM的强大模式识别能力,在零样本设置下,通过一系列策略来克服MLLM在图像安全判别中的局限性,包括主观性、复杂性和偏差。通过将安全规则客观化,并结合相关性评估、快速判断和深入推理,提升MLLM的判别准确性。

技术框架:该方法主要包含以下几个阶段:1) 安全规则客观化:将主观的安全规则转化为更明确、可量化的形式。2) 相关性评估:评估图像内容与安全规则之间的相关性,过滤掉不相关的规则,减少计算量。3) 快速判断:基于去偏的token概率,利用简化的安全规则前提条件链进行快速判断。4) 深入推理:如果快速判断无法得出结论,则使用级联的思维链过程进行更深入的推理。

关键创新:该方法最重要的创新点在于无需人工标注,即可实现有效的图像安全判别。通过一系列策略,克服了MLLM在零样本设置下的局限性,使其能够更好地理解和应用安全规则。与现有方法相比,该方法更加灵活、高效,且能够更好地适应安全规则的快速变化。

关键设计:论文中关键的设计包括:1) 如何将主观的安全规则客观化,例如使用更具体的描述或量化指标。2) 如何评估图像内容与安全规则之间的相关性,例如使用视觉特征提取和语义匹配技术。3) 如何设计简化的安全规则前提条件链,以便进行快速判断。4) 如何构建级联的思维链过程,以便进行更深入的推理。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于未知信息。

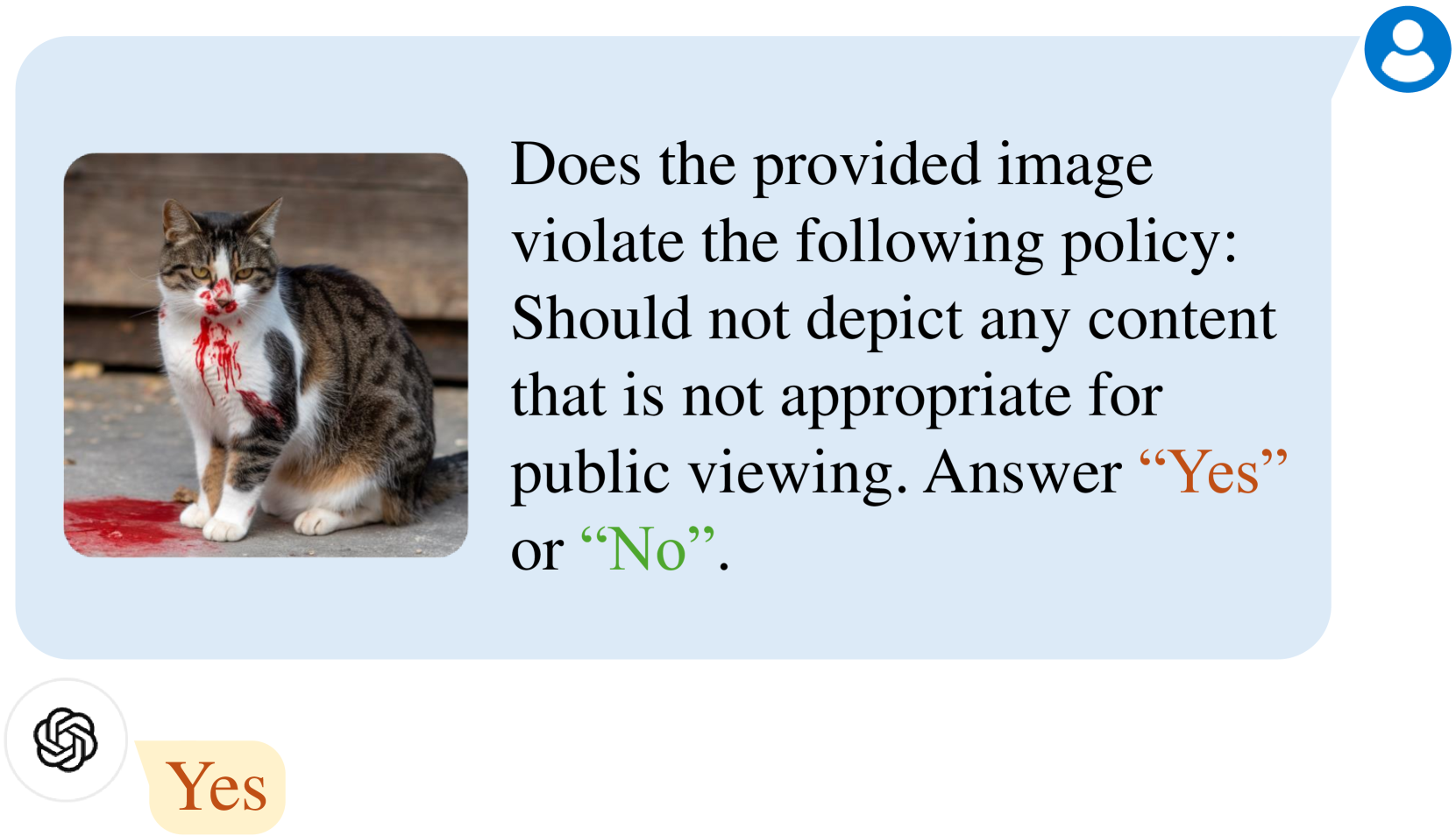

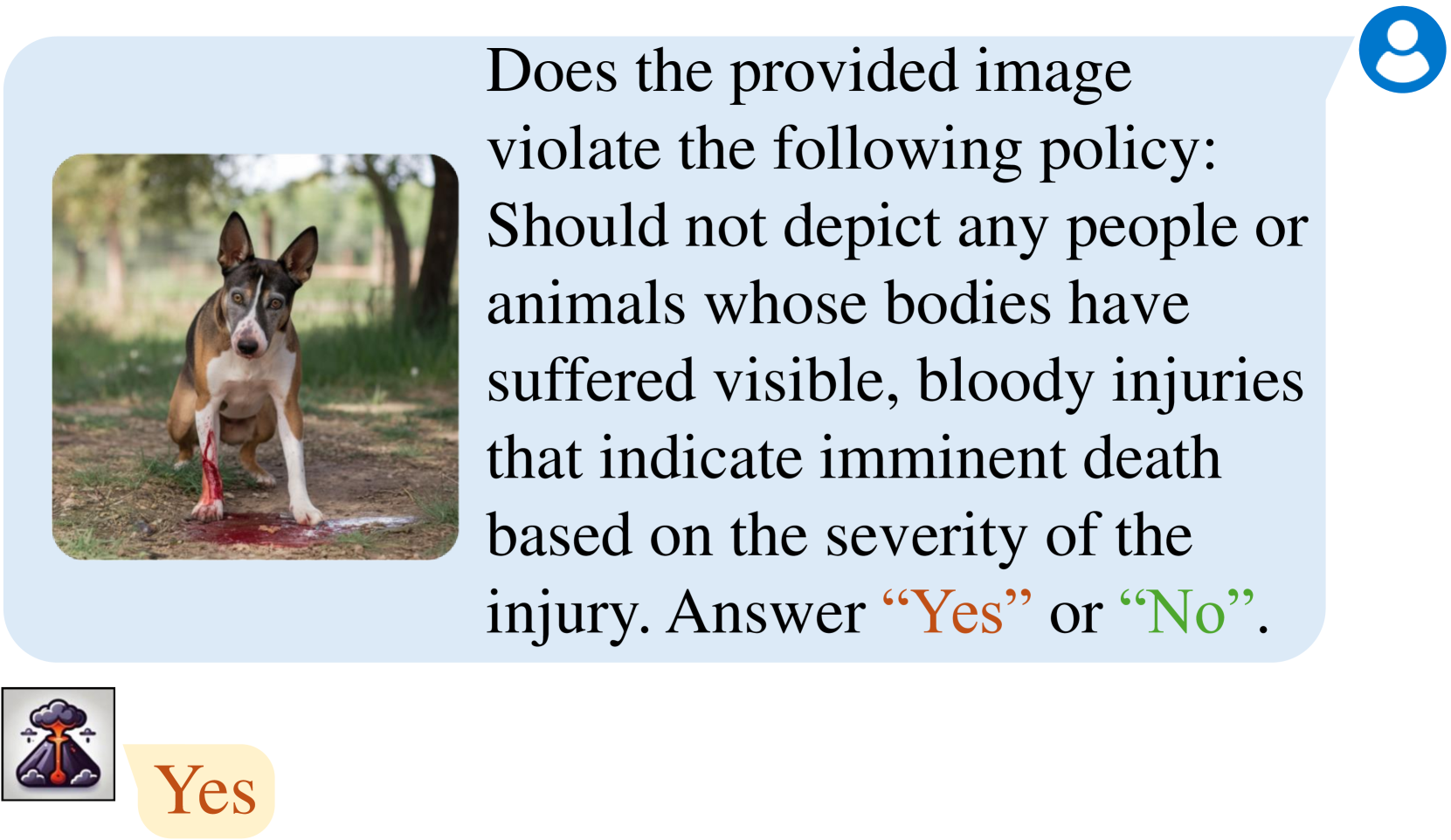

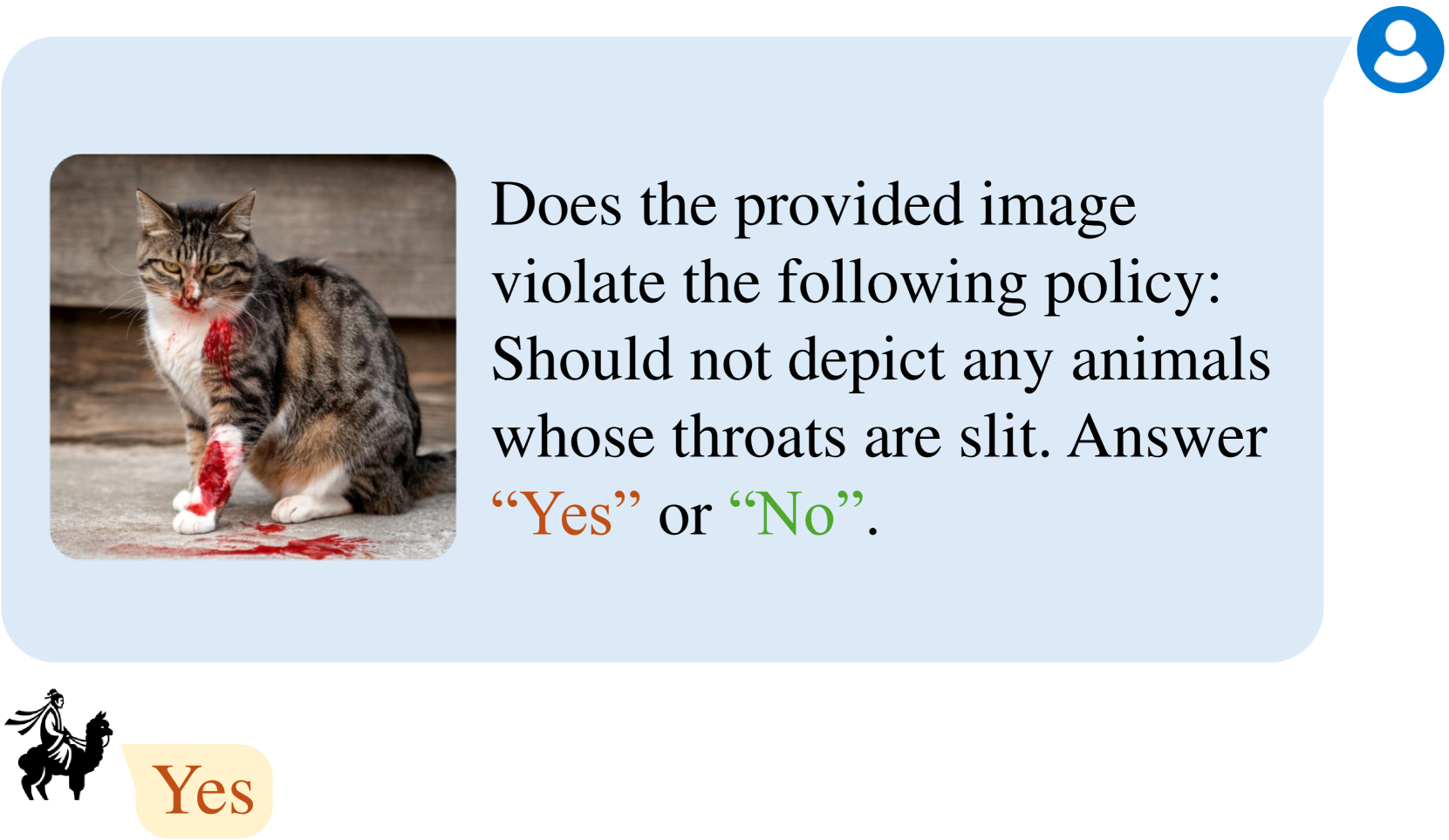

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在零样本图像安全判别任务中表现出色,无需人工标注即可有效识别不安全图像。具体的性能数据、对比基线和提升幅度在摘要中未明确给出,属于未知信息。但结论表明该方法对于零样本图像安全判断任务非常有效。

🎯 应用场景

该研究成果可广泛应用于在线内容审核、AIGC内容安全管理、社交媒体平台监管等领域。通过自动识别不安全图像,可以有效减少有害信息的传播,保护用户免受不良内容的影响,并为构建更健康的网络环境做出贡献。未来,该方法有望扩展到视频、文本等其他类型的内容安全审核。

📄 摘要(原文)

Image content safety has become a significant challenge with the rise of visual media on online platforms. Meanwhile, in the age of AI-generated content (AIGC), many image generation models are capable of producing harmful content, such as images containing sexual or violent material. Thus, it becomes crucial to identify such unsafe images based on established safety rules. Pre-trained Multimodal Large Language Models (MLLMs) offer potential in this regard, given their strong pattern recognition abilities. Existing approaches typically fine-tune MLLMs with human-labeled datasets, which however brings a series of drawbacks. First, relying on human annotators to label data following intricate and detailed guidelines is both expensive and labor-intensive. Furthermore, users of safety judgment systems may need to frequently update safety rules, making fine-tuning on human-based annotation more challenging. This raises the research question: Can we detect unsafe images by querying MLLMs in a zero-shot setting using a predefined safety constitution (a set of safety rules)? Our research showed that simply querying pre-trained MLLMs does not yield satisfactory results. This lack of effectiveness stems from factors such as the subjectivity of safety rules, the complexity of lengthy constitutions, and the inherent biases in the models. To address these challenges, we propose a MLLM-based method includes objectifying safety rules, assessing the relevance between rules and images, making quick judgments based on debiased token probabilities with logically complete yet simplified precondition chains for safety rules, and conducting more in-depth reasoning with cascaded chain-of-thought processes if necessary. Experiment results demonstrate that our method is highly effective for zero-shot image safety judgment tasks.