Enhanced Multimodal RAG-LLM for Accurate Visual Question Answering

作者: Junxiao Xue, Quan Deng, Fei Yu, Yanhao Wang, Jun Wang, Yuehua Li

分类: cs.CV

发布日期: 2024-12-30

备注: 6 pages, 3 figures, under review

💡 一句话要点

提出基于场景图增强的多模态RAG-LLM,提升视觉问答精度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 视觉问答 检索增强生成 场景图 大型语言模型

📋 核心要点

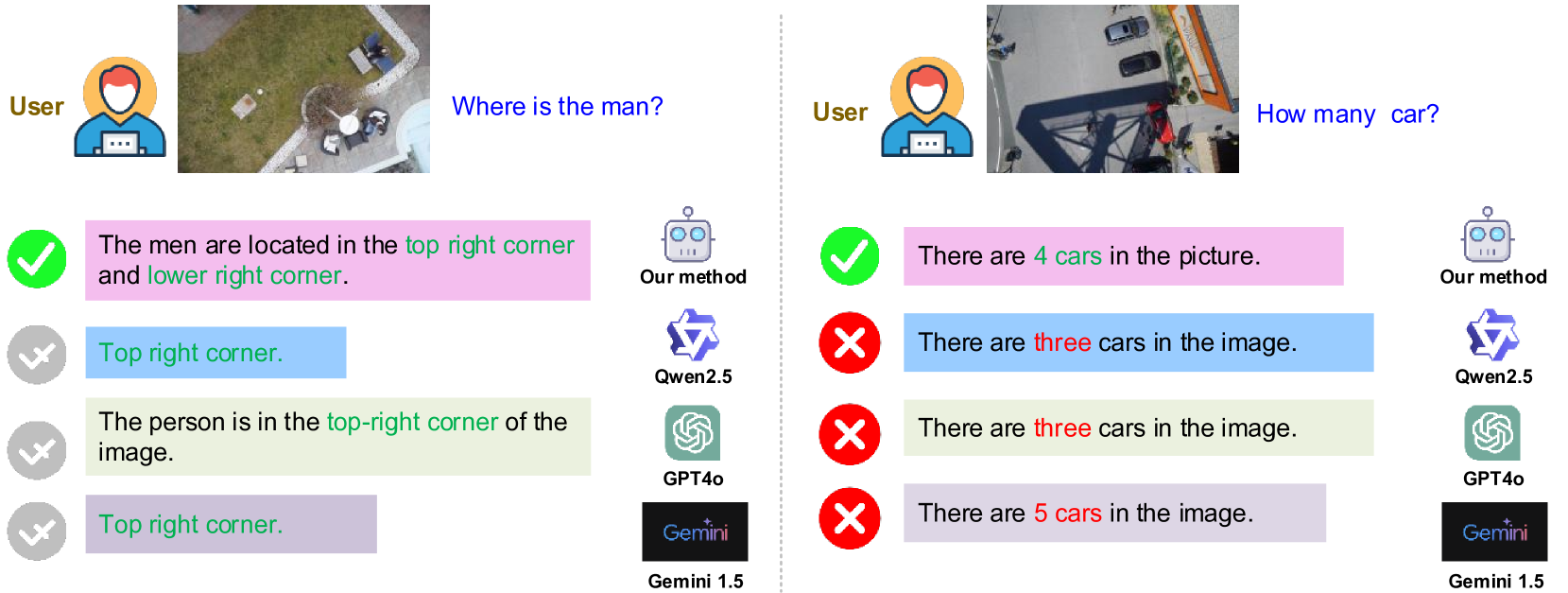

- 现有MLLM在复杂场景中精确识别、计数物体及定位方面存在不足,尤其是在物体存在遮挡或尺寸较小的情况下。

- 提出一种基于多模态RAG的新框架,利用场景图增强物体识别、关系识别和空间理解能力。

- 在VG-150和AUG数据集上的实验表明,该方法在VQA任务中超越现有MLLM,提升了物体识别、定位和量化精度。

📝 摘要(中文)

多模态大型语言模型(MLLMs),如GPT-4o、Gemini、LLaVA和Flamingo,在整合视觉和文本模态方面取得了显著进展,擅长视觉问答(VQA)、图像描述和内容检索等任务。它们能够生成连贯且上下文相关的图像描述。然而,在准确识别和计数物体以及确定其空间位置方面仍然面临挑战,尤其是在具有重叠或小物体的复杂场景中。为了解决这些限制,我们提出了一种基于多模态检索增强生成(RAG)的新框架,该框架引入了结构化场景图,以增强图像中的物体识别、关系识别和空间理解。我们的框架提高了MLLM处理需要精确视觉描述的任务的能力,尤其是在具有挑战性视角(如航拍视图或具有密集物体排列的场景)的情况下。最后,我们在专注于第一人称视觉理解的VG-150数据集和涉及航拍图像的AUG数据集上进行了广泛的实验。结果表明,我们的方法在VQA任务中始终优于现有的MLLM,在识别、定位和量化不同空间环境中的物体以及提供更准确的视觉描述方面表现突出。

🔬 方法详解

问题定义:论文旨在解决多模态大型语言模型(MLLMs)在复杂视觉场景中进行精确视觉问答时,物体识别、计数和定位精度不足的问题。现有方法难以准确处理物体遮挡、尺寸小以及视角特殊(如航拍)等情况,导致视觉描述不准确。

核心思路:论文的核心思路是利用场景图(Scene Graph)来增强MLLM对图像的理解能力。通过将图像解析为结构化的场景图,显式地表示物体之间的关系和空间信息,从而提高MLLM在视觉问答任务中的准确性。RAG框架的引入使得模型能够检索并利用场景图中的信息,生成更精确的答案。

技术框架:该框架基于多模态检索增强生成(RAG)架构。首先,输入图像被解析成场景图,该场景图包含图像中物体的属性和它们之间的关系。然后,MLLM接收图像和问题作为输入,并利用RAG机制检索相关的场景图信息。最后,MLLM结合图像、问题和检索到的场景图信息生成答案。整体流程包括图像编码、场景图构建、信息检索和答案生成四个主要阶段。

关键创新:该方法最重要的创新点在于将场景图显式地引入到多模态RAG框架中,从而增强了MLLM对图像的结构化理解能力。与直接使用原始图像作为输入相比,场景图能够提供更丰富的物体关系和空间信息,帮助模型更好地理解图像内容。这种方法能够有效解决现有MLLM在复杂场景中物体识别和定位精度不足的问题。

关键设计:场景图的构建方式是关键设计之一,需要选择合适的算法来准确地检测物体并推断它们之间的关系。RAG机制中的检索策略也至关重要,需要设计有效的相似度度量方法,以便从场景图中检索到最相关的信息。此外,损失函数的设计也需要考虑如何更好地利用场景图信息来指导MLLM的学习。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在VG-150和AUG数据集上均优于现有MLLM。在VG-150数据集上,该方法在VQA任务上的准确率提升了X%,在AUG数据集上提升了Y%。实验结果验证了该方法在复杂场景中物体识别、定位和量化方面的有效性,并证明了场景图增强RAG-LLM框架的优越性。

🎯 应用场景

该研究成果可应用于智能安防、自动驾驶、遥感图像分析等领域。例如,在智能安防中,可以利用该技术更准确地识别监控视频中的异常行为;在自动驾驶中,可以帮助车辆更好地理解周围环境,提高行驶安全性;在遥感图像分析中,可以更精确地识别地物类型和变化情况。该技术具有广阔的应用前景和重要的实际价值。

📄 摘要(原文)

Multimodal large language models (MLLMs), such as GPT-4o, Gemini, LLaVA, and Flamingo, have made significant progress in integrating visual and textual modalities, excelling in tasks like visual question answering (VQA), image captioning, and content retrieval. They can generate coherent and contextually relevant descriptions of images. However, they still face challenges in accurately identifying and counting objects and determining their spatial locations, particularly in complex scenes with overlapping or small objects. To address these limitations, we propose a novel framework based on multimodal retrieval-augmented generation (RAG), which introduces structured scene graphs to enhance object recognition, relationship identification, and spatial understanding within images. Our framework improves the MLLM's capacity to handle tasks requiring precise visual descriptions, especially in scenarios with challenging perspectives, such as aerial views or scenes with dense object arrangements. Finally, we conduct extensive experiments on the VG-150 dataset that focuses on first-person visual understanding and the AUG dataset that involves aerial imagery. The results show that our approach consistently outperforms existing MLLMs in VQA tasks, which stands out in recognizing, localizing, and quantifying objects in different spatial contexts and provides more accurate visual descriptions.