ReFlow6D: Refraction-Guided Transparent Object 6D Pose Estimation via Intermediate Representation Learning

作者: Hrishikesh Gupta, Stefan Thalhammer, Jean-Baptiste Weibel, Alexander Haberl, Markus Vincze

分类: cs.CV, cs.RO

发布日期: 2024-12-30

期刊: IEEE Robotics and Automation Letters, vol. 9, no. 11, pp. 9438-9445, Nov. 2024

💡 一句话要点

ReFlow6D:利用折射引导的中间表示学习实现透明物体6D位姿估计

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 6D位姿估计 透明物体 折射 中间表示学习 机器人抓取

📋 核心要点

- 透明物体的6D位姿估计因其折射和反射特性而极具挑战,传统方法难以准确估计。

- ReFlow6D通过学习一种对光线折射敏感的中间表示,该表示独立于环境和深度信息,从而实现鲁棒的位姿估计。

- 实验结果表明,ReFlow6D在透明物体位姿估计任务上显著优于现有方法,并在机器人抓取实验中验证了其有效性。

📝 摘要(中文)

本文提出了一种名为ReFlow6D的透明物体6D位姿估计新方法,该方法利用折射中间表示。与传统方法不同,ReFlow6D利用对RGB图像空间变化不敏感且独立于深度信息的特征空间。该方法从图像抠图技术中获得灵感,对通过透明物体的光路变形进行建模,从而产生独特的、特定于物体的中间表示,该表示由光折射引导,并且独立于物体被观察的环境。通过将这些中间特征集成到姿态估计网络中,ReFlow6D仅使用RGB图像作为输入,即可实现透明物体的精确6D姿态估计。该方法还引入了一种新的透明物体合成损失,从而促进了更优异的折射中间特征的生成。实验评估表明,该方法在TOD和Trans32K-6D数据集上显著优于最先进的方法。机器人抓取实验进一步表明,ReFlow6D的姿态估计精度有效地转化为现实世界的机器人任务。

🔬 方法详解

问题定义:透明物体的6D位姿估计是机器人操作中的一个关键问题,但由于其独特的折射和反射特性,使得传统的基于RGB-D或点云的方法难以准确估计其位姿。现有方法通常依赖于深度信息或对环境光照变化敏感的RGB特征,鲁棒性较差。

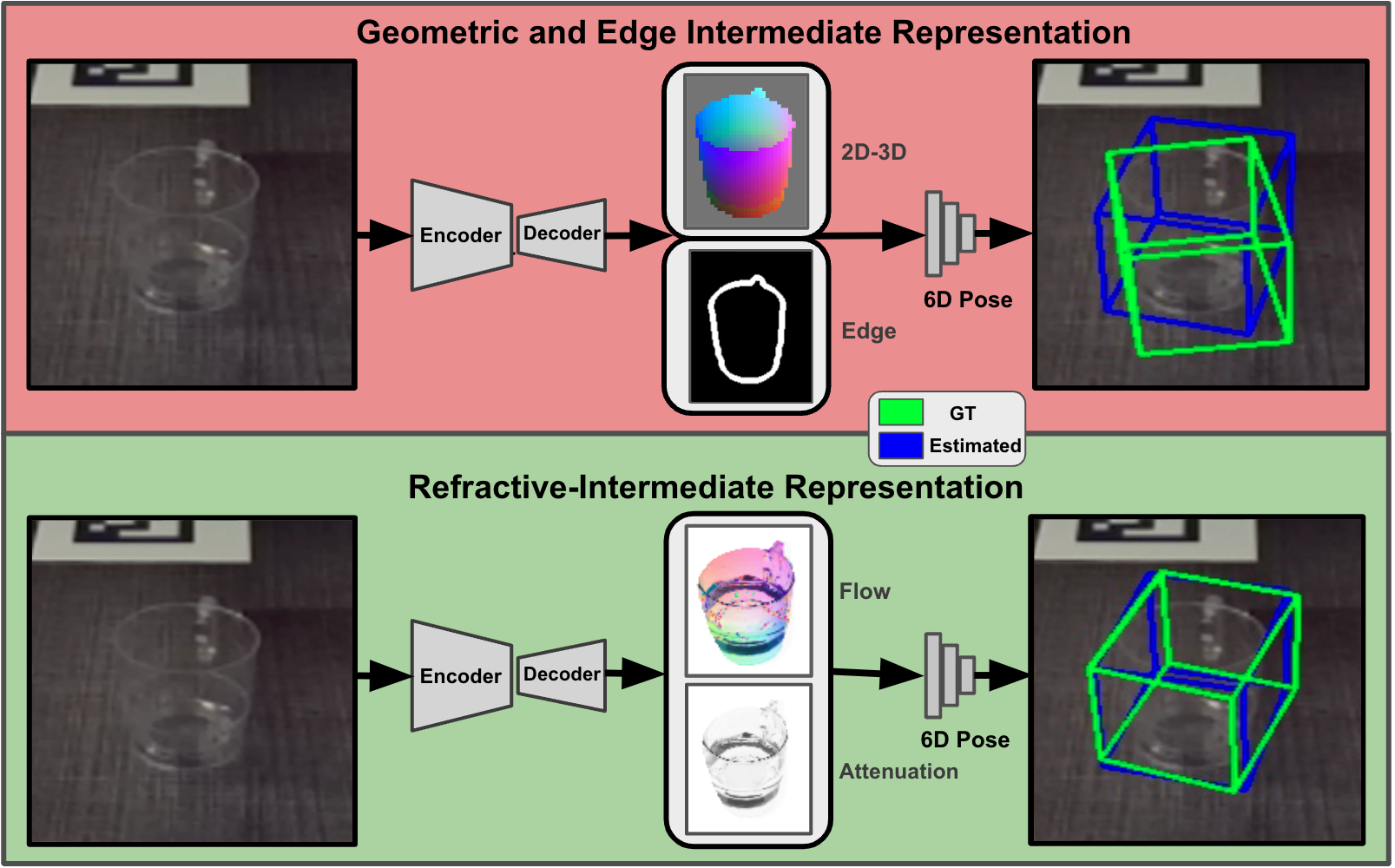

核心思路:ReFlow6D的核心思想是学习一种中间表示,该表示能够捕捉透明物体对光线的折射效应,并且独立于环境光照和深度信息。通过模拟光线在透明物体中的传播路径,生成一种特定于物体的、由折射引导的特征表示,从而实现更鲁棒的位姿估计。

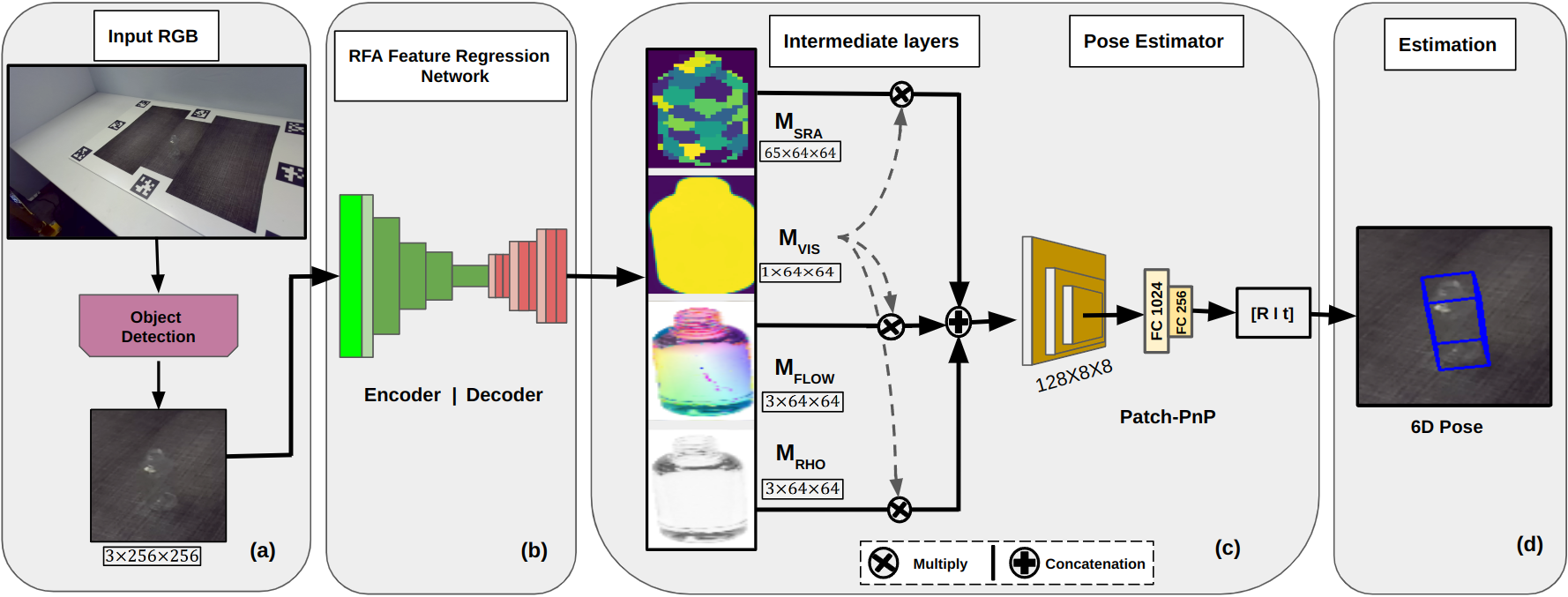

技术框架:ReFlow6D的整体框架包含以下几个主要模块:1) 折射中间表示生成模块:该模块利用RGB图像作为输入,通过一个神经网络学习透明物体的折射特性,并生成中间表示。2) 位姿估计模块:该模块将生成的中间表示作为输入,通过另一个神经网络预测物体的6D位姿。3) 透明物体合成模块:该模块用于生成训练数据,通过模拟透明物体的渲染过程,生成带有折射效应的图像。

关键创新:ReFlow6D的关键创新在于提出了折射中间表示的概念,并设计了一种新的透明物体合成损失函数。该中间表示能够有效地捕捉透明物体的折射特性,并且独立于环境光照和深度信息,从而提高了位姿估计的鲁棒性。透明物体合成损失函数则促进了更优异的折射中间特征的生成。

关键设计:ReFlow6D使用了一种基于U-Net的神经网络结构来生成折射中间表示。该网络以RGB图像作为输入,输出一个与输入图像大小相同的特征图,该特征图表示了光线在透明物体中的折射效应。此外,ReFlow6D还引入了一种新的透明物体合成损失函数,该损失函数鼓励网络生成更逼真的折射效果。该损失函数包括RGB损失、梯度损失和感知损失等。

🖼️ 关键图片

📊 实验亮点

ReFlow6D在TOD和Trans32K-6D数据集上取得了显著的性能提升。在TOD数据集上,ReFlow6D的ADD(-S)指标达到了state-of-the-art水平,超过了现有方法。在Trans32K-6D数据集上,ReFlow6D也取得了显著的性能提升,证明了其在透明物体6D位姿估计任务上的有效性。此外,机器人抓取实验也验证了ReFlow6D的位姿估计精度能够有效地转化为现实世界的机器人任务。

🎯 应用场景

ReFlow6D在机器人操作、自动驾驶、增强现实等领域具有广泛的应用前景。例如,在机器人操作中,可以利用ReFlow6D实现对透明物体的精确抓取和操作。在自动驾驶中,可以利用ReFlow6D识别和跟踪透明物体,如挡风玻璃和交通标志。在增强现实中,可以利用ReFlow6D将虚拟物体与真实透明物体进行无缝融合。

📄 摘要(原文)

Transparent objects are ubiquitous in daily life, making their perception and robotics manipulation important. However, they present a major challenge due to their distinct refractive and reflective properties when it comes to accurately estimating the 6D pose. To solve this, we present ReFlow6D, a novel method for transparent object 6D pose estimation that harnesses the refractive-intermediate representation. Unlike conventional approaches, our method leverages a feature space impervious to changes in RGB image space and independent of depth information. Drawing inspiration from image matting, we model the deformation of the light path through transparent objects, yielding a unique object-specific intermediate representation guided by light refraction that is independent of the environment in which objects are observed. By integrating these intermediate features into the pose estimation network, we show that ReFlow6D achieves precise 6D pose estimation of transparent objects, using only RGB images as input. Our method further introduces a novel transparent object compositing loss, fostering the generation of superior refractive-intermediate features. Empirical evaluations show that our approach significantly outperforms state-of-the-art methods on TOD and Trans32K-6D datasets. Robot grasping experiments further demonstrate that ReFlow6D's pose estimation accuracy effectively translates to real-world robotics task. The source code is available at: https://github.com/StoicGilgamesh/ReFlow6D and https://github.com/StoicGilgamesh/matting_rendering.