Dialogue Director: Bridging the Gap in Dialogue Visualization for Multimodal Storytelling

作者: Min Zhang, Zilin Wang, Liyan Chen, Kunhong Liu, Juncong Lin

分类: cs.CV

发布日期: 2024-12-30

💡 一句话要点

Dialogue Director:提出一种多模态框架,用于将对话脚本转化为动态多视角故事板。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话可视化 多模态框架 故事板生成 思维链推理 检索增强生成 扩散模型 电影制作

📋 核心要点

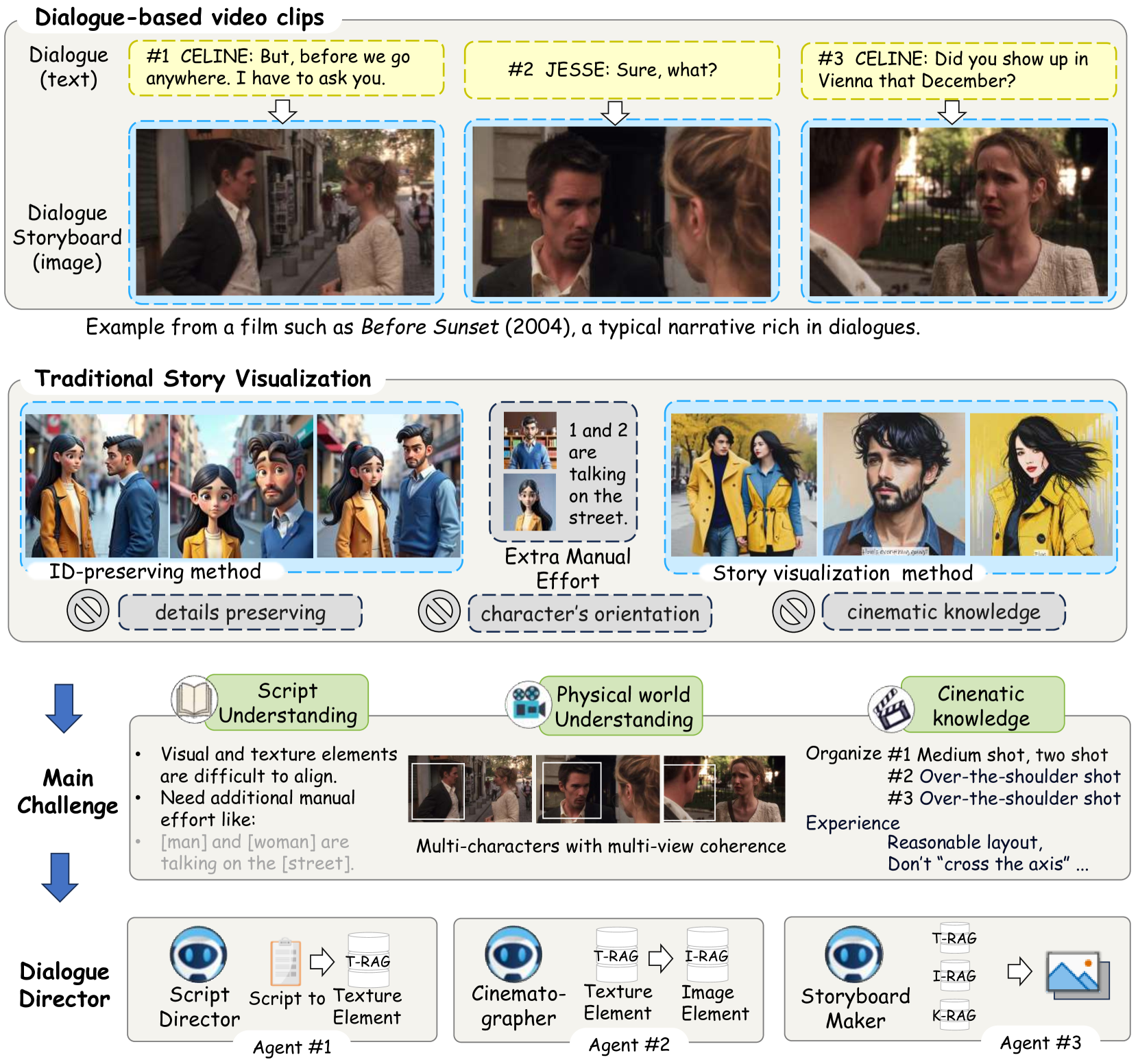

- 现有方法难以将对话脚本转化为连贯故事板,主要受限于脚本细节不足和对物理环境理解的欠缺。

- Dialogue Director 框架通过脚本导演、电影摄影师和故事板制作器三个模块,实现对话脚本到动态故事板的转化。

- 实验结果表明,Dialogue Director 在脚本理解、物理环境理解和电影原则应用方面均优于现有方法。

📝 摘要(中文)

人工智能驱动的叙事技术在视频生成和故事可视化方面取得了显著进展。然而,由于脚本细节有限、物理环境理解不足以及电影制作原则的复杂性,将以对话为中心的脚本转化为连贯的故事板仍然是一个重大挑战。为了解决这些挑战,我们提出了对话可视化,这是一个将对话脚本转化为动态、多视角故事板的新任务。我们引入了Dialogue Director,一个无需训练的多模态框架,包含脚本导演、电影摄影师和故事板制作器。该框架利用大型多模态模型和基于扩散的架构,采用思维链推理、检索增强生成和多视角合成等技术,以提高脚本理解、物理环境理解和电影知识整合。实验结果表明,Dialogue Director在脚本解释、物理世界理解和电影原则应用方面优于最先进的方法,显著提高了基于对话的故事可视化的质量和可控性。

🔬 方法详解

问题定义:论文旨在解决将对话脚本转化为动态、多视角故事板的问题。现有方法在处理此类任务时,面临着脚本细节不足、物理环境理解不够以及难以有效融入电影制作原则等痛点,导致生成的故事板质量和可控性都受到限制。

核心思路:论文的核心思路是构建一个多模态框架,该框架能够充分理解对话脚本的语义信息,并将其与物理世界的知识和电影制作的原则相结合,从而生成高质量的故事板。通过分解任务为脚本理解、场景构建和故事板生成三个阶段,并分别设计相应的模块来处理这些阶段,从而实现端到端的对话可视化。

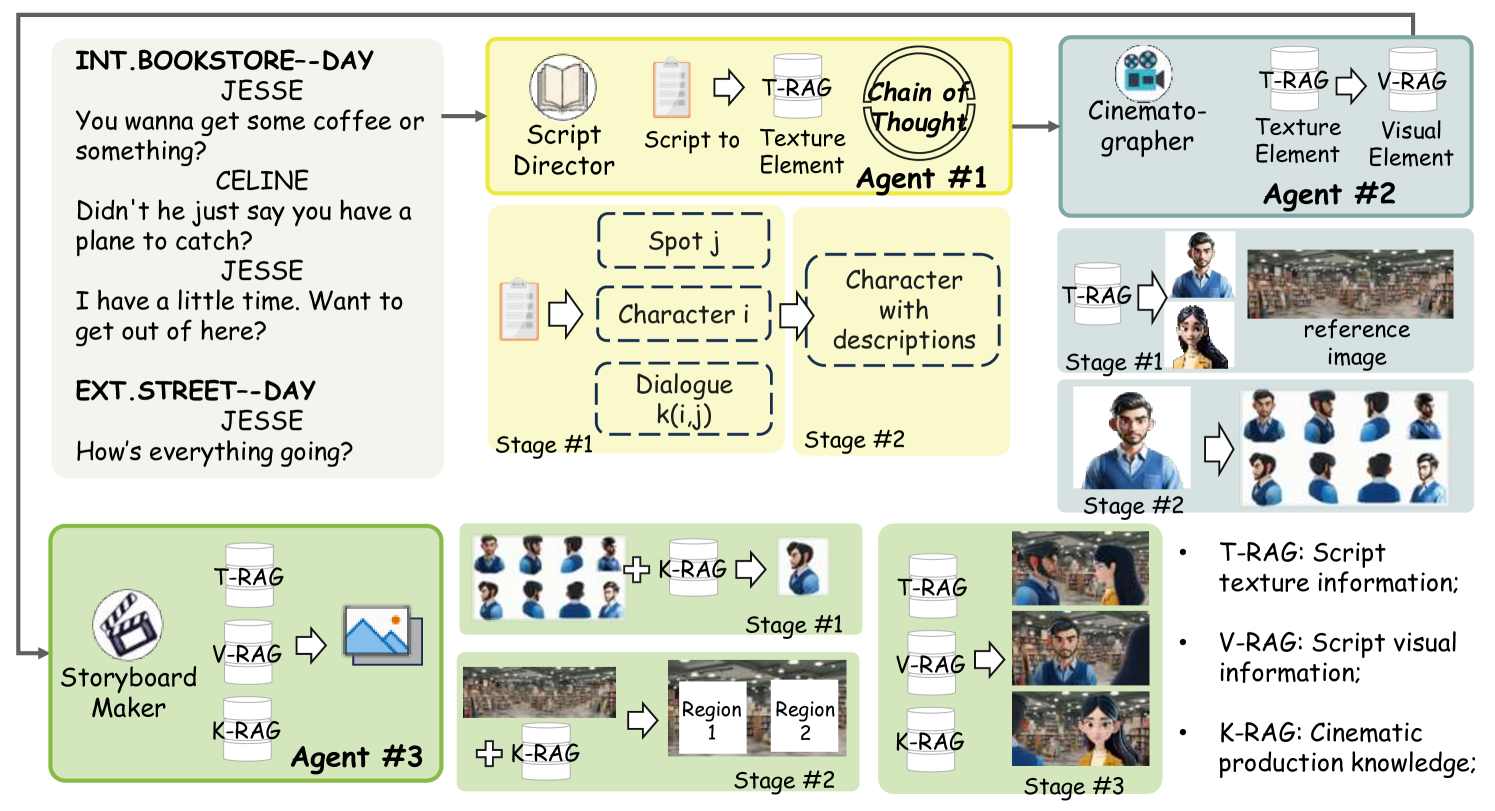

技术框架:Dialogue Director 框架包含三个主要模块:Script Director(脚本导演)、Cinematographer(电影摄影师)和 Storyboard Maker(故事板制作器)。Script Director 负责理解对话脚本,提取关键信息,并进行推理。Cinematographer 负责根据脚本信息和物理世界知识,构建场景描述和镜头规划。Storyboard Maker 负责根据场景描述和镜头规划,生成最终的故事板图像。整个流程是串行的,前一个模块的输出作为后一个模块的输入。

关键创新:该论文的关键创新在于提出了一个无需训练的多模态框架,能够有效地将对话脚本转化为动态、多视角的故事板。该框架通过结合大型多模态模型、扩散模型以及思维链推理、检索增强生成等技术,显著提高了脚本理解、物理环境理解和电影制作原则的应用能力。此外,将任务分解为三个模块,使得每个模块可以专注于解决特定的问题,从而提高了整体框架的效率和可控性。

关键设计:在 Script Director 模块中,使用了 Chain-of-Thought reasoning 来增强脚本理解能力。在 Cinematographer 模块中,使用了 Retrieval-Augmented Generation 来获取相关的物理世界知识。在 Storyboard Maker 模块中,使用了基于扩散的架构来进行多视角合成,从而生成高质量的故事板图像。具体的参数设置和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Dialogue Director 在脚本解释、物理世界理解和电影原则应用方面均优于现有方法。具体的性能数据和对比基线在摘要中未提供,属于未知信息。但论文强调,该方法显著提高了基于对话的故事可视化的质量和可控性。

🎯 应用场景

该研究成果可应用于电影制作、游戏开发、教育娱乐等领域。它可以帮助编剧和导演快速可视化剧本,辅助游戏开发者创建引人入胜的过场动画,并为教育领域提供更生动的教学内容。未来,该技术有望进一步提升故事可视化的自动化程度和质量,降低创作成本,并促进创意产业的发展。

📄 摘要(原文)

Recent advances in AI-driven storytelling have enhanced video generation and story visualization. However, translating dialogue-centric scripts into coherent storyboards remains a significant challenge due to limited script detail, inadequate physical context understanding, and the complexity of integrating cinematic principles. To address these challenges, we propose Dialogue Visualization, a novel task that transforms dialogue scripts into dynamic, multi-view storyboards. We introduce Dialogue Director, a training-free multimodal framework comprising a Script Director, Cinematographer, and Storyboard Maker. This framework leverages large multimodal models and diffusion-based architectures, employing techniques such as Chain-of-Thought reasoning, Retrieval-Augmented Generation, and multi-view synthesis to improve script understanding, physical context comprehension, and cinematic knowledge integration. Experimental results demonstrate that Dialogue Director outperforms state-of-the-art methods in script interpretation, physical world understanding, and cinematic principle application, significantly advancing the quality and controllability of dialogue-based story visualization.