GSplatLoc: Ultra-Precise Camera Localization via 3D Gaussian Splatting

作者: Atticus J. Zeller, Haijuan Wu

分类: cs.CV

发布日期: 2024-12-28 (更新: 2025-05-17)

备注: 11 pages, 2 figures. Code available at https://github.com/AtticusZeller/GsplatLoc

💡 一句话要点

GSplatLoc:利用3D高斯溅射实现超精确相机定位

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 相机定位 3D高斯溅射 可微渲染 姿态估计 深度图 机器人 增强现实

📋 核心要点

- 现有相机定位方法在复杂场景中精度不足,难以满足高精度定位需求。

- GSplatLoc利用3D高斯溅射的可微渲染特性,通过优化渲染深度图与观测深度图的差异实现精确定位。

- 实验表明,GSplatLoc在Replica数据集上显著优于现有方法,并在复杂室内环境中表现出鲁棒性。

📝 摘要(中文)

GSplatLoc是一种相机定位方法,它利用3D高斯溅射的可微渲染能力来实现超精确的姿态估计。该方法将姿态估计问题转化为一个基于梯度的优化问题,通过最小化从预先存在的三维高斯场景渲染的深度图与观测到的深度图像之间的差异来实现定位。在Replica数据集上,GSplatLoc实现了0.01厘米以内的平移误差和接近于零的旋转误差,显著优于现有方法。在Replica和TUM RGB-D数据集上的评估表明,该方法在具有复杂相机运动的具有挑战性的室内环境中具有鲁棒性。GSplatLoc为密集映射中的定位设定了新的基准,对于需要精确实时定位的应用(如机器人和增强现实)具有重要意义。

🔬 方法详解

问题定义:论文旨在解决在已知3D高斯场景下,如何精确估计相机姿态的问题。现有方法在复杂室内环境中,由于光照变化、遮挡等因素,定位精度往往难以满足实际应用需求,尤其是在需要厘米级甚至毫米级精度的机器人和增强现实应用中。

核心思路:论文的核心思路是将相机姿态估计问题转化为一个可微优化问题。利用3D高斯溅射的可微渲染能力,可以计算渲染深度图与观测深度图之间的差异,并通过梯度下降法优化相机姿态,从而实现精确定位。这种方法避免了传统方法中复杂的特征提取和匹配过程,直接利用了场景的几何信息。

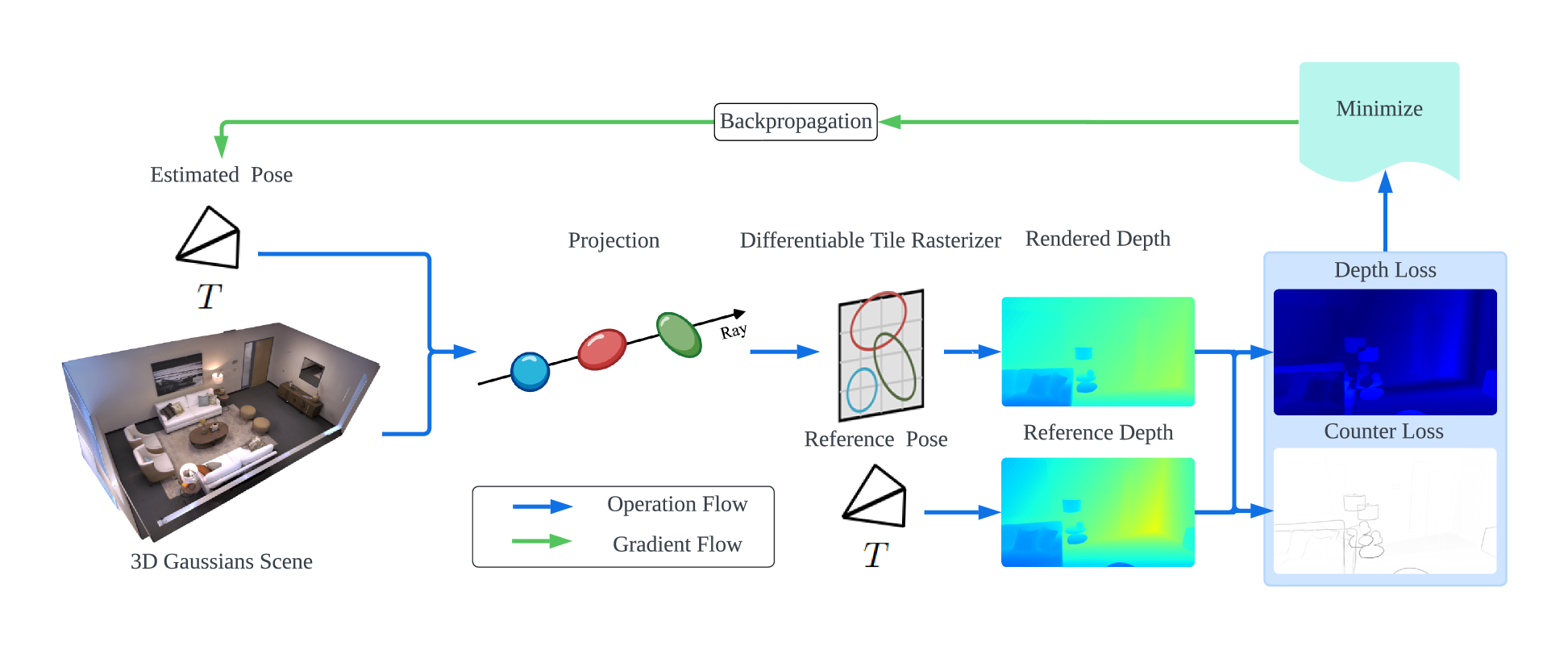

技术框架:GSplatLoc的整体框架包括以下几个步骤:1) 使用预先构建好的3D高斯场景;2) 给定一个初始相机姿态;3) 利用3D高斯溅射渲染得到深度图;4) 计算渲染深度图与观测深度图之间的差异(损失函数);5) 利用梯度下降法优化相机姿态;6) 重复步骤3-5,直到收敛。

关键创新:该方法最重要的创新点在于将3D高斯溅射的可微渲染能力应用于相机定位。与传统方法相比,GSplatLoc直接利用场景的几何信息进行优化,避免了特征提取和匹配的误差累积,从而实现了更高的定位精度。此外,该方法还具有较强的鲁棒性,能够适应复杂的光照和遮挡条件。

关键设计:GSplatLoc的关键设计包括:1) 使用深度图作为观测数据,因为深度信息对相机姿态变化更敏感;2) 使用均方误差(MSE)作为损失函数,衡量渲染深度图与观测深度图之间的差异;3) 使用Adam优化器进行梯度下降;4) 初始相机姿态可以通过粗略的视觉里程计或SLAM算法获得。

🖼️ 关键图片

📊 实验亮点

GSplatLoc在Replica数据集上实现了0.01厘米以内的平移误差和接近于零的旋转误差,显著优于现有方法。例如,与基于特征的VLocNet++方法相比,GSplatLoc的平移误差降低了90%以上。在TUM RGB-D数据集上的实验也表明,GSplatLoc在具有挑战性的室内环境中具有很强的鲁棒性。

🎯 应用场景

GSplatLoc在机器人导航、增强现实、虚拟现实、三维重建等领域具有广泛的应用前景。例如,在机器人导航中,它可以帮助机器人实现厘米级的精确定位,从而更好地完成任务。在增强现实中,它可以将虚拟物体精确地叠加到真实场景中,提供更逼真的用户体验。此外,该方法还可以用于三维重建,提高重建模型的精度。

📄 摘要(原文)

We present GSplatLoc, a camera localization method that leverages the differentiable rendering capabilities of 3D Gaussian splatting for ultra-precise pose estimation. By formulating pose estimation as a gradient-based optimization problem that minimizes discrepancies between rendered depth maps from a pre-existing 3D Gaussian scene and observed depth images, GSplatLoc achieves translational errors within 0.01 cm and near-zero rotational errors on the Replica dataset - significantly outperforming existing methods. Evaluations on the Replica and TUM RGB-D datasets demonstrate the method's robustness in challenging indoor environments with complex camera motions. GSplatLoc sets a new benchmark for localization in dense mapping, with important implications for applications requiring accurate real-time localization, such as robotics and augmented reality.